Estatística

Capítulo 4:

Distribuições Teóricas de

Probabilidades de Variáveis

Aleatórias Discretas

Professor Fernando Porto

Capítulo 4

• Baseado no Capítulo 4 do livro texto,

Distribuições Teóricas de Probabilidades de

Variáveis Aleatórias Discretas.

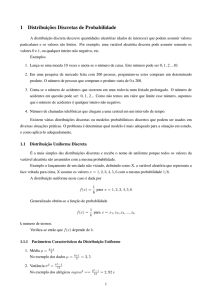

Distribuição de Bernoulli

Na área de teoria das probabilidades e estatística, a distribuição

de Bernoulli, nome em homenagem ao cientista suíço Jakob

Bernoulli, é a distribuição discreta de espaço amostral {0, 1},

que tem valor 1 com a probabilidade de sucesso p e valor 0 com a

probabilidade de falha q = 1 p.

Neste caso a variável aleatória X tem distribuição de Bernoulli e

sua função de probabilidade é dada por:

P(X = x) = px . q1-x

X

P(X)

X . P(X)

X2 . P(X)

0

q

0

0

1

p

p

p

1

p

p

Esperança:

E(X) = p

Variância:

VAR(X) = p – p2 = p . (1 – q) = p . q

Exemplo: Uma urna tem 30 bolas brancas e 20 verdes. Retira-se

uma bola dessa urna. Sendo X o número de bolas verdes,

calcular E(X) e VAR(X) e determinar P(X).

Distribuição Geométrica

A distribuição geométrica é constituída por duas funções de

probabilidade discretas:

a) a distribuição de probabilidade do número X de tentativas de

Bernoulli necessárias para alcançar um sucesso, suportadas

pelo conjunto { 1, 2, 3, ... }, ou

b) a distribuição de probabilidade do número Y = X 1 de

insucessos antes do primeiro sucesso, suportadas pelo

conjunto { 0, 1, 2, 3, ... }.

Se a probabilidade de sucesso de cada tentativa é p, então a

probabilidade de n tentativas serem necessárias para ocorrer um

sucesso é

P(X = n) = (1 – p)n-1 . p

para n = 1, 2, 3, .... De forma equivalente, a probabilidade de

serem necessários n insucessos antes do primeiro sucesso é

P(Y = n) = (1 – p)n . p

para n = 0, 1, 2, 3, ....

Em qualquer caso, a sequência de probabilidades é uma

progressão geométrica.

Média:

E(X) =

Variância:

VAR(X) =

Demonstrações no livro texto.

Exemplo: A probabilidade de se encontrar aberto o sinal de

trânsito numa esquina é 0,20. Qual a probabilidade de que seja

necessário passar pelo local 5 vezes, para encontrar o sinal aberto

pela primeira vez?

X: número de vezes necessárias para encontrar o sinal aberto.

p = 0,20; q = 0,80

P(X = 5) = (0,80)4 – (0,20) = 0,08192 = 8,192%

Distribuição de Pascal

A distribuição de Pascal ou distribuição binomial negativa indica

o número de tentativas necessárias para obter r sucessos de igual

probabilidade p ao fim de x experimentos de Bernoulli, sendo a

última tentativa um sucesso. A sua função de probabilidade é

dada por:

x = r, r + 1, ...

X é o número de repetições necessárias para que ocorram r

sucessos.

Importante: A distribuição Geométrica e fortemente relacionada

com a Binomial negativa. Na Geométrica queremos o número de

tentativas para obter o primeiro sucesso, ou seja, o tempo de

espera até que se tenha o evento de importância ou sucesso.

Média:

E(X) =

Variância:

VAR(X) =

Exemplo: Numa linha de montagem, 10% das peças são

defeituosas. Qual a probabilidade de que a quinta peça analisada

seja a segunda defeituosa?

Assim, x = 5; p = 10% ou 0,10; r = 2; q = 0,9

Distribuição Hipergeométrica

A distribuição hipergeométrica descreve a probabilidade de se

retirar k elementos do tipo A numa sequência de n extrações de

uma população finita de tamanho N, com r elementos do tipo A e

N-r elementos do tipo B, sem reposição.

Seja um conjunto com N elementos tal que existem r elementos

do tipo A e N-r elementos do tipo B. Um conjunto de n elementos

é selecionado, aleatoriamente e sem reposição, do conjunto de N

elementos. A variável aleatória X denota o número de elementos

tipo A. Então, X tem distribuição hipergeométrica e

onde k = 0,1,2,..., min(r, n) e onde

refere-se ao coeficiente

binomial, o número de combinações possíveis ao selecionar b

elementos de um total a.

O valor esperado da variável aleatória X é dado por E(X) = n.p e

a sua variância

Quando o tamanho da população é muito maior do que a amostra

(isto é, N é muito maior que n) a distribuição hipergeométrica é

razoavelmente bem aproximada pela distribuição binomial com

parâmetros n (número de tentativas) e p = K / N (probabilidade de

sucesso numa tentativa única).

Exemplo: Pequenos motores são guardados em caixas de 50

unidades. Um inspetor de qualidade examina cada caixa, antes da

posterior remessa, testando 5 motores. Se nenhum motor for

defeituoso, a caixa é aceita. Se pelo menos um for defeituoso,

todos os 50 são testados. Há 6 motores defeituosos numa caixa.

Qual a probabilidade de que seja necessário examinar todos os

motores dessa caixa?

X: número de motores defeituosos da amostra.

N = 50; r = 6; n = 5.

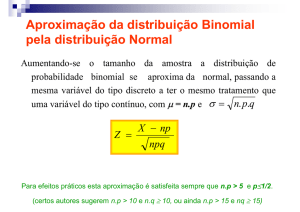

Distribuição Binomial

É a distribuição de probabilidade discreta do número de sucessos

numa sequência de n tentativas tais que:

1. Cada tentativa tem exclusivamente como resultado duas

possibilidades, sucesso ou fracasso;

2. Cada tentativa é independente das demais;

3. A probabilidade de sucesso p a cada tentativa permanece

constante independente das demais;

4. A variável de interesse é o número de sucessos k nas n

tentativas.

A variável aleatória X é o número de tentativas que resultam em

sucesso. A probabilidade de ter exatamente k sucessos é dado pela

função de probabilidade:

Esperança:

E(X) = n . p

Variância:

VAR(X) = n . p . (1 – p)

Demonstrações no livro texto.

Exemplo: Uma moeda é lançada 20 vezes. Qual a probabilidade

de saírem 8 caras?

X: número de sucessos (caras)

X = 0, 1, 2, ..., 20

Probabilidades de cara em um lançamento: p = 0,5

Portanto k = 8; n = 20; p = 0,5

Exemplo: Uma prova tipo teste tem 50 questões independentes.

Cada questão tem 5 alternativas. Apenas uma das alternativas é a

correta. Se um aluno resolve a prova respondendo a esmo as

questões, qual a probabilidade de acertar metade das questões?

X: número de acertos

X: 0, 1, 2, ..., 50

Probabilidades de acerto de 1 questão: p = 1/5 = 0,2

Portanto k = 25; n = 50; p = 0,2

Exemplo: Achar a média e a variância da variável aleatória Y =

3X + 2, sendo X com n = 20; p = 0,3

E(X) = n ´ p = 20 ´ 0,3 = 6

VAR(X) = n ´ p ´ q = 20 ´ 0,3 ´ 0,7 = 4,2

Logo

E(Y) = E(3X + 2) = 3 ´ E(X) + 2 = 3 ´ 6 + 2 = 20

VAR(Y) = VAR(3X + 2) = 9 ´ VAR(X) = 9 ´ 4,2 = 37,8

Distribuição Multinomial

A distribuição multinomial ou polinomial é uma generalização da

distribuição binomial.

Assim consideremos a possibilidade de k alternativas, isto é

repartirmos o espaço amostral em k eventos X1, X2, X3, ..., Xk

mutuamente exclusivos, com probabilidades p1, p2, p3, ..., pk, tais

que

p1 + p2 + p3 + ... + pk = 1

Então em k eventos a probabilidade de que X1 ocorra n1 vezes, X2

ocorra n2 vezes, X3 ocorra n3 vezes ... Xk ocorra nk vezes, é dado

por:

Esperança:

E(Xi) = ni . pi

Variância:

VAR(Xi) = ni . pi . (1 – pi)

sendo i = 1, 2, ... k

Demonstrações no livro texto.

Exemplo: Uma urna tem 6 bolas brancas, 4 pretas e 5 azuis.

Retiram-se 8 bolas com reposição. Qual a probabilidade de sair 4

bolas brancas, 2 pretas e 2 azuis?

X1: saída de 4 bolas brancas

X2: saída de 2 bolas pretas

X3: saída de 2 bolas azuis

X1 + X2 + X3 = 8

Distribuição de Poisson

A distribuição de Poisson expressa a probabilidade de uma série

de eventos ocorrer num certo período de tempo se estes eventos

ocorrem independentemente de quando ocorreu o último evento.

A distribuição foi descoberta por Siméon-Denis Poisson (17811840) e publicada, conjuntamente com a sua teoria da

probabilidade, em 1838 no seu trabalho Recherches sur la

probabilité des jugements en matières criminelles et matière

civile ("Inquérito sobre a probabilidade em julgamentos sobre

matérias criminais e civis"). O trabalho focava-se em variáveis

aleatórias N que contavam, entre outras coisas, o número de

ocorrências discretas de um certo fenômeno durante um intervalo

de tempo de determinada duração.

A probabilidade de que existam exatamente k ocorrências (k

sendo um inteiro não negativo, k = 0, 1, 2, ...) é

onde

• e é base do logaritmo natural (e = 2,718281828...),

• λ é um número real, igual ao número esperado de ocorrências

que ocorrem num dado intervalo de tempo. Por exemplo, se o

evento ocorre a uma média de 4 minutos, e estamos

interessados no número de eventos que ocorrem num intervalo

de 10 minutos, usaríamos como modelo a distribuição de

Poisson com λ = 10/4 = 2,5.

Esperança:

E(X) = l

Variância:

VAR(X) = l

Demonstrações no livro texto.

Exemplo: A probabilidade de uma lâmpada se queimar ao ser

ligada é de 1/100. Numa instalação com 100 lâmpadas, qual a

probabilidade de 2 lâmpadas se queimarem ao serem ligadas,

usando Poisson?

l = n . p = 100 ´ 0,01 = 1

Exemplo: Numa central telefônica chegam 300 telefonemas por

hora. Qual a probabilidade de que:

a) Num minuto não haja nenhum chamado.

b) Em 2 minutos haja 2 chamados.

c) Em t minutos não haja chamados.

a) X: número de chamadas por minuto ® l = 5

b) Dois minutos ® l = 10

c) Tempo de t minutos ® l = 5t

• A distribuição de Poisson representa um modelo

probabilístico adequado para o estudo de um grande

número de fenômenos observáveis. Eis alguns exemplos:

•

•

•

•

Chamadas telefônicas por unidade de tempo;

Defeitos por unidade de área;

Acidentes por unidade de tempo;

Chegada de clientes a um supermercado por unidade de

tempo;

• Número de glóbulos sanguíneos visíveis ao microscópio

por unidade de área;

• Número de partículas emitidas por uma fonte de material

radioativo por unidade de tempo.

• Estatística Básica

• Luiz Gonzaga Morettin

• Pearson Prentice Hall, 2010.

Páginas da Wikipédia referentes à:

• Distribuição de Bernoulli;

• Distribuição Geométrica;

• Distribuição Hipergeométrica;

• Distribuição de Pascal;

• Distribuição Binomial;

• Distribuição Multinomial;

• Distribuição de Poisson.