CAPÍTULO 6

DISTRIBUIÇÕES DISCRETAS DE PROBABILIDADE

1. Introdução

Existem muitas relações, tais como a exponencial, a quadrática, a linear, a

parabólica, que são usadas para descrever a funcionalidade entre as variáveis

determinísticas. No caso das variáveis aleatórias, certas distribuições de probabilidade

são usadas com mais frequência para descrever a grande maioria dos fenômenos

físicos.

As distribuições de probabilidade, para variáveis aleatórias discretas, mais

comumente usadas em engenharia e que desenvolvem um papel importante na

metodologia estatística são: Binomial, Poisson, Geométrica, Pascal e

Hipergeométrica.

2. Distribuição Binomial

A distribuição binomial é aplicada frequentemente para descrever controle

estatístico de qualidade de uma população. Tem-se interesse principalmente em duas

categorias: item defeituoso ou insatisfatório versus item bom ou satisfatório e sucesso

e falha que tenham ocorrido em uma amostra de tamanho fixo.

A distribuição binomial é aplicada a eventos provenientes de uma série de

experimentos aleatórios, que constituem o chamado Processo de Bernoulli.

2.1. Processo de Bernoulli

Este processo é análogo àquele de jogar uma moeda. As seguintes suposições

se aplicam:

a) Cada experimento é dito ser uma tentativa. Existe uma série de tentativas,

cada uma tendo dois resultados: sucesso ou falha;

b) A probabilidade de sucesso é igual a algum valor constante para todas as

tentativas;

c) Os resultados sucessivos são estatisticamente independentes. A

probabilidade de sucesso na próxima tentativa não pode variar, não

importando quantos sucessos ou falhas tenham sido obtidos.

O processo de Bernoulli é comumente utilizado em aplicações de engenharia

envolvendo controle de qualidade. Cada novo item criado no processo de produção

pode ser considerado como uma tentativa resultando em uma unidade com ou sem

1

defeito. Este processo não se limita a objetos; podendo ser usado em pesquisas

eleitorais e de preferências dos consumidores por determinados produtos.

2.2. Probabilidades Binomiais

A distribuição binomial está relacionada ao número de sucessos encontrados

em um número específico de tentativas de um processo de Bernoulli. Ela é

caracterizada por dois parâmetros: (0 1), a probabilidade de sucesso, e n o

número de tentativas (número positivo).

No exemplo das meninas, dado anteriormente, construiu-se uma árvore de

probabilidade, onde 3 tentativas (nascimentos) foram feitas com o objetivo do casal

ter uma menina. Imagine agora a enorme árvore (aproximadamente 6 metros de

altura) que se teria que construir se fossem feitas 10 tentativas ! De modo a evitar isto,

a equação abaixo é usada para descrever a probabilidade de uma variável aleatória X,

que denota o número de sucessos em n tentativas do processo de Bernoulli, utilizando

k itens.

n

(1)

P( X k ) b(k ; n, ) p( x) k (1 ) n k para k=0,1,2,...,n

k

P( X k ) 0 para caso contrário

(2)

onde

n

n!

(3)

k k!(n k )!

Exemplo 1: Calcular novamente as probabilidades do casal ter meninas em três

nascimentos.

Solução:

a) k=0; =0.48; n=3

P( X 0)

3 * 2 *1

* 0.48 0 * (1 0.48) 30 0.14

1 * (3 0)!

(4)

3 * 2 *1

* 0.48 * (1 0.48) 31 0.39

1 * (3 1)!

(5)

3 * 2 *1

* 0.48 2 * (1 0.48) 32 0.36

2 *1 * (3 2)!

(6)

3 * 2 *1

* 0.483 * (1 0.48) 33 0.11

3 * 2 *1 * (3 3)!

(7)

b) k=1; =0.48; n=3

P( X 1)

c) k=2; =0.48; n=3

P( X 2)

d) ) k=3; =0.48; n=3

P( X 3)

2

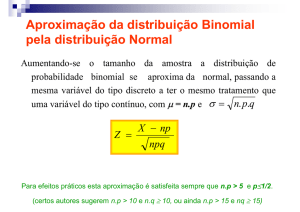

A Figura 6.1 apresenta 3 distribuições binomiais, onde se observa que à

medida que o número de tentativas cresce, as probabilidades vão diminuindo e

ficando menos concentradas, tendo a distribuição um formato de sino, independente

do parâmetro , a probabilidade de sucesso.

P(X=k)

P(X=k)

n=5

=0.30

n=10

=0.30

k

(a)

k

(b)

P(X=k)

n=20

=0.30

k

Figura 6.1 – Distribuições Binomiais

A Figura 6.2 mostra como a distribuição binomial é influenciada pela

probabilidade de sucesso, . Percebe-se que os pares p(x)=0.05;0.95, 0.20;0.80 e

0.40;0.60 (cuja soma é igual a 1) fornecem distribuições de probabilidade que são

imagens no espelho.

ndividuais, aplicáveis a todos os níveis da variável aleatória que estão em ou abaixo

2.3. Valor Esperado e Variância

O valor esperado e a variância da variável aleatória X, quantos sucessos

obtidos em um certo número de tentativas, são dados, respectivamente, por:

E ( X ) n

Var ( X ) n (1 )

(8)

(9)

3

Figura 6.2

2.4. Probabilidade Cumulativa

O cálculo das probabilidades binomiais é árduo para valores altos de tentativas

(n). Assim, existe uma tabela com os valores das probabilidades binomiais

cumulativas, que por sua vez são obtidas através da soma das probabilidades

individuais, aplicáveis a todos os níveis da variável aleatória que estão em ou abaixo

um ponto especificado. Em resumo, a probabilidade binomial cumulativa

(representada pela letra maiúscula B) é definida pela equação abaixo.

k

P( X k ) B(k ; n, ) P( X j )

(10)

j 0

Para o Exemplo 1, fica-se com a Tabela 6.1.

No caso de se querer a probabilidade cumulativa para 2 meninas ou menos,

tem-se o seguinte:

P( X 2) P( X 0) P( X 1) P( X 2) 0.89

(11)

4

Tabela 6.1 – Probabilidades Binomiais Cumulativas

Número de Meninas

Probabilidade Individual

k

P(X=k)

0

1

2

3

Probabilidade

Cumulativa

P(Xk)

0.14

0.53

0.89

1.00

0.14

0.39

0.36

0.11

Estes resultados podem ser colocados em forma gráfica, como apresentados

nas Figuras 6.3 e 6.4 abaixo:

P(k)

k

Figura 6.3 – Distribuição Individual de Probabilidade

P(Xk)

1.00

0.89

0.11

0.36

0.53

0.39

0.14

k

0

1

2

3

Figura 6.4 – Distribuição Cumulativa de Probabilidade

A Figura 6.4 tem formato de uma escada em que a diferença entre os

patamares representa a probabilidade para um determinado valor de k.

As tabelas existentes da probabilidade binomial são dadas em anexo.

Exemplo 2: Como exemplo, considere uma amostra com 100 pessoas que são

escolhidas aleatoriamente. Elas devem escolher entre dois tipos de carro: clássico ou

5

esporte. Assuma que 40% da população escolheu o tipo clássico de carro e considere

esta probabilidade como sendo igual a de sucesso, . Pela tabela em anexo, vê-se que

a probabilidade de que 35% ou menos da população escolha o modelo clássico é:

P( X 35) 0.1795

(12)

Para o caso de no mínimo 50% da população preferir o modelo clássico, temse:

P( X 50) 1 P( X 49) 1 0.9729

(13)

A probabilidade que entre 40% e 50%, inclusive, prefira o modelo clássico é:

P(40 X 50) P( X 50) P( X 39) 0.9832 0.4621 .5211

(14)

A probabilidade de que exatos 38% respondam a favor do modelo clássico é

dada por:

P( X 38) P( X 38) P( X 37) 0.3822 0.3068 0.0754

(15)

Para probabilidades de sucesso maiores que 50%, a tabela de probabilidade

binomial cumulativa deve ser usada como imagem no espelho da probabilidade que

realmente se quer calcular.

Exemplo 3: Qual é a probabilidade de se conseguir pelo menos 15 caras, se uma

moeda assimétrica, com probabilidade de sucesso igual a 60%, for arremessada 20

vezes ? Neste caso, define-se sucesso o evento oposto; isto é, a obtenção de coroa, que

tem obviamente a probabilidade de sucesso igual a 40%. Calcula-se então a

probabilidade de se obter no máximo 5 coroas que será igual à probabilidade de se ter

pelo menos 15 caras.

P(no min imo 15 caras ) P( X 5 coroas ) 0.1256

(16)

3. Distribuição de Poisson

A distribuição de Poisson é uma das mais usadas para variáveis aleatórias

discretas. Sua aplicação mais comum é na descrição de dados sobre, por exemplo,

número diário de telefonemas a uma central telefônica, número de carros que passam

por um cruzamento (ou uma cabine de pedágio) durante um certo período de tempo e

em análises de confiança em uma linha de produção (saber probabilidades de falhas).

Os eventos devem ocorrer em um certo intervalo de tempo ou espaço.

3.1. Processo de Poisson

Imagine que se está interessado em saber o número de lâmpadas queimadas

em uma rua, durante 12 dias do mês de agosto. Cada lâmpada queimada é considerada

um evento. Obtém-se o seguinte resultado, tendo-se uma taxa média de =1 (uma

lâmpada queimada diariamente).

6

01

02

03

04

05

06

07

08

09

10

11

12

tempo

Todo o processo de Poisson tem as seguintes propriedades:

a) O número de eventos ocorrendo em um segmento de tempo ou espaço é

independente do número de eventos ocorridos no segmento anterior; o

processo de Poisson não tem memória;

b) A taxa média do processo, , deve permanecer constante durante o período

de tempo e espaço considerados;

c) Quanto menor o segmento de tempo e espaço, menor a probabilidade de

ocorrer mais de um evento naquele segmento. A probabilidade de

ocorrência de 2 ou mais eventos se aproxima de zero, quando o tamanho

do segmento se aproxima de zero.

3.2. Probabilidades de Poisson

A distribuição de Poisson é dada por:

p( x; , t ) P( X x)

(t ) x e t

x!

para x=0,1,2,...

(17)

em que os parâmteros e t são a taxa média do processo e o intervalo de

tempo/espaço, respectivamente.

Exemplo 4: Considere o horário de pico do uso da ponte Rio-Niterói (saída para

feriadão, por exemplo). Suponha que 600 carros por hora passem pelo pedágio. Estáse interessado no número de carros que chegam, variável X, durante um período de 12

segundos. Assim, tem-se =600 e t=1/300 h. As unidades de e t devem ser as

mesmas. As probabilidades de X são dadas abaixo:

7

P( X

P( X

P( X

P( X

2 0 e 2

0) p(0 : 600,1 / 300)

0.1353

0!

21 e 2

1) p(1 : 600,1 / 300)

0.2707

1!

2 2 e 2

2) p(2 : 600,1 / 300)

0.2707

2!

2 3 e 2

3) p(3 : 600,1 / 300)

0.0361

3!

(18)

P( X 10) p (10 : 600,1 / 300)

210 e 2

0.0000382

10!

Observa-se que à medida que X aumenta, as probabilidades de Poisson tendem

rapidamente a zero. Os resultados anteriores mudam completamente se os valores dos

parâmteros e t forem alterados.

Embora 2 ou mais carros possam chegar à ponte em um intervalo de tempo

muito curto, a probabilidade deles chegarem ao mesmo tempo é considerada zero.

Mesmo havendo alguns exemplos práticos em que os carros cheguem ao mesmo

tempo, a distribuição de Poisson é um modelo teórico que satisfaz plenamente.

3.3. Função Distribuição de Poisson

A função distribuição de Poisson ou probabilidade cumulativa de Poisson é

dada por:

x

P( x; , t ) P( X x) p( j; , t )

(19)

j 0

As probabilidades cumulativas de Poisson são dadas nas tabelas em anexo.

Exemplo 5: Calcule o número de ruídos encontrados em um vídeo, que tem =0.1 por

pé, em um segmento de fita igual a 200 ft de comprimento.

Solução: t=0.1*200=20. Pela Tabela 6.2, tem-se que a probabilidade de se encontrar

menos de 15 vezes este defeito é igual a:

P(14;0.1,200) P( X 15) 0.1049

(20)

A probabilidade de que mais de 20 defeitos sejam encontrados é dada por:

P( X 20) 1 P(20) 1 0.5591 0.4409

(21)

A probabilidade de se encontrar exatamente 20 defeitos é igual a:

P( X 20) P(20) P(19) 0.5591 0.4703 0.0888

(22)

8

3.4. Valor Esperado e Variância

O valor esperado e a variância de uma distribuição de Poisson são iguais a:

E ( X ) t

Var ( X ) t

(23)

(24)

Assim, vê-se que o valor esperado de carros passando pelo pedágio deve

dobrar se dobramos o tempo de observação, o mesmo acontecendo com a variância.

3.5. Aproximação da Distribuição de Binomial pela Distribuição de Poisson

As distribuições de Poisson e binomial estão relacionadas entre si, através da

seguinte consideração: divida o intervalo de tempo em muitos segmentos de

comprimento t e suponha que cada um seja uma tentativa, tendo dois possíveis

resultados: ocorrência ou não de um evento relevante. Mostra-se que:

t

lim b x; , t p( x; , t )

t

t 0

;

(25)

ou seja, a distribuição binomial se aproxima da distribuição de Poisson. Esta

aproximação é usada quando os cálculos com uma distribuição é mais difícil que com

a outra. Por exemplo, quando a probabilidade de sucesso é pequena e n é um

número grande, as duas distribuções podem ser aproximadas, fazendo t=n. Assim:

(n ) x e n

b( x; n, )

x!

para x=0,1,2,...,n

(26)

A Tabela 6.2 apresenta uma comparação entre as duas distribuições, para

n=100 e =0.01; ou seja, t=100*0.01=1

Tabela 6.2 – Comparação entre as Distribuições Binomial e de Poisson

Número de Sucessos

x

0

1

2

3

4

5

Binomial Exata

b(x;100,0.01)

0.3660

0.3698

0.1848

0.0610

0.0150

0.0029

Aproximada por Poisson

0.3679

0.3679

0.1839

0.0613

0.0153

0.0031

9

4. Distribuição Hipergeométrica

A distribuição hipergeométrica é uma das mais importantes distribuições de

probabilidade para variáveis discretas usadas em amostragem estatística. Ela fornece

probabilidades para o número de observações amostrais de uma categoria particular

que pode ser obtida. A diferença básica entre esta distribuição e a binomial é que esta

última requer independência entre as tentativas, o que torna impraticável sua

utilização na avaliação de investigações amostrais de populações pequenas, a menos

que a amostragem seja feita com reposição. Por exemplo, em controle de qualidade de

equipamentos eletrônicos, testes são feitos com a destruição da amostra, não podendo

pois haver reposição.

A distribuição hipergeométrica pode ser melhor entendida através do seguinte

exemplo:

Exemplo 6: Considere um carregamento de 25 transformadores, dos quais uma

amostra de 4 deles será testada do ponto de vista ambiental. Cada transformador do

carregamento será considerado satisfatório (S) ou defeituoso (D). A Figura 6.4

apresenta a árvore de probabilidade, supondo que 20% dos transformadores são

defeituosos (o que representa 5 transformadores do total). Naturalmente, este fato é

desconhecido do setor de testes, que deve aceitar ou rejeitar o carregamento com base

no número de itens defeituosos encontrados na amostra.

Figura 6.4 – Árvore de Probabilidade para o Exemplo 6

10

Solução: Utilizando-se as informações da árvore, percebe-se que existem 4

possibilidades de se obter um item defeituoso; são elas: S1S2S3D4, S1S2D3S4, S1D2S3S4

e D1S2S3S4. Assim, a probabilidade de existir pelo menos um item defeituoso é dada

por:

34200

P( X 1) 4 *

0.45

(27)

303600

4.1. Probabilidades Hipergeométricas

De modo a evitar a construção da enorme árvore de probabilidade, utiliza-se a

Equação (28):

C kN C n(1k ) N

para k=0,1,...n ou N

(28)

P( X k ) h(k ; n, , N )

C nN

em que

b!

C ab

ou

(29)

a! (b a)!

b a 1 b

C ab

C a 1

a

,

(30)

N representa o tamanho da população a ser amostrada, n é o tamanho da amostra e é

a proporção de sucessos na população.

Então, no caso dos transformadores, tem-se: N=25, n=4 e =0.2. A

probabilidade de se ter transformador defeituoso é:

P( X 0) h(0;4,0.2,25)

P( X 1) h(1;4,0.2,25)

5

0

C C

C 425

5

1

20

4

20

3

25

4

C C

C

P( X 2) h(2;4,0.2,25)

5

2

C C

C 425

5! 20!

0! 5! 4! 16!

0.3830

25!

4! 21!

5! 20!

1! 4! 3! 17!

0.4506

25!

4! 21!

20

2

5! 20!

2! 3! 2! 18!

0.1502

25!

4! 21!

(31)

(32)

(33)

11

P( X 3) h(3;4,0.2,25)

P( X 4) h(4;4,0.2,25)

5

3

20

1

25

4

5

4

20

0

C C

C

C C

C 425

5! 20!

3! 2! 1! 19!

0.01581

25!

4! 21!

(34)

5! 20!

4! 1! 0! 20!

0.00040

25!

4! 21!

(35)

Uma outra forma de calcular essas probabilidades seria:

n k 1

N k 1

P( X k 1)

P( X k )

k

(1 ) N n k

(36)

A função distribuição de probabilidade hipergeométrica cumulativa é dada

por:

k

F (k ) P( X k ) h( j; n, , N )

(37)

j 0

Considerando o exemplo anterior, tem-se que:

F (3) P( X 3) 0.383 0.45059 0.15020 0.01581 0.99960

(38)

4.2. Valor Esperado e Variância

O valor esperado e a variância são dados por:

E ( X ) n

(39)

N n

Var ( X ) n (1 )

N 1

(40)

A diferença entre a Equação (40) e aquela que calcula a variância para a

distribuição binomial está no termo (N-n)/(N-1). Esta quantidade é chamada de fator

de correção para uma população finita. Note que quando o tamanho da amostra, n,

for próximo do tamanho da população, N, este termo é consideravelmente menor que

um, indicando que a variância da distribuição hipergeométrica é bem menor que a da

distribuição binomial. O significado prático deste fator de correção ficará mais

evidente, quando a distribuição hipergeométrica for aproximada pela distribuição

normal.

12

4.3. Aproximação da Distribuição Hipergeométrica para a Distribuição Binomial

Devido ao fato da distribuição binomial ser mais fácil de ser calculada e dispor

de tabelas, pode-se usar esta distribuição como uma aproximação para a distribuição

hipergeométrica, mesmo quando não há reposição dos itens. A aproximação é tanto

melhor quanto maior for o tamanho de N em relação a n. A Tabela 6.4 apresenta uma

comparação entre os valores calculados para as duas distribuições, no caso do

exemplo dos transformadores, com n=4 e =0.40. Estes parâmetros não alteram muito

a aproximação.

Tabela 6.4 – Comparação entre as Distribuições Binomial e Hipergeométrica

Número Possível

de Defeitos

k

0

1

2

3

Probabilidade

Binomial

b(k;n;)

0.4096

0.4096

0.1536

0.0016

Probabilidade Hipergeométrica

h(k;n, ,N)

N=25

N=100

0.38300

0.40333

0.45059

0.41905

.01581

0.02326

0.00040

0.00124

5. Distribuição Geométrica

A distribuição geométrica é a menos usada dentre as distribuições. Ela está

relacionada ao número de tentativas de um processo de Bernoulli, antes do primeiro

sucesso ser obtido. Em problemas de confiabilidade, este fato passa a ser algo

importante, que deve ser considerado. Por exemplo: a célula de potência de um

satélite pode durar indefinidamente até que haja uma colisão com um micro meteoro.

Cada dia é considerado como uma tentativa no processo de Bernoulli.

A expressão matemática para esta distribuição é dada abaixo:

p(k ) P( X k ) (1 ) k 1

para k=1,2,3,...

,

(41)

sendo X o número de tentativas no processo de Bernoulli até que o primeiro suceeso

seja atingido e a probabilidade de sucesso.

Exemplo 7: Cada dia, há uma probabilidade de =0.01 que um satélite seja

danificado em uma colisão. A probabilidade de sobrevivência diária é

consequentemente igual a 1-=0.99. Calcule a probabilidade de que o satélite seja

danificado exatamente no vigésimo e centésimo dias de operação.

Solução:

P( X 20) p(20) 0.01* (0.99)19 0.0083

P( X 100) p(100) 0.01* (0.99) 99 0.0037

(42)

(43)

A função de distribuição de probabilidade geométrica expressa a

probabilidade cumulativa de que o primeiro sucesso ocorra em ou antes da k-ésima

tentativa.

13

k

F (k ) P( X k ) p( x) 1 (1 ) k

(44)

x 1

5.1. Valor Esperado e Variância

O valor esperado e a variância são dados por:

E( X )

1

(45)

Var ( X )

1

2

(46)

14