UnilesteMG – Curso de Especialização em Automação e Controle

1

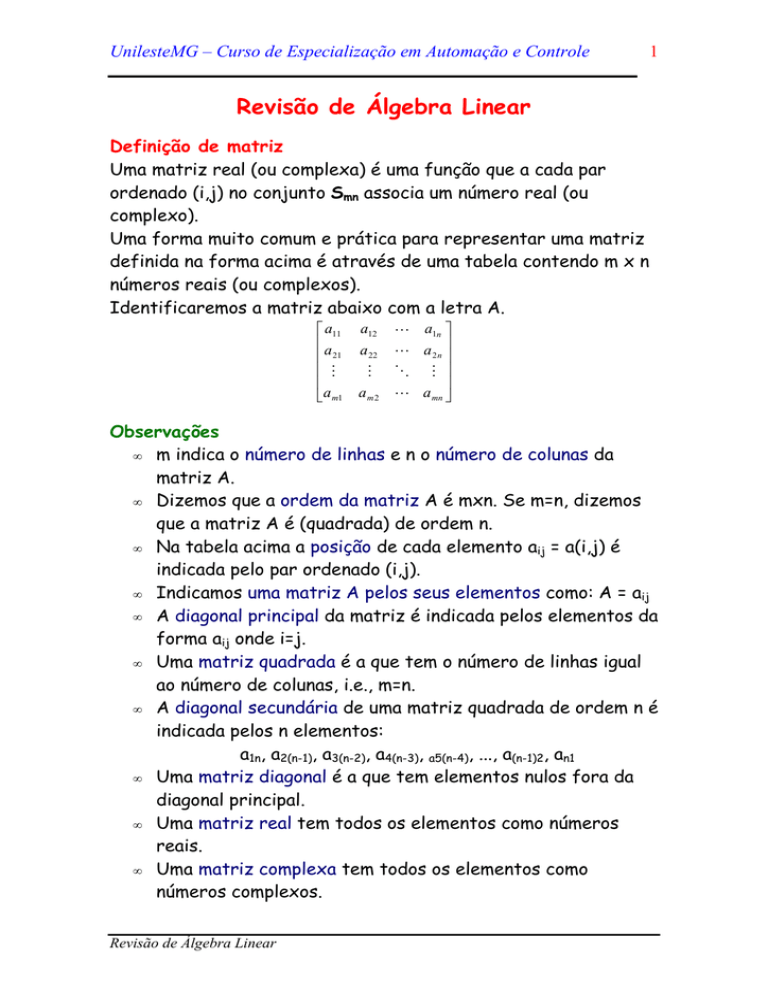

Revisão de Álgebra Linear

Definição de matriz

Uma matriz real (ou complexa) é uma função que a cada par

ordenado (i,j) no conjunto Smn associa um número real (ou

complexo).

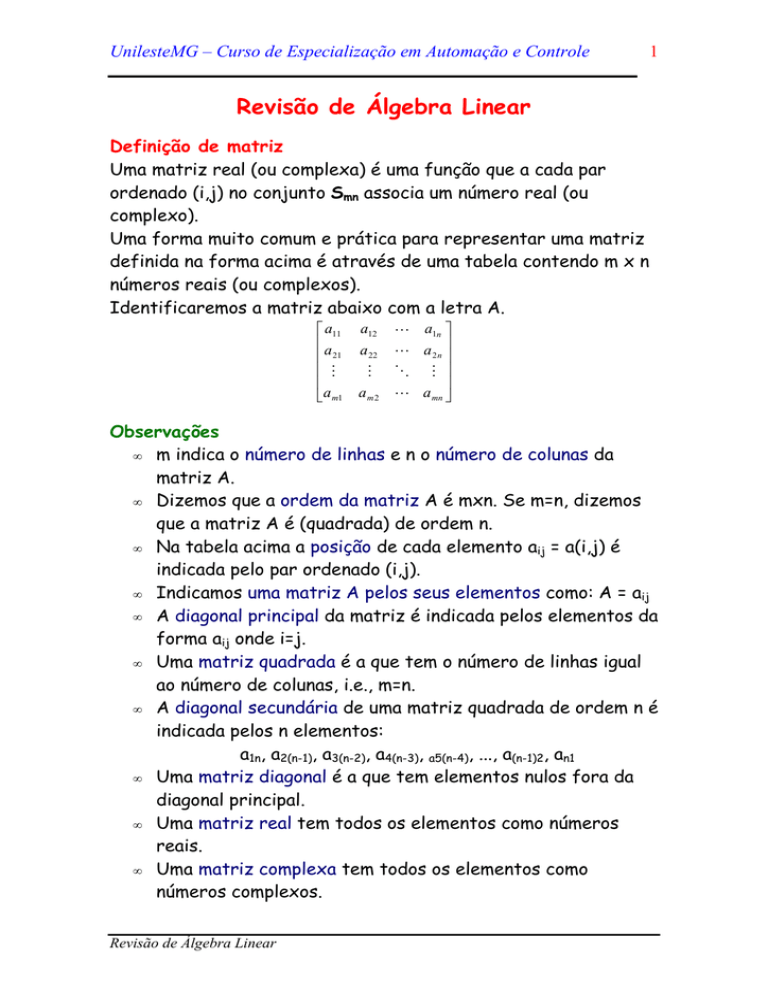

Uma forma muito comum e prática para representar uma matriz

definida na forma acima é através de uma tabela contendo m x n

números reais (ou complexos).

Identificaremos a matriz abaixo com a letra A.

a11

a

21

"

a m1

a12

a 22

"

am2

! a1n

! a 2 n

# "

! a mn

Observações

• m indica o número de linhas e n o número de colunas da

matriz A.

• Dizemos que a ordem da matriz A é mxn. Se m=n, dizemos

que a matriz A é (quadrada) de ordem n.

• Na tabela acima a posição de cada elemento aij = a(i,j) é

indicada pelo par ordenado (i,j).

• Indicamos uma matriz A pelos seus elementos como: A = aij

• A diagonal principal da matriz é indicada pelos elementos da

forma aij onde i=j.

• Uma matriz quadrada é a que tem o número de linhas igual

ao número de colunas, i.e., m=n.

• A diagonal secundária de uma matriz quadrada de ordem n é

indicada pelos n elementos:

a1n, a2(n-1), a3(n-2), a4(n-3), a5(n-4), ..., a(n-1)2, an1

• Uma matriz diagonal é a que tem elementos nulos fora da

diagonal principal.

• Uma matriz real tem todos os elementos como números

reais.

• Uma matriz complexa tem todos os elementos como

números complexos.

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

•

•

•

2

Uma matriz nula tem todos os elementos são iguais a zero.

Uma matriz identidade , denotada por Id, tem os elementos

da diagonal principal iguais a 1 e zero fora da diagonal

principal.

Uma matriz diagonal tem todos os elementos que estão fora

da diagonal principal são iguais a zero, podendo ocorrer que

alguns elementos da diagonal principal sejam nulos.

Exemplos:

Matriz 4x4 de números reais:

−6

12

− 23 − 24

0

0

0

0

Matriz 4x4 de números complexos:

7 18

0 0

5 0

0 9

7

i

12 − 6 + i

− i − 24

0

0

0

0

5 + i 5 − i

0

0

9

0

Matriz nula com duas linhas e duas colunas:

0 0

0 0

Matriz nula com três linhas e duas colunas:

0 0

0 0

0 0

Matriz identidade com três linhas e três colunas:

1 0 0

0 1 0

0 0 1

Matriz diagonal com quatro linhas e quatro colunas:

0

23

0 − 56

0

0

0

0

Revisão de Álgebra Linear

0 0

0 0

0 0

0 100

UnilesteMG – Curso de Especialização em Automação e Controle

3

Matrizes iguais

Duas matrizes A= aij e B= bij, de mesma ordem mxn, são iguais se

todos os seus correspondentes elementos são iguais, isto é:

aij = bij

para todo par ordenado (i,j) em Smn.

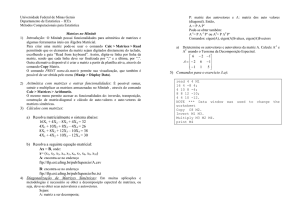

Exercício: Determinar os valores de x e y para que sejam iguais

as matrizes:

1 2

3 4

e

x −1

x + y

y − 1

x 2

Soma de matrizes

A soma (adição) de duas matrizes A= aij e B= bij de mesma ordem

mxn, é uma outra matriz C= cij, definida por:

cij = aij + bij

para todo par ordenado (i,j) em Smn.

Exemplo: A soma das matrizes A e B, representadas

respectivamente por:

− 23 10

7

9

e

10 5

8 9

é a matriz C = A+B, representada por:

− 13 15

15 18

Propriedades da soma de matrizes

A1: Associativa

Para quaisquer matrizes A, B e C, de mesma ordem mxn, vale a

igualdade:

(A + B) + C = A + (B + C)

A2: Comutativa

Para quaisquer matrizes A e B, de mesma ordem mxn, vale a

igualdade:

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

A + B = B + A

A3: Elemento neutro

Existe uma matriz nula 0 que somada com qualquer outra matriz

A de mesma ordem, fornecerá a própria matriz A, isto é:

0 + A = A

A4: Elemento oposto

Para cada matriz A, existe uma matriz -A, denominada a oposta

de A, cuja soma entre ambas fornecerá a matriz nula de mesma

ordem, isto é:

A + (-A) = 0

Multiplicação de escalar por matriz

Seja k um escalar e A= aij uma matriz. Definimos a multiplicação

do escalar k pela matriz A, como uma outra matriz C=kA,

definida por:

cij = k. aij

para todo par ordenado (i,j) em Smn.

Exemplo: A multiplicação do escalar -4 pela matriz A, definida

por:

− 2 10

7

9

é a matriz C = -4.A

− 40

8

− 28 − 36

Propriedades da multiplicação de escalar por matriz

E1: Multiplicação pelo escalar 1

A multiplicação do escalar 1 por qualquer matriz A, fornecerá a

própria matriz A, isto é:

1.A = A

E2: Multiplicação pelo escalar zero

A multiplicação do escalar 0 por qualquer matriz A, fornecerá a

matriz nula, isto é:

0.A = 0

Revisão de Álgebra Linear

4

UnilesteMG – Curso de Especialização em Automação e Controle

5

E3: Distributividade das matrizes

Para quaisquer matrizes A e B de mesma ordem e para qualquer

escalar k, tem-se:

k.(A+B) = k.A + k.B

E4: Distributividade dos escalares

Para qualquer matriz A e para quaisquer escalares p e q, tem-se:

(p+q).A = p.A + q.A

Multiplicação de matrizes

Seja a matriz A= aij de ordem m x n e a matriz B= bkl de ordem

nxr. Definimos o produto das matrizes A e B como uma outra

matriz C=A.B, definida por:

cuv = au1.b1v + au2.b2v + ... + aum.bmv

para todo par (u,v) em Smr.

Para obter o elemento da 2a. linha e 3a. coluna da matriz produto

C=A.B, isto é, o elemento c23, devemos:

• multiplicar os primeiros elementos da 2a. linha e 3a. coluna;

• multiplicar os segundos elementos da 2a. linha e 3a. coluna;

• multiplicar os terceiros elementos da 2a. linha e 3a. coluna;

• multiplicar os quartos elementos da 2a. linha e 3a. coluna;

• somar os quatro produtos obtidos anteriomente.

Assim:

c23 = a21.b13 + a22.b23 + a23.b33 + a24.b43

Podemos visualizar esta operação através das matrizes

seguintes. Basta observar a linha e a coluna em negrito:

a11

a

21

a 31

a 41

a12

a13

a 22

a32

a 42

a 23

a33

a 43

a14 b11

a 24 b21

.

a34 b31

a 44 b41

b12

b22

b32

b42

b13

b 23

b 33

b 43

b14 x

b24 x

=

b34 x

b44 x

x x

x c 23

x x

x x

x

x

x

x

Observação: Somente podemos multiplicar duas matrizes se o

número de colunas da primeira for igual ao número de linhas da

segunda.

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

Propriedades da multiplicação de matrizes

Para todas as matrizes A, B e C que podem ser multiplicadas,

temos algumas propriedades:

M1: Nem sempre vale a comutatividade

Em geral, A.B é diferente de B.A, como é o caso do produto que

segue:

1 2 3 1 2

2 4 6.3 5

3 6 9 7 9

M2: Distributividade da soma à direita

A.(B+C) = A.B + A.C

M3: Distributividade da soma à esquerda

(A+B).C = A.C + B.C

M4: Associatividade

A.(B.C) = (A.B).C

M5: Nulidade do produto

Pode acontecer que o produto de duas matrizes seja a matriz

nula, isto é: A.B = 0, embora nem A nem B sejam matrizes nulas,

como é o caso do produto:

0 1 0 2 0 0

0 0.0 0 = 0 0

M6: Nem sempre vale o cancelamento

Se ocorrer a igualdade A.C = B.C, então nem sempre será

verdadeiro que A = B, pois existem matrizes como a matriz C

dada por:

0 5

0 0

e as matrizes A e B dadas respectivamente por:

0 1

0 0

e

0 2

0 0

Revisão de Álgebra Linear

6

UnilesteMG – Curso de Especialização em Automação e Controle

7

de forma que A.C = B.C e não temos que A = B.

Matrizes com propriedades especiais

1. Uma matriz A é nilpotente de índice k natural, se:

Ak = 0

2. Uma matriz A é periódica de índice k natural, se:

Ak+1= A

3. Uma matriz A é idempotente, se:

A2 = A

4. As matrizes A e B são comutativas, se:

A.B = B.A

5. As matrizes A e B são anti-comutativas, se:

A.B = - B.A

6. A matriz identidade Id multiplicada por toda matriz A,

fornecerá a própria matriz A, quando o produto fizer

sentido.

Id . A = A

7. A matriz A será a inversa da matriz B, se:

A.B =Id

e

B.A = Id

A transposta de uma matriz

Dada uma matriz A=ai,j de ordem mxn, definimos a transposta da

matriz A como a matriz

At = aj,i

e se observa aqui, que as linhas de A se transformam nas colunas

de At.

Propriedades da transposição de matrizes

T1: A transposta da transposta da matriz é a própria matriz.

(At)t = A

T2: A transposta da multiplicação de um escalar por uma matriz

é igual ao próprio escalar multiplicado pela transposta da matriz.

(kA)t= k(At)

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

8

T3: A transposta da soma de duas matrizes é a soma das

transpostas dessas matrizes.

(A+B)t = At + Bt

T4: A transposta do produto de duas matrizes é igual ao produto

das transpostas das matrizes na ordem trocada.

(A.B)t = Bt . At

Análise Vetorial – Matricial

Definições

• Matriz conjugada

1 − j

1 1 + j

1

A=

⇒A=

0

j −1 0

− 1 − j

• Matriz Transposta

1 2

1 3

A=

⇒ AT =

3 4

2 4

• Transposta da conjugada A* é a transposta da matriz

conjugada A* = ( A ) T

• Matriz simétrica é aquela que é igual a sua transposta A = AT

• Matriz anti-simétrica é aquela que é igual a negativa de

sua transposta - A = − AT

Notas:

1. A soma de qualquer matriz quadrada a sua

transposta gera uma matriz simétrica - A + AT = B .

Logo B é simétrica;

2. A subtração de qualquer matriz quadrada de sua

transposta gera uma matriz anti-simétrica:

A − AT = C . Logo C é anti-simétrica.

3. A inversa de uma matriz simétrica é simétrica (se a

inversa existir).

Exercício: Podemos escrever qualquer matriz quadrada

como a soma de uma matriz simétrica e uma anti-simétrica !

Prove ?

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

• Matriz ortogonal: AT A = AAT = I ; A é real ⇒ A = ±1 e então

A é não singular;

• Matriz Hermitiana: Matriz com elementos complexos

onde A* = A ou aij = a ji . A matriz que satisfaz esta

condição é chamada matriz hermitiana. Uma matriz

hermitiana tem que ser quadrada e os elementos de sua

diagonal principal devem ser reais.

Seja A = B + jC onde A é hermitiana e B e C Reais; Então

B = B T → B é simétrica

C = −C T → C é anti-simétrica

Notas:

1. A inversa de uma matriz hermitiana é hermitiana:

A −1 = ( A −1 ) *

2. O determinante de uma matriz hermitiana é

sempre real

• Matriz anti-hermitiana: A* = − A ; Se

A = B + jC , onde B e C são matrizes reais, então

B = − B T → B é anti-simétrica

C = C T → C é simétrica.

• Matriz unitária: Matriz complexa em que a inversa é

igual a conjugada da transposta

A −1 = A * ou AA* = A * A = I

• Matriz normal: Comuta com sua transposta conjugada

AA* = A * A → onde A é uma matriz complexa, ou

AAT = AT A → onde A é uma matriz real

Determinante

a

a

Seja uma matriz A = 11 12 , então det(A) = A = a11 a 22 − a12 a 21

a 21 a 22

a11

Para uma matriz 3 x 3 tem-se: A = a 21

a31

det( A) = a11 a 22 a33 + a 21 a 32 a13 + a 31 a12 a 23 − a31 a 22 a13

Revisão de Álgebra Linear

a12

a 22

a 32

a13

a 23 , logo

a33

− a 21 a12 a 33 − a11 a 23 a32

9

UnilesteMG – Curso de Especialização em Automação e Controle

10

Para matrizes de dimensão maior que 3 utiliza-se seguinte

método:

1. Define-se o menor de um elemento aij de uma matriz

quadrada, ao determinante da matriz que resultar ao

suprimirmos a linha (i) e a coluna (j) referente a este

elemento. Exemplo: O menor do elemento a21 referente a

matriz 2 x 2 anterior vale a12. O menor do elemento a12 da

matriz 3 x 3 anterior vale a21a33 – a23a31.

2. Define-se como cofator de um elemento aij de uma matriz

quadrada, ao menor deste elemento com um sinal que

depende da linha e coluna do elemento aij. Para determinar

o sinal basta calcular (-1)i+j. Se a soma da linha i com a

coluna j for um número par, o sinal será positivo, caso

contrário, o sinal será negativo.

3. Para o cálculo do determinante de uma matriz quadrada

qualquer, basta escolher uma linha (ou coluna) e somar cada

elemento desta linha (ou coluna) multiplicado pelo seu

respectivo cofator.

Propriedades do determinante

1. Se duas linhas (ou colunas) são trocadas, somente o sinal do

determinante é mudado;

2. O determinante é invariante pela adição de um múltiplo

escalar de uma linha (ou coluna);

3. Se uma matriz n x n tem duas linhas (ou colunas) idênticas,

então o determinante é igual a zero.

4. Para uma matriz A, n x n, det (AT ) = det ( A ),

det( A* ) = det( A ) ;

5. O determinante do produto de duas matrizes quadradas A

e B vale: det ( AB ) = det (A) det (B) = det ( BA );

6. Se uma linha (ou coluna) é multiplicada por um escalar K,

então o determinante é multiplicado por K.

7. Se A, n x n, então det ( KA ) = Kn det (A).

8. Se os autovalores de A são λi ( i = 1, 2, ..., n), então det ( A )

= λ1λ2...λn.

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

11

9. Se A, n x m e B, m x n, então det (In + AB) = det (Im + BA).

Inversão de matrizes

• Para uma matriz quadrada (n x n) não singular define-se

{∃B BA = AB = I }→ então B = A −1 . A inversa de A existe se A

for não singular, ou o determinante de A for diferente

de zero, ou A não tenha linhas e/ou colunas linearmente

independentes. As três condições são idênticas.

• Uma matriz quadrada é dita singular quando não existe

sua inversa, ou seja, se o determinante da mesma for

nulo o que é a mesma coisa de afirmar que existem linhas

e/ou colunas linearmente dependentes.

• Propriedades da matriz inversa

1. Seja A, n x n e K um escalar, então

( KA) −1 =

1 −1

A

K

2. O determinante da matriz inversa de A é igual ao

inverso do determinante de A

det( A −1 ) =

1

det( A)

• O cálculo da inversa de uma matriz pode ser efetuado do

seguinte modo:

1. Calcula-se o determinante de A. Se este existir,

então A possui inversa.

2. Calcula-se os cofatores de todos os elementos de ª

3. A inversa de A será dada pelo produto do inverso

do determinante de A pela matriz transposta dos

cofatores de ª

A −1 =

1

[cofatores _ A]T

det( A)

Derivada e integral de uma matriz

• Derivada

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

da1m (t )

da11 (t )

!

dt

dt

dA(t )

=

"

#

"

da (t )

dt

da nm (t )

n1

!

dt

dt

• Integral

a11 (t )dt !

∫

#

∫ A(t )dt = "

a (t )dt !

∫ n1

(t )dt

"

(

)

a

t

dt

∫ nm

∫a

1m

• Diferenciação de uma matriz

d ( A(t ) + B(t )) dA(t ) dB(t )

=

+

dt

dt

dt

d ( AB) dA

dB

B+ A

=

dt

dt

dt

dAk (t ) dA

dk (t )

k (t ) + A

=

dt

dt

dt

b

b

dA

dB

b

∫a dt B.dt = AB a − ∫a A dt dt

• Derivada de uma função escalar em relação a um vetor

∂2J

∂J

∂x

∂x12

∂J 1 ∂ 2 J

= "

,

=

∂x ∂J ∂x 2 ∂ 2 J

∂x ∂x

∂x

n

n 1

∂2J

∂x1∂x 2

"

∂2J

∂x n ∂x 2

∂2J

∂x1∂x n

#

"

∂2J

!

∂x n2

!

• Jacobiano: se uma matriz f(x), m x 1, é uma função

vetorial de um n-vetor x, então:

∂f 1

∂x

1

∂f

∂f 1

= ∂x

∂x 2

"

∂f

1

∂x n

∂f 2

∂x1

∂f 2

∂x 2

"

∂f 2

∂x n

∂f m

∂x1

∂f m

!

∂x 2

# "

∂f m

!

∂x n

!

Vetores e análise vetorial

Revisão de Álgebra Linear

12

UnilesteMG – Curso de Especialização em Automação e Controle

13

• Independência linear de vetores: diz-se que vetores xi

são linearmente independentes caso ocorra

c1 x1 + c 2 x 2 + ... + c n x n = 0 , somente se c1 = c 2 = ... = c n = 0

• Produto interno

n

< x, y >= x1 y1 + x 2 y 2 + ... + x n y n = ∑ xi y i

i =1

• Um vetor complexo ou real x é dito normalizado se

< x, x >= 1

• Norma de um vetor (euclidiana) – conceito semelhante ao

de valor absoluto ou P.U. x =< x, x > 2 = x1 + x 2 + ... + x n

1

2

2

2

• Distância entre dois pontos

x − y = ( x1 − y1 ) 2 + ( x 2 − y 2 ) 2 + ... + ( x n − y n ) 2

• Ortogonalidade de vetores

• Se o produto interno de dois vetores x e y é igual a

zero, então x e y são ortogonais entre si. Exemplo:

1

0

1

x1 = 1 , x 2 = 0 e x3 = − 1

0

1

0

• Um conjunto de vetores é dito ortonormal se os mesmos

estão normalizados e são ortogonais, ou seja,

< xi , xi >= 1

< xi , x j >= 0, i ≠ j

Polinômio característico de uma matriz quadrada

• Chama-se polinômio característico de uma matriz An x n , o

polinômio p(λ) = det(A-λIn)

Autovalores de uma matriz

• Os autovalores de uma matriz An x n são as raízes de seu

respectivo polinômio característico.

• O determinante de uma matriz An x n também pode ser

calculado multiplicando-se os autovalores de A.

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

14

Autovetores de uma matriz

• Seja An x n e λ um autovalor de A, se existe um vetor não

v1

nulo V = " tal que AV1 = λV1 e V1 é não nulo, então V1 é

v n

1

chamado de autovetor de A.

• Observe que uma matriz A com n autovalores terá n

autovetores (um vetor associado a cada autovalor).

Diagonalização de matrizes quadradas

• Uma matriz An x n é diagonalizável se, e somente se, ela

possui n autovetores linearmente independentes.

• Se uma matriz A é diagonalizável então existe uma

matriz P tal que: P-1AP = D, onde D é uma matriz diagonal

e os elementos desta diagonal são os autovalores de A

(observe que o determinante deve ser invariante).

•

λ1

0

D=

"

0

0

λ2

"

0

! 0

! 0

a matriz P será composta pelos

# "

! λn

autovetores associados a cada autovalor da matriz A:

P=[V1 V2 ... Vn].

Formas quadráticas

• Para uma matriz An x n real e simétrica e um n-vetor x, a

n

forma x T Ax = ∑∑ j =1 aij xi x j onde a ji = aij é chamada forma

n

i =1

quadrática real em xi.

• Qualquer forma quadrática real sempre pode ser escrita

como xTAx. Por exemplo:

x12 − 2 x1 x 2 + 4 x1 x3 + x 22 + 8 x32 = [x1

x2

1 − 1 2 x1

x3 ]− 1 1 0 x 2

2 0 8 x3

• Critério de Sylvester para determinar se uma forma

quadrática é positiva definida: Uma condição necessária

e suficiente para uma forma quadrática xTAx, onde A é

Revisão de Álgebra Linear

UnilesteMG – Curso de Especialização em Automação e Controle

15

uma matriz n x n real simétrica, ser positiva definida é

que o determinante de A seja positivo e que os

determinantes menores principais e sucessivos do

determinante A sejam positivos.

Pseudo-inversas

• O conceito de pseudo-inversa de uma matriz é uma

generalização da noção de uma inversa. Ele é útil para se

determinar uma “solução” de um conjunto de equações

algébricas em que o número de incógnitas e o número de

equações linearmente independentes não são iguais.

• Matriz pseudo-inversa: Para uma equação vetorialmatricial Ax = b onde A é uma matriz n x m com posto n,

x é um m-vetor e b é um n-vetor. A solução que minimiza

a norma ||x|| é dada por xo = (ATA)-1AT b

Bibliografia Recomendada

CALLIOLLI, C.A, Domingues, H. Cirta, Roberto C.F. – Álgebra

Linear e Aplicações. São Paulo, Editora Atual 1998.

LAWSON, Terry. Álgebra Linear, São Paulo, Ed. Edgard Blucher,

1997.

KALMAN, Bernard. Introdução à Álgebra Linear. Rio de Janeiro.

Ed. Prentice Hall, 1998.

JANICH, Klain. Álgebra Linear, Rio de Janeiro, LTC, 1998.

LIPSCHUTZ, Seymour. Álgebra Linear. São Paulo. Coleção

Schaum. McGraw-Hill, 2ª Edição

JUDICE, Edson D. Elementos de Geometria Analítica. Belo

Horizonte – Editora Vega

SANTOS, Reginaldo J. Um Curso de Geometria Analítica e

Álgebra Linear - Belo Horizonte: Imprensa Universitária da

UFMG, 2000.

Revisão de Álgebra Linear