MOQ – 13

PROBABILIDADE E

ESTATÍSTICA

Professor: Rodrigo A. Scarpel

[email protected]

www.mec.ita.br/~rodrigo

Programa do curso:

Semanas

Conteúdo

1

Introdução à probabilidade (eventos, espaço amostral, axiomas, propriedades, probabilidade condicional e

independência).

2

Teorema da probabilidade total e teorema de Bayes. Variáveis aleatórias. Distribuições de probabilidade.

Funções massa, densidade, e distribuição acumulada. Funções de variáveis aleatórias.

3

Valor esperado e variância. Momentos de uma variável aleatória. Função geradora de momentos. Principais

distribuições de probabilidade discretas (Bernoulli, Binomial e Poisson).

4

Principais distribuições de probabilidade contínuas (Exponencial negativa e Normal).

5

Feriado (2/4)

6

Variáveis aleatórias conjuntas, função distribuição conjunta e marginal. Independência estatística. Covariância

e Coeficiente de Correlação.

7

Prova

8

Princípios de estatística. Amostras aleatórias. Distribuições amostrais. Teorema do limite central.

9

Estimador, estimativa e propriedades dos estimadores. Estimação pontual de parâmetros (Métodos dos

momentos e da máxima verossimilhança).

10

Intervalos de confiança (estimação por intervalo). Tamanho da amostra. Princípios de testes de hipóteses.

11

Testes de Hipóteses. Inferência baseada em 2 amostras (entre parâmetros de populações distintas).

12

Testes não-paramétricos (associação, independência e de aderência).

13

Feriado (4/6)

14

Prova

15 e 16

Regressão linear simples e correlação.

Aplicações de modelos de regressão linear.

MOQ – 13

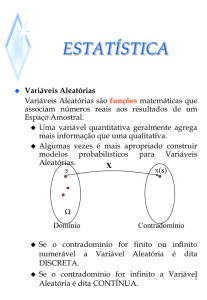

VARIÁVEIS

ALEATÓRIAS

UNIDIMENSIONAIS

Professor: Rodrigo A. Scarpel

[email protected]

www.mec.ita.br/~rodrigo

Momentos de uma variável aleatória:

As variáveis aleatórias e suas distribuições de probabilidade são

freqüentemente caracterizadas por um pequeno número de parâmetros,

os quais também têm uma interpretação prática.

Exemplo: “Valor médio” da variável aleatória

Matematicamente, isto é conhecido como o problema (generalizado) dos

momentos: para uma dada classe de variáveis aleatórias X, encontre

uma coleção de funções, {fi(X)} tais que os valores esperados E[fi(X)]

caracterizem completamente a distribuição da variável aleatória X.

Def: Momentos de uma variável aleatória: seja X uma variável aleatória

caracterizada por uma função distribuição de probabilidade f(x). Para

k=1,2,3,… seu k-ésimo momento é dados por E[Xk].

Parâmetro de posição: valor esperado

O valor esperado é o primeiro momento de uma v. aleatória (k=1, E[X])

Também é conhecido por esperança ou média da v.aleatória.

Caracteriza o centro (centro de massa) da distribuição da v.aleatória.

CASO DISCRETO:

µ = E ( X ) = ∑ xi .P( xi )

CASO CONTÍNUO:

µ = E(X ) =

i

+∞

∫ x. f (x )dx

−∞

Propriedades do valor esperado:

E [K] = K

E [ax+b] = a.E[x]+b

E [x ± y] = E[x] ± E[y]

Parâmetro de dispersão: variância

Caracteriza o momento de inércia baricêntrico de uma distribuição.

[

] ( )

VAR( X ) = σ 2 ( X ) = E ( X − µ )2 = E X 2 − E ( X )2

CASO DISCRETO:

Var ( X ) =

2

(

)

x

−

µ

∑ i .P(xi )

i

CASO CONTÍNUO:

Var ( X ) =

+∞

2

(

)

x

−

µ

. f (x )dx

∫

−∞

→ Desvio-padrão: σ(x) = σ = (σ

σ2)½

Propriedades da variância: σ2(k) = 0

σ2(k.x) = k2. σ2(x)

σ2(x+k) = σ2(x)

Função geradora de momentos:

Dada uma variável aleatória X e sua distribuição de probabilidade,

( )

Mx(t ) = E e tX

∑ etX p ( x ), se X é uma v.a. discreta

= x tX

∫ e f (x )dx, se X é uma v.a. contínua

x

em que Mx(t) é sua função geradora de momentos. Desta forma, fazendo

k tX

x

e p ( x ), se X é uma v.a. discreta

∑

k

d Mx(t ) x

= k tX

k

dt

∫ x e f ( x )dx, se X é uma v.a. contínua

x

Para t=0, obtém-se E[Xk]

MOQ – 13

PRINCIPAIS

DISTRIBUIÇÕES

DISCRETAS

Professor: Rodrigo A. Scarpel

[email protected]

www.mec.ita.br/~rodrigo

Tipos de variáveis:

NOMINAL

QUALITATIVA

ORDINAL

- BERNOULLI

VARIÁVEL

DISCRETA

- POISSON

QUANTITATIVA

CONTÍNUA

1. f(x) ou P(x)

2. F(x)

O QUE É ESTUDAR UMA

VARIÁVEL ALEATÓRIA?

3. E(x)

4. Var(x)

5. Utilidade

- BINOMIAL

Distribuição de Bernoulli [x~Ber(p)]:

Def: Se uma variável aleatória X assumir apenas 2 valores (ex:

sucesso ou fracasso, 0 ou 1,…) com distribuição de probabilidade:

p(1)=p e p(0)=1-p, essa é chamada variável aleatória de Bernoulli.

Assim: Ω = {A,Ā}

X(w) =

1-p , para x=0

f(x) =

p

, para x=1

0

, caso contrário

E(X) = p

Var(X) = p(1-p)

0, w= Ā (se o resultado for fracasso)

1, w= A (se o resultado for sucesso)

0

, se x < 0

F(x) = 1-p , se 0 ≤ x < 1

1

, se x ≥ 1

Distribuição Binomial [x~Bin(n,p)]:

Def: Experimento Binomial:

•

Há um fenômeno do tipo fracasso (0) e sucesso (1)

•

São feitas n observações deste fenômeno

•

A probab. de sucesso em cada uma das n obs. é igual a p

•

As observações são independentes entre si

Def: Se X é uma variável aleatória que é igual ao número de

sucessos nas n observações de um experimento binomial, ela é

chamada variável aleatória binomial (ou que segue uma

distribuição binomial).

Distribuição Binomial [x~Bin(n,p)]:

Função de Distribuição de Probabilidade de X:

, x ∉ {0,1, K , n}

0

n

f ( x) = P( X = x) =

p x (1 − p )n − x , x ∈ {0,1, K , n}

x

Função de Distribuição Acumulada de X:

0

x n

F ( x) = P ( X ≤ x) = ∑ p j (1 − p )n − j

j =0 j

1

E(X) = n.p

Var(X) = n.p.(1-p)

,x < 0

,x<n

,x ≥ n

Distribuição de Poisson [x~Poi(λ

λ), λ>0]:

No caso da distribuição binomial (e das outras estudadas até

agora), a variável de interesse é o número de sucessos em um

intervalo discreto (n observações ou repetições). Muitas vezes,

entretanto, o interesse é o número de sucessos em um intervalo

contínuo - Exemplos:

•

Em um call center chegam, em média, 3 ligações por minuto;

•

Em um determinado processo de fabricação de cabos, em

média, aparece 1 falha a cada 400 metros.

Def: Se X é uma v.a. que é igual ao número de sucessos em um

intervalo contínuo, então diz-se que esta segue uma distribuição de

Poisson.

Distribuição de Poisson [x~Poi(λ

λ), λ>0]:

Função de Distribuição de Probabilidade de X:

e -λ λ x

f ( x) = P( X = x) = x!

0

, x = 0,1, K, n

, caso contrário

Função de Distribuição Acumulada de X:

0

x -λ j

F ( x) = P( X ≤ x) = e λ

∑

j!

j=1

E(X) = λ

Var(X) = λ

,x < 0

,x ≥ 0

Processo de Poisson:

Def: Quando a variável aleatória de interesse conta o número de

ocorrências do evento ao longo do tempo, têm-se um processo de

Poisson.

Suposições do processo de Poisson:

• As ocorrências são independentes e estacionárias (λ

λ:constante);

• O número de ocorrências é proporcional ao tamanho do intervalo;

• Em intervalos muito pequenos, a probabilidade de ocorrer mais de

um sucesso é desprezível.

Neste caso:

e-λt (λt )k

P( X = k ) =

k!

E(X) = λt

Var(X) = λt

Aproximação da Binomial pela Poisson:

O cálculo das probabilidades binomiais quando p é pequeno e n é

grande pode ser feito aproximadamente pela distribuição de Poisson

fazendo:

E(X) = n.p = λt

Valores de p < 0,10 fornecem boas aproximações.

Exemplo:

• Se retirarmos 50 peças defeituosas de uma máquina que produz 2%

das peças com defeito, a probabilidade de encontrarmos 2 peças

defeituosas será:

50

P( X = 2) = (0,02)2 (0,98)48 = 0,1857

2

e -112

E(X) = n.p = 0,02. 50 = 1 ⇒ P ( X = 2) =

= 0,1839

2!

Distribuição Hipergeométrica [x~Hip(N,r,n)]:

No Experimento Binomial, a probabilidade de sucesso em cada

uma das n observações é igual a p. Assim, há 2 possibilidades:

•

Os experimentos feitos são com reposição;

•

A população é tão grande que a extração não altera o valor de p.

Nos casos em que as extrações devem ser feitas sem reposição e

a população não é suficientemente grande, a distribuição adequada é

a Hipergeométrica.

Def: Consideremos um conjunto de N elementos, r dos quais têm

uma determinada característica (r≤

≤N). Serão extraídos n elementos

sem reposição. Se X é uma v.a. que é igual ao número de elementos

com a referida característica que estarão entre os n retirados, ela é

chamada hipergeométrica (ou que segue essa distribuição).

Distribuição Hipergeométrica [x~Hip(N,r,n)]:

Função de Distribuição de Probabilidade de X:

r N − r

x n − x

, x = 0,1, K, n

f ( x) = P( X = x) = N

n

0

, caso contrário

Função de Distribuição Acumulada de X:

0

r N − r

x

j n− j

F ( x) = P( X ≤ x) = ∑

N

j =0

n

1

E(X) = n.p

Var(X) = n.p.(1-p).[(N-n)//(N-1)]

,x < 0

,x<n

,x ≥ n

Outras distribuições discretas notáveis:

Distribuição multinomial:

O experimento binomial se torna multinomial se

deixarmos que cada tentativa tenha mais de dois

resultados possíveis.

Distribuição binomial negativa:

A variável aleatória X é o número de tentativas para se

obter k sucessos.

Distribuição geométrica:

A variável aleatória X é o número da tentativa na qual o

primeiro sucesso ocorre.

Para casa:

• Lista de Exercícios 3 (site: www.mec.ita.br/~rodrigo/)

• Leitura: Devore – cap. 3: Variáveis aleatórias discretas

Walpole et al. – caps. 3 e 5 (Algumas dist. prob. Discretas)