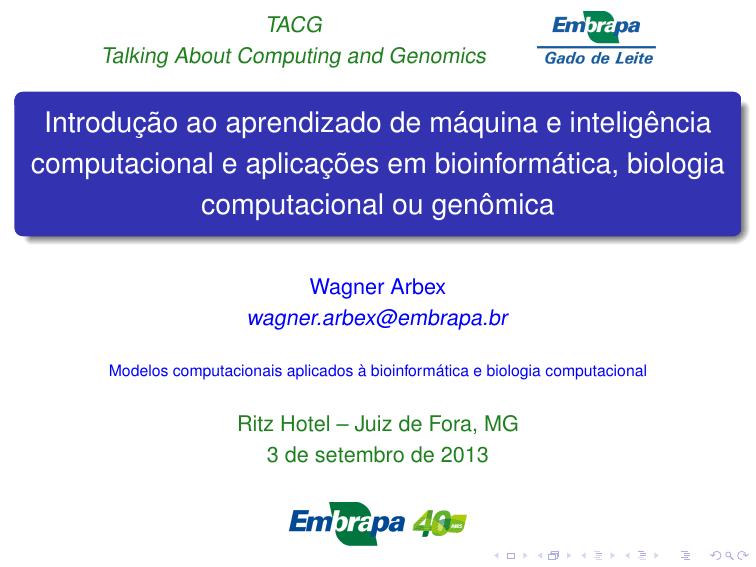

TACG

Talking About Computing and Genomics

Introdução ao aprendizado de máquina e inteligência

computacional e aplicações em bioinformática, biologia

computacional ou genômica

Wagner Arbex

[email protected]

Modelos computacionais aplicados à bioinformática e biologia computacional

Ritz Hotel – Juiz de Fora, MG

3 de setembro de 2013

First of all...

Parte I

Introdução ao aprendizado de máquina e

inteligência computacional

Inteligência artificial x aprendizado de máquina I

Até a década de 80, a IA era uma área de “problemas

curiosos”(FACELLI et al., 2011), dividida entre simbolismo e

conexionismo;

Simbolismo e conexionismo

São técnicas que buscam criar um “comportamento inteligente” em

sistemas computacionais;

O simbolismo baseia-se no “fluxo do raciocínio”, em geral, serial e que

simula o raciocínio dedutivo;

O conexionismo baseia-se em princípios neurobiológicos da “arquitetura

cerebral”, criando um “raciocínio paralelo e a partir de experiências”.

A partir dos anos 80, a IA começou a ser aplicada, quase sempre,

para encontrar/criar regras ou tomar decisões, baseadas em

conhecimento de especialistas, p. ex., em sistemas de diagnóstico;

Inteligência artificial x aprendizado de máquina II

O aprendizado de máquina (AM), em termos amplos, é aplicado na:

Caracterização, entendimento automático e reconhecimento de

padrão;

Interpretação de resultados prévios, primários e/ou intermediários para

estabelecimento de conhecimento ou tomada de decisão.

Ao contrário das abordagens clássicas:

Permite expressar ou representar imprecisão e/ou incerteza – alto,

baixo, muito, pouco etc. – ou relações e agrupamentos – p. ex., o

conjunto das pessoas altas;

Possibilita o uso desses conceitos “vagos”, emulando o padrão comum

de entendimento, uma vez que, entre pessoas, não há dificuldade de

discernimento dos mesmos;

Inteligência artificial x aprendizado de máquina III

Aprendizado de máquina, ou machine learning, pode ser definido

como a capacidade de melhorar o desempenho na realização de

alguma tarefa, por meio da experiência (MITCHELL, 1997);

Aprendizado de máquina

O processo de indução de uma hipótese – ou aproximação de função – a

partir de experiência adquirida/obtida chama-se aprendizado de

máquina (FACELLI et al., 2011).

Aquisição de conhecimento

Um sistema computacional adquire e utiliza conhecimento caso seja

capaz de utilizar-se de informações prévias, primárias ou derivadas

dessas, para inferir novos resultados e novas informações (ARBEX, 2009).

Inteligência artificial x aprendizado de máquina IV

Onde aparece a mineração de dados?

Mineração de dados (MD) é um nome estabelecido no “mundo dos

negócios” para aplicações de algoritmos de aprendizado de máquina em

grande massas de dados e, na ciência da computação, é chamado de

descoberta de conhecimento em bases de dados (knowledge discovery in

databases - KDD) (ALPAYDIN, 2004; CARVALHO, 2005):

MD e AM são diferenciados na compreensão de que AM refere-se à

disciplina na qual são desenvolvidos e estudados os algoritmos, técnicas e

ferramentas que permitem o aprendizado;

MD deve ser vista como o processo em si, que aplica AM para a descoberta

de conhecimento;

Como funciona o aprendizado de máquina? I

Costuma-se dizer que AM cumpre tarefas e que se resumem a

tarefas preditivas ou supervisionadas e tarefas descritivas ou

não-supervisionadas;

Na predição, estabelecem-se funções ou hipóteses que consigam

explicar como os atributos de entrada – ou atributos preditores –

relacionam-se com o atributo de saída – também chamado de

atributo alvo ou atributo meta;

As tarefas de predição podem ser a classificação, para dados

discretos, e a regressão para dados contínuos;

Como funciona o aprendizado de máquina? II

Na descrição, as tarefas são, genericamente, chamadas de

agrupamento, associação e sumarização (CARVALHO, 2005;

FACELLI et al., 2011):

No agrupamento, buscam-se dados similares, sob algum aspecto de

seus atributos

Na associação, buscam-se padrões suficientemente frequentes para

separar os atributos que refletem esse padrão;

Por sumarização, entende-se uma descrição simples, e compacta para

um conjunto de dados;

Como funciona o aprendizado de máquina? III

Tarefa de predição

Encontrar uma função – ou hipótese – a partir dos dados de treinamento,

que sirva para caraterizar um novo caso, com base nos valores dos seus

atributos de entrada e, portanto, faz-se o aprendizado

supervisionado (FACELLI et al., 2011);

Um modelo preditivo também obtém uma descrição simples do conjunto de

dados;

Tarefa de descrição

Faz-se a descrição ou a exploração de um conjunto de dados, do qual não

se conhece(m) o(s) atributo(s) de saída, então é feito o aprendizado

não-supervisionado. P. ex., agrupamento ou descoberta de regras de

associação (CARVALHO, 2005; FACELLI et al., 2011);

Um modelo descritivo pode servir para predição, após ser validado;

Inteligência computacional I

O termo inteligência computacional (IC) surgiu na última década,

confundindo o escopo relacionado com IA e AM;

A IA tenta simular o comportamento inteligente em sistemas com

representação exata e completa do conhecimento (TURING, 1950).

IC envolve computação a partir de um sistema com uma capacidade

de aprendizagem e/ou para tratar situações novas, estando

relacionado a adaptação, como, p. ex., o aprendizado por reforço;

Um sistema com IC deve possuir um ou mais atributos de razão,

como generalização, descoberta, de associação e

abstração (EBERHART; SHI, 2007);

Inteligência computacional II

O início e o fim da confusão entre IC e AM

IC geralmente incorpora abordagens híbridas, tais como redes neurais,

sistemas difusos e sistemas de computação evolucionária;

São sistemas frequentemente projetados para imitar um ou mais aspectos

da “inteligência biológica”;

Parte II

Aplicações de aprendizado de máquina e

inteligência computacional

Descoberta de SNPs I

Polimorfismos de base única são modificações de um único

nucleotídeo, em uma dada sequência, quando comparada a outra,

que, como consequência, podem alterar a formação de proteínas;

Figura : Exemplos de polimorfismos bi, tri e tetra-alélicos

Descoberta de SNPs II

O estudo de SNPs busca... (ARBEX, 2009)

Identificar um SNP em uma sequência;

Comprovar se o nucleotídeo “trocado" é realmente um caso de

polimorfismo;

Verificar se o polimorfismo provocará alterações a ponto de alterar a

formação de uma proteína;

Verificar se a “nova" proteína, se esta realmente foi formada, quando

combinada com as demais, provocará ou suprimirá alguma característica no

indivíduo;

Descoberta de SNPs III

C1 : QS = 43 (Ac = 99,999%)

Polyphred = 99% PPSPolyphred = 1 (97% TP); Polybayes = 96% PPSPolybayes = 2 (75% TP)

C2 : QS = 50 (Ac = 99,9999%)

Polyphred = 94% PPSPolyphred = 3 (62% TP); Polybayes = 0% PPSPolybayes = 6 (1% TP)

Descoberta de SNPs IV

Padrões para leitura das bases e identificação de SNPs

Escore de

qualidade (QS)

10

20

30

40

50

Probabilidade

de erro

1 em 10

1 em 100

1 em 1.000

1 em 10.000

1 em 100.000

Acurácia

(Ac - %)

90

99

99,9

99,999

99,9999

Qualidade de leitura das bases.

Classe

1

2

3

4

5

6

Polyphred

score (PPS)

99

95 - 98

90 - 94

70 - 89

50 - 69

0 - 49

Ver. Positivos

(TP - %)

97

75

62

35

11

1

Classificação de candidatos a SNPs.

Sistema de inferência difusa (SID) para descoberta de

SNPs

O

Máquina de Inferência

/

C2 : QS = 50; Polyphred = 94% PPSPolyphred; Polybayes = 0% PPSPolybayes

Fuzzificação

{︃

PIM (x) =

⎧

⎪

⎪

⎪

⎪

⎨

PmP (x) = ⎪

⎪

⎪

⎪

⎩

⎧

⎪

⎪

⎪

⎪

⎨

PMP (x) = ⎪

⎪

⎪

⎪

⎩

1

59 − x

59 − 49

0

x ≤ 49

49 < x < 59

x ≥ 59

0

x − 60

70 − 60

1

91, 5 − x

91, 5 − 89

0

x ≤ 60

60 < x < 70

70 ≤ x ≤ 89

0

x − 92, 5

95 − 92, 5

1

99 − x

99 − 98

0

89 < x < 91, 5

x ≥ 91, 5

⎧

⎪

⎪

⎪

⎪

⎨

PPP (x) = ⎪

⎪

⎪

⎪

⎩

⎧

⎪

⎪

⎪

⎪

⎨

PPR (x) = ⎪

⎪

⎪

⎪

⎩

0

x − 25

50 − 25

1

79 − x

79 − 69

0

0

x − 80

90 − 80

1

96 − x

96 − 94

0

x ≤ 25

25 < x < 50

50 ≤ x ≤ 69

69 < x < 79

x ≥ 79

x ≤ 80

80 < x < 90

90 ≤ x ≤ 94

94 < x < 96

x ≥ 96

x ≤ 92, 5

92, 5 < x < 95

95 ≤ x ≤ 98

98 < x < 99

x ≥ 99

{︃

PAP (x) =

0

x − 96, 5

99 − 96, 5

1

x ≤ 96, 5

96, 5 < x < 99

x ≥ 99

Função de pertinência para a variável linguística possibilidade.

Fuzzificação

⎧

⎪

⎪

⎨

QR (x) = ⎪

⎪

⎩

1

30 − x

30 − 20

0

x ≤ 20

20 < x < 30

x ≥ 30

⎧

⎪

⎪

⎪

⎪

⎪

⎪

⎨

QB (x) = ⎪

⎪

⎪

⎪

⎪

⎪

⎩

0

x − 15

30 − 15

1

70 − x

70 − 40

0

x ≤ 15

15 < x < 30

30 ≤ x ≤ 40

40 < x < 70

x ≥ 70

⎧

⎪

⎪

⎨

QO (x) = ⎪

⎪

⎩

0

x − 40

50 − 40

1

x ≤ 40

40 < x < 50

x ≥ 50

Função de pertinência para a variável linguística qualidade.

Regras de inferência

se

improvável

pouco provável

medianamente provável

provável

muito provável

altamente provável

improvável

pouco provável

medianamente provável

provável

muito provável

altamente provável

improvável

pouco provável

medianamente provável

provável

muito provável

altamente provável

e

qualidade ruim

qualidade ruim

qualidade ruim

qualidade ruim

qualidade ruim

qualidade ruim

qualidade boa

qualidade boa

qualidade boa

qualidade boa

qualidade boa

qualidade boa

qualidade ótima

qualidade ótima

qualidade ótima

qualidade ótima

qualidade ótima

qualidade ótima

então

SNP descartado

SNP descartado

SNP descartado

SNP descartado

SNP descartado

SNP descartado

SNP descartado

SNP descartado

SNP não confirmado

SNP não confirmado

SNP confirmado

SNP confirmado

SNP descartado

SNP descartado

SNP não confirmado

SNP não confirmado

SNP confirmado

SNP confirmado

Regras de inferência utilizadas no modelo.

(R1 )

(R2 )

(R3 )

(R4 )

(R5 )

(R6 )

(R7 )

(R8 )

(R9 )

(R10 )

(R11 )

(R12 )

(R13 )

(R14 )

(R15 )

(R16 )

(R17 )

(R18 )

Regras de inferência

possibilidade

improvável (PIM )

pouco provável (PPP )

medianamente provável (PmP )

provável (PP )

muito provável (PMP )

altamente provável (PAP )

ruim (QR )

qualidade

boa (QB )

ótima (QO )

SNPD

SNPD

SNPD

SNPD

SNPD

SNPD

SNPD

SNPD

SNPNC

SNPNC

SNPC

SNPC

SNPD

SNPD

SNPNC

SNPNC

SNPC

SNPC

Interpretação das regras de inferência utilizadas no modelo.

Defuzzificação

⎧

⎪

⎪

⎨

SNPD (x) = ⎪

⎪

⎩

⎧

⎪

⎪

⎪

⎪

⎪

⎪

⎨

SNPNC (x) = ⎪

⎪

⎪

⎪

⎪

⎪

⎩

⎧

⎪

⎪

⎨

SNPC (x) = ⎪

⎪

⎩

1

30 − x

30 − 20

0

0

x − 15

30 − 15

1

70 − x

70 − 40

0

0

x − 40

50 − 40

1

x ≤ 20

20 < x < 30

x ≥ 30

x ≤ 15

15 < x < 30

30 ≤ x ≤ 40

40 < x < 70

x ≥ 70

x ≤ 40

40 < x < 50

x ≥ 50

Função de saída para a variável linguística SNP, definida pelos termos SNP descartado (SNPD ),

SNP não confirmado (SNPNC ) e SNP confirmado (SNPC ).

Síntese dos resultados

Escore mínimo

de alinhamento

30%

60%

90%

Polyphred

Polybayes

Total

1.503

1.224

1.055

240

230

202

1.624

1.378

1.145

SID - Mamdani

SID - Larsen

SNPC

SNPNC

SNPD

SNPC

SNPNC

SNPD

17%

10%

22%

5%

61%

85%

9%

9%

4%

5%

87%

86%

Candidatos a SNPs e agrupamentos desses a partir dos resultados do SID.

Referências I

ALPAYDIN, E. Introduction to machine learning. Cambrige: MIT

Press, 2004. 415 p.

ARBEX, W. Modelos computacionais para identificação de

informação genômica associada à resistência ao carrapato

bovino. Tese (Doutorado em Engenharia de Sistemas e Computação)

— Universidade Federal do Rio de Janeiro, Rio de Janeiro, Mar.

2009. Trabalho vencedor do prêmio SBIAgro 2009 – Categoria

Tese de Doutorado no VII Congresso da Sociedade Brasileira de

Agroinformática.

CARVALHO, L. A. V. de. Datamining: a mineração de dados no

marketing, medicina, economia, engenharia e administração. Rio

de Janeiro: Ciência Moderna, 2005.

EBERHART, R. C. et al. Computational intelligence: concepts to

implementation. Burlington: Morgan Kaufmann Publishers, 2007.

Referências II

FACELLI, K. et al. Inteligência artifical: uma abordagem de

aprendizado de máquina. Rio de Janeiro: LTC, 2011.

MITCHELL, T. M. Machine learning. 1. ed. New York: McGraw Hill

Higher Education, 1997. 432 p. ISBN 0070428077.

TURING, A. M. Computing machinery and intelligence. Mind, LIX, p.

433–460, Oct. 1950.

TACG

Talking About Computing and Genomics

Introdução ao aprendizado de máquina e inteligência

computacional e aplicações em bioinformática, biologia

computacional ou genômica

Wagner Arbex

[email protected]

Modelos computacionais aplicados à bioinformática e biologia computacional

Ritz Hotel – Juiz de Fora, MG

3 de setembro de 2013