1

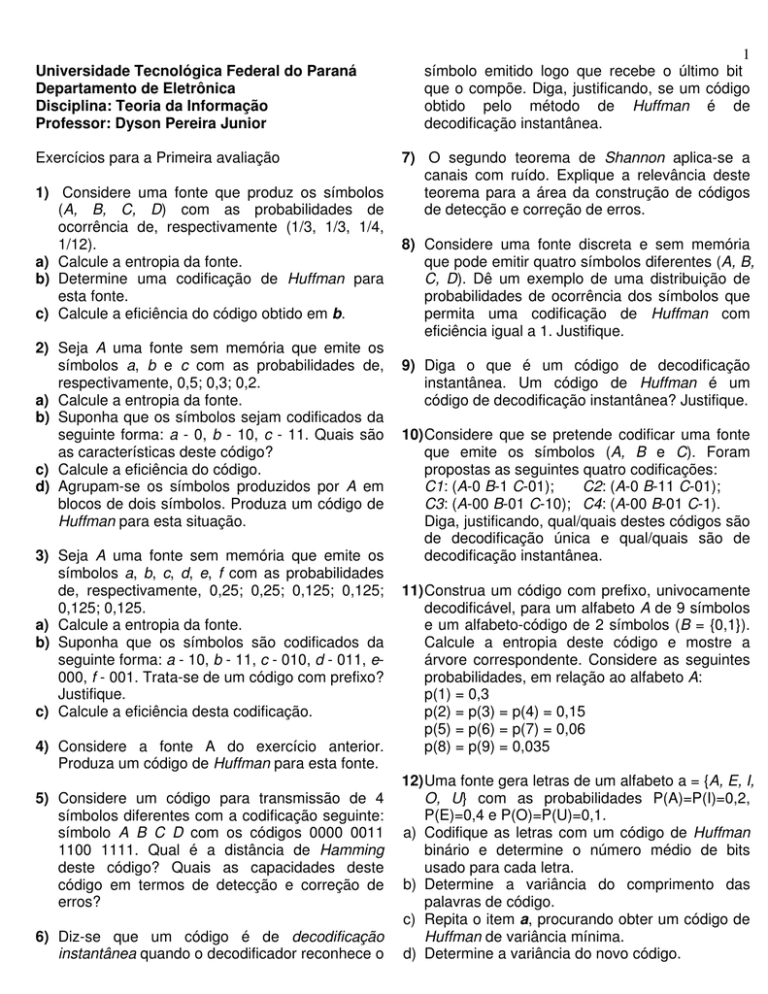

Universidade Tecnológica Federal do Paraná

Departamento de Eletrônica

Disciplina: Teoria da Informação

Professor: Dyson Pereira Junior

Exercícios para a Primeira avaliação

1) Considere uma fonte que produz os símbolos

(A, B, C, D) com as probabilidades de

ocorrência de, respectivamente (1/3, 1/3, 1/4,

1/12).

a) Calcule a entropia da fonte.

b) Determine uma codificação de Huffman para

esta fonte.

c) Calcule a eficiência do código obtido em b.

2) Seja A uma fonte sem memória que emite os

símbolos a, b e c com as probabilidades de,

respectivamente, 0,5; 0,3; 0,2.

a) Calcule a entropia da fonte.

b) Suponha que os símbolos sejam codificados da

seguinte forma: a - 0, b - 10, c - 11. Quais são

as características deste código?

c) Calcule a eficiência do código.

d) Agrupam-se os símbolos produzidos por A em

blocos de dois símbolos. Produza um código de

Huffman para esta situação.

3) Seja A uma fonte sem memória que emite os

símbolos a, b, c, d, e, f com as probabilidades

de, respectivamente, 0,25; 0,25; 0,125; 0,125;

0,125; 0,125.

a) Calcule a entropia da fonte.

b) Suponha que os símbolos são codificados da

seguinte forma: a - 10, b - 11, c - 010, d - 011, e000, f - 001. Trata-se de um código com prefixo?

Justifique.

c) Calcule a eficiência desta codificação.

4) Considere a fonte A do exercício anterior.

Produza um código de Huffman para esta fonte.

5) Considere um código para transmissão de 4

símbolos diferentes com a codificação seguinte:

símbolo A B C D com os códigos 0000 0011

1100 1111. Qual é a distância de Hamming

deste código? Quais as capacidades deste

código em termos de detecção e correção de

erros?

6) Diz-se que um código é de decodificação

instantânea quando o decodificador reconhece o

símbolo emitido logo que recebe o último bit

que o compõe. Diga, justificando, se um código

obtido pelo método de Huffman é de

decodificação instantânea.

7) O segundo teorema de Shannon aplica-se a

canais com ruído. Explique a relevância deste

teorema para a área da construção de códigos

de detecção e correção de erros.

8) Considere uma fonte discreta e sem memória

que pode emitir quatro símbolos diferentes (A, B,

C, D). Dê um exemplo de uma distribuição de

probabilidades de ocorrência dos símbolos que

permita uma codificação de Huffman com

eficiência igual a 1. Justifique.

9) Diga o que é um código de decodificação

instantânea. Um código de Huffman é um

código de decodificação instantânea? Justifique.

10) Considere que se pretende codificar uma fonte

que emite os símbolos (A, B e C). Foram

propostas as seguintes quatro codificações:

C1: (A-0 B-1 C-01);

C2: (A-0 B-11 C-01);

C3: (A-00 B-01 C-10); C4: (A-00 B-01 C-1).

Diga, justificando, qual/quais destes códigos são

de decodificação única e qual/quais são de

decodificação instantânea.

11) Construa um código com prefixo, univocamente

decodificável, para um alfabeto A de 9 símbolos

e um alfabeto-código de 2 símbolos (B = {0,1}).

Calcule a entropia deste código e mostre a

árvore correspondente. Considere as seguintes

probabilidades, em relação ao alfabeto A:

p(1) = 0,3

p(2) = p(3) = p(4) = 0,15

p(5) = p(6) = p(7) = 0,06

p(8) = p(9) = 0,035

12) Uma fonte gera letras de um alfabeto a = {A, E, I,

O, U} com as probabilidades P(A)=P(I)=0,2,

P(E)=0,4 e P(O)=P(U)=0,1.

a) Codifique as letras com um código de Huffman

binário e determine o número médio de bits

usado para cada letra.

b) Determine a variância do comprimento das

palavras de código.

c) Repita o item a, procurando obter um código de

Huffman de variância mínima.

d) Determine a variância do novo código.

2

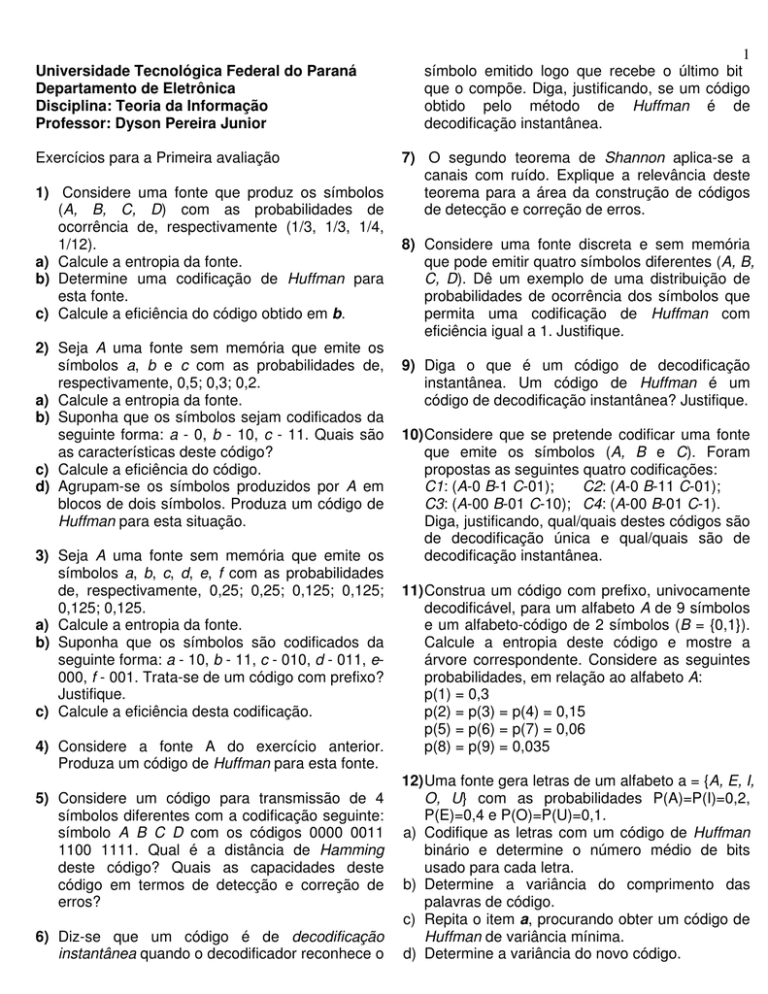

13) Considere os dois códigos de Huffman da tabela

seguinte:

Letras Probabilidades Código I

X1

0,2

01

X2

0,4

1

X3

0,2

000

X4

0,1

0010

X5

0,1

0011

Código II

10

00

11

010

011

Poderá verificar que o número médio de

bits/símbolo, n , é igual em ambos os códigos e

que a variância do código 2 é a menor das duas.

a) A seqüência x2x1x3x2x1x2x4 codificada com o

código 1 e enviada através de um canal, que

provocou um erro no primeiro bit da seqüência

binária (em vez de se receber um “1” recebeuse um “0”, ou vice-versa). Quantos caracteres

errados ocorrem antes do primeiro corretamente

decodificado?

b) Repita o mesmo para o código 2.

c) Repita as alíneas anteriores, mas supondo

agora que é o terceiro bit recebido que está

errado.

14) Um alfabeto de entrada (por exemplo, um

teclado de um processador de texto) consiste

em 100 caracteres.

a) Se as teclas forem codificadas através de um

código de comprimento fixo, determine o

número requerido de bits para a codificação de

cada tecla.

b) Suponhamos que 10 das teclas são

equiprováveis e que cada uma ocorre com

probabilidade 0,05. Suponhamos também que

as restantes 90 teclas são batidas com igual

probabilidade. Determine o número médio de

bits requerido para codificar este alfabeto

usando um código de Huffman.

15) Uma palavra foi codificada usando o código de

Huffman, tendo-se obtido a seqüência binária:

10111011010111001110100

O alfabeto original era constituído pelas letras A,

B, C, D, E, I, L, R e T e a letra I foi codificada

como "00". Supondo que estas letras ocorriam

com as probabilidades

P(A) = 0,26 P(B) = 0,09

P(C) = 0,08 P(D) = 0,01

P(E) = 0,07

P(I) = 0,22 P(L) = 0,01

P(R) = 0,23 P(T) = 0,03

qual terá sido a palavra codificada?

16) Uma fonte discreta possui um alfabeto de 10

símbolos X1, X2, …, X10 que ocorrem com as

seguintes probabilidades:

{1/50, 2/50, 3/50, 4/50, 5/50, 5/50, 6/50, 7/50,

8/50, 9/50}.

a) Codifique os símbolos da fonte com um código

de Huffman ternário.

b) Determine o comprimento médio das palavras

do código.