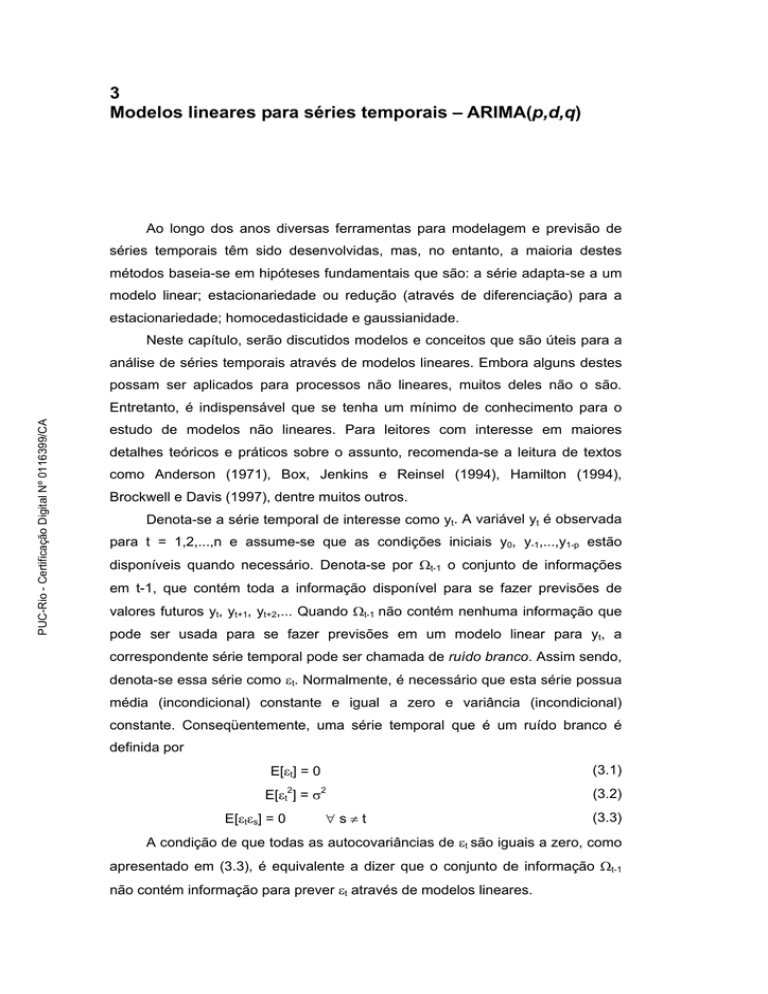

3

Modelos lineares para séries temporais – ARIMA(p,d,q)

Ao longo dos anos diversas ferramentas para modelagem e previsão de

séries temporais têm sido desenvolvidas, mas, no entanto, a maioria destes

métodos baseia-se em hipóteses fundamentais que são: a série adapta-se a um

modelo linear; estacionariedade ou redução (através de diferenciação) para a

estacionariedade; homocedasticidade e gaussianidade.

Neste capítulo, serão discutidos modelos e conceitos que são úteis para a

análise de séries temporais através de modelos lineares. Embora alguns destes

possam ser aplicados para processos não lineares, muitos deles não o são.

PUC-Rio - Certificação Digital Nº 0116399/CA

Entretanto, é indispensável que se tenha um mínimo de conhecimento para o

estudo de modelos não lineares. Para leitores com interesse em maiores

detalhes teóricos e práticos sobre o assunto, recomenda-se a leitura de textos

como Anderson (1971), Box, Jenkins e Reinsel (1994), Hamilton (1994),

Brockwell e Davis (1997), dentre muitos outros.

Denota-se a série temporal de interesse como yt. A variável yt é observada

para t = 1,2,...,n e assume-se que as condições iniciais y0, y-1,...,y1-p estão

disponíveis quando necessário. Denota-se por Ωt-1 o conjunto de informações

em t-1, que contém toda a informação disponível para se fazer previsões de

valores futuros yt, yt+1, yt+2,... Quando Ωt-1 não contém nenhuma informação que

pode ser usada para se fazer previsões em um modelo linear para yt, a

correspondente série temporal pode ser chamada de ruído branco. Assim sendo,

denota-se essa série como εt. Normalmente, é necessário que esta série possua

média (incondicional) constante e igual a zero e variância (incondicional)

constante. Conseqüentemente, uma série temporal que é um ruído branco é

definida por

E[εt] = 0

(3.1)

E[εt2] = σ2

(3.2)

E[εtεs] = 0

∀s≠t

(3.3)

A condição de que todas as autocovariâncias de εt são iguais a zero, como

apresentado em (3.3), é equivalente a dizer que o conjunto de informação Ωt-1

não contém informação para prever εt através de modelos lineares.

25

3.1.

Modelos lineares de séries temporais

Geralmente, pode se pensar para qualquer série temporal yt como sendo a

soma de duas partes: o que pode e o que não pode ser previsto usando o

conhecimento do passado. Isto é, yt pode ser decomposto como

yt = E[yt|Ωt-1] + υt ,

(3.4)

onde E[.|.] denota o operador do valor esperado condicional e υt é

chamado de “parte imprevisível”, com E[υt|Ωt-1] = 0. Neste capítulo assume-se

que υt satisfaz as propriedades do ruído branco (3.1) – (3.3).

Um modelo muito aplicado na parte previsível de yt assume que a previsão

pode ser feita por uma combinação linear dos lags passados de ordem p da

série, que é,

y t = φ1 y t −1 + φ 2 y t − 2 + ... + φ p y t − p + ε t ,

t = 1,...,n

(3.5)

PUC-Rio - Certificação Digital Nº 0116399/CA

onde φ1,..., φp são parâmetros desconhecidos. Este simples modelo é

chamado de modelo auto-regressivo de ordem p [AR(p)] ou auto-regressão de

ordem p. Usando o operador de retardo L, definido por Lkyt = yt-k para k =

0,1,2,...,(3.5) pode ser escrito de uma forma mais concisa como

φ p ( L) y t = ε t ,

onde

φ p ( L) = 1 − φ1 L − ... − φ p L p ,

(3.6)

que é chamado de polinômio AR em L de ordem p.

Quando p em AR(p) é grande, pode-se tentar aproximar o polinômio AR

por uma razão de dois polinômios em que juntos envolvem um número menor de

parâmetros. O modelo resultante é

φ p ( L) yt = θ q ( L)ε t , t = 1,...,n,

(3.7)

Com

φ p ( L) = 1 − φ1 L − ... − φ p L p ,

θ q ( L) = 1 + θ1 L + ... + θ q Lq ,

onde o p em (3.7) é, normalmente, muito menor do que o p em (3.5). Este

modelo é chamado de auto-regressivo média móvel de ordem (p,q) [ARMA(p,q)].

A classe de modelos ARMA foi popularizada por Box & Jenkins (1970).

Algumas vezes é conveniente assumir que a parte previsível de yt é uma

combinação linear dos mais recentes q choques εt-1,...,εt-q. Isso reduz,

26

efetivamente, o modelo ARMA em (3.7) para um modelo de médias móveis de

ordem q [MA(q)], dado por

y t = ε t + θ1ε t −1 + ... + θ q ε t − q , t = 1,...,n.

(3.8)

3.2.

Estacionariedade

Uma série ruído branco como definida em (3.1) – (3.3) é um caso especial

de uma série estacionária. Geralmente, uma dada série temporal yt é dita

estacionária se tem uma média, variância e covariâncias constantes, isto é,

E[yt] = µ

∀ t = 1,...,n,

E[(yt - µ)2] = γ0

∀ t = 1,...,n,

E[(yt - µ)(yt-k - µ)] = γk ,

(3.9)

(3.10)

(3.11)

onde µ, γ0 e γk são valores finitos.

PUC-Rio - Certificação Digital Nº 0116399/CA

Para saber se uma série gerada por um processo ARMA(p,q) é

estacionária ou não, deve-se analisar os valores dos parâmetros autoregressivos φ1,...,φp. Por exemplo, considere uma auto-regressão de primeira

ordem

y t = φ 0 + φ1 y t −1 +ε t ,

(3.12)

onde foi incluído um intercepto φ0 para descrever uma média diferente de

zero de yt. Tomando os valores esperados de ambos os lados em (3.12), isto é,

E[ y t ] = φ 0 + φ1 E[ y t −1 ] + E[ε t ] ,

(3.13)

assumindo que yt é estacionário e usando (3.9) e (3.1), segue que

µ=

φ0

.

1 − φ1

(3.14)

Note que (3.14) só faz sentido se |φ1| < 1. Por exemplo, quando φ1 excede

1 e φ0 é um número positivo, (3.14) implica que a média de yt é negativa, embora

(3.12) diga que, em média, yt é um múltiplo de seu valor anterior mais uma

constante positiva. Essa aparente contradição é causada pelo fato de que para

se derivar (3.14) assume-se yt estacionário em um primeiro momento, e que não

é o caso quando |φ1| ≥ 1.

Sendo assim, para séries que não são estacionárias, é uma prática comum

de se proceder com a análise de ∆1yt ≡ (1 – L)yt = yt – yt-1 – que nada mais é do

que a série diferenciada de yt. Quando uma série temporal precisa ser

diferenciada d vezes – que é o filtro aplicado ∆1d – diz-se que a série é integrada

27

de ordem d [I(d)]. Quando um modelo ARMA é integrado em ∆1dyt, fala-se que yt

é descrito por um modelo de médias móveis integrado auto-regressivo de ordem

(p,d,q) [(ARIMA(p,d,q)].

3.3.

Estratégia de especificação

Nesta seção, vai se demonstrar uma típica estratégia de especificação de

modelos de série temporal lineares, a qual foi utilizada neste trabalho para

comparação com o modelo não linear proposto para a previsão do preço da série

do CMO.

Em geral, os vários passos nessa estratégia valem para modelos não

lineares, entretanto, algumas vezes existem diferenças nas ferramentas

estatísticas que deveriam ser utilizadas. A modelagem normalmente envolve os

PUC-Rio - Certificação Digital Nº 0116399/CA

seguintes passos:

(1) calcular certas estatísticas para a série temporal em análise;

(2) comparar estes valores (ou “tamanho”) dessas estatísticas com os

respectivos valores teóricos para saber se o modelo é adequado (ou

uma qualquer hipótese nula de um teste estatístico);

(3) estimar os parâmetros para o modelo proposto;

(4) avaliar o modelo usando medidas de diagnóstico;

(5) reespecificar o modelo se necessário;

(6) usar o modelo para fins de descrição ou previsão.

A principal vantagem de se modelar seqüencialmente os valores

observados da série é de que modelos específicos implicam em específicas

propriedades dos dados que são gerados por estes modelos. Comparando estas

propriedades com as características correspondentes da série temporal em

análise, pode-se ter uma idéia do grau de utilidade do modelo para descrever

essa série. Por exemplo, sabe-se que um modelo MA(1) apresenta apenas autocovariância de primeira ordem diferente de zero. Portanto, testes estatísticos

podem ser realizados para saber se isso é verdade na série observada e, se isso

for confirmado, pode-se iniciar no passo (3) com um modelo MA(1).

3.4.

Identificação da ordem do modelo (p, d, q)

Para os modelos ARIMA, os passos (1) e (2) são fundamentalmente para

identificar a ordem do modelo, ou seja, p, d e q. Essa parte da especificação é

28

chamada quase sempre de “identificação do modelo” (Box & Jenkins, 1970).

Note que em modelos não lineares existe identificação dos parâmetros que é um

conceito completamente diferente deste. Essa identificação em vários modelos

não lineares é de que algumas restrições tenham que ser impostas para que se

possa “identificar” (estimar) os parâmetros.

As estatísticas mais relevantes para identificar a ordem do modelo são as

funções de autocorrelação (FAC) e autocorrelação parcial (FACP). Para saber

com detalhes o que significam essas funções, o comportamento e como elas são

computadas de forma que se identifique a ordem p e q consulte Souza e

Camargo (1996). Existe também um comportamento específico dessas funções

para saber se a série necessita de diferenciação. Além disso, testes de hipótese

que verificam a presença ou não de uma raiz unitária na equação característica

como Dickey Fuller (DF), Augmented Dickey Fuller (ADF) e Phillips Perron (PP)

podem ser aplicados.

PUC-Rio - Certificação Digital Nº 0116399/CA

É muito importante dizer que existem outras ferramentas para auxiliar a

identificação da ordem do modelo (Souza e Camargo, 1996). A análise única e

exclusiva da FAC e FACP pode se tornar extremamente complicada até mesmo

para quem tem experiência na identificação.

3.5.

Estimação

Os parâmetros em um modelo AR(p)

y t = φ 0 + φ1 y t −1 + φ 2 y t − 2 + ... + φ p y t − p + ε t ,

(3.15)

podem ser estimados por mínimos quadrados ordinários (MQO). Pode ser

mostrado que sob suposições relativamente fracas sobe as propriedades das

inovações εt (muito mais fracas do que as hipóteses do ruído branco

apresentadas aqui em (3.1) – (3.3)), que parâmetros estimados sob o MQO são

consistentes e assintoticamente normais e a estatística t padrão pode ser usada

para investigar a significância de φ1 a φp (veja Box & Jenkins, 1970). A média µ

de yt pode ser estimada de µˆ = φˆ0 /(1 − φˆ1 − φˆ2 − ... − φˆp ) . Usando os parâmetros

estimados, a série de resíduos εˆt pode ser construída.

Muitos métodos de estimação dos parâmetros para modelos ARIMA foram

desenvolvidos (veja Box, Jenkins e Reinsel, 1994; Brockwell e Davis, 1977, para

exemplos de métodos como a máxima verossimilhança e mínimos quadrados

ordinários). O fato de que não existe um método preferencial para estimação é

29

causado pelo fato de que as variáveis defasadas da parte MA são não

observáveis, e suas realizações tem que ser estimadas juntamente com os

parâmetros.

As

propostas

dos

procedimentos

de

estimação

diferem

principalmente na estimação desses choques não observados.

Um método muitas vezes aplicado é o método de mínimos quadrados

iterativo. (Box, Jenkins e Reinsel, 1994)

3.6.

Ferramentas de Avaliação

Apresenta-se nesta seção alguns dos testes estatísticos aplicados ao

modelo selecionado (identificado e com os parâmetros estimados), para a

comprovação de sua validade.

O primeiro deles é conhecido como teste de sobrefixação e consiste,

PUC-Rio - Certificação Digital Nº 0116399/CA

basicamente, na elaboração de um modelo com um número maior (ou menor) de

parâmetros em comparação com o modelo selecionado, ou seja, com o objetivo

de cubrir supostas direções de discrepâncias. Este modelo mais elaborado é

submetido à análise, que indicará a necessidade ou não de parâmetros

adicionais. Portanto, este teste tem como objetivo tentar corrigir algum erro que

tenha sido cometido quando da identificação do modelo.

Em seguida, menciona-se um método que testa a significância

conjuntamente das m primeiras autocorrelações dos resíduos. O teste estatístico

desenvolvido por Ljung e Box (1978) é dado por

m

LB (m) = n(n + 2)∑ (n − k ) −1 rk2 (εˆ ) ,

(3.16)

k =1

e pode ser usado para este propósito. Sob a hipótese nula de que não

existe autocorrelação nos resíduos para as defasagens de 1 a m de um modelo

ARIMA(p,d,q), o teste LB tem uma distribuição assintótica χ2(m-p-q), desde que

m/n seja pequeno e m é moderadamente grande. Alguns estudos de simulação

mostraram que o teste LB talvez não tenha muito poder (veja, por exemplo, Hall

e McAleer, 1989). Mesmo com essa propriedade ruim do teste, ele é quase

sempre utilizado devido à fácil implementação computacional.

Pó último, uma suposição usual é de que as realizações que compõe a

série de resíduos sejam independentes e identicamente distribuídos de acordo

com uma distribuição normal de média 0 e uma variância comum σ2. Dada essa

suposição, pode-se usar ferramentas comuns para validar as estimativas dos

parâmetros e realizar os testes t.

30

Um teste que pode ser utilizado para verificar a normalidade dos resíduos

é o Jarque Bera. Esta estatística de teste é

2

Sˆ − 0 Kˆ − 3

+

JB =

6 n 24 n

2

2

= n Sˆ + n Kˆ − 3

6

24

2

(

)

(3.17)

onde S é o coeficiente de assimetria e K é o coeficiente de curtose.

Supondo que S e K são normais estas estatísticas tem distribuição

assintoticamente χ2 com dois graus de liberdade.

A hipótese de normalidade dos dados é rejeitada a nível de confiança (1 -

JB > χ 2

2

α) se

−1

(1 − α )

.

Outros testes podem ser utilizados como, por exemplo, o teste de

Anderson Darling e ferramentas como o P-P plot e o Q-Q plot.

PUC-Rio - Certificação Digital Nº 0116399/CA

3.7.

Modelos SARIMA

Os processos encontrados na prática, além de raramente serem

estacionários, apresentam muitas vezes componentes sazonais. Assim Box &

Jenkins formularam seus modelos para séries temporais com componentes

sazonais dando origem aos modelos SARIMA.

Nesse caso a modelagem segue a equação:

φ ( B)Φ( B S )∇ SD∇ d Zt = θ ( B)Θ( B S )at ,

(3.18)

onde:

φ(B), operador não sazonal auto-regressivo; φi, parâmetros auto-regressivo

não-sazonais; ∇d =(1-B)d, operador diferença não sazonal de ordem d; Φ(Bs),

operador sazonal auto-regressivo; Φi, parâmetros auto-regressivo sazonais; ∇Ds

=(1-Bs)D, operador diferença sazonal de ordem D; θ(B), operador não sazonal

de médias móveis; θi, parâmetros de médias móveis não sazonais; Θ(Bs),

operador sazonal de médias móveis; Θi, parâmetros de médias móveis sazonais.

Um modelo com esta estrutura é denominado SARIMA(p,d,q)x(P,D,Q).

Ressalta-se que o procedimento de obtenção deste modelo segue os mesmos

passos empregados para achar o modelo ARIMA não sazonal. Isto quer dizer

que, no SARIMA, faz-se também a observância do comportamento da FAC e da

FACP, entretanto, olha-se para as defasagens sazonais (para uma série mensal,

por exemplo, são as defasagens 12, 24, 36, etc).