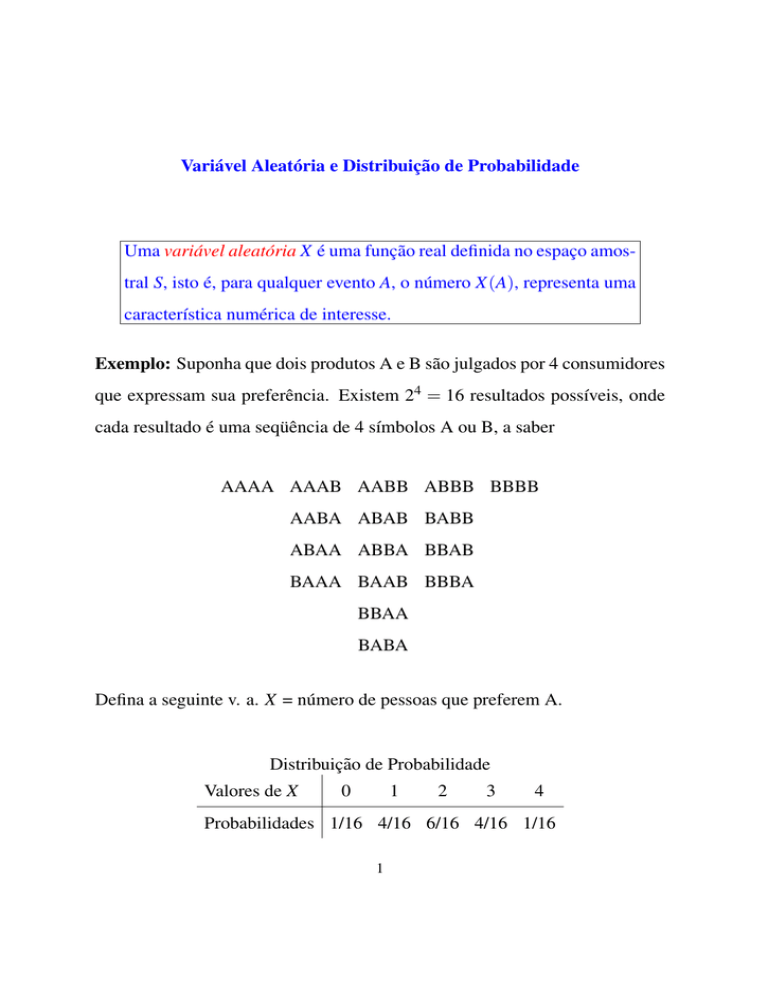

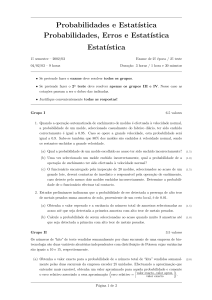

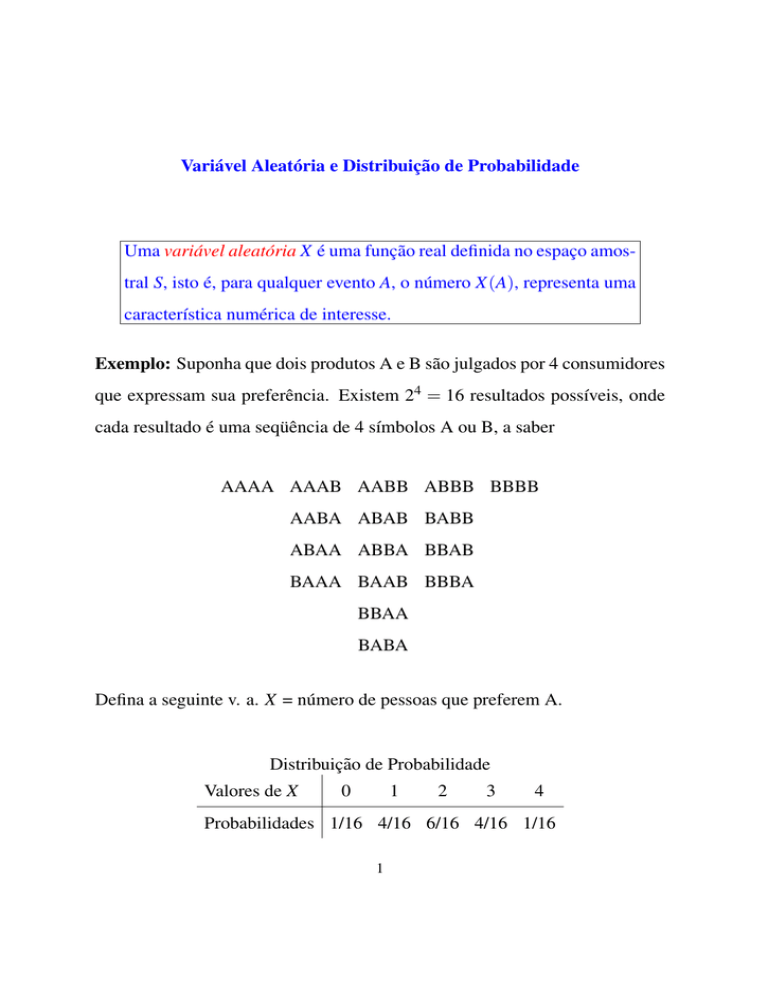

Variável Aleatória e Distribuição de Probabilidade

Uma variável aleatória X é uma função real definida no espaço amostral S, isto é, para qualquer evento A, o número X(A), representa uma

caracterı́stica numérica de interesse.

Exemplo: Suponha que dois produtos A e B são julgados por 4 consumidores

que expressam sua preferência. Existem 24 = 16 resultados possı́veis, onde

cada resultado é uma seqüência de 4 sı́mbolos A ou B, a saber

AAAA AAAB AABB ABBB BBBB

AABA ABAB BABB

ABAA ABBA BBAB

BAAA BAAB BBBA

BBAA

BABA

Defina a seguinte v. a. X = número de pessoas que preferem A.

Distribuição de Probabilidade

Valores de X

0

1

2

3

4

Probabilidades 1/16 4/16 6/16 4/16 1/16

1

A distribuição de probabilidade de uma v. a. discreta, é uma lista

dos distintos valores xi de X com suas probabilidades associadas, isto é,

{xi , P(X = xi ), i = 1, 2, . . .}, que pode ser representada por uma tabela ou

por uma fórmula.

Exemplo: A chance de um paciente responder positivamente a um estı́mulo

(sucesso) durante um experimento é 1/3. Experimentos são realizados até que

ocorra o primeiro sucesso. Seja X o número de experimentos realizados até

ocorrer o primeiro sucesso. Qual a distribuição de probabilidade de X?

O espaço amostral é S = { S, FS, FFS, FFFS, FFFFS, . . . },

onde S = sucesso e F = fracasso.

Distribuição de Probabilidade de X

Valores de X 1

P(X = x)

1

3

2

3

4

···

( 23 )( 13 ) ( 23 )2 ( 13 ) ( 23 )3 ( 13 ) · · ·

( )x−1

2

1

, x = 1, 2, 3, . . .

P(X = x) =

3

3

2

Exemplo (Amostragem para aceitação): Uma fabrica produz balas de cupuaçu

cobertas com chocolate e acondicionas em caixas com 15 balas. Cada caixa

centém 5 balas não conforme (abaixo do peso). A vigilância escolhe uma

caixa ao acaso e pesa 3 balas (amostra). Seja X o número de balas não conforme na amostra. Determine a distribuição de probabilidade de X.

Valores de X

P(X = x)

0

1

2

3

24/91 45/91 20/91 2/91

(10)

(10) (5)

·

120

45 × 5 45

24

3

P(X = 0) = (15

=

P(X = 1) = 2(15) 1 =

=

)=

455 91

455

91

3

3

(5)

(10) (5)

·

10

×

10

20

10

2

3

P(X = 2) = 1(15) 2 =

=

P(X = 3) = (15

=

)=

455

91

455 91

3

3

O valor esperado ou a média ou a esperança de uma variável aleatória

discreta X é dada por

µ = E(X) = ∑ xi P(X = xi )

i

Exemplo: Para o caso das balas

4

E(X) = ∑ xi P(X = xi ) = 0 ·

i=1

24

45

20

2

+1· +2· +3·

=1

91

91

91

91

3

A variância de uma variável aleatória X é dada por

{

}

2

σ = Var(X) = E (X − µ ) = E(X 2 ) − (E(X))2 , onde

2

E(X 2 ) = ∑ xi2 P(X = xi )

i

Exemplo: Para o caso das balas

4

E(X ) = ∑ xi P(X = xi ) = 02 ·

2

i=1

24

45

20

2

143

+ 12 · + 22 · + 32 ·

=

91

91

91

91

91

Portanto,

Var(X) = E(X 2 ) − (E(X))2 =

143

4

− 12 =

91

7

O dsvio padrão de uma variável aleatória X é dada por

σ = d p(X) =

4

√

Var(X)

Distribuição Binomial

Considere n repetições independentes de um experimento com

P(sucesso) = p constante em cada repetição. Seja X o número de

sucessos nas n repetições.

Nesta situação, dizemos que X tem distribuição binomial com parâmetros

n e p. Notação X ∼ B(n, p). Os possı́veis valores de X são os inteiros

0, 1, 2, . . . , n.

( )

n x n−x

P(X = x) =

p q , x = 0, 1, 2, . . . , n e q = 1 − p

x

E(X) = np e Var(X) = np(1 − p)

Exemplo: No cruzamento de plantas com flores vermelhas e brancas, 25% resultam em plantas com flores vermelhas. Se cruzamos 5 pares destas plantas,

qual a probabilidade do resultado ser: (a) Nenhuma planta com flor vermelha;

(b) Quatro ou mais plantas com flores vermelhas.

sucesso = planta com flor vermelha P(sucesso) = 0, 25 n = 5,

P(X = x) =

(5)

x

(5)

0

5

0 × (0, 25) × (0, 75) = 0, 237

()

()

≥ 4) = 54 × (0, 25)4 × (0, 75)1 + 55 × (0, 25)5 × (0, 75)0

(a) P(X = 0) =

(b)P(X

× (0, 25)x × (0, 75)5−x , x = 0, 1, 2, 3, 4, 5.

5

= 0, 016

Distribuição Normal

A função densidade de probabilidade f (x) descreve a distribuição de

probabilidade de uma variável aleatória contı́nua e satisfaz:

(a) A área total sob a curva da densidade é 1;

(b) P(a ≤ X ≤ b) = área sob a curva da densidade entre a e b;

(c) f (x) é positiva ou nula.

Uma v. a. contı́nua X tem distribuição normal com média µ e variância σ 2 ,

notação X ∼ N(µ , σ 2 ) se sua densidade é dada por

{

}

1

(x − µ )2

−∞ < x < ∞

f (x) = √

exp −

2σ 2

2πσ

Distribuição Normal Padrão

Uma v. a. contı́nua X tem distribuição normal padrão, isto é, com média 0 e

variância 1, notação X ∼ N(0, 1) se sua densidade é dada por

{ 2}

1

x

f (x) = √ exp −

−∞ < x < ∞

2

2π

Se X ∼ N(µ , σ 2 ), então Z =

X−µ

σ

Aproximação da binomial pela normal

B(n, p) ≈ N(np, npq)

quando n é grande e p não está proximo de 0 ou 1.

6

∼ N(0, 1)

Conceitos Básicos de Testes de Hipóteses

Um teste estatı́stico é uma afirmação sobre a população, que é avaliada com base em informações obtidas de uma amostra da população.

Como a afirmação pode ser falsa ou verdadeira temos duas hipóteses complementares.

hipótese 1: a afirmação é vedadeira

hipótese 2: a afirmação é falsa.

Usando informações de uma amostra, devemos tomar uma das decisões:

rejeito H0 e concluo que H1 é fortemente sustentada pelos dados

não rejeito H0 e concluo que não há evidência nos dados para sustentar H1 .

O processo pelo qual é feita a escolha entre estas duas ações é chamado teste estatı́stico de hipóteses

Proposição matemática: A função h(x) = 3x2 − 2x + 1 tem mı́nimo em x = 2.

Resultado da investigação: Em x = 2 temos que h(x) = 9, mas quando x = 0,

h(x) = 1.

Conclusão: A proposição matemática é falsa.

7

Hipótese estatı́stica: A proporção de consumidores que preferem o produto da

marca A é p = 0, 4 (ou seja, 40% dos consumidores de um produto preferem

a marca A).

Resultado da investigação: Em uma amostra aleatória de 15 consumidores,

12 revelaram que preferem a marca A.

Conclusão: É altamente improvável que a hipótese estatı́stica seja verdadeira.

Usando X ∼ B(15; 0, 4) temos que P(X ≥ 12) = 0, 002. Como é possı́vel

acontecer esta observaçã quando p = 0, 4, não podemos garantir absolutamente que a hipótese é falsa.

Problema: Experiência mostra que a razão de cura para uma dada doença

usando um medicamento padrão é 60%. A razão de cura de uma nova droga

é anunciada como melhor que o medicamento padrão. Suponha qua a nova

droga é testada em uma amostra de 20 pacientes e o número de pacientes

curados X é registrado. Como os dados experimentais podem ser usados para

responder a questão: Existe uma forte evidência de que a nova droga tem

maior poder de cura que o medicamento padrão?

X ∼ B(20, p),

p um parâmetro desconhecido.

Temos duas hipóteses relevantes:

A nova droga é melhor que o medicamento padrão p > 0, 6

8

A nova droga não é melhor que o medicamento padrão p ≤ 0, 6

Escolha de H0 e H1

Quando queremos estabelecer uma afirmação com garantias obtidas

em uma amostra, a negação da afirmação deve ser tomada como a

hipótese nula H0 e a própria afirmação é tomada como hipótese altenativa H1 .

Um réu é inocente até que as provas do crime sejam evidentes.

Ao testar uma hipótese nula H0 contra uma hipótese alternativa H1 ,

nossa atitude é admitir H0 como verdade até que os dados deponham

fortemente contra ela, neste caso, H0 será rejeitada em favor de H1 .

Neste sentido, a especificação das hipóteses nula e alternativa no nosso problema é

H0 : p ≤ 0, 6 (a nova droga não é mehor)

H1 : p > 0, 6 (a nova droga é melhor)

Os dados experimentais sobre a nova droga é X, o número de pacientes curados entre os 20 pacientes que usaram a nova droga.

9

Os valores de X ({0,1, . . . , 20}) podem ocorrer sob H0 e sob H1 , de modo que

nenhum dos resultados pode provar absolutamente que H0 é verdade ou que

H1 é verdade.

Um procedimento objetivo: rejeitar H0 (em favor de H1 ) se X ≥ 15 e não rejeito H0 se X ≤ 14. Uma tal regra é chamada teste da hipótese nula e X é

chamada a estatı́stica de teste. Claro que outras regras podem ser consideradas.

Um teste da hipótese nula é uma ação especificando o conjunto de

valores de uma v. a. X para os quais H0 é rejeitada. A v. a. cujos

valores servem para determinar a ação é chamada a estatı́stica de teste

e o conjunto de seus possı́veis valores para os quais H0 é rejeitada é

chamado de região de rejeição do teste. Um teste é completamente

especificado pela estatı́stica de teste e a região de rejeição.

No nosso exemplo temos:

Estatı́stica de teste 7−→ X número de pacientes curados na amostra;

Região de rejeição 7−→ R = {15, 16, 17, 18, 19, 20}

Qualquer que seja a decisão, rejeitar H0 ou não rejeitar H0 , está associada a

um erro que pode ser medido (risco calculado).

10

Os dois tipos de erro

Verdadeiro estado da natureza

H0 verdadeira

H0 falsa

Decisão

(p ≤ 0, 6)

(p > 0, 6)

Não rejeitar H0

Correto

Errado

(Erro Tipo II)

Rejeitar H0

Errado

Correto

(Erro Tipo I)

Erro Tipo I: rejeitar H0 quando H0 é verdadeira

Erro Tipo II: não rejeitar H0 quando H1 é verdadeira

As probabilidades dos dois tipos de erro

α = P(Erro Tipo I) = P(rejeitar H0 | H0 é verdadeira)

β = P(Erro Tipo II) = P(não rejeitar H0 | H1 é verdadeira)

A probabilidade α depende de um particular valor em H0 , enquanto β

depende de um valor particula em H1 .

Exemplo: Continuando a solução do nosso problema, X ∼ B(20, p) e o teste

11

á rejeitar H0 se X ≥ 15. A função de probabilidade do teste é:

γ (p) = P(rejeitar H0 | o valor do parâmetro é p) = P(X ≥ 15|p)

Probabilidades de rejeitar H0 para o teste X ≥ 15.

p

0,4

0,5

0,6

0,7

0,8

0,9

γ (p) = P(X ≥ 15|p) 0,002 0,021 0,126 0,416 0,804 0,989

P(Erro Tipo I) = α (p) = γ (p) para p ≤ 0, 6

P(Erro Tipo II) = β (p) = 1 − γ (p) para p > 0, 6

12

Os principais passos para testar hipóteses são:

1. Identificar o modelo de probabilidade apropriado e o parâmetro sobre o

qual são feitas as hipóteses;

2. Formular a hipótese nula H0 e a hipótese alternativa H1 ;

3. Escolher a estatı́stica de teste e determinar a estrutura da região de rejeição;

4. Especificar a distribuição amostral da estatı́stica de teste sob H0 e determinar a região de rejeição para o α especificado e;

5. Implementar o teste e tirar conclusões.

A conclusão de um teste estatı́stico é a afirmação

rejeitar H0 ou a afirmação não rejeitar H0

ao nı́vel de significância α

A probabilidade de significância (P-valor ou nı́vel descritivo) do teste, é o

menor valor de α para o qual rejeita-se H0 .

Além de realizar um teste de hipótese com um valor de α prédeterminado, uma boa prática é apresentar a probabilidade de significância

13

Testando hipóteses sobre a média

Inicialmente, vamos considerar pequenas amostras.

Suposição: X

∼ N(µ , σ 2 ) =⇒ X

Queremos testar H0 : µ = µ0

∼N

(

2

µ , σn

)

contra H1 : µ > µ0 .

Naturalmente a es-

tatı́stica de teste será a média amostral X.

Se σ é conhecido, sob H0 ,

Z=

(

)

X − µ0

σ

√

n

∼ N(0, 1).

Neste caso a regra é

rejeitar H0 se X > c ⇒

X−√

µ0

σ/ n

>

c−√

µ0

σ/ n

(

(

)

e P X >c =P Z>

c−√

µ0

σ/ n

)

Como P(Z > zα ) = α , a probabilidade do Erro Tipo I é satisfeita escolhendose c tal que

√

c − µ0

√ = zα =⇒ c = µ0 + zα (σ / n)

σ/ n

Portanto, a região de rejeição é X > µ0 + zα √σn ou Z > zα

Se σ é desconhecido, usamos o desvio padrão amostral s e sob H0 ,

)

(

X − µ0

T=

∼ t − Student, com n − 1 graus de liberdade.

s

√

n

14

Portanto, a região de rejeição é X > µ0 + tn−1,α √sn ou T > tn−1,α

Resumo: Teste de hipótese para uma média em pequenas amostras

Hipótese

nula (H0 ) alternativa (H1 )

µ = µ0

µ = µ0

µ = µ0

µ > µ0

µ < µ0

µ ̸= µ0

Estatı́stica de teste

σ conhecido

σ desconhecido

X > µ0 + zα √σn

X > µ0 + tn−1,α √sn

Z > zα

T > tn−1,α

X < µ0 − zα √σn

X < µ0 − tn−1,α √sn

Z < −zα

T < −tn−1,α

X > µ0 + zα /2 √σn X > µ0 + tn−1,α /2 √sn

ou

ou

X < µ0 − zα /2 √σn X < µ0 − tn−1,α /2 √sn

|Z| > zα /2

|T | > tn−1,α /2

Teste de hipótese para uma média em grandes amostras (n ≥ 30)

Quando n é grande e σ é desconhecido, o teste da hipótese nula H0 :

µ = µ0 é realizado usando-se a estatı́stica de teste normal

Z=

X − µ0

√s

n

Não requer nenhuma suposição quanto a forma da distribuição da

população.

15

Testando hipóteses sobre a proporção

Denotando a proporçaõ populacional por p, queremos testar

H0 : p = p0 contra H1 : p ̸= p0 .

A proporção populacional é bem estimada por

p̂ =

X

,

n

onde X é o número de sucessos na amostra de tamanho n.

Em grandes amostas, a distribuiçao de probabilidade de p̂ pode ser aproximada por uma normal con média p e variância pq/n. Sob H0 , a distribuição

(

)

0

de p̂ é aproximadamente N p0 , p0 ×q

. Portanto

n

p̂ − p0

Z=√

∼ N(0, 1)

p0 ×q0

n

Neste caso a região de rejeição do teste de nı́vel α é

{

}

√

√

po ×qo

po ×qo

|Z| > zα /2 ou p̂; p̂ < p0 − zα /2

n ou p̂ > p0 + zα /2

n

Para a hipótese alternativa unilateral, procedemos como no caso da média.

Como p̂ = X/n, temos que

Z=

X

n − p0

√

p0 ×q0

n

X − np0

=√

n × p0 × q0

16

Comparando duas população - Amostras independentes

Os dados são medidas de respostas associadas ao seguinte plano experimental:

Uma coleção de n1 + n2 indivı́duos são aleatoriamente divididos em 2 grupos

de tamanhos n1 e n2 . Cada membro do grupo 1 recebe o tratamento 1 e cada

membro do grupo 2 recebe o tratamento 2.

Amostra

População 1

Estatı́sticas

média µ1

X1 , X2 , . . . , Xn1 X =

População 2

Y1 ,Y2 , . . . ,Yn2

1

n1

n1

∑ Xi

i=1

média µ2

Y=

1

n2

n2

∑ Yi

i=1

variância σ12

n1 (

)2

S12 = n11−1 ∑ Xi − X

i=1

variância σ22

n2 (

)2

S22 = n21−1 ∑ Yi −Y

i=1

Queremos comparar

(media da população 1) - (media da população 2) = µ1 − µ2

17

Suposições para pequenas amostras

1. X1 , X2 , . . . , Xn1 é uma a. a. de uma distribuição N(µ1 , σ 2 );

2. Y1 ,Y2 , . . . ,Yn2 é uma a. a. de uma distribuição N(µ2 , σ 2 );

3. As variãncias populacionais σ12 e σ22 são iguais;

4. As amostras X1 , X2 , . . . , Xn1 e Y1 ,Y2 , . . . ,Yn2 são independentes.

Qual estatı́stica usar para fazer inferência sobre µ1 − µ2 ?

E(X −Y ) = E(X) − E(Y ) = µ1 − µ2

Var(X) + Var(Y ) =

Supondo que σ12 = σ22 = σ 2 , então

(

Var(X −Y ) = σ

2

σ12 σ22

+

n1 n2

1

1

+

n1 n2

)

Estimador combinado da variância comum

n1 (

)2 n2 (

)2

∑ Xi − X + ∑ Yi −Y

(n1 − 1)S12 + (n2 − 1)S22

i=1

i=1

2

Sp =

=

n1 + n2 − 2

n1 + n2 − 2

Assumindo populações normais temos que

(X −Y ) − (µ1 − µ2 )

(X −Y ) − (µ1 − µ2 )

√

√

∼ N(0, 1) e

∼ tn1 +n2 −2

1

1

1

1

σ n1 + n2

s p n1 + n2

18

Testando H0 : µ1 − µ2 = δ − variâncias iguais − σ12 = σ22

Estatı́stica de teste

T=

X −Y − δ

√

∼ tn1 +n2 −2

1

1

s p n1 + n2

Hipótese alternatina Região de rejeição de nı́vel α

H1 : µ1 − µ2 ̸= δ

|T | > tn1 +n2 −2,α /2

H1 : µ1 − µ2 > δ

T > tn1 +n2 −2,α

H1 : µ1 − µ2 < δ

T < −tn1 +n2 −2,α

Testando H0 : µ1 − µ2 = δ − variâncias diferentes − σ12 ̸= σ22

Estatı́stica de teste

(

X −Y − δ

∼ tn , onde n =

T= √ 2

S1

S22

n1 + n2

)

S12

S22 2

n1 + n2

( 2 )2

( 2 )2

S1

n1

n1 +1

+

S2

n2

n2 +1

Hipótese alternatina Região de rejeição de nı́vel α

H1 : µ1 − µ2 ̸= δ

|T | > tn,α /2

H1 : µ1 − µ2 > δ

T > tn,α

H1 : µ1 − µ2 < δ

T < −tn,α

19

−2

Exemplo: Um experimento foi conduzido com 25 vacas para comparar duas

dietas, uma com alfafa tipo A e outra com alfafa tipo B. A alfafa tipo B representa uma vantagem econômica. Uma amostra de 12 vacas foi selecionada

aleatoriamente e tratadas com alfafa B; as 13 vacas restantes foram tratadas

com alfafa A. Os animais foram observados por um perı́odo de 3 semanas e a

média diária da produção de leite foi registrada.

alfafa A 44, 44, 56, 46, 47, 38, 58, 53, 49, 35, 46, 30,41

alfafa B 35, 47, 55, 29, 40, 39, 32, 41, 42, 57, 51, 39

Os dados indicam que a produção de leite com a alfafa tipo B é menor que a

produção de leite com a alfafa tipo A? (Usar α = 5% - t23,5% = 1, 714).

H0 : µA = µB contra H1 : µA > µB

13

alfafa A n1 = 13 x = 45, 15

∑ (xi − x)2 = 767, 69 S12 = 64, 0

i=1

12

alfafa B n2 = 12 y = 42, 25

∑ (yi − y)2 = 840, 25 S22 = 76, 4

i=1

S2p =

13

12

i=1

i=1

∑ (xi − x)2 + ∑ (yi − y)2

T=

=

n1 + n2 − 2

767, 69 + 840, 25

= 69, 9

23

x−y

45, 15 − 42, 25 2, 90

√

√

=

=

= 0, 84

3,

45

1

1

1

1

S p n1 + n2

8, 63 13 + 12

Rejeito H0 se T > 1, 714

Resolver usando o Minitab

20

Comparando duas população - Amostras pareadas

Par ou Bloco Unidades experimentais

1

2

1

2

1

2

3

..

.

1

..

.

2

..

.

n

2 1

As unidades em cada par são similares, enquanto as diferentes unidades podem não ser. Em cada par, uma unidade é escolhida aleatoriamente para receber o tratamento 1 e a outra unidade recebe o

tratamento 2.

Estrutura dos dados para comparação pareada

Par ou Bloco Tratamento 1 Tratamento 2

Diferença

1

X1

Y1

D1 = X1 −Y1

2

..

.

X2

..

.

Y2

..

.

D2 = X2 −Y2

..

.

n

Xn

Yn

Dn = Xn −Yn

Os pares (X1 ,Y1 ), (X2 ,Y2 ), . . . , (Xn ,Yn ) são independentes

Estatı́sticas:

1 n

D = ∑ Di

n i=1

2

SD

1 n

(Di − D)2

=

∑

n − 1 i=1

21

Os pares (Xi ,Yi ) são independentes mas, Xi e Yi em cada par são

dependentes

E(Di ) = E(Xi −Yi ) = δ

Var(Di ) = Var(Xi −Yi ) = σD2 , i = 1, 2, . . . , n

Inferência em pequenas amostras para diferença média δ

Assumindo que as diferenças Di = Xi − Yi são independentes com

distribuição N(δ , σD2 ),

√

n

1

D = ∑ Di e SD =

n i=1

1 n

(Di − D)2

∑

n − 1 i=1

então, um teste para H0 : δ = δ0 é baseado na estatı́stica

T=

D − δ0

SD

√

n

∼ tn−1

Exemplo: Um pesquisador quer saber se uma determinada substância, tem o efeito indesejado de reduzir a pressão sanguı́nea do usuário. Em um estudo com 15 mulheres em idade

escolar, a pressão sanguı́nea foi medida no inı́cio do estudo e após o uso regular por seis

meses. O que o pesquisador pode concluir (α = 5%) sobre o efeito da substância na pressão

sanguı́nea?

Sujeito

2

3

4

5

6

7

8

9

10

11

12

13

14

15

Antes (X) 70 80

72

76

76

76

72

78

82

64

74

92

74

68

84

Depois (Y ) 68 72

62

70

58

66

68

52

64

72

74

60

74

72

74

10

6

18

10

4

26

18

-8

0

32

0

-4

10

D = (X −Y )

1

2

8

22

Cada sujeito representa um bloco gerando um par de medidas; uma antes e

outra depois de usar a substância. As diferenças são calculadas.

1 15

D=

∑ Di = 8, 80

15 i=1

Para testar H0 : δ = 0

T=

contra

e

v

u 15

u1

SD = t ∑ (Di − D)2 = 10, 98

14 i=1

H1 : δ > 0

D

8, 80

8, 80

√ =

√ =

= 3, 10

SD / n 10, 98/ 15 2, 84

tn−1,α = t14,5% = 1, 761

Consequentemente devemos rejeitar H0 em favor de H1

Resultados usando o Minitab

23