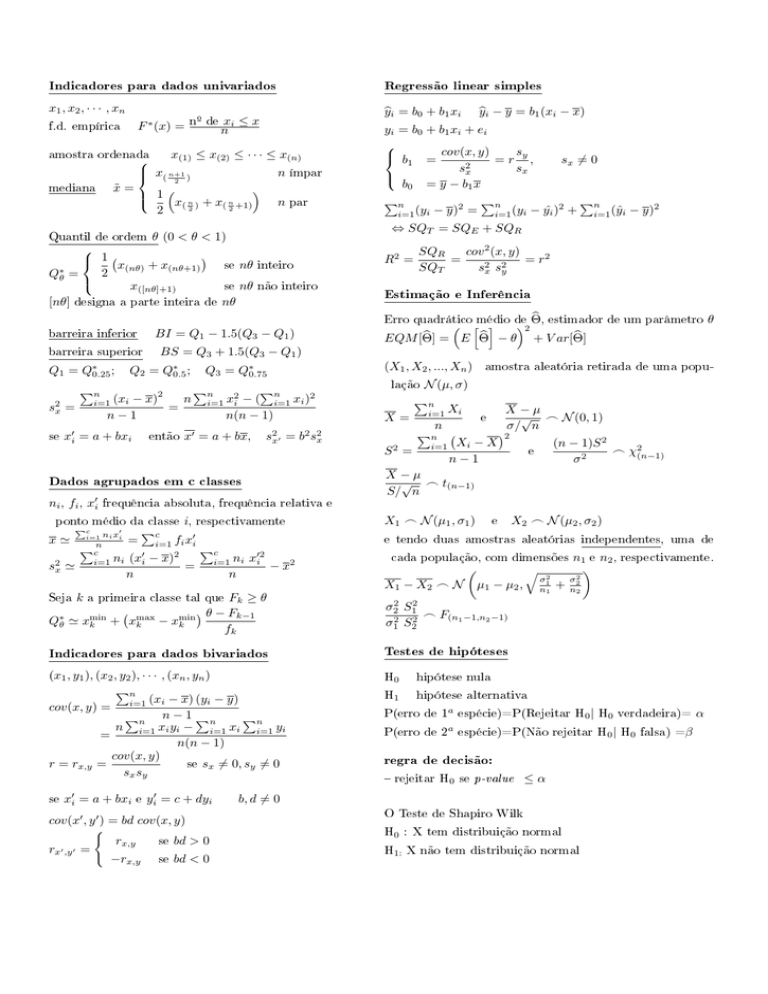

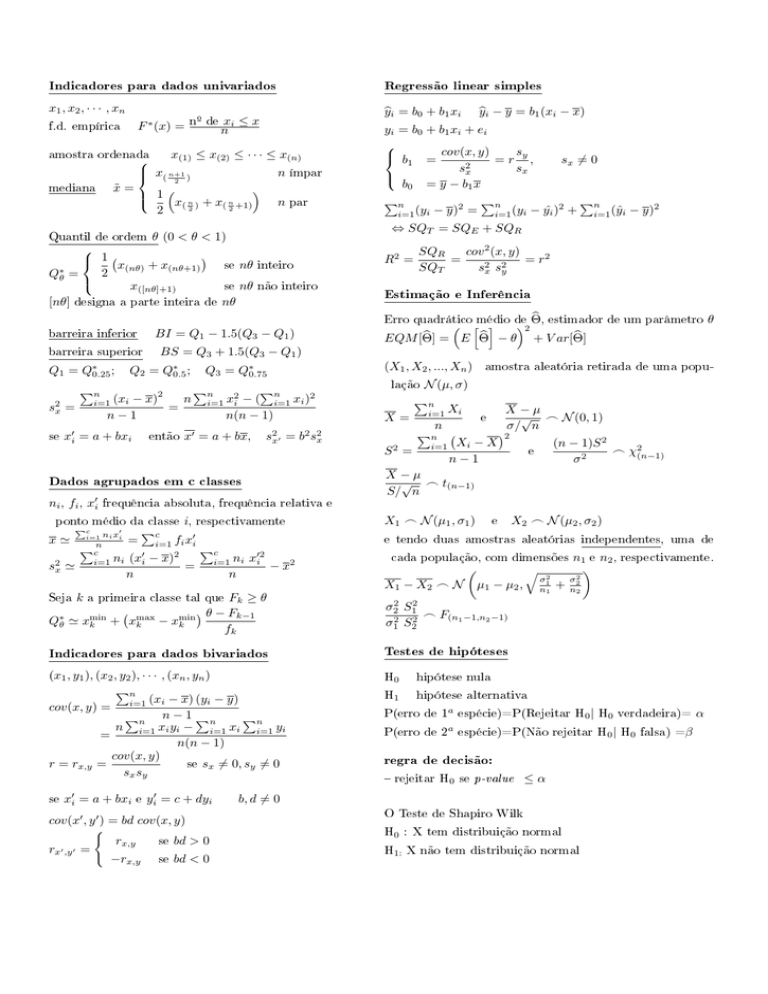

Indicadores para dados univariados

Regressão linear simples

x1 , x2 , · · · , xn

ybi = b0 + b1 xi

o

F ∗ (x) = n de nxi ≤ x

f.d. empírica

amostra ordenada

x(1) ≤ x(2) ≤ · · · ≤ x(n)

n ímpar

x( n+1

2 )

mediana x̃ =

1 x( n ) + x( n +1)

n par

2

2

2

Quantil de ordem θ (0 < θ < 1)

1 x

se nθ inteiro

(nθ) + x(nθ+1)

∗

2

Qθ =

x([nθ]+1)

se nθ não inteiro

[nθ] designa a parte inteira de nθ

barreira inferior

barreira superior

Q1 =

s2x =

Q∗0.25 ;

BI = Q1 − 1.5(Q3 − Q1 )

2

n

i=1 (xi − x)

=

n−1

se x0i = a + bxi

yi = b0 + b1 xi + ei

b = cov(x, y) = r sy ,

sx 6= 0

1

s2x

sx

b0 = y − b1 x

Pn

Pn

Pn

2

2

2

i=1 (yi − y) =

i=1 (yi − yˆi ) +

i=1 (ŷi − y)

⇔ SQT = SQE + SQR

R2 =

SQR

cov 2 (x, y)

= r2

=

SQT

s2x s2y

Estimação e Inferência

b

Erro quadrático

de

hmédio

i

2 Θ, estimador de um parâmetro θ

b = E Θ

b − θ + V ar[Θ]

b

EQM [Θ]

BS = Q3 + 1.5(Q3 − Q1 )

Q2 = Q∗0.5 ;

Pn

ybi − y = b1 (xi − x)

Q3 = Q∗0.75

Pn

Pn

2

2

i=1 xi − (

i=1 xi )

n(n − 1)

então x0 = a + bx,

s2x0 = b2 s2x

Dados agrupados em c classes

ni , fi , x0i frequência absoluta, frequência relativa e

ponto médio da classe i, respectivamente

Pc

Pc

n x0

x ' i=1n i i = i=1 fi x0i

Pc

Pc

ni (x0i − x)2

ni x02

i

= i=1

− x2

s2x ' i=1

n

n

Seja k a primeira classe tal que Fk ≥ θ

θ − Fk−1

Q∗θ ' xmin

+ xmax

− xmin

k

k

k

fk

(X1 , X2 , ..., Xn ) amostra aleatória retirada de uma população N (µ, σ)

Pn

Xi

X −µ

√ _ N (0, 1)

X = i=1

e

n

σ/ n

2

Pn

Xi − X

(n − 1)S 2

S 2 = i=1

e

_ χ2(n−1)

n−1

σ2

X −µ

√ _ t(n−1)

S/ n

X1 _ N (µ1 , σ1 )

e X2 _ N (µ2 , σ2 )

e tendo duas amostras aleatórias independentes, uma de

cada população, com dimensões n1 e n2 , respectivamente.

q 2

σ

σ2

X1 − X2 _ N µ1 − µ2 , n11 + n22

σ22 S12

_ F(n1 −1,n2 −1)

σ12 S22

Indicadores para dados bivariados

Testes de hipóteses

(x1 , y1 ), (x2 , y2 ), · · · , (xn , yn )

Pn

(xi − x) (yi − y)

cov(x, y) = i=1

Pn

Pn n − 1 Pn

n i=1 xi yi − i=1 xi i=1 yi

=

n(n − 1)

cov(x, y)

se sx 6= 0, sy 6= 0

r = rx,y =

sx sy

H0

hipótese nula

H1

hipótese alternativa

se x0i = a + bxi e yi0 = c + dyi

cov(x0 , y 0 ) = bd cov(x, y)

(

rx,y

se bd > 0

rx0 ,y0 =

−rx,y se bd < 0

P(erro de 1a espécie)=P(Rejeitar H0 | H0 verdadeira)= α

P(erro de 2a espécie)=P(Não rejeitar H0 | H0 falsa) =β

regra de decisão:

rejeitar H0 se

p-value

≤α

b, d 6= 0

O Teste de Shapiro Wilk

H0 : X tem distribuição normal

H1: X não tem distribuição normal

Probabilidade de acontecimentos

Cov[a + bX, c + dY ] = bd Cov[X, Y ] a, b, c, d ∈ IR

Cov[X, Y ]

ρ = ρX,Y =

σX , σY 6= 0

σX σY

ρa+bX,c+dY = ρX,Y se bd > 0

a, b, c, d ∈ IR

P (A − B) = P (A ∩ B) = P (A) − P (A ∩ B)

P (A|B) = 1 − P (A|B)

se P (B) 6= 0

P (A ∪ B ∪ C) = P (A) + P (B) + P (C) − P (A ∩ B)

−P (A ∩ C) − P (B ∩ C) + P (A ∩ B ∩ C)

Distribuição binomial

X _ B(n, p) ⇔ n − X _ B(n, q) com q = 1 − p

Variáveis aleatórias

X v.a. contínua com função densidade fX (x) e

Aproximações das distribuições

Y = ϕ(X), estritamente

monótona e derivável, então

dx fY (y) = fX (x) com x = ϕ−1 (y)

dy

X _ H(N, n, k) e

Parâmetros (de funções) de uma v.a. X

X

ϕ(xi )pi ,

se X discreta

E[ϕ(X)] =

i

R +∞

ϕ(x)f (x)dx, se X contínua

−∞

σ 2 = V ar[X] = E[(X − µ)2 ] = E[X 2 ] − µ2

(µ = E[X])

V ar[a + bX] = b2 V ar[X]

Função geradora de momentos

> 10 ⇒ X ∼ B (n, p) com p =

N

n

X _ B(n, p), n ≥ 20 e p ≤ 0.05 ⇒ X ∼ P (λ) com λ = np

X _ B(n, p), np > 5 e nq > 5 ⇒ X ∼ N (µ, σ)

√

com µ = np, σ = npq

X _ P(λ) e λ > 12 ⇒ X ∼ N (µ, σ) com µ = λ, σ =

√

λ

Teorema Limite Central

Sejam X1 , . . . , Xn , v.a.'s independentes e identicamente

distribuídas com valor médio µ e variância σ 2 (nita).

n

n

P

P

Sn =

Xi e X n = n1

Xi tem-se, c/ n grande

i=1

i=1

Sn − nµ

√

∼ N (0, 1)

σ n

MX (t) = E[etX ]

k

N

Xn − µ

√ ∼ N (0, 1)

σ/ n

e

Ma+bX (t) = eat MX (bt)

Se X e Y v.a.'s independentes MX+Y (t) = MX (t)MY (t)

Construção de modelos (distribuições)

Se MX (t) está denida numa vizinhança de zero

n v.a.'s Zi _ N (0, 1) independentes ⇒

d(r) MX (t)

= E[X r ],

dtr

|t=0

Z _ N (0, 1) e Y _ χ2(n) independentes ⇒ p

Zi2 _ χ2(n)

i=1

r = 1, 2, ...

Par aleatório (X, Y ) discreto com função massa de

probabilidade conjunta P [X = xi , Y = yj ] = pij

P

P

marginais

pi· = j pij

p·j = i pij

pij

condicional

P [X = xi |Y = yj ] =

p·j

Par aleatório (X, Y ) contínuo com função densidade

conjunta f (x, y)

R +∞

fX (x) = −∞ f (x, y)dy

f (x, y)

fX|Y =y (x) =

fY (y)

n

P

fY (y) =

R +∞

−∞

f (x, y)dx

Parâmetros de funções de um par aleatório (X, Y ).

PP

g(xi , yj )pij

i j

E[g(X, Y )] =

RR

g(x, y)f (x, y)dxdy

(X, Y ) discreto

(X, Y ) contínuo

R2

σX,Y = Cov[X, Y ] = E[(X − µX )(Y − µY )]

= E[XY ] − E[X]E[Y ]

(µX = E[X], µY = E[Y ])

V ar[X ± Y ] = V ar[X] + V ar[Y ] ± 2 Cov[X, Y ]

X _ χ2(m) e Y _ χ2(n)

X _ F(m,n) ) ⇒

Z

_ t(n)

Y /n

X/m

independentes ⇒

_ F(m,n)

Y /n

1

_ F(n,m)

X

Expressões úteis

Combinações de n elementos k a k , n, k ∈ IN0

n!

n

n

=

k≤n

Ck =

k

k!(n − k)!

R +∞ n −x

x e dx = n!, n ∈ IN0

0

∞

P

2

3

xn

ex = 1 + x + x2! + x3! + · · · =

n!

n=0

a(1 − rn+1 )

ar =

1−r

k=0

n

P

k

∞

P

ark =

k=0

a

,

1−r

se |r| < 1

Algumas regras de primitivas

Uma primitiva de xe−x

0

P (f g) = F g − P (F g )

0 α

P (f f ) =

0 f

f α+1

α+1

f

+C

P (f e ) = e + C

é

−e−x (x + 1)

F = Pf

α ∈ IR \ {−1}

0

P ff = log|f | + C