Personagens Sintéticas

Autónomas

Tópicos

Introdução

Expressividade - Projecto de Oz

Comunicação social - REA

Comportamento Realista – C4, Um

Cérebro Virtual

Conclusões

Bibliografia

Introdução

O que são personagens sintéticas?

Personagens que parecem vivas.

Criaturas que parecem possuir

personalidade.

Credibilidade

Autónomas:

Pensam, raciocinam e agem por si

próprias

Sem controle externo

Introdução

Inúmeras aplicações

Interfaces Homem-Máquina

Entretenimento – Jogos e Filmes

Testes de teorias

Várias áreas de estudo:

Animação tradicional

Computação gráfica

Inteligência artificial

Psicologia

Interfaces multimodais

Introdução

Projecto de Oz

REA

C4 – Um Cérebro Virtual

Conclusões

Bibliografia

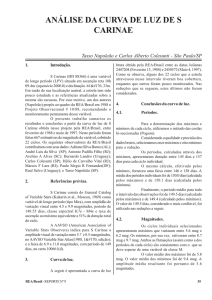

Projecto de Oz

Projecto de OZ - 1992

Teatros virtuais interactivos

Personagens sintéticas em ambientes

interactivos (woogles).

Inspirado no trabalho dos animadores da

Disney.

Baseada em:

Aspectos comportamentais.

Objectivos.

Emoções

Criaturas com reacções emocionais a eventos.

Projecto de Oz

Personagem credível – proporciona a ilusão de vida,

permitindo a suspensão de descrença da audiência.

Emoção fundamental para criar a ilusão de vida.

Três pontos chave para a representação de

emoções:

Estado emocional da personagem claramente

definido.

Processo de pensamento revela o sentimento.

Acentuação das emoções.

Personalidade

Arquitectura Tok

Geração Emoção (EM)

Objectivos

Quando um objectivo falha

Standards (normas morais)

Objectivo falha por culpa doutrem

Joy, Distress: intensidade = importância

Anger

Atitudes (relativas a objectos)

Funções que determinam Like/Dislike

Emoções Geradas

Selecção de Acções (HAP)

Objectivos

Biblioteca de “Planos” para atingir

objectivos

Condições de activação

Subobjectivos

Acções

Precondições

Árvore de objectivos e “planos”

activos

Introdução

Projecto de Oz

REA

C4 – Um Cérebro Virtual

Conclusões

Bibliografia

REA

REA (Real Estate

Agency) é um ECA no

domínio das agências

imobiliárias.

Tem uma base de dados

com casas à venda.

Mostra imagens

tridimensionais das

casas e quartos.

Duas câmaras permitem

detectar a posição da

cabeça e das mãos do

utilizador.

Utilizador fala com a REA

através de um

microfone.

Embodied Conversational Agents

Humanos Virtuais com capacidades sociais e

linguísticas para levar a cabo uma conversa face a

face:

Reconhecem e respondem a entradas verbais e não

verbais.

Geram saidas verbais e não verbais.

Lidam com funções conversacionais (dar a vez, dar

feedback).

Dispõem de sinais que indicam o estado da conversa.

Utilizam o corpo de uma maneira muito semelhante

aos humanos.

Ideais para suportarem uma interacção eficiente

entre pessoas e máquinas.

Não é necessário treino por parte dos utilizadores.

Modelo FMBT

FMBT – Functions

Dois tipos de contribuições:

Funções proposicionais. Correspondem à

informação semântica enviada. Discurso

informativo, gestos manuais, entoação de voz,

etc.

Ex: Gestos que indicam tamanho na sentença

“era deste tamanho”.

Funções de Interacção. Pistas que regulam

e mantêm aberto o canal de comunicação.

Ex: Acenar com a cabeça para indicar que se

está a compreender o interlocutor.

Modelo FMBT

FMBT – Modalities

Possibilidade de usar várias modalidades de

comunicação simultâneamente.

Fala, olhar, gestos.

Olhos focam a atenção do interlocutor.

Mãos ajudam a retirar ambiguidades e a

descrever localizações.

“O café fica ali.”

“Passa-me aquela camisa.”

Informação redundante e complementar em

paralelo

Modelo FMBT

FMBT – Behaviours are not functions

A mesma função comunicativa nem sempre se mapeia

no mesmo comportamento.

O mesmo comportamento nem sempre serve a mesma

função.

Funções:

Comportamentos:

Reagir a uma pessoa

Lançar um olhar breve

Desviar-se da conversa

Olhar em redor

Despedir-se

Acenar com as mãos

Pedir Feedback

Olhar para o interlocutor,

Levantar as sobrancelhas

Fornecer Feedback

Olhar para o interlocutor,

Acenar com a cabeça

Modelo FMBT

FMBT – Timing

Pessoas assumem que acontecimentos

síncronos têm significado.

O significado de um simples acenar pode

depender da altura em que ocorre na

conversa:

Um acenar de cabeça no preciso momento em

que o emissor pede feedback revela que o

receptor está a compreendê-lo!

Um atraso em acenar a cabeça por parte do

receptor pode significar discordância.

REA - Arquitectura

REA - Arquitectura

Input Manager

Integração das diversas modalidades

Reacção ou Deliberação

Action Sheduler

Escalonamento dos eventos motores

Sincronização entre modalidades

REA - Arquitectura

Deliberative Module

Understanding Module

Generation Module

Comportamentos -> Funções

Funções -> Comportamentos

Decision Module

Interactional Processing

Propositional Processing

REA - Exemplo

Mike aproxima-se do

ecrâ. Rea está virada

noutra direcção.

Rea vira-se, olha para

Mike e diz:

“Olá, em que posso

ajudá-lo?”

“Procuro uma casa perto

do MIT.”

“Tenho uma casa para

lhe mostrar.”

Aparece uma imagem da

casa no ecrâ. Rea olha

para a casa e novamente

para Mike.

“Fale-me sobre ela.”

Rea olha para um sitio

distante enquanto

decide o que dizer.

“É grande.”

REA - Exemplo

Mike levanta as mão

indicando que vai falar.

Rea para e espera.

“É muito longe?”

“Fica a 5 minutos da

estação de metro”

“É muito grande?”

“Tem 4 quartos, 3 casas

de banho…”

Mike interrompe Rea que

para de falar

imediatamente.

“Onde é que fica o quarto

principal?”

“No andar de cima.”

“E a casa de banho

principal?”

“Ao lado do quarto”

Introdução

Projecto de Oz

REA

C4 – Um Cérebro Virtual

Conclusões

Bibliografia

C4 – Um Cérebro Virtual

Influenciado pela teoria da atitude intencional.

Noção de ilusão de vida.

Personagens com a capacidade de expressarem o

seu estado mental:

Se conhecermos as crenças e os desejos de uma

criatura, podemos predizer as suas acções.

Um observador pode inferir as suas crenças e

desejos.

Aprendizagem essencial para atingir credibilidade

Capacidade de adaptação ao ambiente

Revisão e criação de crenças

C4 – Um Cérebro Virtual

Exemplo: Sheep|dog

Duncan

Pastor

Ovelhas

Utilizador controla o pastor, dando

comandos de voz ao duncan

(sit,down,away).

C4 - Arquitectura

C4 – Perception System

Árvore de Percepções Hierárquica

São apenas feitas transversias parciais da árvore.

Pode-se substituir os classificadores sem afectar o

funcionamento do sistema.

C4 – Working Memory

Memória de Percepção

Simula a memória de trabalho humana.

Lista de objectos persistentes.

Percepções

Predicções

Hipóteses

Juntos formam a vista que a criatura tem do

contexto.

Todos os componentes da C4 podem alterar ou

acrescentar este tipo de objectos.

C4 – Working Memory

Eventos de diferentes modalidades podem ser combinados num único

objecto.

A confiança num determinado objecto vai decaindo ao longo do

tempo.

Estrutura permite-nos questionar a memória de maneiras muito uteis.

“Há comida perto de mim?”

Escolher alvos de accção. “Procura um objecto humanoide e vai até

ele”.

C4 – Working Memory

Predicção

Informação sensorial vinda de um objecto

pode ser interrompida temporariamente.

Quando o registo de uma percepção não é

observado:

O seu valor é predito.

Torna-se visível ao sistema como se

tivesse sido realmente observado.

Base para surpresa.

Predição contribui para o senso comum e a

credibilidade de uma criatura.

Implicam expectativas acerca do mundo.

C4 – Action System

Selecção de Acções

Responder a 4 questões:

Quando fazer?

O que fazer e como fazer?

A que o fazer?

Durante quanto tempo?

Acção modifica estado interno da criatura

Guarda na memória o objecto actual de interesse

C4 – Action Selection

Grupos de acção

Definem acções que não se podem

executar ao mesmo tempo

Exemplo

Sentar e correr (Grupos diferentes)

Correr e abanar a cauda (mesmo grupo)

Acções são escolhidas

probabilisticamente

Aprendizagem

Aprendizagem por reforço (recompensa)

Recompensa associada à ultima acção

Memória de percepção activa no

momento da acção associada com a

recompensa

Introdução

Projecto de Oz

REA

C4 – Um Cérebro Virtual

Conclusões

Bibliografia

Conclusão

Bates e Loyall - OZ

Cassell - REA

Capacidades comunicação social

Blumberg - C4

Expressividade emocional e Personalidade

Atitude Intencional

Aprendizagem e capacidade de adaptação

Várias perspectivas

Todas elas importantes

Focos Diferentes

Bibliografia

Thomas F., Johnston O.: “Disney Animation: The Illusion of Life”,

Abbeville Press, New York, 1981

Ortony A., Clore G., Collins A.: “The Cognitive Structure of

Emotions”, Cambridge University Press, UK, 1988.

Gilboa E., Ortony A.: “The structure of emotion response

tendencies”. Work in progress, 1991.

Elliot C.: “The Affective Reasoner: A process model of emotions in

a multi-agent system”. Northwestern University, PhD Thesis,

Illinois, 92.

Bates J.: “The Role of Emotion in Believable Agents”. Technical

Report CMU-CS-94-136, School of Computer Science, Carnegie

Mellon University, Pittsburgh, PA. April 1994. Also to appear in

Communications of the ACM, Special Issue on Agents, July 1994.

Reilly S., Bates J.: ”Building Emotional Agents”. Technical Report

CMU-CS-92-143, School of Computer Science, Carnegie Mellon

University, Pittsburgh, PA. May 1992.

Loyall B.: ”Believable Agents: Building Interactive Personalities”.

Technical Report CMU-CS-97-123, School of Computer Science,

Carnegie Mellon University, Pittsburgh, PA. May 1997.

Bibliografia

Cassell J., Bickmore T., Billinghurst M., Campbell L., Chang K., Vilhjalmsson

H., and Yan H.:"Embodiment in Conversational Interfaces: Rea",

Proceedings of CHI 99, Pittsburgh, PA, 1999.

Cassell J., Bickmore T., Campbell L., Vilhjalmsson H., and Yan H.:"More

Than Just a Pretty Face: Conversational Protocols and the Affordances of

Embodiment", Knowledge-Based Systems, vol. 14, pp. 55-64, 2001.

Cassell J., Stocky T., Bickmore T., Gao Y., Nakano Y., Ryokai K., Tversky D.

Vaucelle C., Vilhjalmsson H.: “MACK: Media lab Autonomous

Conversational Kiosk”, in Proceedings of Imagina’02, Monte Carlo, 2002

Burke R., Isla D., Downie M., Ivanov Y, Blumberg B.: “CreatureSmarts: The

Art and Architecture of a Virtual Brain”. Proceedings of the Game

Developers Conference, 2001, pg. 147 – 166.

Blumberg, B.: “Swamped! Using plush toys to direct autonomous animated

characters.”, Proceedings of SIGGRAPH 98: conference abstracts and

applications.

Blumberg, B.: “(void*): A Cast of Characters”. Proceedings of SIGGRAPH

99: conference abstracts and applications.

Blumberg, B.: “D-Learning: What learning in dogs tells us about building

characters that learn what they ought to learn”. Distinguished

Presentations in AI, 2001

![Planta Apartamento B [ » 426.86 Kb]](http://s1.studylibpt.com/store/data/004097850_1-838864853e0454f6adf51b0afa732727-300x300.png)