APONTAMENTOS DE

B I O E S T A T Í S T I C A

Bárbara Oliveiros, 2008

BioEstatística

1. INTRODUÇÃO À BIOESTATÍSTICA

A estatística é uma área do conhecimento que utiliza teorias probabilísticas para explicação

de eventos, estudos e experimentos. Tem por objectivo obter, organizar e analisar dados,

determinar as relações que estes apresentam, e avaliar as consequências para descrição e

explicação do que passou, e/ou para a previsão e organização do futuro.

A estatística é também uma ciência e prática de desenvolvimento de conhecimento humano

através do uso de dados empíricos. Baseia-se na teoria estatística, um ramo da matemática

aplicada. Na teoria estatística, a aleatoriedade e incerteza são modeladas pela teoria da

probabilidade. Algumas práticas estatísticas incluem, por exemplo, o planeamento, a

descrição e a interpretação de observações. Porque o objectivo da estatística é a produção da

"melhor" informação possível a partir dos dados disponíveis, alguns autores sugerem que a

estatística é um ramo da teoria da decisão.

Origem

O termo estatística surge da expressão em Latim statisticum collegium, palestra sobre os

assuntos do Estado, de onde surgiu a palavra em língua italiana statista, que significa "homem

de estado", ou político, e a palavra alemã Statistik, designando a análise de dados sobre o

Estado. A palavra foi proposta pela primeira vez no século XVII, em latim, por Schmeitzel na

Universidade de Lena e adoptada pelo académico alemão Godofredo Achenwall. Aparece

como vocabulário na Enciclopédia Britânica em 1797, e adquiriu um significado de colecta e

classificação de dados, no início do século XIX.

Actualmente, é um ramo do conhecimento científico que tem por objectivo não só a

observação, classificação e análise dos fenómenos colectivos, mas também o estudo de

possibilidade de inferência indutiva a partir de dados observados.

A base da estatística e sua definição

A Estatística é uma ferramenta matemática que nos informa sobre o erro que as nossas

observações apresentam sobre a realidade pesquisada. A estatística baseia-se na medição do

erro que existe entre a estimativa de quanto uma amostra representa adequadamente a

população da qual foi extraída. Assim o conhecimento de teoria de conjuntos, teoria de

probabilidades, análise combinatória e cálculo são indispensáveis para compreender como o

3

Engenharia Biomédica

erro se comporta e a magnitude do mesmo. É o erro (erro amostral) que define a qualidade da

observação e do delineamento experimental.

A probabilidade de um evento é frequentemente definida como um número entre zero e um.

Na realidade, porém, nunca há situações que tenham probabilidades 0 ou 1. Pode dizer-se que

o sol irá certamente nascer na manhã seguinte, mas… e se acontecer um evento extremamente

difícil de ocorrer que o destrua? E se ocorrer uma guerra nuclear e o céu ficar coberto de

cinzas e fumo?

Normalmente aproximamos a probabilidade de alguma coisa para cima ou para baixo porque

elas são tão prováveis ou improváveis de ocorrer, que é fácil de reconhecê-las como

probabilidade de um ou zero.

Entretanto, isto normalmente leva a desentendimentos e comportamentos perigosos, porque as

pessoas não conseguem distinguir entre, uma probabilidade de 10-4 e uma probabilidade de

10-9. Na prática, há uma grande diferença: imagine que vai atravessar a estrada numa

passadeira cerca de 105 ou 106 vezes na sua vida. Considerando que o risco de atropelamento

é 10-9, pode ficar seguro para o resto da sua vida; considerando que o risco de atropelamento é

de 10-4, é bastante provável que venha a ser atropelado, mesmo com o sentimento intuitivo

que 0,01% é um risco muito baixo.

Bioestatística – é a estatística aplicada ao estudo das características biológicas das

populações (humanas) ou, de forma genérica, às ciências da vida.

A Bioestatística é cada vez mais uma área independente da estatística, ainda que as suas bases

assentem na teoria de probabilidades, tal como a própria Estatística.

Inicialmente, considerou-se a Bioestatística como a “Estatística aplicada à Biologia Humana e

Medicina”. Uma definição mais actual, e mais abrangente, passou a ser “a ciência que foca o

desenvolvimento e utilização de métodos estatísticos para resolver problemas e questões que

surgem nas áreas da Biologia Humana e Medicina”.

Contudo, começa a considerar-se que, na Bioestatística, poderão caber temas tão diversos

como a avaliação de recursos faunísticos e florais, estudos da teoria de aprendizagem e

comportamento animal, questões de ecologia e, sobretudo, Planeamento de Experiências.

4

BioEstatística

Assim, a Bioestatística tem de ser uma área interdisciplinar, onde o raciocínio dedutivo e

indutivo devem estar integrados de forma a considerar que:

•

a incerteza é fonte de conhecimento, quando a Probabilidade nos permite delimitá-la

caracterizando os seus padrões;

•

a informação obtida “por acaso” pode ser enganadora, enquanto que a informação obtida

“ao acaso” tem uma variabilidade útil;

•

mais importante do que a informação, é a transformação desta em conhecimento;

•

a amostragem é boa mas o Planeamento Experimental é ainda melhor, por ser um

investimento na obtenção de dados de qualidade, que importam analisar;

•

os problemas éticos não podem ser escamoteados na investigação experimental;

•

o problema do passado (e actual, no caso das doenças raras) era a escassez de dados e,

actualmente, o problema é, frequentemente, a proliferação de dados, muitas vezes de má

qualidade.

Estatística

Descritiva

Inferencial

Descrever dados através de

Tomada de decisão baseada

indicadores (estatísticas)

Estimadores dos reais

nos elementos observados

No conhecimento que o

ou experimentados (intervalos de

investigador tem sobre

Indicadores da população confiança e/ou testes estatísticos)

o problema em causa

5

Engenharia Biomédica

Sumariar dados

Estatística descritiva

Conhecimento da população

Extrapolar para a população as conclusões obtidas na amostra

Estimação de parâmetros

Inferência estatística

Cálculo de Probabilidades

(estatística assenta na

Testes de Hipóteses

teoria de probabilidades)

Origem nos jogos de azar

Fenómeno aleatório – influenciado pelo acaso

Experiência aleatória – há possibilidade de ser repetida em condições idênticas

- é conhecido o conjunto de todos os resultados possíveis, embora não

se saiba, à priori, qual será o resultado

- existe regularidade estatística na repetição da experiência

Experiência determinística – o resultado é conhecido antes da sua realização (ex: temperatura

de congelação ou ebulição da água)

6

BioEstatística

2. RECOLHA DE DADOS E AMOSTRAGEM

Primários – levantados especialmente para determinada investigação

Dados

Secundários- se se utilizam dados já existentes

Censo – informação relativa a todos os elementos da população

Recolha de dados

Dimensão mínima da amostra?

Amostragem – analisa-se um subconjunto da população

vantagens

Impossível a recolha de todos os elementos da população em

Populações infinitas

Com elevado nº de elementos

Quando o estudo das características de cada elemento conduz à sua destruição

O estudo cuidadoso de uma amostra conduz a resultados mais fidedignos do que o estudo

sumário de toda a população

Menor custo e obtenção de resultados em tempo oportuno

Problemas de ordem ética devem ser tidos em consideração

Estudo de novos medicamentos

Novas técnicas cirúrgicas

Técnicas invasivas

Amostra representativa da população

Não pode ser enviezada – definição correcta da população a inquirir e da técnica de

amostragem

Deve existir um controlo na obtenção de não respostas ou casos perdidos, o que pode

diminuir drasticamente a dimensão da amostra

Deve ter dimensão suficiente para que as conclusões a obter tenham um determinado grau

de confiança e nível de precisão

Amostras de conveniência são, muitas vezes, as únicas possíveis de obter, principalmente

quando se trata de populações raras, mal conhecidas, geograficamente mal determinadas

Perigo de tendenciosidade, logo inadequadas para produzir inferência

7

Engenharia Biomédica

Amostragem aleatória, casual ou probabilística é a que garante melhor representatividade

É necessário possuir uma listagem de todos os elementos da população de modo a que a

probabilidade de qualquer elemento da população ser seleccionado seja conhecida à priori

(≠0.)

Extremamente difícil obter-se tal amostragem ⇒ possível obter uma aproximação

Amostragem aleatória

Simples – todos os elementos têm igual probabilidade de serem seleccionados (1/N) por

sorteio (bolas numeradas num saco, tabela de nos aleatórios1). Este método não é muito

usado dado que é difícil obter populações réplica

Estratificada – quando se conhece a estrutura da população. Conduz a amostras

representativas de menor dimensão. A população é dividida em estratos, grupos

homogéneos relativamente a uma característica (ex: sexo), e dentro de cada estrato

seleccionam-se os elementos duma forma aleatória simples, de acordo com a proporção de

cada grupo na população.

Sistemática ou quase aleatória – Apenas o 1º elemento da amostra é escolhido

aleatoriamente, e os restantes são determinados de modo sistemático pela razão N/n (N –

dimensão da população; n – dimensão da amostra). O 1º elemento pode ser obtido por

uma tabela de nos aleatórios no intervalo [1, N/n], e os restantes por adição de N/n (valores

arredondados ao menor inteiro).

1

Geradas por processos matemáticos que constituem um conjunto de números que não obedecem a nenhum

plano prévio (amostras sem reposição)

8

BioEstatística

3. VARIÁVEIS, PROBLEMAS DE INVESTIGAÇÃO E QUESTÕES

3.1 Variáveis

Os elementos chave de uma investigação são as variáveis – características dos participantes

ou da situação de um determinado estudo, que pode tomar diferentes valores. Uma variável

tem de ter a capacidade de variar, ou tomar diferentes valores. Se um conceito apenas toma

um valor num estudo, então não é uma variável (por exemplo, o género não é uma variável se

todos os indivíduos do estudo forem mulheres).

Na investigação quantitativa, as variáveis podem ser definidas como:

Variável

Independente

Activa*

´Dependente

Estranha

Atributo **

3.1.1 Variável Independente

Activa – a variável ou a situação em que esta é avaliada pode ser manipulada. A variável de

interesse “é dada” ao participante (ex: terapia nova/terapia tradicional, substância

activa/placebo). A existência deste tipo de variáveis independentes é necessária mas não

suficiente para tirar conclusões de causa-efeito, ou seja, fazer inferência. Os Estudos

Experimentais (randomizados ou não) exigem a existência deste tipo de variáveis.

Atributo – a variável independente é medida, não pode ser manipulada, embora seja um foco

importante do estudo (os valores da variável independente são atributos “pré-existentes”, que

não se alteram sistematicamente com o desenrolar do estudo. Ex: género feminino/masculino,

escalão etário). Estudos que apenas têm variáveis independentes do tipo atributo são não

experimentais.

3.1.2 Variável Dependente – mede ou avalia o efeito da variável independente; é assumida

como o resultado.

9

Engenharia Biomédica

3.1.3 Variável Estranha – não são de interesse em determinado estudo, mas podem

influenciar a variável dependente. Factores ambientais e características do experimentador são

variáveis estranhas que devem ser controladas

.

3.2 Amostras independentes versus amostras emparelhadas

Independentes – se não existe nenhum tipo de relação ou factor unificador entre os

elementos das amostras: a probabilidade de um sujeito pertencer a ambas é nula (ex: uma

variável é avaliada para cada um dos géneros sexuais)

Emparelhadas – as amostras são constituídas usando os mesmos sujeitos experimentais,

ou homólogos (ex: a mesma variável é medida antes e depois de um determinado

tratamento). A excepção é quando se utilizam Gémeos ou animais da mesma ninhada

A distinção entre amostras independentes e emparelhadas é particularmente importante para a

inferência estatística: a relação, ou ausência de relação, existente entre os elementos de uma

ou mais amostras.

10

BioEstatística

3.3 Questões, Hipóteses e Objectivos de Investigação

A única diferença entre as questões e as hipóteses de investigação está no formato de

apresentação das ideias a investigar (pergunta/frase). A partir do momento em que estão

definidas as questões ou as hipóteses de investigação, estas podem ser objectivadas num

capítulo: objectivos de investigação ou do estudo.

Exemplos:

Questões

Hipóteses

Objectivos

Será que este novo tratamento é

eficaz em comparação com o

placebo?

Será que este novo tratamento é tão

seguro

como

o

tratamento

standard?

Pretende-se investigar a hipótese do

novo tratamento ser mais eficaz

que o placebo.

Pretende-se investigar a hipótese

que o novo tratamento é tão seguro

como o tratamento standard.

Pretende-se investigar a hipótese

que os expostos a determinados

factores de risco têm efectivamente

mais risco de doença que os não

expostos.

Pretende-se investigar a hipótese

que quem fez a terapia A tem 10

vezes menos risco de recidiva que

quem não fez.

Pretende-se investigar a hipótese

que os casos de doença estiveram

mais expostos a determinados

factores de risco que os controlos.

Pretende-se investigar a hipótese

desta doença apresentar uma

prevalência ao nível nacional que

não justifica que a mesma seja

considerada um problema de saúde

pública.

Pretende-se investigar a hipótese

dos

acidentes

de

viação

apresentarem uma incidência anual

que

realmente

justifica

ser

considerado um problema de saúde

pública.

Comparar a eficácia do novo

tratamento versus a eficácia do

placebo.

Comparar a segurança do novo

tratamento versus a segurança do

tratamento standard.

Será

que

os

expostos

a

determinados factores de risco têm

efectivamente mais risco de doença

que os não expostos?

Será que quem fez a terapia A tem

10 vezes menos risco de recidiva

que quem não fez?

Será que os casos de doença

estiveram mais expostos a determinados factores de risco que os

controlos?

Será que esta doença apresenta um

prevalência ao nível nacional que

justifique que a mesma seja

considerada um problema de saúde

pública?

Será que os acidentes de viação

apresentam um incidência anual

que justifique ser considerado um

problema de saúde pública?

Comparar as incidências da doença

entre os expostos a factores de risco

e os não expostos.

Comparar as taxas de recidiva entre

um grupo que faz a terapia A e um

grupo que não faz qualquer

tratamento.

Comparar casos com controlos

relativamente à exposição prévia a

factores de risco.

Determinar a taxa de prevalência

da doença a nível nacional.

Determinar a taxa de incidência

anual média dos acidentes de

viação nos próximos 5 anos.

11

Engenharia Biomédica

3.3.1 Relação entre variáveis e Questões/hipóteses e objectivos da Investigação

As variáveis têm de ser observadas para se poderem analisar os objectivos da investigação. De

acordo com os exemplos anteriores, poder-se-ia ter:

3.4 Níveis de mensuração das variáveis

Existem variáveis Qualitativas e Quantitativas.

As primeiras, embora categorias, podem ser ordenáveis ou não, ainda que, por vezes, se

considere que as variáveis dicotómicas são sempre ordenáveis. As variáveis quantitativas

podem ser discretas (se tomam valores num conjunto finito ou infinito numerável) ou

contínuas (se tomam valores no conjunto nos reais).

Dado que as variáveis medem qualidades ou quantidades, podem ser classificadas quanto ao

seu nível de mensuração, sendo que a escolha do tratamento estatístico adequado exige a

identificação da escala e níveis de medida das variáveis.

Níveis de Mensuração

Nominal

=, ≠

Ex: sexo, raça, religião, estado civil, nº na camisola do jogador de futebol

Os valores são atributos ou categorias; os úmeros apenas servem para identificar

categorias

Variáveis qualitativas – classificação dos indivíduos de acordo com as suas categorias

Nominal Dicotómica tem alguns privilégios

12

BioEstatística

Ordinal

=, ≠, <, >

Ex: nível sócio-económico, ordem de preferências, faixas etárias, grau de escolaridade

Podem ser distinguidos diferentes graus de um atributo ou categoria, existindo entre eles

uma

relação

de

ordem;

categorias

que

podem

ser

ordenadas

de

forma

ascendente/descendente; os códigos numéricos atribuídos a estas categorias devem

obedecer a essa ordem

Intervalar

=, ≠, <, >, valor das diferenças

Ex: temperatura, escala QI, medidas de atitudes e personalidade

Variáveis quantitativas – quanto valem as diferenças entre os valores: “Entre 10ºC e 30ºC

existe uma diferença idêntica à encontrada ente 70ºC e 90ºC.”… mas 90ºC não é 3 vezes

mais quente do que 30ºC! O zero é arbitrário e não ausência da característica!

Racional

Todas as operações aritméticas

Ex: peso, altura, idade, velocidade, níveis de glicémia

O valor mínimo é o zero absoluto, que representa ausência da característica medida.

É possível passar de um nível de mensuração para outro inferior ⇒ Perda de informação

3.5. Plano de Operacionalização das variáveis

Desde o momento que estão definidas diferentes variáveis para um estudo, é de todo o

interesse definir um plano de operacionalização (ou informatização) de variáveis. Neste

plano deve constar qual a notação computacional da variável, assim como os seus possíveis

valores ou códigos, o tipo de variável e a sua importância na investigação. Por exemplo:

13

Engenharia Biomédica

3.6 Codificação das variáveis

3.6.1 Regras

-

Todos os dados devem ser numéricos;

-

Cada indivíduo ou participante corresponde a uma linha da base de dados;

-

Cada variável de cada caso corresponde a uma coluna, na mesma linha, da base de dados;

-

Os códigos de uma variável devem ser mutuamente exclusivos;

-

Cada variável deve ser codificada de forma a que se obtenha o máximo de informação;

-

Cada indivíduo deve estar codificado com um identificador único

-

Os códigos devem ser consistentemente aplicados a todos os casos da base de dados

3.6.2 Controlo da Base de dados

É conveniente que se criem regras (escritas) para lidar com alguns problemas como: respostas

duplas, incompletas, em branco, não muito claras, etc.

Não respostas DEVEM ser células em branco, e não ZERO! Eventualmente, atribui-se um

valor superior ao máximo possível para aquela variável como, por exemplo, 99, 999, ...

14

BioEstatística

As não respostas podem

Resultar de erros de introdução ou de recolha de dados ⇒ devem ser eliminadas

Fazer parte da natureza intrínseca do fenómeno⇒ devem ser retidas

Caso estas atinjam ou ultrapassem 20% dos dados, devem ser analisadas com atenção pois, se

não tiverem um comportamento aleatório, irão enviezar os resultados do estudo, podendo

caracterizar o segmento da população que se negou a responder.

15

Engenharia Biomédica

4. REPRESENTAÇÃO DAS VARIÁVEIS

4.1 Indicadores numéricos

As estatísticas apropriadas dependem do nível de mensuração da variável.

Medidas de

Nominal

Tendência central

Moda

Localização

-

Dispersão

Indicadores da

distribuição

-

Nível de mensuração

Ordinal

Intervalar/Ratio

Média aritmética

Moda

Moda

Mediana

Mediana

Quantis:

Quantis:

Quartis/decis/percentis... Quartis/decis/percentis...

Amplitude inter-quartis

Erro/Desvio-padrão

Coeficiente de

Assimetria/Achatamento

Distribuição

Simétrica

- coef. assimetria = 0

- média=mediana=moda

Assimetria não confirmada

-

coef .assimetria

≤ 1.96

erro − padrão

- moda ≈ mediana ≈ média

assimétrica

-

coef .assimetria

> 1.96

erro − padrão

- assimétrica positiva ou à direita: Mo < Md < x

- assimétrica negativa ou à esquerda: x < Md < Mo

4.2 Representação gráfica

Gráfico de barras, Gráficos Circulares, Histograma de frequências ou de frequências

acumuladas, Polígono de frequências e ogiva de Galton são gráficos já conhecidos do aluno.

Diagrama de extremos e quartis ou caixa de bigodes - Outliers

A representação gráfica permite visualizar o comportamento da variável e identificar as

observações aberrantes ou outliers, que tendem a distorcer a média (aumentando-a ou

16

BioEstatística

diminuindo-a) e o desvio-padrão (aumentando-o). Nestes casos, Assim, estes devem ser

expressamente referidos e analisados aquando da interpretação dos resultados, analisando

ainda o efeito daqueles na distribuição através da comparação das estatísticas resultantes da

análise com e sem observações aberrantes.

Quando os outliers afectam significativamente os resultados, não se deve utilizar o desviopadrão como medida de dispersão, mas sim aplicar estatísticas mais robustas, como por

exemplo a amplitude inter-quartil ou a MAD (mediana dos desvios absolutos em relação à

mediana); alternativamente, podem transformar-se os dados de forma a obter a simetria.

Gráficos de Caule e Folhas – reúnem a informação dos

histogramas, mantendo o valor em cada observação.

Actualmente não são muito utilizados.

]

Diagrama de barras de erro: desvio-padrão, erro-padrão e

comparar uma variável dependente intervalar/ratio em pelo

menos dois grupos independentes. Ilustram não só o valor da

média, mas também a dispersão observada ou o valor esperado

na população, para cada grupo.

VEMS (S) 200ML

intervalo de confiança – muito úteis quando se pretende

4.00

3.00

]

2.00

]

Testemunha

Controlo

Estudo

Grupo

Diagramas de Dispersão – Ilustram a relação, casuística ou de

mera associação, entre 2 variáveis; particularmente úteis para

verificar se a relação entre variáveis é do tipo linear.

17

Engenharia Biomédica

4.3 Representação Tabular

Tabela de distribuição de frequências – 1 variável

Tabela de contingência - Representação simultânea de 2 variáveis

18

BioEstatística

Exemplo: Pretende-se avaliar uma possível relação entre a existência de cáries dentárias e o

sexo e o índice de massa corporal dos jovens portugueses. Pensa-se aidna que o IMC poderá

estar relacionado com a região de residência dos indivíduos.

1. Como planearia este estudo? Descreva sucintamente.

2. Suponha agora que já tinha colhido os dados referentes ao Sexo, Altura e existência de

cáries dentárias. Abra um livro do Microsoft Excel.

2.1. Na folha 1, crie um Plano de Operacionalização de Variáveis para os seguintes dados:

Id

1

2

3

4

5

6

7

8

9

10

11

12

13

14

Sexo

M

M

M

F

F

M

F

M

M

F

F

M

M

Altura

1.717

1.574

1.618

1.402

1.427

1.558

1.462

1.504

1.754

1.626

1.529

1.521

1.711

1.623

Cáries

Sim

Sim

Sim

Não

Não

Não

Sim

Sim

Não

Não

Não

Não

Sim

Sim

Id

15

16

17

18

19

20

21

22

23

24

25

26

27

28

Sexo

F

M

M

M

F

F

F

M

M

M

F

M

F

F

Altura

1.552

1.627

1.516

1.718

1.475

1.505

1.408

2.522

1.527

1.622

1.481

1.704

1.449

1.595

Cáries

Sim

Não

Sim

Sim

Não

Não

Sim

Sim

Não

Não

Sim

Não

Não

Id

29

30

31

32

33

34

35

36

37

38

39

40

41

42

Sexo

F

F

F

M

M

M

M

F

M

M

M

F

F

Altura

1.557

1.535

1.535

1.520

1.577

1.554

1.533

1.562

1.458

1.649

1.629

1.533

1.592

1.494

Cáries

Sim

Não

Não

Não

Não

Sim

Sim

Sim

Sim

Sim

Sim

Não

Não

2.2. Na folha 2, introduza os dados

3. Abra o SPSS

3.1. Importe os dados do Microsoft Excel

3.2. Altere as propriedades das variáveis: Label, Values, Measure

4. Determine a média, desvio-padrão e amplitude de variação das variáveis altura, peso, e

IMC.

4.1. Detecta algum erro de introdução? Em caso afirmativo, corrija esse valor para 1.522,

e determine novamente os valores pedidos em 4.

4.2. Determine os quartis e amplitude inter-quartil destas variáveis, segundo o sexo.

4.2.1. Existem outliers? Justifique.

5. Qual a percentagem de indivíduos, na amostra, que:

5.1. são do sexo masculino?

5.2. têm dentes cariados?

5.3. são do sexo feminino e têm dentes cariados.

5.4. são do sexo feminino, sabendo que têm dentes cariados.

5.5. têm dentes cariados, sabendo que são do sexo masculino.

19

Engenharia Biomédica

6. Por lapso, não tinham sido registados os valores de peso, para cada indivíduo, nem a

região de residência. Acrescente estas variáveis ao plano de operacionalização das

variáveis, e na base de dados em SPSS introduza a variável peso logo após a variável

altura, e a variável regiao no final, alterando as suas propriedades adequadamente.

Id

1

2

3

4

5

6

7

8

9

10

11

12

13

14

Peso

92.2

75.5

73.0

41.1

53.9

67.7

42.3

52.4

102.1

65.0

46.4

53.0

76.6

60.9

Regiao

N

S

N

N

S

N

S

S

S

N

N

S

S

N

Id

15

16

17

18

19

20

21

22

23

24

25

26

27

28

Peso

47.2

84.3

48.0

68.1

46.2

47.9

40.6

78.4

63.2

71.1

51.3

98.2

57.6

51.4

Regiao

S

S

N

N

S

S

N

S

N

N

S

S

S

N

Id

29

30

31

32

33

34

35

36

37

38

39

40

41

42

Peso

65.7

49.4

47.7

65.8

68.4

79.3

63.8

67.6

52.3

58.5

69.8

67.2

47.8

41.2

Regiao

N

S

N

S

N

N

S

S

S

S

N

S

N

S

7. Crie a variável Índice de Massa Corporal (IMC), que será automáticamente calculada

como peso altura 2 .

7.1. Descreva sucintamente esta variável, em termos estatísticos.

8. Crie a variável IMC_cl, que representa o IMC em classes, de acordo com a seguinte

classificação:

1

IMC < 18

Magreza

2

18 < IMC < 25

Normal

3

25 < IMC < 30

Excesso de Peso

4

30 < IMC < 35

Obesidade I

5

35 < IMC < 40

Obesidade II

6

40 < IMC < 45

Obesidade III

9. Recodifique esta variável (IMC_cl) em 4 clases, aglutinando as classes 4, 5 e 6 numa só.

(não se esqueça de acrescentar estas variáveis ao Plano de Operacionalização de Variáveis).

9.1. Descreva esta variável, em termos estatísticos

9.2. Qual a taxa de indivíduos com excesso de peso e obesidade?

9.3. Qual a taxa de indivíduos obesos, com cárie dentária.

9.4. Qual a taxa de indivíduo normais, com cárie dentária.

9.5. Qual a taxa de indivíduos com e sem cáries dentárias, entre os indivíduos:

9.5.1. obesos.

20

BioEstatística

9.5.2. normais

9.5.3. Parece-lhe ser viável o objectivo definido?

9.6. Parece-lhe que a ocorrência de cáries é mais frequente no sexo masculino?

9.7. Para cada região, determine

9.7.1. Em que região é mais frequente haver cáries dentárias?

9.7.2. O IMC médio em cada região.

9.7.3. Fará sentido estudar o objectivo do estudo, em cada região?

21

Engenharia Biomédica

5. DISTRIBUIÇÕES DE PROBABILIDADES

Função densidade de probabilidade – função que determina a probabilidade do valor de cada

observação da amostra na população: f(x)

A partir do conhecimento desta função, e dum número infinito de amostras com a mesma

dimensão da amostra em estudo pode estimar-se a distribuição amostral, ou seja, na prática, é

possível testar se as observações da amostra em estudo se ajustam a uma distribuição teórica.

Função de distribuição – Função real de variável real: F(x)= P(X < x)

1. 0 < F(x) < 1

2. F é não decrescente

3. Para qualquer função de distribuição F tem-se que

a.

lim F ( x) = 0 ; lim F ( x) = 1

x → −∞

x → +∞

b. ∀a, b ∈ ℜ : a < b, P ( a < X ≤ b) = F (b) − F ( a )

c. F é contínua à direita

5.1 Algumas distribuições de variáveis aleatórias contínuas

Distribuição Uniforme

U ( a, b )

Esta é a mais simples das distribuições contínuas, mas uma das mais importantes. É utilizada

para representar quantidades que variam aleatoriamente no intervalo [a,b], e cuja

probabilidade de tomar valores num qualquer subintervalo de [a,b] é proporcional ao seu

comprimento, logo constante nesse subintervalo.

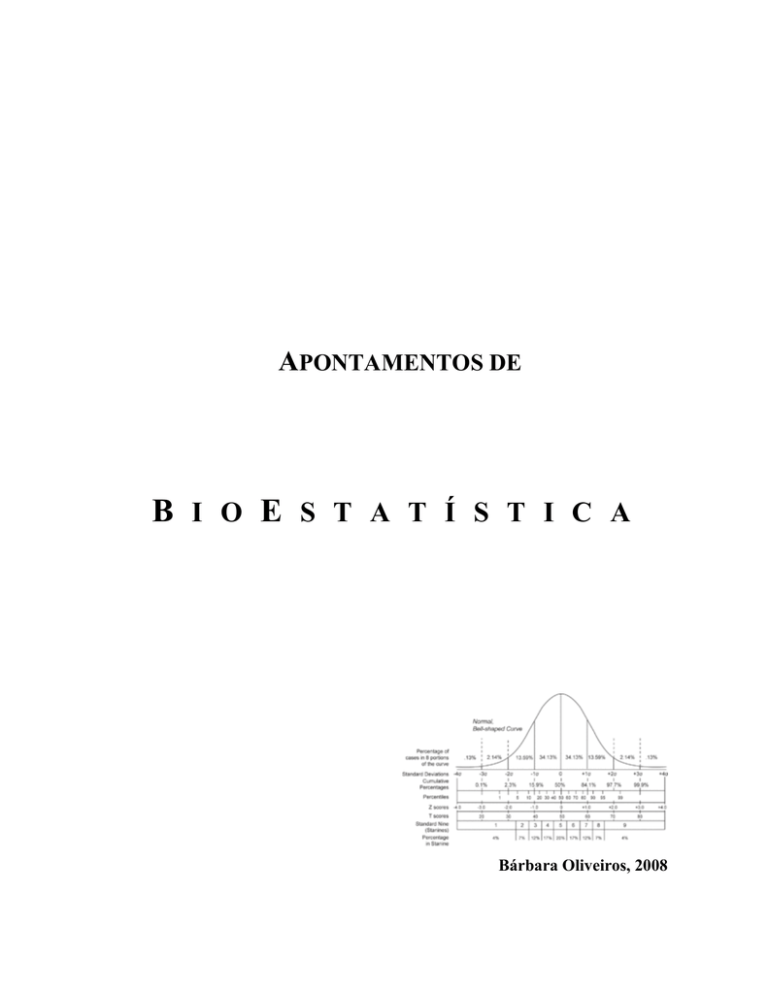

Distribuição normal ou de Gauss 2

N (µ ,σ 2 )

Fenómenos físicos, medidas biológicas, erros de medição, etc.

Polígonos de frequências regulares com grau de simetria e achatamento próximos dos de uma

distribuição normal

Quando se passa da distribuição de frequências para a distribuição de probabilidades obtém-se

2

Descrita pela primeira vez por De Moivre em 1733; Gauss, séc. XVIII-XIX teve um papel decisivo no seu

desenvolvimento.

22

BioEstatística

Características:

A variável aleatória X pode tomar um qualquer valor dentro do intervalo de variação

A curva representativa da distribuição tem a forma de sino e é simétrica relativamente à

média

Os valores da média, mediana e moda são iguais

Devido à simetria, P ( X < µ ) = P ( X > µ ) = 0.5

As curvas em forma de sino diferem apenas pelos valores de µ , centro da distribuição, e de

σ , variabilidade dos valores de X relativamente à média.

Geometricamente, a probabilidade da variável aleatória X, de média 0 e variância 1, assumir

valores no intervalo ]-1,96; 1,96[ é dada pela região a

sombreado na figura:

Para esta variável, existe uma tabela que fornece os valores

de probabilidade em intervalos sucessivos e de amplitude

suficientemente pequena de modo a que a aproximação a

efectuar no encontro da área apropriada é bastante boa.

MAS…há uma infinidade de curvas, consoante µ e σ . Nos restantes casos utiliza-se

P ( a < X < b) = ∫

b

a

1

2π σ

e

−

1

2

x−µ

σ

2

23

Engenharia Biomédica

Necessidade de padronizar: Z =

X −µ

σ

: Z é N(0,1)

A média amostral é uma das estatísticas mais importantes quer para a teoria da estimação quer

da decisão. Outra característica importante da distribuição de probabilidades é que, à medida

que a dimensão das amostras utilizadas para calcular a distribuição amostral da média

aumenta,

a

distribuição

da

média amostral

tende

para

a

distribuição

normal,

independentemente do tipo de distribuição da variável em estudo – teorema do limite central.

Ex.: Distribuição da média das classificações a uma cadeira de estatística em 100 amostras

aleatórias de dimensão n

Inicialmente, a distribuição era claramente assimétrica à direita, mas à medida que a dimensão

das amostras aumenta, o histograma das frequências de X vai assumindo a “forma de sino”

típica da distribuição normal.

24

BioEstatística

χ2(n)

Distribuição do Chi-quadrado

n

Uma variável aleatória X ( X = ∑ Z i ) obtida pela soma dos quadrados de n variáveis

2

i =1

aleatórias Z i ~ N (0,1) diz-se ter uma distribuição do tipo

χ2 com n graus de liberdade

A representação gráfica da função densidade de

probabilidade é a seguinte, para 2, 4, 8 e 22 graus de

liberdade. Note-se que, à medida que o número de graus

de liberdade aumenta, a curva vai-se tornando mais

parecida com a curva normal.

Distribuição t-Sudent

t(n)

Dadas Z ~ N (0,1) e Y~χ2(n) tais que Z e Y são

independentes,

a variável

X =

Z

Y

diz-se ter uma

n

distribuição t-Student com n graus de liberdade.

A

representação

gráfica

da

função

densidade

de

probabilidade é dada de seguida, para 3 e 6 graus de

liberdade.

Distribuição F-Snedecor

F(n1,n2)

Sejam Y1, χ2(n1) e Y2, χ2(n2) duas variáveis aleatórias e

Y1

X =

Y2

n1

. X diz-se ter uma distribuição F-Snedecor com

n2

n1 e n2 graus de liberdade. Na imagem seguinte

encontram-se representadas duas variáveis com (5,5)

graus de liberdade e (15,15) graus de liberdade.

25

Engenharia Biomédica

Distribuição Exponencial

E( 1 )

λ

Esta distribuição está associada a um processo de Poisson3, ou seja, a ocorrência de eventos

independentes a uma taxa constante, num intervalo de tempo ou numa região dos espaço, e

tem uma larga aplicação no estudo das filas de espera e da fiabilidade de sistemas complexos,

usando-se para representar o intervalo de tempo entre dois eventos. Tem-se:

5.2 Algumas distribuições de variáveis aleatórias discretas

Distribuição Discreta Uniforme

DU (i, j )

É a mais simples de todas as distribuições discretas. Caracteriza-se por:

todos os valores possíveis são equiprováveis:

Aplicam-se, assim, à ocorrência de fenómenos aleatórios igualmente prováveis, ou como

primeiro modelo para quantidades que variam entre i e j, mas acerca da qual pouco é sabido.

Distribuição Binomial

Β ( n, p )

Sequência de experiências com as seguintes características:

cada prova tem como resultado um de dois acontecimentos mutuamente exclusivos

(sucesso/insucesso)

a probabilidade de sucesso p permanece constante nas várias provas e a probabilidade de

insucesso é q = 1-p

as provas são independentes, ou seja, o resultado de cada uma não afecta o resultado das

restantes

3

Ver distribuição de Poisson (discreta)

26

BioEstatística

À semelhança da distribuição χ2(n) e da t-Student, o teorema do limite central assegura

também que a distribuição binomial se aproxima da distribuição normal para valores elevados

de n e valores de p que produzam uma distribuição simétrica.

0.1 < p < 0.9

Na prática, consideramos uma aproximação correcta para np > 5

nq > 5

A padronização da variável X, B(n,p), para a variável Z, N(0,1) obtém-se através da seguinte

transformação, aplicando a correcção de continuidade:

Z=

( X ± 0.5) − np

npq

µ = np

, dado que 2

σ = npq

P (λ )

Distribuição de Poisson

Associada a processos de contagens de um determinado número de eventos independentes, ao

longo do tempo ou numa região do espaço:

o número de eventos que ocorrem em dois intervalos disjuntos são independentes

a probabilidade de ocorrer exactamente um evento em qualquer intervalo de amplitude ∆t

arbitrariamente pequena é aproximadamente λ∆t

a probabilidade de ocorrerem dois ou mais eventos em qualquer intervalo de amplitude ∆t

arbitrariamente pequena é aproximadamente igual a zero.

Também a distribuição de Poisson

pode

ser

aproximada

distribuição

normal,

a

uma

uma

vez

que µ = σ 2 = λ , considerando que a

aproximação

é

correcta

p < 0.1 ∨ p > 0.9

quando

λ ≥ 5

A padronização da variável X, P (λ ) ,

para a variável Z, N(0,1) obtém-se

através da seguinte transformação:

Z=

( X ± 0.5) − λ

λ

27

Engenharia Biomédica

5.3 Relação entre as Distribuições Contínuas

5.4 Relação entre as Distribuições Discretas

28

BioEstatística

6. INTERVALOS DE CONFIANÇA E TESTES ESTATÍSTICOS EM POPULAÇÕES NORMAIS

6.1 Teoria da Estimação

A teoria da estimação tem como objectivo estimar parâmetros de uma população teórica a

partir de estatísticas obtidas numa amostra representativa dessa população.

Assim, se se extraírem n amostras de uma população cuja função densidade depende de um

parâmetro (por exemplo, a média) do qual se desconhece o verdadeiro valor, é necessário

estimá-lo, com um determinado grau de

Precisão - estimação por pontos

Confiança - estimação por intervalos

Fixada a dimensão da amostra, quanto mais precisa for a resposta, menor será a confiança

nela depositada.

Estimação por pontos:

x é o melhor estimador de µ

^

s=

n

× s é o melhor estimador de σ

n −1

Estimativa ≠ Estimador

Estimador ( θ ) é uma variável aleatória, função da amostra casual

^

Estimativa ( θ ) é o valor concreto do estimador para uma amostra em particular

Uma estimativa pontual de um parâmetro da população está fortemente dependente da

estimativa amostral. Se se extraírem n amostras da mesma população, é altamente improvável

obter amostras que tenham a mesma média amostral, ou seja, teria n estimativas diferentes da

média populacional. Dado que o valor da média populacional é único, uma estimativa pontual

pode ou não ser coincidente com o parâmetro populacional. Assim, este tipo de estimativa não

possui nenhum grau de certeza (ou incerteza) associado à estimativa obtida. A alternativa é

utilizar a estimação por intervalos.

Estimação por intervalos:

Há situações em que é preferível a estimação por intervalos. Esta pode obter-se associando

um determinado grau de confiança ao estimador pontual, uma vez conhecida a distribuição

amostral. Assim, em vez de propor uma estimativa isolada para um determinado parâmetro,

29

Engenharia Biomédica

faz-se acompanhar esta de um determinado intervalo (a, b) para significar que o verdadeiro

valor do parâmetro está, muito provavelmente, entre a e b. Ao associar um intervalo à

estimativa proposta, atribui-se ao mesmo intervalo um grau de confiança. Este intervalo pode

ser considerado uma medida da precisão ou do erro inerente à estimativa.

Normalmente, o que se pretende estimar é µ (média da população), σ 2 (variância da

população) ou π (proporção da população).

Tendo uma amostra particular, a partir da qual se determina a estimativa para um parâmetro

(ex: a média), o intervalo de confiança a (1-α)100% para µ , dado por (a, b), traduz o grau

de confiança que se tem em que uma particular amostra dê origem a um intervalo (a,b).

Incorrecto dizer que (1-α) é a probabilidade de θ ∈ (a, b) dado que os extremos do intervalo, a

e b, não são aleatórios.

6.2 Teoria da Decisão

A teoria da decisão, através dos testes de hipóteses, é uma outra forma de inferir sobre o

parâmetro da população, associando a este processo um determinado nível de significância

(α). Contrariamente aos intervalos de confiança, o teste de hipóteses tem como objectivo

refutar (ou não) uma determinada hipótese acerca de um ou mais parâmetros da população, a

partir de uma ou mais estimativas obtidas nas amostras.

Ex: Testar se, por hipótese, a média populacional é igual a um determinado valor, ou se a

média de uma população é superior à de outra, se a variância de 5 populações são iguais, etc.

30

BioEstatística

Considere-se uma população com uma determinada função de distribuição (F). Uma hipótese

estatística é qualquer conjectura sobre aspectos desconhecidos de F. Quando a forma da

função de distribuição ou da função densidade (função probabilidade) é conhecida, e a

conjectura diz respeito apenas ao parâmetro, tem-se uma hipótese paramétrica.

Ex: A conjectura “X é uma variável aleatória com distribuição normal” é uma hipótese

estatística não paramétrica. Caso se saiba que X segue uma distribuição normal, a conjectura

“ µ = 3, σ 2 = 1 ” corresponde a uma hipótese paramétrica.

Estas questões são formuladas sob a forma de hipóteses referentes ao(s) valor(es) do(s)

parâmetro(s) e referentes a alternativa caso se rejeite aquela hipótese. Assim, a hipótese

inicial, mais restritiva, designa-se por hipótese nula e representa-se por H0, representando-se

a hipótese alternativa por H1 ou Ha. A hipótese nula só deve ser rejeitada caso exista

evidência suficiente, a um nível significativo, que de facto H0 não é válida, ou seja, deve ser

defendida até a evidência mostrar o contrário, enquanto que a hipótese alternativa apenas é

adoptada se a hipótese nula for rejeitada.

Ex: A média dos efeitos de um determinado medicamento é nula

H 0 : µ = 0

Teste bilateral

H 1 : µ ≠ 0

H 0 : µ = 0

Teste unilateral à esquerda

H 1 : µ < 0

H 0 : µ = 0

Teste unilateral à direita

H 1 : µ > 0

Assim, considerando-se uma amostra casual da população, (X1,X2,…,Xn), com determinada

função densidade (probabilidade), o espaço-amostra é o conjunto de todas as amostras

particulares (x1,x2,…,xn). Um teste de hipóteses deve basear-se no comportamento

probabilístico de (X1,X2,…,Xn), no espaço-amostra, e estabelecer um critério para determinar

quais as amostras concretas (x1,x2,…,xn) que levam à rejeição da hipótese nula (e,

consequentemente, à aceitação da alternativa). Assim, um teste de hipóteses é uma regra que

permite especificar um subconjunto R do espaço-amostra tal que

31

Engenharia Biomédica

se (x1 , x 2 ,..., x n ) ∈ R ⇒ Re jeita − se H 0

(x1 , x 2 ,..., xn ) ∉ R ⇒ Aceita − se

H0

A este conjunto R chama-se região crítica ou região de rejeição de H0.

A definição desta região depende do tipo de teste escolhido. No caso de um teste bilateral,

tem-se

Por outro lado, se o teste é unilateral à esquerda, a região crítica é definida à esquerda da

média, enquanto que num teste unilateral à direita define-se a região de rejeição à direita da

média:

Ao proceder ao teste de H0 contra H1 podem ser cometidos dois tipos de erros:

O erro de 1ª espécie ou erro tipo I que consiste em rejeitar H0 quando esta é verdadeira

O erro de 2ª espécie ou erro tipo II que consiste em aceitar H0 quando esta é falsa

Decisão tomada

Rejeitar H0

Aceitar H0

32

H0 verdadeira

H0 falsa

Erro tipo I

Potência do teste

α = P (rejeitarH 0 / H 0 verdadeira)

1 − β = P(rejeitarH 0 / H 0 falsa )

Nível de confiança

Erro tipo II

1- α

β = P(aceitarH 0 / H 0 falsa )

BioEstatística

Por exemplo, seja H0: Inocente; H1: Culpado

Então α=P(enviar um inocente para a cadeia) e β=P(não prender um culpado)

α e β estão inversamente relacionados. Só aumentando n se reduz simultaneamente

ambos.

Quando se emprega o teste de nível de significância α, associado à região crítica R, e se

observa a amostra concreta (x1,x2,…,xn), pode ocorrer uma das duas situações seguintes:

(x1 , x2 ,..., xn ) ∉ R e não há motivo para rejeitar H0 ao nível de α100%

(x1 , x2 ,..., xn ) ∈ R e deve rejeitar-se H0 ao nível de α100%

Passos de um teste estatístico

Identificação do tipo de distribuição amostral

Formulação das hipóteses a testar

Definição do nível de significância

Definição da região crítica ou região de rejeição de H0

Calculo da estatística do teste (VC), sob H0

Decisão estatística

Ao menor valor de α a partir do qual se rejeita H0 chama-se probabilidade de significância

ou, mais simplesmente, valor-p. O teste de hipóteses permite obter a probabilidade de, em

qualquer experiência, ser encontrado o valor observado nesta amostra ou outro valor mais

extremo, sendo a hipótese nula verdadeira. Designando esta probabilidade por p:

p = prob(|valor| ≥ valor observado | H0)

Este valor representa uma medida complementar do grau de certeza a partir do qual

assumimos como real o resultado da estatística amostral dado que é a probabilidade de obter

este ou outro valor mais desfavorável para a hipótese nula, admitindo que esta hipótese é

verdadeira. Assim, o valor-p é uma medida da evidência que os dados fornecem a favor de H0.

Normalmente, situa-se o valor-p relativamente aos níveis de significância mais habituais

(0.05, 0.01), fixados previamente ao estudo, donde deve rejeitar-se a hipótese nula sempre que

se tem p<α. Por exemplo, se 0.01 < p < 0.05 ⇒ a evidência contra H0 não é significativa ao

nível de 0.01 (1%) mas já o é ao nível de 0.05 (5%), ou deve rejeitar-se H0 ao nível de 5%

33

Engenharia Biomédica

mas não de 1%, ou seja, quanto menor for p menor é a consistência dos dados com a hipótese

a testar (H0). Abaixo de determinados valores ou limiares de significância (0,05 ou 0,01)

dizemos que existe forte evidência contra esta hipótese (H0) que por isso deve ser rejeitada.

Passos de um teste estatístico com recurso a uma aplicação estatística (ex: SPSS)

Identificação do tipo de distribuição amostral

Formulação das hipóteses a testar

Definição do nível de significância

Cálculo do valor-p, sob H0

Decisão estatística

O problema que agora se coloca é saber a que nível de significância deve ser rejeitada H0.

Suponha que com determinada amostra é encontrado o valor p=0,03. Deve ou não rejeitar H0?

Estando este valor p compreendido entre os limiares de significância (ou níveis de

significância habitualmente considerados) 0,01 e 0,05 há autores que diriam ser de rejeitar ao

nível de significância de 5% mas não ao de 1%.

Outros autores consideram apenas a comparação do valor p observado com o nível de

significância estabelecido antes do estudo, dependente do critério do investigador. Se, por

exemplo, o nível fixado foi de 5%, dir-se-ia apenas que sendo p<0,05 rejeita-se H0 ao nível de

significância de 5%. Se o nível fixado foi de 1%, dir-se-ia que sendo p>0,01 não pode

rejeitar-se H0 ao nível de significância de 1%.

6.3 Intervalos de Confiança versus Testes de Hipóteses

Ambos são métodos de inferência estatística que têm associado uma determinada

probabilidade de erro;

Pode utilizar-se um intervalo de confiança a (1-α)100% para concluir acerca da rejeição

ou não de H0 num teste de hipóteses bilateral para um nível de significância α.

Qual dos métodos usar?

Depende dos objectivos do estudo… em ensaios clínicos, pretende-se geralmente demonstrar

a eficácia (ou não) de um determinado tratamento ou medicamento. Se o tratamento tiver um

34

BioEstatística

efeito significativo, então a média das variações da variável sob estudo será

significativamente diferente de 0, isto é, pretendemos rejeitar H 0 : µ = 0 em favor de

H 1 : µ ≠ 0 , independentemente da magnitude de µ , sendo este tipo de inferência requerido

para publicação do estudo em revista científica.

Contudo, para o gestor do produto (medicamento), o intervalo de confiança para a média das

variações tem mais interesse, pois o gestor poderá concluir acerca da dimensão e credibilidade

do efeito do medicamento, o que será de maior peso em decisões administrativas do que o

facto do efeito médio ser (ou não) diferente de zero.

Pense no seguinte exemplo:

Uma companhia produtora de baterias para pacemakers garante que a vida média de cada

bateria é de, pelo menos, 3 anos. Se a data de operação cirúrgica, para substituição da bateria,

se basear na garantia do fabricante:

Como explicaria ao gestor da companhia as consequências do erro tipo I e erro tipo II?

Preferia utilizar um teste estatístico para averiguar se a vida média de cada bateria é, de

facto, 3 anos, ou utilizaria um Intervalo de Confiança? Porquê?

35

Engenharia Biomédica

7. POPULAÇÕES NORMAIS

7.1 Intervalo de Confiança e teste t de Student

H 0 : µ = 0

Normalmente, quando se está a fazer um teste à média ( teste bilateral :

) ou a

H 1 : µ ≠ 0

determinar um intervalo de confiança para a média populacional ( µ ), não se conhece a

^2

variância da população ( σ 2 ). Assim, utiliza-se s =

a variável aleatória Z ( Z =

X −µ

σ

n

n

× s 2 como estimador de σ 2 , donde

n −1

~ N (0,1) ) deixa de poder ser utilizada uma vez que, para

além µ , se desconhece σ (parâmetro perturbador).

A variável que passa a ter condições para ser utilizada na determinação do intervalo de

confiança para µ ou na realização do teste estatístico é T =

X −µ

^

s

~ t (n − 1) .

n

O intervalo de confiança é dado por

( x − tα 2

^

^

s

s

n

; x + tα 2

n

) , com tα 2 a verificar P(T> tα 2 ) =

α

2

Dado que esta variável aleatória (T) tem, também, uma distribuição simétrica relativamente à

origem, tem-se que a amplitude do intervalo varia de amostra para amostra, já que depende de

^

s e da dimensão da amostra.

Pense nos seguintes casos:

O que acontece ao intervalo de confiança quando aumenta o nível de confiança?

Se a variância da amostra aumentar para o dobro, o que acontece à amplitude do intervalo

de confiança?

Se a amostra passar a ter mais 100 casos, com valores iguais à média amostra, o que

acontece ao intervalo de confiança?

O que pode fazer se quiser reduzir para metade a amplitude de um intervalo de confiança?

36

BioEstatística

7.1.1 Duas Amostras emparelhadas

Neste caso, o intervalo de confiança pode ser determinado, baseando-nos na média das

diferenças de cada uma das variáveis. Constrói-se a variável Diferença, e determina-se o

Intervalo de Confiança para a nova variável. Para a realização do teste estatístico, procede-se

da mesma forma. Contudo, as aplicações estatísticas fazem-no automaticamente.

H 0 : µ Dif = 0

H 0 : µ Antes − µ Depois = 0

H 0 : µ Antes = µ Depois

teste bilateral :

⇔

⇔

H 1 : µ Dif ≠ 0

H 1 : µ Antes − µ Depois ≠ 0

H 1 : µ Antes ≠ µ Depois

Exemplo 1: Deseja-se saber se um programa de reabilitação após enfarte de miocárdio

diminui a frequência cardíaca de esforço. Para tal, 10 doentes com enfarte do miocárdio foram

submetidos a uma prova de esforço antes e depois do programa. Os resultados, expressos em

batimentos por minuto, estão no quadro seguinte. Indique se o programa de reabilitação foi

eficaz.

Doente

1

2

3

4

5

6

7

8

9

10

x

s

Antes

Depois

Dif.

147

132

15

122

117

5

127

142

-15

141

125

16

150

116

34

132

130

2

157

122

35

147

118

29

157

135

18

155

117

38

143.5

125.4

18.1

12.63

8.99

17.03

160

s

n

4.00

2.84

5.38

40,00

150

30,00

95% CI

95% CI fc

140

20,00

130

10,00

120

110

0,00

Antes

Depois

Média das diferenças: frequência cardíaca

Exemplo 2: Foi estudado o grau de satisfação (medido por questionário) de vários utentes de

uma clínica dentária antes e depois de lhes ser aplicada uma nova prótese total removível. Os

resultados, expressos em score de satisfação, foram os apresentados de seguida. Supondo que

os scores seguem uma distribuição normal, indique se aplicação da nova prótese influenciou o

grau de satisfação dos utentes.

Doente

1

2

3

4

5

6

7

8

x

s

Antes

Depois

Dif.

4

4

0

10

16

-6

8

11

-3

13

17

-4

7

17

-10

3

4

-1

15

18

-3

7

11

-4

8.38

12.25

-3,88

4.14

5.75

3,09

s

n

1.46

2.03

1.09

37

Engenharia Biomédica

0,00

17,5

15,0

-2,00

95% CI

95% CI p

12,5

10,0

7,5

-4,00

-6,00

5,0

-8,00

Antes

Depois

Média das diferenças: Satisfação Prótese

7.1.2 Duas Amostras independentes

Neste caso, não é possível construir o intervalo de confiança fazendo a média das diferenças,

uma vez que cada indivíduo não tem um par de observações (tem-se a diferença de médias). O

mesmo se passa com o teste estatístico. Eventualmente, poderão existir grupos de dimensões

diferentes…

H 0 : µ A − µ B = 0

H 0 : µ A = µ B

teste bilateral :

⇔

H 1 : µ A − µ B ≠ 0

H 1 : µ A ≠ µ B

Por outro lado, o que acontece se a variabilidade de cada grupo é diferente? Serão as médias

de dois grupos com variabilidade diferente comparáveis?

O teste de Levene (1960) é um dos testes mais potentes para testar a homogeneidade das

variâncias e é automaticamente efectuado pelo SPSS quando se efectua um teste t para

amostras independentes, sendo o intervalo de confiança determinado com base no resultado

daquele. As hipóteses estatísticas são as seguintes:

H 0 : σ A 2 = σ B 2

H 1 : σ A 2 ≠ σ B 2

No caso de se desconhecer a variância populacional, a variável T tem condições para se

definir como variável fulcral, ficando o Intervalo de Confiança definido por

(( x A − x B ) − tα 2 s * ; ( x A − x B ) + tα 2 s * ) , e P(T> tα 2 ) =

α

2

com s * dado computacionalmente por uma qualquer aplicação estatística (SPSS).

38

BioEstatística

Exemplo 1: Foi efectuado um estudo sobre o índice de massa corporal consoante o escalão

etário, em 16 estudantes do ensino superior, tendo-se obtido os seguintes dados:

Idade

17-19

20-22

IMC

20,8

21,1

19,6

15,1

39

8,7

30,3

17,7

29,1

13,3

15,4

18,2

30,7

20,6

27

15,7

x

s

26.49

16.30

7.55

4.06

Observe agora os resultados obtidos no SPSS. O que conclui?

Levene's Test

F

IMC

Equal variances

assumed

2,82

Sig.

,115

Equal variances

not assumed

t-test for Equality of Means

T

Sig.

(2-tailed)

df

Mean

Difference

Std. Error

Difference

95% Confidence Interval

of the Difference

Lower

Upper

3,36

14

,005

10,18750

3,03053

3,68767

16,68733

3,36

10,7

,007

10,18750

3,03053

3,49811

16,87689

Pelo teste de Levene pode-se assumir a

30,00

A leitura do teste t de Student para amostras

independentes e do Intervalo de confiança

95% CI IMC

igualdade de variâncias.

25,00

20,00

para a diferença de médias é feita, assim, na 1ª

linha da tabela de resultados, ou pelo gráfico

15,00

seguinte:

17-19

20-22

Escalão etário

Exemplo 2: Verificou-se ter havido um erro na introdução dos dados (IMC=8,7), pelo que

esse indivíduo será eliminado da amostra.

Suponha ainda que os critérios de inclusão/exclusão do estudo exigiam que os sujeitos

tivessem IMC entre 15 e 30, pelo que se excluíam 3 sujeitos no escalão dos 17-19 anos, e 2 do

outro grupo. Os resultados seriam os seguintes:

Levene's Test

F

IMC

Equal variances

assumed

Equal variances

not assumed

5,49

Sig.

,044

t-test for Equality of Means

T

Sig.

(2-tailed)

df

Mean

Difference

Std. Error

Difference

95% Confidence Interval

of the Difference

Lower

Upper

1,71

9

,121

4,31333

2,51796

-1,38269

10,00936

1,59

5,28

,168

4,31333

2,69781

-2,51350

11,14016

39

Engenharia Biomédica

Neste caso, não há homogeneidade de variância pelo que os resultados do teste t de Student

para amostras independentes têm de ser lidos na segunda linha, ou visualizados no gráfico que

se segue:

30,00

28,00

95% CI IMC 15-30

26,00

24,00

22,00

20,00

18,00

16,00

17-19

20-22

Escalão etário

7.2 K Populações Normais e Independentes (k>2): ANOVA

Uma das aplicações da Análise de Variância (ANOVA) é a comparação entre médias de m

populações normais, ou seja, testar a hipótese

H 0 : µ1 = µ 2 = ... = µ m

H 1 : ∃i, j ∈ {1,2,..., m}, i ≠ j : µ i ≠ µ j

A primeira hipótese que provavelmente colocaria seria comparar as médias duas a duas

através de um teste t-Student… Este procedimento, ainda que possível, não é válido, dado que

a estatística e o valor crítico deste teste só são válidos para comparar médias de 2, e apenas 2

populações, a partir das quais se extraíram duas amostras aleatórias.

De facto, enquanto que no teste a duas populações o erro tipo I não será superior a α × 100% ,

utilizando esse mesmo teste para comparar mais m populações, duas a duas, ter-se-ia um erro

tipo I aproximadamente de 1 − (1 − α ) m × 100% . Por exemplo, em 3 populações, para

α = 0.05 , a probabilidade de um erro tipo I, ou seja, de concluir erradamente que existe

diferença entre as 3 populações é de 14.3%.

Assim, é necessário avaliar a forma como as m populações são definidas, com base num ou

mais critérios (ou factores) e a variabilidade patenteada pelas amostras de cada uma das

populações.

40

BioEstatística

Por exemplo, suponha que queria testar a igualdade da média em 3 populações (A, B e C), e

considerem-se as duas situações apresentadas na imagem seguinte, onde se podem observar 5

observações amostrais de cada uma das 3 populações:

Note-se que as médias amostrais relativas às várias populações são iguais nas duas situações.

Contudo, intuitivamente os gráficos sugerem conclusões diferentes; enquanto que no primeiro

caso se tende a rejeitar quase de imediato a hipótese de igualdade de médias, no segundo caso

a tendência é para aceitar, com alguma facilidade, a hipótese de igualdade de médias.

Assim, a variabilidade dos dados relativos a cada população é um aspecto fundamental a ter

em conta no teste de hipóteses de igualdade de médias.

Se a variabilidade em torno de cada uma das médias amostrais é grande,

comparativamente com a variabilidade entre as médias amostrais (2º caso), tende-se a

não rejeitar a hipótese nula;

Assim, parece aceitável fundamentar o teste de hipóteses na comparação entre estas

variabilidades ⇒ Análise de Variância (ANalysis Of VAriance).

41

Engenharia Biomédica

A ANOVA é relativamente robusta a desvios à normalidade desde que o número de

elementos em cada grupo seja relativamente grande, sendo que a não normalidade tem

consequência mínimas na interpretação dos resultados quando a distribuição não é muito

enviezada.

A distribuição F, na qual se baseia a ANOVA, é também robusta a violações da

homocedasticidade (homogeneidade de variâncias entre os grupos) desde que o número de

observações em cada grupo seja aproximadamente igual, considerando-se que os grupos são

de dimensão semelhante quando o quociente entre a dimensão do maior grupo e do menor for

inferior a 1,5.

7.2.1 ANOVA a 1 factor

A definição das m populações é feita com base num critério ou factor (por exemplo, definemse 3 populações segundo os escalões etários [20, 30[, [30, 40[, [40, 50[).

Caso se rejeite a hipótese H0 de igualdade de médias, conclui-se, para um determinado nível

de significância α, que as m populações não apresentam comportamento idêntico perante o

critério ou factor que serviu para efectuar a classificação. Contudo, só é legítimo considerar

este factor a causa das diferenças entre as médias das populações se se puder garantir a

homogeneidade das populações relativamente a todos os outros factores que podiam ser

relevantes para a explicação do fenómeno.

Sejam X i1 , X i 2 ,..., X ini , i = 1,2,..., m m amostras causais independentes com distribuição

normal de média desconhecida e variância comum desconhecida, isto é,

X ij ~ N ( µ i , σ 2 ), j = 1,2,..., ni , i = 1,2,..., m

Assim, X ij = µ + α i + ε ij , ε ij ~ N (0, σ 2 ) , o que implica que µ i = µ + α i

Valor Observado = Média Geral + Efeito do nível i do factor + Variável Residual

Baseado no modelo teórico da ANOVA para a população, é possível escrever o modelo a

partir das observações amostrais:

(

)

xij = x + x i − x + ( xij − x i )

Observação ij

Média amostral (estimativa de µ)

42

Efeito do nível i do factor

Resíduos

BioEstatística

O cálculo da estatística teste para a ANOVA requer o conhecimento das estimativas da

variabilidade dentro dos grupos (isto é, a variação residual ou dos erros de medida), estimada

a partir de ( xij − x i ) e da variabilidade entre as amostras (variação factorial, devida ao factor)

(

)

que pode ser estimada a partir de x i − x . Em ambos os casos, determinam-se as somas dos

quadrados:

m

ni

(

SQD = ∑∑ X ij − X i

i =1 j =1

m

(

) =∑ (n

2

i =1

SQE = ∑ ni X i − X

i =1

^2

m

i

− 1) s i

)

2

Sendo assim, é possível obter uma estimativa da variabilidade total, dada por

Soma Quadrados Total = Soma Quadrados Dentro Amostras + Soma Quadrados Entre Amostras

A estatística teste da ANOVA é dada pela razão entre a variância do factor (ou entre as

amostras, estimada a partir de

SQE

), e a variância dos erros (ou dentro das amostras,

m −1

SQE

(m − 1)

SQD

), ou seja, a partir da variável F =

~ F (m − 1, n − m) .

estimada a partir de

SQD

n−m

( n − m)

Fonte de Variação

Entre Amostras

Dentro das

amostras

Total

Soma dos

Graus de

Quadrados

Liberdade

SQE

m-1

MQE = SQE (m − 1)

SQD

n-m

MQD = SQD (n − m)

SQT

n-1

Médias Quadráticas

F

F = MQE MQD

Este procedimento permite testar a existência de diferenças estatisticamente significativas

entre as médias das m populações.

Quando se conclui que tais diferenças existem é interessante qualificá-las, através:

43

Engenharia Biomédica

Do cálculo do intervalo de confiança para a média de cada população, usando a

MQD

MQD

distribuição t-Student com n-m graus de liberdade: x i 0 − tα / 2

, x i 0 + tα / 2

ni

ni

No SPSS, efectuam-se comparações múltiplas das médias usando as comparações PostHoc através dos testes de Tuckey, Fisher-LSD, Scheffé ou Bonferroni, entre outros.

O teste de Tuckey é um dos mais robustos a desvios à normalidade e homogeneidade de

variâncias para amostras grandes, enquanto que em amostras pequenas, o teste de

Bonferroni é um dos mais potentes.

Quando se compara um número reduzido de grupos, muitas vezes opta-se por testes mais

simples, como os de Fisher-LSD ou de Scheffé.

É possível, ainda que pouco provável, que a ANOVA e os testes de comparações

múltiplas cheguem a conclusões diferentes, isto é, pode rejeitar-se H0 na ANOVA, sem

que um teste para comparações múltiplas detecte a diferença entre pares de médias… Tal

deve-se ao facto de a ANOVA ser um teste mais potente (ou seja, onde a probabilidade de

rejeitar H0 correctamente é mais elevada), enquanto que os testes para comparações

múltiplas têm associado maiores probabilidades de erro tipo II) ⇒ repetição do estudo

com amostras de maior dimensão de modo a reduzir a probabilidade de erro tipo II.

Outra hipótese é realizar comparações à priori, ou seja, comparações planeadas,

usando contrastes. Estas comparações são mais potentes do que testes post-hoc, uma vez

que, de facto, serão testes t de Student que serão efectuados, mas exigem que a decisão

acerca das condições de interesse a testar sejam tomada à priori, daí serem menos

utilizados.

Os coeficientes do contraste são números positivos ou negativos (eventualmente nulos)

que definem as hipóteses a serem testadas, testando relações específicas entre grupos

através de uma combinação linear das médias cuja soma dos coeficientes se anula.

Por exemplo, se houver 5 grupos e pretender comparar os grupos 1 e 3 com o grupo 4,

basta definir os coeficientes do contraste como, por exemplo, 1, 0, 1, -2, 0; se quiser

comparar os grupos 1, 2 e 3 com o grupo 4 e 5 utiliza-se, por exemplo, 1, 1, 1, -1.5, -1.5.

44

BioEstatística

Exemplo 1: ANOVA a 1 factor ordinal.

Neste caso (factor ordinal), é possível fazer uma análise de

tendência. Suponha que as notas de Bioestatística da

Licenciatura de Medinina Dentária da UC, no ano lectivo de

2006/2007, foram as apresentadas no quadro seguinte,

consoante as condições motivacionais dos alunos.

Será a motivação um factor de diferenciação das notas nesta

disciplina?

Em caso afirmativo, quais os grupos com diferença

significativa?

Apresente um gráfico que lhe permita avaliar alguma

tendência.

Baixa

14

15

9

15

15

10

11

11

10

14

16

11

15

12

12

14

13

10

Média

12

11

14

13

16

15

13

14

13

12

13

14

13

15

16

14

13

13

Alta

17

16

16

18

16

17

14

15

16

12

18

13

18

14

16

17

15

17

Exemplo 2: ANOVA a 1 factor nominal

No quadro seguinte apresentam-se o número de acidentes segundo o tipo de bebida alcoólica

consumido pelo condutor, nas duas horas anteriores ao acidente.

Bebida

1

1

1

1

1

1

1

1

1

1

Acidentes

5

4

4

5

5

6

6

4

4

5

Bebida

2

2

2

2

2

2

2

2

2

2

Acidentes

6

5

3

5

4

4

4

4

4

2

Bebida

3

3

3

3

3

3

3

3

3

3

Acidentes

2

2

3

3

1

2

2

4

3

2

Bebida

4

4

4

4

4

4

4

4

4

4

Acidentes

2

1

2

1

2

2

3

2

3

4

Bebidas: 1 = Aguardente; 2 = Vinho; 3 = Cerveja; 4 = Não bebe

Verifique se existe diferença estatisticamente significativa no número de acidentes, consoante

o tipo de bebida ingerida. Em caso afirmativo, identifique as diferenças através do teste de

Tuckey.

Indique ainda o que significam os contrastes seguintes, efectue-os e conclua:

a) 1/3 aguardente + 1/3 vinho + 1/3 cerveja – 1 Não bebem

b) 0,5 aguardente + 0,5 vinho – 0,5 cerveja – 0,5 não bebem

45

Engenharia Biomédica

7.2.2 Exemplos de outras Análises de Variância

ANOVA a mais do que 1 factor - 2 factores fixos

Amostra aleatória de 30 mães, tendo-se seleccionado aleatoriamente 5 por cada categoria de

parto e por continente de origem. Avaliar o efeito da origem (asiática, europeia, africana) e do

Distócico

Eutócico

tipo de parto (eutócico, distócico) no peso dos recém-nascidos.

Asiática

2.9

3.3

2.7

2.8

3.2

2.9

3.3

3.1

3

3.2

Europeia

3.5

3.4

3.3

3.4

3.3

3.9

4.1

4

4

3.9

Africana

2.1

2.2

2.3

2.4

2.3

2

2.3

2.2

2.1

2

ANOVA a mais do que 1 factor - modelo aleatório: factores aleatórios – não tinha escolhido o

continente onde seriam seleccionadas as mães, nem tipo de parto, mas tinha seleccionado

aleatoriamente

ANOVA a mais do que 1 factor - efeitos mistos: inclui factores fixos, aleatórios, e variáveis

concomitantes

ANCOVA – ANalysis OF COVAriance

Avaliar a relação entre o tipo de acompanhamento que as crianças tiveram até aos 5 anos de

idade (infância) e as notas de matemática.

É lógico que crianças com maior QI tendam a originar melhores notas a matemática

- factor infância tem 3 níveis: 1 = jardim-infância; 2 = casa; 3 = ama

– QI é variável concomitante

Infância

1

1

1

1

1

1

1

46

QI

105.7

100.3

94.3

108.7

93.1

96.7

106.9

Notas

15.526

14.826

13.44

15.645

11.586

11.53

16.66

Infância

2

2

2

2

2

2

2

QI

100.3

86.5

96.1

101.2

97.6

96.4

109.6

Notas

14.78

9.18

12.966

12.82

8.734

10.08

16.868

Infância

3

3

3

3

3

3

3

QI

94

112

112

100

103

112

112

Notas

9

14

14

9

14

14

14

BioEstatística

MANOVA (Multiple ANalysis OF Variance) e MANCOVA (Multiple ANalysis OF COVariance)

A análise de variância multivariada (MANOVA) é um teste mais potente do que a realização

de várias análises de variância, quando se têm várias variáveis dependentes relacionadas. A

realização de várias ANOVS’s assenta no pressuposto que as várias variáveis dependentes

eram ortogonais, ou seja, independentes. De facto, em muitos casos, a MANOVA detecta

diferenças que não seriam detectadas por múltiplas ANOVAs, assim como a ANOVA pode

detectar diferenças não detectáveis pelos testes post-hoc.

Para ilustrar este facto, pode observar-se a figura seguinte, onde é visível a diferença existente

entre os dois grupos de pontos (escuros e claros), mas quando as funções densidade são

projectadas em cada um dos eixos, ou seja, em cada uma das variáveis, as diferenças já não

são aparentes:

Na MANOVA, as variáveis dependentes são consideradas em simultâneo, organizadas de

forma composta e com os efeitos associados a cada variável ponderados pela correlação

existente entre ambas, de forma a que o erro tipo I permaneça igual a α, uma vez que o erro

tipo I através de ANOVAs sucessivas em k amostras é igual a kα.

47

Engenharia Biomédica

7.3 Correlação linear

Quando se pretende estudar a relação ou associação entre 2 variáveis quantitativas aleatórias

X e Y, e sendo ambas provenientes de populações normais, determina-se o coeficiente de

correlação r de Pearson, coeficiente este que varia entre -1...0...1 e é dado por

r=

cov xy

sx × s y

=

∑ [(x − x )× (y − y )]

∑ (x − x ) × ∑ (y − y )

i

i

2

2

i

i

O coeficiente de correlação r mede a força da associação entre as variáveis e o teste que lhe

está associado ( t o =

r

1− r 2

n − 2 ~ t (n − 2) ) tem como hipóteses:

H 0 : Não existe relação linear entre X e Y (r = 0)

H 1 : X e Y estão linearmente relacionadas (r ≠ 0)

Sempre que existe uma correlação estatisticamente significativa, é interessante avaliar o sinal

de r, dado que este indica o sentido da relação (Note-se que a significância estatística de r=0.7

ou r=-0.7 é a mesma, o que muda é o sentido da relação). Graficamente, através de um

diagrama de dispersão, pode observar-se uma tendência crescente ou decrescente consoante o

valor do coeficiente de correlação é positivo ou negativo.

1.00

Fracção de Sobrevivência

0.80

0.60

0.40

0.20

0.00

0.00

200.00

400.00

Dose

r>0

r<0

Normalmente há vantagem em ser efectuada uma análise de regressão em vez da correlação

simples, sendo necessário ter uma variável dependente e outra independente. Em termos

laboratoriais podemos dizer que uma das variáveis é manipulada pelo investigador enquanto

na outra são medidos os valores obtidos.

48

BioEstatística

7.4 Análise de Regressão Linear Simples

A regressão linear simples é um método para estudar a relação entre 2 variáveis quantitativas,

normalmente distribuídas, com o objectivo de estimar uma variável Y em função da outra X,

ou seja, de estudar como modificações numa variável independente produzem modificações

noutra variável dependente.

À equação que traduz a função y de x dá-se o nome de curva de regressão de y sobre x. Se

for uma regressão linear, tem-se uma recta: y* = a + bx

O coeficiente a é designado por intersecção ou ordenada na origem, e o coeficiente b por

inclinação ou declive da recta de regressão de y sobre x.

Contudo, nem todos os pontos do diagrama de dispersão4 ficam sobre a recta5, ou seja, nem

sempre y coincide com y*. Isto significa que nem toda a variabilidade de y é explicada pela

regressão; parte da variabilidade de y não é explicada pela regressão - é a variabilidade

residual devida a outros factores ou ao erro ou resíduo: ε=y*-y.

Se esta variabilidade residual for devida a erros casuais não tem uma magnitude significativa

relativamente à variabilidade devida à regressão (tem-se, normalmente, ε = 0 ).

O objectivo é encontrar os valores de a e b que melhor traduzem a recta de regressão, ou seja,

que minimizam os erros cometidos entre o valor y* previsto pela recta e o seu valor

( )

observado y, e de tal forma que x, y seja um ponto dessa recta.

7.4.1 Determinação dos coeficientes da recta de regressão