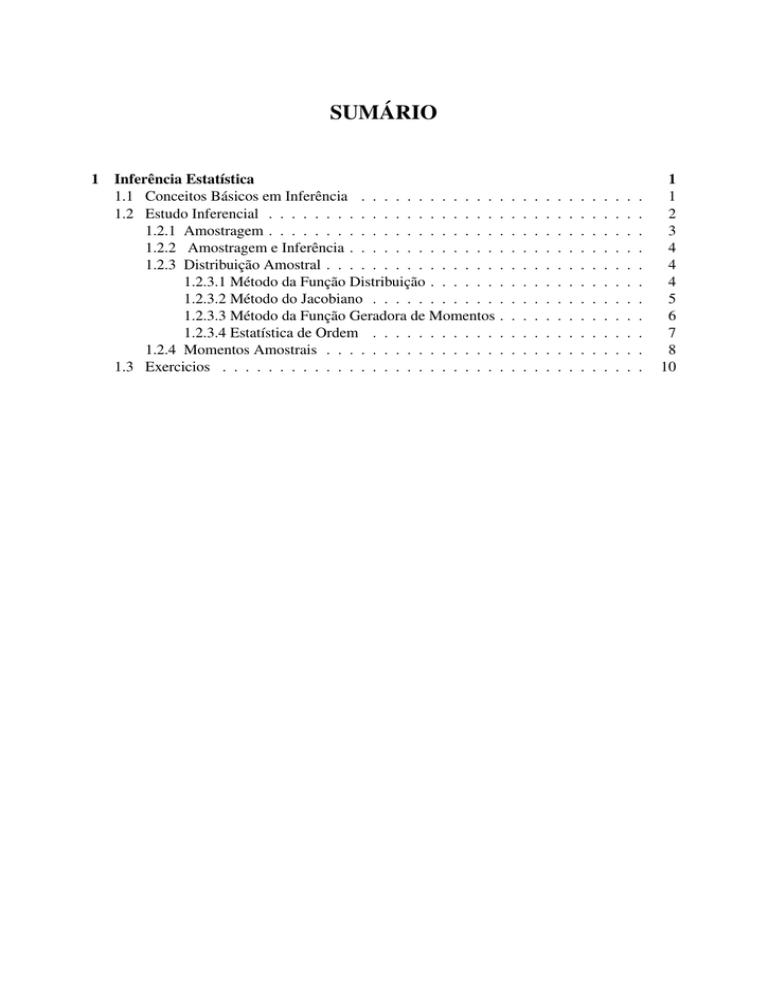

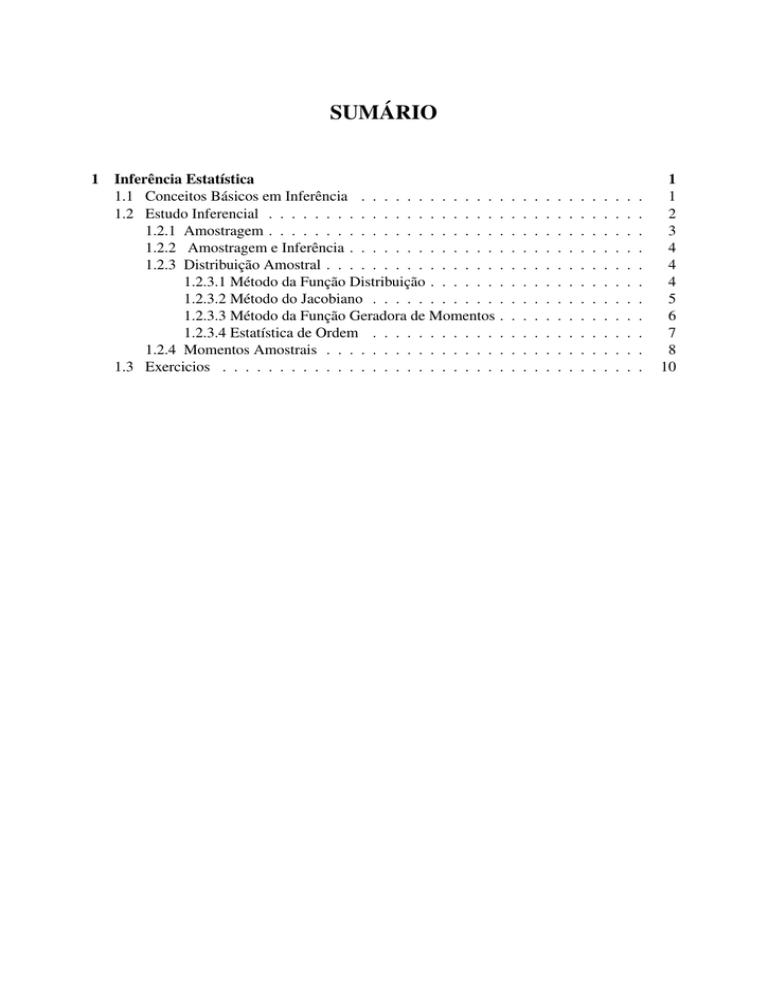

SUMÁRIO

1

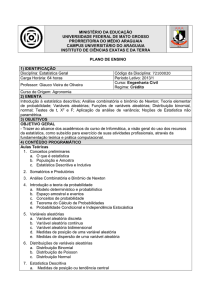

Inferência Estatística

1.1 Conceitos Básicos em Inferência . . . . . . . . . . . .

1.2 Estudo Inferencial . . . . . . . . . . . . . . . . . . . .

1.2.1 Amostragem . . . . . . . . . . . . . . . . . . . .

1.2.2 Amostragem e Inferência . . . . . . . . . . . . .

1.2.3 Distribuição Amostral . . . . . . . . . . . . . . .

1.2.3.1 Método da Função Distribuição . . . . . .

1.2.3.2 Método do Jacobiano . . . . . . . . . . .

1.2.3.3 Método da Função Geradora de Momentos

1.2.3.4 Estatística de Ordem . . . . . . . . . . .

1.2.4 Momentos Amostrais . . . . . . . . . . . . . . .

1.3 Exercicios . . . . . . . . . . . . . . . . . . . . . . . .

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

.

1

1

2

3

4

4

4

5

6

7

8

10

1

INFERÊNCIA ESTATÍSTICA

Latim: INFERENTIA. Ato de inferir (tirar por conclusão). Admite-se uma proposição como

verdadeira, que não seja conhecida diretamente, através da relação dela com outras proposições

já sabidamente verdadeiras.

Inferência estatística é o processo pelo qual pode-se tirar conclusões acerca de um conjunto

maior (a população) usando informação de um conjunto menor (a amostra). O objetivo principal da Inferência estatística, é estimar os parâmetros populacionais (média, variância etc),

deduzidos a partir da estatística amostral correspondente.

Os procedimentos mais usuais para inferir algo sobre estes parâmetros são:

• Estimação pontual - o objetivo é encontrar os valores do parâmetro desconhecido.

• Estimação por intervalos- o objetivo é encontrar um intervalo que contenha o parâmetro

de interesse com uma probabilidade especificada.

• Testes de hipóteses- o objetivo é criar conjecturas sobre os valores possíveis do parâmetro

e verificar se, estas conjecturas, são muito ou pouco prováveis (isto é, testar as hipóteses).

Definição 1.1 (Inferência Estatística): Seja X uma variável aleatória com função de densidade de probabilidade (ou de probabilidade) que abreviamos por f.d.p (f.p) e denotamos por

f (x|θ ), em que θ é um parâmetro desconhecido. Chamamos de inferência estatística o problema que consiste em especificar um ou mais valores de θ , baseado em um conjunto de valores

de X

1.1

CONCEITOS BÁSICOS EM INFERÊNCIA

Definição 1.2 (População): O conjunto de valores de um característica (observável) associada a uma coleção de indivíduos ou objetos de interesse é dito população.

Definição 1.3 (Amostra Aleatória): Uma sequência X1 , ..., Xn de n variáveis aleatórias independentes e identicamente distribuídas (i.i.d.) com função de densidade (f.d.p.) ou, no caso

discreto, função de probabilidade (f.p.) f (x|θ ) é dita ser uma amostra aleatória de tamanho n

Inferência Estatística

2

da distribução de X. Nesse caso, temos,

n

f (x1 , ..., xn |θ ) = f (x1 |θ )... f (xn |θ ) = ∏ f (xi |θ )

i=1

Definição 1.4 (Espaço Parámetrico): O conjunto Θ em que θ toma valores é denominado

espaço paramétrico.

Exemplo 1.1: Sejam X1 , ..., Xn uma amostra aleatória da variável aleatória X ∼ N(µ, σ 2 ).

Assim,

Θ = {(µ, σ 2 )| − ∞ < µ < ∞, σ 2 > 0}

Definição 1.5 (Estatística): Qualquer função da amostra que não depende de parâmetros

desconhecidos é denominada uma estatística.

Definição 1.6 (Estimador): Qualquer estatística que assuma valores em Θ é um estimador

para θ .

Exemplo 1.2: Sejam X1 , ..., Xn uma amostra aleatória da variável aleatória X, com f.d.p. ou

f.p. f (x|θ ). A funções abaixo são estatísticas:

i) X(1) = min(X1 , ..., Xn )

ii) X(n) = max(X1 , ..., Xn )

iii) X =

1.2

∑ni=1 xi

n

ESTUDO INFERENCIAL

Para estudar alguma característica da população o ideal seria estudar cada indivíduo da

população. Entretanto entrar em contato com toda a população seria caro e demorado. A

amostragem torna-se uma boa alternativa para estudar alguma característica da população. Os

métodos inferências são baseado em amostras aleatórias.

Definição 1.7 (Pesquisa Estatística): É qualquer informação retirada de uma população ou

amostra, podendo ser através de Censo ou Amostragem

Definição 1.8 (Censo): Censo é atividade de inspecionar (observar) todos os elementos de

uma população, objetivando conhecer, com certeza suas características;

Definição 1.9 (Amostragem): Amostragem é o processo de obter informações dos "n"elementos

amostrais, no qual deve seguir um método criterioso e adequado (tipos de amostragem).

Inferência Estatística

3

Fases do Estudo Inferencial:

/

População

Parâmetros

Populacionais

1.2.1

o

Amostra

Inferência

Estatísticas

da Amostra

Amostragem

A amostragem é naturalmente usada em nossa vida diária. Exemplos:

• Para verificar o tempero de um alimento em preparação, podemos provar (observar) uma

pequena porção.

• Como o médico detecta as condições de um paciente através de um exame de sangue.

Amostragem é o processo de seleção de uma amostra, que possibilita o estudo das características da população. Os objetivos principais de amostragem são fornecer dados que permitam

fazer inferências para uma população com base na análise de uma amostra. Em se tratando de

amostra, a preocupação central é que ela seja representativa. Para obter informações através de

um levantamento amostral, temos imediatamente dois problemas:

• Definir cuidadosamente a população de interesse

• Selecionar a característica que iremos pesquisar.

Amostragem não-probabilísticas:

• Critério de escolha é definido pelo investigador

• Não permitem a inferência populacional (não-representativas)

• Não permitem a comprovação de hipóteses

Amostragem probabilísticas:

• Cada unidade amostral tem probabilidade igual de ser selecionada (base da amostra aleatória)

• Permitem a inferência populacional (representatividade populacional)

Amostragem não-probabilísticas:

• Amostra de conveniência

• Amostra intencional

Amostragem probabilísticas:

Inferência Estatística

4

• Amostra aleatória simples

• Amostra sistemática

• Amostra estratificada

• Amostra por conglomerados

1.2.2

Amostragem e Inferência

De uma dada população pode-se retirar muitas amostras:

• Amostra 1, Amostra 2,..., Amostra n

Entretanto quase sempre é recolhido só uma amostra para estudar uma característica X da

população. Em uma amostra pode-se obter n observações x1 , x2 , .., xn . Assim as observações

x1 , x2 , .., xn são realizações de n variáveis aleatória X1 , X2 , ..., Xn que são "cópias"da variável X.

Antes do processo de amostragem ser realizado temos n variáveis aleatórias X1 , X2 , ..., Xn .

Depois de efetuado a amostragem temos um conjunto de dados que constituem a amostra observada x1 , x2 , .., xn . Assim temos que as variáveis aleatórias X1 , X2 , ..., Xn são identicamente

distribuídas e possuem a mesma distribuição de probalidade da característica X em estudo da

população.

1.2.3

Distribuição Amostral

Definição 1.10 (Distribuição amostral): Sejam X1 , ..., Xn uma amostra aleatória da variável

aleatória X, com f.d.p. ou f.p. f (x|θ ) e seja T = T (X1 , ..., Xn ) uma estatística. A distribuição

de probabilidade de T é denominada distribuição amostral

Em geral, temos interesse em saber a distribuição amostral de um estimador. Isto é, dado

que θ̂ = T (X1 , ..., Xn ) é uma variável aleatória temos interesse em saber o comportamento deste

estimador para a população de todas as possíveis amostras aleatórias de um dado tamanho n.

A distribuição amostral de uma estatística T = T (X1 , ..., Xn ) pode ser definida a partir da

distribuição conjunta da amostra. Sendo X1 , X2 , ..., Xn uma amostra aleatória de uma população com função densidade de probabilidade ou função de probabilidade f (xi |θ ), a função de

distribuição conjunta, é definida:

n

f (x1 , x2 , ..., xn |θ ) = ∏ f (Xi |θ )

i=1

1.2.3.1

Método da Função Distribuição

Seja X uma variável aleatória, com função de distribuição FX (x). Qualquer função Y = g(X)

também é uma variável aleatória.

FY (y) = P(Y ≤ y) = P(g(X) ≤ y)

Inferência Estatística

5

Exemplo 1.3: Se X1 , ..., Xn uma amostra aleatória da variável aleatória X independente e

indenticamente distribuída, com função de densidade de probabilidade dada por:

f (x|θ ) = θ e−θ x , x > 0

Considerando a estatística T = min{X1 , ..., Xn }, temos que T ∼ exp(nθ )

FT (t) = P(T ≤ t) = P(min{X1 , ..., Xn } ≤ t) = 1 − P(min{X1 , ..., Xn } > t)

n

= 1 − ∏ P(Xi > t) = 1 − (P(Xi > t))n = 1 − (1 − FX (t))n

i=1

Como

f (x|θ ) = θ e−θ x

FX (x|θ ) = 1 − eθ x

FT (t) = 1 − (1 − FX (t))n

= 1 − enθt

Assim,

fT (t) = nθ enθt

1.2.3.2

Método do Jacobiano

Seja X1 , X2 , ..., Xn variáveis aleatórias contínuas com função de densidade f (xi |θ ) e sejam

Yi = gi (X1 , X2 , ..., Xn ) funções de variáveis aleatórias. Se a função gi é inversível e diferenciável,

então

fY (y1 , ..., yn ) = |J| fX (h1 (y1 , ..., yn ), ..., hm (y1 , ..., yn )) IY

em que:

• hi é a função inversa de gi , em que

xi = hi (y1 , ..., yn )

• J é o jacabiano, definido pelo determinante da matriz:

∂ x1

∂ y1

···

...

∂ x1

∂ yn

∂ xn

∂ y1

···

∂ xn

∂ yn

.

.

J = det

.

..

.

Inferência Estatística

6

Exemplo 1.4: Sejam X1 e X2 variáveis aleatórias exponencial com parâmetro θ , verifique

que Y = X1 + X2 tem distribuição gama 2 e θ .

Como Y = X1 + X2 e tomemos W = X1 , então X1 = W e X2 = Y −W , assim

"∂x

1

J = det

∂y

∂ x2

∂y

∂ x1

∂w

∂ x2

∂w

#

"

#

0 1

= det

= −1

1 −1

Como

f (x1 , x2 ) = θ 2 x1 x2 e−θ (x1 +x2 )

Assim

fY,W (y, w) = θ 2 (wy − w2 )e−θ (y)

Z∞

fY (y) =

θ 2 (wy − w2 )e−θ y dw

0

2 −θ y

Z∞

= θ e

2

(wy − w2 )dw

0

−θ y

= θ ye

1.2.3.3

Método da Função Geradora de Momentos

Teorema 1.1: Se as funções geradoras de momentos de duas variáveis aleatórias X e Y

são idênticas para todo t em um intervalo aberto contendo t = 0, então, as distribuições de

probabilidade de X e Y devem ser idênticas.

Assim, sejam X1 , X2 , ..., Xn variáveis aleatórias com fdp ou fp f (xi |θ ) e sejam Yi = gi (X1 , X2 , ..., Xn )

funções de variáveis aleatórias. Se existir a função geradora de momentos conjunta de Yi ,

mY (t1 , ...,tn ) = E et1Y1 +...tnYn

h

i

t1 g1 (X1 ,X2 ,...,Xn )+...tn gn (X1 ,X2 ,...,Xn )

= E e

Se a função geradora de momentos conjunto resultar em uma função geradora de momentos

de uma variável aleatória conhecida Wi então Yi tem a mesma distribuição de probabilidade de

Wi

Inferência Estatística

7

Exemplo 1.5: Sejam X1 , X2 , ..., Xn uma amostra aleatória da variável aleatória exponencial

n

(θ ) e seja a estatística Y = ∑ Xi , verique que Y ∼ Gama(n, θ )

i=1

" n #

"

#

n

t ∑ Xi

tY tX

mY (t) = E e = E e i=1

= E ∏e i

i=1

n

n

= ∏ E etXi = E etX

i=1

=

θ

θ −t

n

Como a função geradora de momentos de Y é igual a função geradora de momentos de uma

distribuição gama, temos que Y ∼ Gama(n, θ )

1.2.3.4

Estatística de Ordem

Definição 1.11 (Estatística de Ordem): Seja X1 , X2 , ..., Xn uma amostra aleatória de tamanho n. As variáveis Xi , com i = 1, ..., n, ordenadas em ordem crescente, são denominadas

estatísticas de ordem e são representadas por

X(1) ≤ X(2) ≤ X(3) ≤ ... ≤ X(n)

;

Ao estudar estatística de ordem o interesse compreender como uma estatística única ordem

é distribuída, por exemplo, mínimo, máximo, mediana da amostra, etc. Além disso, podese querer derivar a distribuição de uma função de estatísticas de ordem, por exemplo, R =

X(n) − X(1) , a faixa de amostra.

Teorema 1.2: Seja X1 , X2 , ..., Xn uma amostra aleatória de tamanho n com função de distribuição F(x), e seja X(1) , X(2) , ..., X(n) a estatísticas de ordem da amostra. Então a distribuição

acumulada marginal é dada por

n

n

FX( j) (x) = ∑

F(x)k (1 − F(x))n−k

k= j k

Corolário 1.1: Sejam X(1) = min(X1 , X2 , ..., Xn ) e X(n) = max(X1 , X2 , ..., Xn ) estatísticas de

ordem do mínimo e do máximo, então suas distribuições acumuladas marginal

FX(1) (x) = 1 − (1 − F(x))n

FX(n) (x) = (F(x))n

Inferência Estatística

8

Exemplo 1.6: Seja X1 , X2 , ..., Xn uma amostra aleatória de tamanho n de uma uniform (0, 1),

assim fX (x) = 1 e FX (x) = x para x ∈ (0, 1). Assim:

n

n k

x (1 − x)n−k

FX( j) (x) = ∑

k

k= j

FX(1) (x) = 1 − (1 − x)n

FX(n) (x) = (x)n

Teorema 1.3: Seja X1 , X2 , ..., Xn uma amostra aleatória de tamanho n de uma distribuição

continua com função de densidade fX (x) e função de distribuição FX (x), seja X(1) , X(2) , ..., X(n)

as estatísticas de ordem da amostra. Então:

• fdp

fX( j) (x) =

n!

fX (x) [FX (x)] j−1 [1 − FX (x)]n− j

( j − 1)!(n − j)!

• fdp conjunta de X(i) e X( j) , 1 ≤ i ≤ j ≤ n, é:

fX(i) ,X( j) (u, v) =

n!

fX (u) fX (v) [FX (u)]i−1 [FX (v) − FX (u)] j−1−i [1 − FX (v)

( j − 1)!(i − 1)!( j − 1 − i)!(n − j)!

para −∞ < u < v < ∞

• fdp conjunta de X(1) , X(2) , ..., X(n)

fX(1) ,X(2) ,...,X(n) (x1 , x2 , ..., xn ) = n! fX (x1 ) fX (x2 )... fX (xn )

Exemplo 1.7: Seja X1 , X2 , ..., Xn uma amostra aleatória de tamanho n de uma uniform (0, 1),

assim fX (x) = 1 e FX (x) = x para x ∈ (0, 1). Assim:

n!

1 [x] j−1 [1 − x]n− j

( j − 1)!(n − j)!

Γ(n + 1)

=

x j−1 (1 − x)n− j

Γ( j)Γ(n − j + 1)

fX( j) (x) =

Logo a i-ésima estatística de ordem tem distribuição beta( j, n − j + 1)

E a fdp conjunta é dada por:

fX(1) ,X(2) ,...,X(n) (x1 , x2 , ..., xn ) = n!

1.2.4

Momentos Amostrais

Definição 1.12 (Momentos Amostrais): Seja X1 , ..., Xn uma amostra aleatória da variável

aleatória X, com f.d.p. ou f.p. f (x|θ ). Então:

Inferência Estatística

9

• O k-ésimo momento amostral é definido por:

n

Mk0 =

∑ Xik

i=1

n

• O k-ésimo momento amostral centrado em torno de Xn é definido por

n

∑ (Xi − Xn )k

i=1

Mk =

n

em que Xn é o primeiro momento amostral.

Teorema 1.4: Seja X1 , ..., Xn uma amostra aleatória da variável aleatória X, com f.d.p. ou

f.p. f (x|θ ). Então o valor esperado esperado do k-ésimo momento amostral é igual ao k-ésimo

momento populacional.

E[Mk0 ] = µk0

e também a variância do k-ésimo momento amostral é dada por

V [Mk0 ] =

0 − (µ 0 )2

E[X 2k ] − (E[X k ])2 µ2k

k

=

n

n

Definição 1.13 (Média Amostral): Seja X1 , ..., Xn uma amostra aleatória da variável aleatória X, com f.d.p. ou f.p. f (x|θ ), então

n

∑ Xi

Xn =

i=1

n

é definido como média amostral

Definição 1.14 (Variância Amostral): Seja X1 , ..., Xn uma amostra aleatória da variável

aleatória X, com f.d.p. ou f.p. f (x|θ ), então

n

∑ (Xi − Xn)2

Sn2 =

i=1

n−1

para n > 1

é definido como variância amostral

Teorema 1.5: Seja X1 , ..., Xn uma amostra aleatória da variável aleatória X, com f.d.p. ou

f.p. f (x|θ ), com média µ e variância σ 2 então

E[Xn ] = µ

Var[Xn ] =

σ2

n

Inferência Estatística

10

Teorema 1.6: Seja X1 , ..., Xn uma amostra aleatória da variável aleatória X, com f.d.p. ou

f.p. f (x|θ ), com média µ e variância σ 2 então

E[Sn2 ] = σ 2

1.3

Var[Sn2 ] =

n−3 4

1

µ4 −

σ

n

n−1

EXERCICIOS

1.1) Responda as questões abaixo:

a) O que é inferência estatística?

b) O que é uma Estatística?

c) O que é um Estimador?

d) O que é uma estimativa?

e) O que é um parâmetro?

f) O que é um espaço paramétrico?

g) O que é uma distribuição amostral?

1.2) Defina POPULAÇÃO e AMOSTRA e cite pelo menos 3 vantagens da amostragem.

1.3) Por que é importante que uma amostra extraída de uma população seja aleatória

1.4) Sejam X 1 , ..., X n um conjunto de médias amostrais. O que ocorre com a variabilidade

desse conjunto conforme o tamanho da amostra aumenta?

1.5) Sejam X1 , ..., Xn uma amostra aleatória de variáveis aleatórias independentes e identicamente distribuídas (i.i.d.) com função de densidade (f.d.p.) ou, no caso discreto, função de

probabilidade (f.p.) f (x|θ ). Para cada uma das distribuições abaixo determine:

• O espaço paramétrico

• O suporte da distribuição

n

• A função de distribuição de S = ∑ Xi .

i=1

• A distribuição de X(1) e X(n)

a) Xi ∼ Bernoulli(θ )

b) Xi ∼ Bin(3, θ )

c) Xi ∼ Poisson(λ )

Inferência Estatística

11

d) Xi ∼ Geometrica(θ )

e) Xi ∼ Gama(r, θ )

1.6) Suponha que X seja uma variável aleatória continua distribuída uniformemente sobre o

intervalo (0, 1). Ache a fdp das seguintes variáveis aleatórias e determine sua Moda e Mediana.

a) Y = X 2 + 1

b) Z =

1

X+1

1.7) Se X é uma variável aleatória continua com função de distribuição F. Mostre que se uma

variável aleatória Y = F(X) é uniformemente distribuída em (0, 1).

1.8) Se X é uma variável aleatória com distribuição normal N(µ, σ 2 ). Seja Y = eX , mostre que

Y tem distribuição lognormal com parâmetros µ e σ 2 .

1.9) Se X é uma variável aleatória com distribuição lognormal LogN(µ, σ 2 ). Seja Y = lnX,

mostre que Y tem distribuição normal com parâmetros µ e σ 2 .