Previsão de commodities com modelos ARIMA-GARCH e redes neurais com ondaletas:

velhas tecnologias – novos resultados

1. Introdução

Na última década, uma nova metodologia para previsão de séries temporais

(decomposição em sub-séries, com previsão dentro das mesmas via filtro de ondaletas ou

wavelets) tem sido discutida na literatura e aplicada por agentes envolvidos nas previsões

econômicas com intuito de redução de incertezas e riscos, principalmente no mercado

agropecuário.

Já é crescente o número de pesquisas que estão sendo desenvolvidas com o uso desta

nova metodologia aplicadas aos indicadores de bolsa de valores como, por exemplo, Tak

(1995) e Wong et al. (2003). No Brasil, ainda são poucos os trabalhos que exploram ondaletas

como os de Chang (1997) e Homsy, Portugal e Araújo (2000), Lima (2004).

Diversos estudos têm pesquisado a adoção de previsões na área de finanças, utilizando

diferentes técnicas e abordagens.

Autores como Keim e Stambough (1986), O’Connor,

Remus e Griggs (1997), Leung, Daouk, Chen (2000), Bressan e de Lima (2002) estudaram a

adoção de métodos de previsão de indicadores financeiros, explorando, através de abordagens

econométricas e de redes neurais, a previsibilidade de retornos de preços de ações até de

preços aplicados a contratos futuros na BM&F, através da modelagem de sucessões

cronológicas, em que se têm, como variável de entrada, os valores históricos da variável a ser

prevista.

Outros autores analisaram mais especificamente a previsão de índices de Bolsa de

Valores. Por exemplo, Kutsurelis (1998), Leung, Daouk e Chen (2000) utilizaram técnicas de

modelagem de séries temporais, tomando como base os modelos ARIMA sugeridos por Box e

Jenkins (1994) e usando redes neurais voltadas para o índice S&P 500.

O surgimento da teoria de decomposição via ondaletas, a partir de meados dos anos

80, que consiste em fracionar a série temporal original em duas sub-séries, sendo uma relativa

às altas freqüências e a outra às baixas freqüências, por meio de formas de ondas específicas,

fez com que alguns autores começassem a incorporar o uso desta teoria em conjunto com

outras técnicas já convencionais para fins de previsão (GENÇAY; SELÇUK; WHITCHER,

2002).

Exemplificando, Ariño (1995) utilizou as ondaletas para previsão de vendas mensais

de carros no mercado espanhol. Tak (1995) fez uso de ondaletas para previsão do S&P500,

em conjunto com redes neurais e com modelos ARIMA, baseando-se na metodologia

proposta por Engle (1982). Através desta metodologia, chegou-se a uma previsão do índice

futuro, aplicando-se um modelo de previsão às duas sub-séries derivadas da série original,

obtendo-se uma reconstrução desta série através de uma ondaleta.

Wong et al. (2003) também realizaram previsões com ondaletas modelos ARIMA, na

série do dólar americano e identificaram uma melhora no desempenho das previsões quando

as ondaletas eram utilizadas para fracionar a série.

No Brasil, alguns poucos trabalhos utilizando ondaletas podem ser citados. Por

exemplo, Chang (1997) trabalha com ondaletas na caracterização estatística de processos

estacionários com dados dos componentes espectrais de eletroencefalograma durante o estado

de sono de bebês cujas mães se abstiveram de bebidas alcoólicas durante a gravidez e de

bebês cujas mães consumiram, de forma moderada, bebidas alcoólicas durante a gravidez.

Esta técnica foi aplicada para detecção de alterações do estado de sono, via distorções nos

comportamentos dos escalogramas em escalas altas e baixas.

Homsy, Portugal e Araújo (2000) comparam, sob forma de estudo de casos, previsões

relativas a três diferentes métodos de modelagem de séries de tempo, os quais consistem na

aplicação da metodologia ARIMA, tanto da forma usual quanto amparada por dois

procedimentos auxiliares, baseados na análise de ondaletas para as séries da produção

industrial, exportações brasileiras e volume de pesca na Groelândia. Utilizou também o

procedimento de alisamento exponencial das séries. Este estudo dá indícios de que a

modelagem em separado através de ondaletas de sub-séries de baixas e altas freqüências

contribui positivamente para a qualidade das previsões.

Incorporando dados mais recentes, Wong et al. (2003) trabalharam com a taxa de

câmbio para previsões de dez passos à frente e na construção dos modelos de tendência,

utilizando uma amostra de 512 observações de 1º de agosto de 1989 a 31 de julho de 1991.

Este autores utilizaram a ondaleta de Daubechies (DAUB7) e, comparando com os modelos

ARIMA, obtiveram um menor erro de estimação com a decomposição via ondaletas.

A partir do levantamento do referencial teórico, observa-se uma lacuna na literatura

sobre previsão existente no mercado brasileiro. Em particular, pode-se explorar o estudo

conjunto da utilização dos modelos ARMA-GARCH e de redes neurais, dentro das sub-séries

decompostas por meio de uma ondaleta específica. Após a previsão feita dentro destas subséries, reconstrói a série original pela mesma ondaleta. A exemplo da pesquisa de Tak (1995)

e Homsy, Portugal e Araújo (2000), o presente estudo investiga a decomposição na série

original via uso de formas de ondaletas específicas e também na reconstrução da série original

para obtenção da previsão futura.

O diferencial deste trabalho está na realização das previsões dentro das sub-séries

decompostas por uma ondaleta, obtendo-se a previsão da série original via reconstrução, para

modelos de séries temporais de commodities, mais especificamente como exemplo o caso da

série de preços da saca de 60 kg da soja. Mais especificamente, este artigo trata da

aplicabilidade de previsão de ARIMA, ARIMA-GARCH e redes neurais com retropropagação

e redes neurais recorrentes.

O problema central da investigação deste trabalho envolve a seguinte questão:

“comparando os métodos já utilizados de previsão de séries temporais com a metodologia das

ondaletas, qual se mostra mais preciso na previsão aplicado a uma commodity?”

O objetivo principal desta pesquisa é explorar uma metodologia capaz de decompor

uma série temporal via ondaletas, conjuntamente com outros modelos já existentes de

previsão. Adicionalmente, busca-se comparar a qualidade de previsões obtidas por diferentes

métodos considerando uma série temporal de preços de uma commodity.

O artigo encontra-se dividido da seguinte forma. Após esta introdução, a seção 2 traz a

fundamentação teórica das ondaletas e sua aplicação em modelos de previsão de séries

temporais. A seção 3 trata da metodologia desenvolvida para esta pesquisa e a seção 4 mostra

os resultados deste conjunto de aplicações de filtros e modelos de previsão para a série

temporal da saca de 60 kg da soja, discutindo as vantagens e limitações desta nova

metodologia.

2. Fundamentação Teórica

Uma série temporal é qualquer conjunto de variáveis estocásticas eqüiespaçadas e

ordenadas no tempo X t X1 , X 2 ,

n

t 1

, X n . Em outras palavras, um sinal que depende do

tempo e é medido em pontos particulares no tempo é sinônimo de uma série temporal

(ENDERS, 2003). Conforme Morettin (2002), o que se chama de série temporal é uma parte

de uma trajetória, dentre muitas que poderiam ter sido observadas de um processo estocástico.

A análise de séries temporais, segundo enfoque de Box, Jenkins e Reinsel (1994), tem

por objetivo principal a realização de previsões. Essa metodologia permite que valores futuros

de uma série possam ser previstos com base apenas em seus valores presentes e passados. O

feitio deste processo se dá pela exploração da correlação temporal que existe, geralmente,

entre os valores exibidos pela série. Por envolverem apenas uma série de tempo, são

classificados como modelos paramétricos lineares univariados (MORETTIN, 2002).

Os modelos ARIMA são modelos que são aplicados no caso específico de séries não

estacionárias ou estacionarizadas e são compostos pelos três filtros: auto-regressivo, média

móvel e diferenciação. Para se montar um modelo ARIMA para uma série temporal, há três

estágios a se considerar: identificação, estimação e verificação (diagnóstico) (MORETTIN,

2002).

Genericamente, um modelo ARMA (p,q) seria:

X t 1 X t 1 2 X t 2 p X t p t 1 t 1 2 t 2

q t q

(1)

em que t et 1 (1) X t Et 1 X t .

Um modelo ARCH- Autoregressive Conditional Heterocedasticity, ou seja, de

heterocedasticidade autoregressiva condicional criado por Engle (1982) descreve uma série

temporal X t como X t t ht que descreve o comportamento de X t

conjunto informacional It-1 Xt 1 , Xt 2 ,

sendo

condicionado

ao

que t deve ser normal e identicamente

distribuído NID(0;1). O valor de ht é:

ht Var X t X t 1 , X t 2 , E X t2 X t 1 , X t 2 ,

com E t2 1 , resulta que

h 0 1 X t21 , 0 0,0 1 1 .

E t2 ( 0 1 X t21 )

(2)

(3)

Como ht depende do período defasado de X t21 , a série dos X t é então chamada de

modelo ARCH de ordem 1, índice p do modelo. A equação (3) indica que a variância

condicional de t varia com o tempo e deve-se observar que não há o termo de erro adicional.

A equação (2) assume que todas as observações t têm aas mesmas propriedades

distribucionais.

A equação (3) mostra ainda que para valores absolutos grandes (ou pequenos) de

X t são esperados ser seguidos de valores absolutos grandes (ou pequenos), enquanto houver a

igualdade E X t X t h 0 , ou seja, a idéia básica é a de que a série dos retornos X t é nãocorrelacionada serialmente, mas a volatilidade (variância condicional) depende dos retornos

passados por meio de uma função quadrática. Conseqüentemente, um modelo ARCH poderá

descrever uma série temporal com seqüências pontuais que parecem com outliers, onde o fato

de que estes outliers aparecem em clusters é causado pela equação de variância e não pelas

autocorrelações no nível da série temporal.

O modelo ARCH generalizado, conhecido como GARCH – Generalized

Autoregressive Conditional Heterocedasticity foi proposto Bollerslev (1987), onde dado um

modelo AR(p)-ARCH(q), este pode ser representado por: X t t ht com t ~ NID(0;1)

com h 0 1 X t21 2 X t22

q X t2q 1ht 1 2ht 2

p ht p

ou seja, é a equação GARCH(p,q) , sendo 0 0 , i 0 , j 0 ,

(4)

q

(

i 1

i

i ) 1

e

q = max(p,q).

As redes neurais artificiais são sistemas de processamento de informações distribuídas,

compostas por muitos elementos computacionais simples que interagem através de conexões

com pesos distintos. Inspiradas na arquitetura do cérebro humano, elas exibem características

como a habilidade de “aprender” padrões complexos de informação e generalizar a

informação aprendida (ZHANG; PATUWO; HU, 1998).

Muitos algoritmos neurais para processamento temporal têm sido propostos, entre

estes destacam-se o algoritmo de retropropagação através do tempo (BPTT, back propagation

through time), aprendizado recorrente em tempo real (RTRL, real-time recurrent learning ) e

os algoritmos de redes recorrentes utilizando o filtro de Kalman.

Segundo Haykin (2001), as unidades básicas da rede são os neurônios artificiais. Os

neurônios se agrupam em camadas. Existem três categorias de camadas: a camada de entrada,

a intermediária que pode também conter mais de uma camada e a camada de saída. Os

neurônios entre as camadas são conectados por sinapses ou pesos, os quais refletem a relativa

importância de cada entrada com o neurônio. A camada de entrada é responsável pelas

variáveis de entrada do modelo; a camada de saída contém um ou mais nós, representando os

resultados finais do processamento e as camadas intermediárias, ou camadas ocultas, que

podem existir uma ou mais que irão tornar o processamento mais refinado e não-linear.

A Figura, a seguir, apresenta o modelo de um neurônio, que forma a base para o

wk0 = bk

projeto de redes neurais (artificiais):

Entrada

Fixa

(viés)

wk0

x0 =

+1

x1

x2

Sinais de

Entrada

wk1

wk

2

x

m

wk

Potencial

de

Ativação

v

k

Função de

Ativação

(.)

Saída

yk

Junção

aditiva

m

Pesos

sinápticos

Figura 1: Modelo de um neurônio artificial

Fonte: HAYKIN, 2001.

No modelo neural da Figura 1, tem-se: um conjunto de sinapses ou elos de conexão,

sendo que cada sinapse é caracterizada por um peso ou força própria. Especificamente, um

sinal x j , na entrada da sinapse j conectada ao neurônio k, é multiplicado pelo peso

sináptico wkj . É importante notar como são escritos os índices do peso sináptico wkj . O

primeiro índice se refere ao neurônio em questão e o segundo ao terminal de entrada da

sinapse à qual o peso se articula; um somador ou integrador para somar os sinais de entrada,

ponderado pelas respectivas sinapses do neurônio; as operações descritas, neste caso,

constituem um combinador linear e a função de ativação para restringir a amplitude da saída

de um neurônio. A função de ativação é também referida como função restritiva já que

restringe (limita) o intervalo permissível de amplitude do sinal de saída a um valor finito.

O modelo neural da figura 1 inclui também um viés aplicado externamente,

representado por bk . O viés bk tem o efeito de aumentar ou diminuir a entrada líquida da

função de ativação, dependendo se ele é positivo ou negativo, respectivamente.Em termos

matemáticos, pode-se descrever um neurônio k, a partir das seguintes equações:

m

uk wkj x j

(5)

yk uk bk

(6)

j 1

sendo que x1 , x2 , ..., xm são os sinais de entrada; wk1 , wk 2 , ..., wkm são os pesos sinápticos do

neurônio k; uk é a saída do combinador linear devido aos sinais de entrada; bk é o viés; ()

é a função de ativação e yk é o sinal de saída do neurônio. O uso do viés bk tem o efeito de

aplicar um transformação afim à saída uk do combinador linear no modelo da Figura 2, como

mostrado por:

(7)

vk uk bk

Em particular, dependendo se o viés bk é positivo ou negativo, a relação entre o

campo local induzido ou potencial de ativação vk do neurônio k e a saída do combinador

linear uk pode ser alterada.

O modelo linear tem a propriedade útil de ter uma solução de forma fechada para

resolver o problema de uma regressão, ou seja, de minimizar a diferença quadrática entre oi e

o valor previsto pˆ i . Para a previsão de um período curto, o modelo linear é um ponto de

partida razoável, ou um padrão reconhecido, visto que, em muitos mercados, observam-se

apenas pequenas mudanças simétricas na variável a ser predita, ao longo de uma tendência de

longo prazo. No entanto, isto pode não ser preciso o bastante para mercados financeiros

voláteis em que pode haver um processo não-linear dos dados. Movimentos lentos no

aumento dos preços dos ativos, seguidos por colapsos repentinos conhecidos como “bolhas”

são comuns de acontecer. Dessa forma, o modelo linear pode falhar em capturar ou prever

pontos de mudança acentuada nos dados. Por esta razão, é que são utilizadas técnicas nãolineares de previsão.

A rede neural é uma alternativa aos modelos lineares e a algumas abordagens nãoparamétricas para a aproximação de sistemas não-lineares. A razão para o uso de uma rede

neural é simples e direta. O objetivo é encontrar uma abordagem ou método o qual realize

bem previsões para dados gerados para processos que, freqüentemente, são desconhecidos e

altamente não-lineares, com uma quantidade pequena de parâmetros e o qual seja mais fácil

de estimar que os modelos não-lineares paramétricos (DE OLIVEIRA, 2003).

Redes neurais recorrentes são redes neurais com um ou mais laços de realimentação,

podendo ser local ou global (HAYKIN, 2001).

Talvez, os algoritmos mais amplamente utilizados sejam o algoritmo de aprendizagem

recorrente em tempo real (RTRL – real time recurrent learning) e o algoritmo de

retropropagação através do tempo (BPTT – backpropagation through time) (WILLIAM e

ZIPSER, 1995).

As previsões das séries temporais podem ser feitas no próprio nível da série dos

retornos X t , muito embora os ruídos apresentados dificultem a identificação dos coeficientes

tanto dos modelos GARCH como dos condicionamentos das redes neurais. Uma saída

proposta para esse problema seria passar sobre a série temporal um filtro que ajudasse a

diminuir esse ruído existente. A proposta metodológica desta pesquisa é usar para esse filtro

um sistema de ondaletas.

A primeira menção sobre o termo ondaletas foi dada em 1909, por Alfred Haar. O

conceito de ondaletas, na forma atual, foi primeiramente proposto por Jean Morlet e sua

equipe no Marseille Theoretical Physics Center, trabalhando em Alex Grossmann, na França

(MISITI et al., 1997).

As ondaletas são funções matemáticas que ampliam intervalos de dados, separando-os

em diferentes componentes de freqüência, permitindo a análise de cada componente em sua

escala correspondente. Essa característica distingue métodos de ondaletas de outros métodos

em estatística, baseados em séries ortogonais, tais como as usuais séries de Fourier. (MISITI

et al., 1997).

De acordo com a definição acima, a transformada contínua de ondaleta (CWT) pode

ser interpretada como o produto interno do sinal de teste com as funções base ( , s )(t ) :

CWTx ( , s) x ( , s) x(t ). *, s (t )dt

(8)

1 t

.

s s

Esta definição de CWT mostra que a análise de ondaleta é uma medida de similaridade

onde , s

entre as funções base (ondaleta) e o próprio sinal. Aqui similaridade está no sentido de

conteúdo de freqüência similar. Os coeficientes CWT calculados referem o quanto próximo

do sinal está a ondaleta na escala atual. Se o sinal tem maior componente de freqüência

correspondente à escala atual, então a ondaleta (funções base) na escala atual serão similares

ou próximas ao sinal na posição particular, onde esta componente de freqüência ocorre. Dessa

forma, o coeficiente CWT calculado naquele ponto no plano escala-tempo será um número

relativamente grande (POLIKAR, 1994).

Segundo Morettin (1999), toda função periódica, de período 2 , de quadrado

integrável, ou seja, de L2 (0, 2 ) , é gerada por uma superposição de exponenciais complexas

Wn ( x) einx , n 0, 1, 2,

, obtidas por dilatações da função Wn ( x) eix .

O objetivo, segundo o autor, é estender essa função para L2 ( IR) , isto é, gerar um

espaço, a partir de uma função , que pode ser conseguida por dilatações (parâmetro “ a ”)

ou compressões e translações (parâmetro “ b ”) de , dada por:

(9)

x b

, a, b IR, a 0

a

Sendo que é chamada de ondaleta mãe e os parâmetros a e b tomam os seguintes

a ,b ( x ) a

1

2

valores especiais, a 2 j e b k 2 j , que compõem a equação:

j

2

j , k ( x) 2 2 j x k , j , k

(10)

obtida pela dilatação binária 2 e pela translação diática k 2 , conforme sugere Morettin

(1999).

j

j

Uma maneira de gerar ondaletas é pela função escala, ou chamada de ondaleta pai,

, que é uma solução da equação

l (2t k )

(t ) 2

(11)

k

k

onde lk 2 (t )(2t k )dt .

Essa função gera uma família ortonormal de L2 ( IR) ,

j

2

(12)

j , k ( x) 2 2 j x k , j , k Z

Nessas condições, pode ser obtida de por:

(t ) 2

h (2t k )

(13)

k

k

(14)

onde hk (1) l1 k

que é chamada de quadrature mirror filter relation (MORETTIN, 1999).

Segundo Gençay, Selçuk e Whitcher (2002), uma série temporal financeira pode ser

k

decomposta por uma análise de ondaletas, por uma seqüência de projeções de ondaletas pai e

mãe, a partir das funções e , como seguem as equações (10) e (11).

A integração entre as ondaletas e uma série temporal prevista está no fato de que, uma

vez realizadas as previsões nas sub-divisões obtidas na etapa chamada de decomposição, a

transformada inversa da ondaleta na etapa de reconstrução, que irá trazer de volta a série

temporal no nível, isto é, a série temporal original.

A representação de uma série temporal X t em L2 ( IR) pode ser dada por:

Xt

a

j ,k

j ,k (t )

k

d

j ,k

j ,k (t )

k

Xt

a

k

j ,k

j ,k (t )

d

j 1, k

j 1,k (t )

k

d

i

i ,k

d

1, k

1,k (t )

(15)

k

j i 1,k (t )

(16)

k

onde j é o número de componentes e k que varia de 1 ao número de coeficientes do

componente específico. Os coeficientes

a j ,k , d j ,k ,

, d1,k

são os coeficientes das

transformadas de ondaletas dadas pelas projeções:

Aj ,k

e

j ,k (t ). X t dt , chamada parte de aproximação

(17)

D j ,k

(18)

j ,k (t ). X t dt , chamada parte de detalhe

E no nível j tem-se a metade do número de coeficientes do nível j 1 , donde o nome

piramidal.

A problemática em questão consiste em obter uma freqüência crítica de maneira que

os componentes da série original relacionados a freqüências menores ou iguais a uma

freqüência crítica formem uma sub-série

At 1

n

2

relativa a baixas freqüências, que também

recebem o nome de série “aproximada” (aproximation part) e os demais componentes

formem outra sub-série relativa a altas freqüências, denotada

Dt 1 ,

n

2

também chamada de

série “detalhe” (detail part) conforme as equações (10) e (11). (HOMSY; PORTUGAL;

ARAÚJO, 2000).

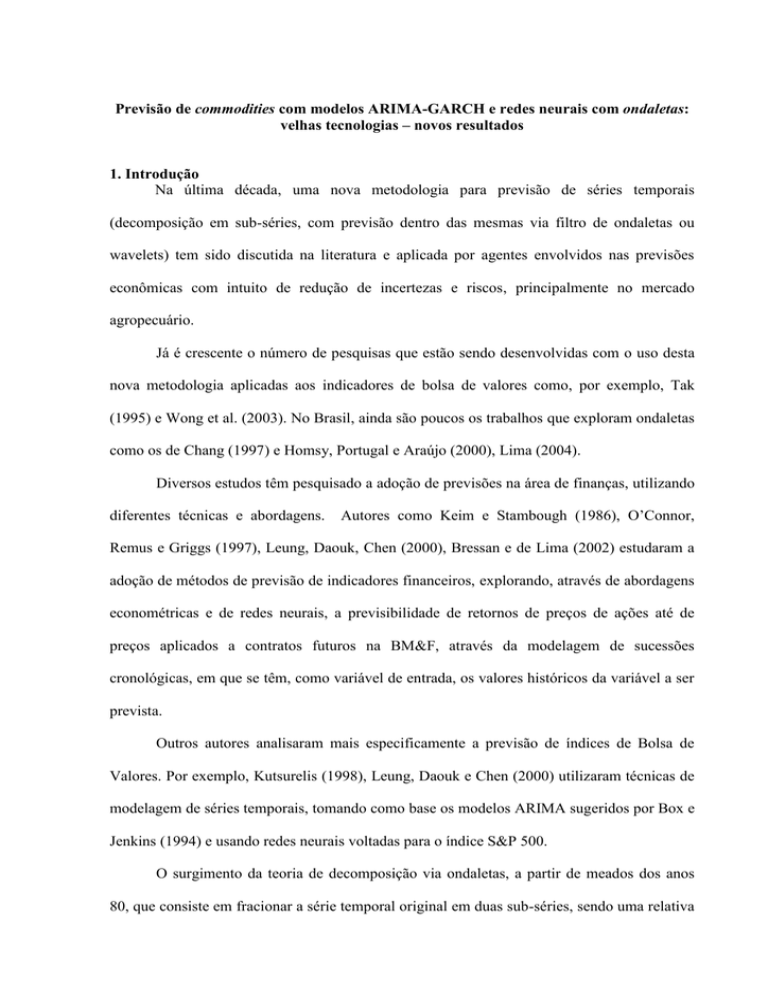

Para Misiti et al. (1997), este processo de decomposição, a partir de uma série X t ,

passando por um filtro de uma ondaleta, dá origem a duas novas séries: uma chamada

aproximação (baixas freqüências) e outra detalhe (altas freqüências). O autor cita ainda que o

processo de decomposição da série pode ser iterativo, com sucessivas decomposições,

formando uma árvore de decomposição com 2 n caminhos diferentes para a codificação da

série. A árvore de decomposição fica da seguinte forma:

Série

Original

A1

AA1

AAA2

AAD2

D1

1º Nível

AD1

ADA2

DAD2

2º Nível

3º Nível

DA1

ADA2

ADD2

DD1

DDA2

DDD2

Figura 2: Árvore de decomposição em 3 níveis de uma série temporal via decomposição por ondaleta.

Fonte: MISITI et al., 1997.

3. Metodologia

A metodologia utilizada fundamenta-se na análise e na construção de modelos

univariados de previsão de séries temporais não-lineares. Há uma grande variedade de

modelos aplicáveis a estudos dessa natureza. Para fins desta pesquisa, optou-se por selecionar

os modelos ARIMA-GARCH e de Redes Neurais com o algoritmo de aprendizagem

recorrente em tempo real, conforme sugerido por Williams e Zipser (1995) e De Oliveira

(2003) e LIMA(2004).

A commodity agrícola escolhida para esta pesquisa foi a soja. Nos dias atuais, ela

constitui um dos produtos de maior relevância para a economia brasileira e uma das culturas

que mais cresce no segmento agroindustrial. Os dados foram obtidos junto ao site da Esalq

através do Centro de Estudos Avançados em Economia Aplicada1 para a saca de 60 Kg da

soja.

Usou-se o EVIEWS® 5.0, para tratamento dos testes e previsões para o modelo

ARIMA-GARCH. Para as redes neurais, utilizou-se o MATLAB® 6.5, para as redes

recorrentes e o software Statistica da StatSoft© 6.1, para as redes com retropropagação.

Entendem-se as ondaletas como uma etapa inicial de pré-processamento, para fins de

realizar as previsões dentro das sub-séries de baixa e alta freqüência em que a ondaleta as

decompõe. Foi escolhida a ondaleta de Daubesch número 1 (DB1), por ser a mais trabalhada

nos artigos da revisão da literatura. Foi considerado as decomposições da série da soja pela

ondaleta de Daubesch em até um nível conforme Lima(2004) por apresentar melhores

resultados do que em dois níveis de decomposição.

Para comparar as previsões do valor do preço da saca de 60 Kg da soja utilizou-se as

estatísticas MAPE, TIC e correlação. O Erro Percentual Absoluto Médio (Mean Absolute

Percentage Error) (MAPE) é um valor absoluto médio em percentual, para se verificar a

1

www.cepea.esalq.usp.br

margem de acerto em comparação com o valor previsto. É mais adequado para comparação

entre modelos. Quanto menor for o seu valor, melhor é o ajuste do modelo.

ˆi

h

MAPEh

X

i 1

(19)

i

h

100 %

MAPE 0

O coeficiente de correlação linear r mede o grau de relacionamento linear entre os

valores emparelhados x e y em uma amostra. O coeficiente de correlação linear é chamado, às

vezes, coeficiente de correlação momento-produto de Pearson. Varia entre –1 e 1, sendo estes

extremos indicação de associação linear negativa e positiva perfeita, respectivamente.

h

rh

(X

i

X )( Xˆ i Xˆ )

i 1

S X S Xˆ

1;1

(20)

em que X̂ é a esperança condicionada de X t 1 dada a informação até período t (inclusive).

O TIC – Coeficiente de Desigualdade de Theil (Theil Inequality Coefficient) sempre

estará entre zero e um, sendo que zero indica um ajuste perfeito.

h

ˆ

2

i

TICh

0,1

i 1

h

Xˆ

i 1

2

i

h

X

2

i

(21)

i 1

4. Resultados Experimentais

A Série da SOJA, mostrada na figura a seguir, corresponde aos valores nominais de

30/07/1997 a 11/04/2008, perfazendo 2660 observações diárias.

Figura 3: Série original da saca de 60 Kg da soja

Fonte: Série histórica: indicador CEPEA/ESALQ (R$/sc 60 kg)

Figura 4: Série dos log-retornos da série da saca de 60 Kg da soja.

(a)

(b)

Foi considerado o período de 30/07/1997 a 28/03/2005, totalizando 2650 observações

para a geração, identificação e testes dos modelos ficando 10 pontos para testes de previsão

futura, ou seja de 31/03/2008 a 11/04/2008.

A figura 5 representa o correlograma da série dos retornos diários da saca de 60 Kg da

soja sem uso da decomposição por ondaletas. Pode-se verificar que a função de

autocorrelação (Autocorrelation) apresenta um comportamento declinante e a função de

autocorrelação parcial (Partal Correlation) é truncada da primeira defasagem; isto é um

indicativo de um modelo auto-regressivo de primeira ordem (AR(1)).

Figura 6: Correlograma da série dos log retornos em um nível sem decomposição por

ondaletas

(a) Série sem ondaletas

(b) Série Com Ondaletas Aproximation

Part

(c) Série Com Ondaletas Detail Part

Figura 4 – FAC e FACP da série de retornos diários da saca de 60 Kg da soja para a série sem decomposição

por filtro de ondaletas e a série com a primeira decomposição.

Figura 7: Correlograma da série Aproximation Part dos log retornos decomposta em

um nível via ondaleta

Figura 8: Correlograma da série Detail Part dos log retornos decomposta em um nível

via ondaleta

De posse das informações descritas acima, gerou-se um modelo ARIMA-GARCH,

para cada uma das sub-séries descritas a seguir pelo modelo AR(1)-GARCH(1,1) para a série

sem uso de ondaletas.

SOJAt 1SOJAt 1 t

2 I t 1 ~ N (0, ht )

t

ht 0

2

1 t 1

1ht 1

Parâmetros

1

0

1

1

Coeficiente

Estatística z

Sig. estimada

0,309464

Erro

Padrão

0,019809

15,62276

0,0000

2,41E-06

3,04E-07

7,937662

0,0000

0,133337

0,008850

15,06578

0,0000

0,859072

0,007294

117,7742

0,0000

Quadro 1 – Estatísticas do modelo ARIMA-GARCH gerados para a série dos retornos da saca da soja sem

decomposição de ondaletas

Para a série decomposta em um nível com ondaletas tem-se:

Coeficiente

Erro Estatística z

Asojat 1 Asojat 1 t Parâmetros

2 I t 1 ~ N (0, ht )

1

0

1

1

t

ht 0

2

1 t 1

1ht 1

Sig. estimada

0,224592

Padrão

0,027860

8,061412

0,0000

9,12E-06

8,42E-07

10,83049

0,0000

0,149746

0,015367

9,744727

0,0000

0,805042

0,014064

57,23957

0,0000

Quadro 2 – Estatísticas do modelo ARIMA-GARCH gerados para a série decomposta – Aproximation Part

Dsojat 1Dsojat 1 t

Parâmetros

2 I t 1 ~ N (0, ht )

t

ht 0

2

1 t 1

1ht 1

Coeficiente

1

0

1

1

- 0,047233

Erro

Padrão

0,030650

Estatística z

Sig. estimada

- 1,540161

0,1233

3,75E-06

5,53E-07

6,781012

0,0000

0,200516

0,017445

11,49437

0,0000

0,784482

0,015360

51,07392

0,0000

Quadro 3 – Estatísticas do modelo ARIMA-GARCH gerados para a série decomposta – Detail Part

Após a etapa de identificação e previsão da série dos retornos da saca da soja de 60

Kg, foram previstos 10 passos à frente pela previsão dinâmica.

A seguir, são apresentados os resultados obtidos, utilizando-se redes neurais artificiais

para a série da saca de 60 Kg da soja. A rede neural utilizada, primeiramente, foi com o

algoritmo de retropropagação e, posteriormente, com a rede recorrente proposta por Williams

e Zipser (1995) e implementada em DE OLIVEIRA (2003) e LIMA(2004). Foi utilizado,

nesta etapa, o Matlab® 6.5.

Para que os dados sejam inseridos na rede, foi utilizado o processo de normalização

proposto por Azoff (1994), que considera um vetor de entrada de dimensão n, ou seja, os

elementos no vetor variam de i 1,

, n . Os elementos ti j , para a sinapse i e a amostra total

de tamanho N, do vetor indo de j 1,

, N , são normalizados e utilizados para análise pela

expressão:

Yt min Yt t 1

N

Zt

max Yt t 1 min Yt t 1

N

N

0;1

Utilizando-se a rede recorrente de tempo real, conforme sugere DE OLIVEIRA (2003)

e LIMA(2004), tomou-se uma rede com função de ativação logística, taxa de aprendizagem

de 0,005, um neurônio na camada de entrada e um na saída e 4 neurônios na camada

intermediária.

A conversão da normalização para o retorno logarítmico fica, considerando a série

DLSOJA como a série das diferenças dos logaritmos, isto é, do retorno contínuo da cotação

de fechamento do preço da saca de 60 Kg de soja:

NDSOJAt

DLSOJAt min DLSOJAt

max DLSOJAt min DSOJAt

DLSOJAt NDSOJAt max DLSOJAt min DLSOJAt min DLSOJAt

Esse valor já desnormalizado NDLSOJAt passa a ser o agora o valor previsto, tanto

para a rede neural como para o modelo ARIMA-GARCH. Para que sejam obtidos os valores

da série no nível, é necessário realizar uma transformação dos dados resultantes da análise da

série dos retornos que segue:

ln SOJAt ln SOJAt 1 NDLSOJAt max DLSOJAt min DLSOJAt min DLSOJAt

ln SOJAt NDLSOJAt max DLSOJAt min DLSOJAt min DLSOJAt ln SOJAt 1

Aplicando exponencial na expressão acima, chega na reconstrução da série prevista no

nível original.

NDLSOJAt max DLSOJAt min DLSOJAt min DLSOJAt ln SOJAt 1

SOJAt e

Dessa forma, os valores previstos foram:

DATA

Valor Real

31/3/2008

1/4/2008

2/4/2008

3/4/2008

4/4/2008

7/4/2008

8/4/2008

9/4/2008

10/4/2008

11/4/2008

42,78

42,05

42,87

43,26

43,50

43,53

43,42

43,63

44,69

44,70

VALORES PREVISTOS

ARIMAARIMAREDE

GARCH

GARCH

RECORRENTE

Sem Ondaletas

Com Ondaletas

Sem Ondaletas

44,60

45,08

44,42

42,77

43,21

42,86

42,05

41,94

42,18

42,87

43,14

43,02

43,26

43,11

43,41

43,50

43,72

43,65

43,53

43,42

43,67

43,42

43,68

43,56

43,63

43,44

43,77

44,69

44,88

44,85

REDE

RECORRENTE

Com Ondaletas

44,74

43,44

42,17

43,17

43,33

43,85

43,61

43,77

45,73

45,01

Quadro 4- Comparação entre os valores no nível e os previstos para a série da saca da soja com e sem uso de

ondaletas

O gráfico a seguir ilustra a série real e as séries previstas já no nível da série original

onde se observa que as previsões com uso de ondaletas se aproximam melhor da série original

pelo fato da redução de ruído. Há distorções nos valores previstos apenas nos primeiros e nos

últimos valores onde as oscilações foram em maior escala.

Figura 8 – Valores da série diários da saca de 60 Kg da soja e a curva de previsão para os modelos com uso de

ondaletas (CW) e sem o seu uso (SW).

As estatísticas de erro dos modelos conforme citadas pelas equações (19), (20) e (21)

são apresentadas no quadro a seguir:

Estatística

de

Análise

ARIMA-GARCH

Sem Ondaletas

Previsão de 10 passos à frente por modelos

ARIMA-GARCH

REDE RECORRENTE

Com Ondaletas

Sem Ondaletas

MAPE(%)

1,5229

1,2530

1,4622

Correlação

0,3064

0,4929

0,6463

TIC

0,0111

0,0088

0,0100

Quadro 5 – Estatísticas de acurácia das previsões feitas para a saca de 60 Kg da soja.

REDE

RECORRENTE

Com Ondaletas

1,1537

0,5736

0,0080

5. Conclusão

Nesta pesquisa, o objetivo principal foi o de explorar a possibilidade de usar uma

metodologia capaz de decompor uma série temporal via uso de ondaletas, conjuntamente com

os modelos econométricos e de redes neurais já existentes de previsão e comparar a qualidade

de previsões obtidas para séries temporais da série da soja.

O diferencial deste trabalho esteve na realização das previsões dentro das sub-séries

decompostas por uma ondaleta em até dois níveis, obtendo-se a previsão da série original via

reconstrução da série para a sucessão cronológica da soja.

No caso do modelo ARIMA(1,0,0)-GARCH(1,1), pode-se observar

que a

decomposição pela ondaleta foi melhor para apenas uma etapa de separação de altas e baixas

freqüências, tanto pela correlação quanto pelos critérios do TIC, sendo este reduzido, e pelo

MAPE menor para as previsões de curto prazo.

Para os modelos de previsão com redes neurais, ressalta-se a qualidade das previsões

com redes neurais recorrentes, isto é a capacidade de previsão das redes recorrentes para

dados não-lineares com 1 nível de decomposição para previsões de curto prazo.

Destacou-se também o aumento da correlação com uso das ondaletas apenas no

modelo ARIMA-GARCH. As previsões estáticas são melhores para as redes neurais

recorrentes.

A capacidade das redes neurais de lidarem com sucessões não-lineares é uma

vantagem, pois as previsões feitas com pré-processamento convalidam uma indicação dessa

característica.

Referências

ARIÑO, M. A. Time series forecasts via ondaletas: an application to car sales in the spanish

market. Discussion Paper 95-30, ISDS, Duke University.

AZOFF, E. M. Neural network time series forecasting of financial markets. John Wiley &

Sons. 1994.

BARTLETT, M. S. On the theoretical specification and sampling properties of autocorrelated

time series. Journal of the Royal Statistical Society. B2, 1946, p. 27-41.

BOLLERSLEV, T. A conditional heteroscedasticity time series model for speculative process

and rates of return. Review of Economics and Statistics, v. 69, p. 542-547, 1987.

BOX, G. E. P; PIERCE, D. A. Distribution of autocorrelations in autoregressive moving

average models. Journal of the American Statistical Association, v. 65,1970. p. 1509-1526,

1970.

BOX, G. E. P., JENKINS, G. M., REINSEL, G. C. Time series analysis: forecasting and

control. 3. ed. New York : Prentice Hall, 1994.

BRESSAN, A. A. ; LIMA, J. E. . Modelos de Previsão de Preços aplicados aos contratos

futuros de boi gordo na BM&F. Nova Economia, Belo Horizonte, v. 12, n. 1, p. 117-140,

2003.

CAMPBELL, J.Y.; LO, A.W.; MACKINLAY, A. C. The econometrics of financial

markets. New Jersey: Princeton University Press, 1997.

CHANG, C. Análise de ondaletas em séries temporais. São Paulo: IME, 1997. 117 f. Tese

(Doutorado em Matemática Aplicada) – Instituto de Matemática e Estatística, Universidade

de São Paulo, 1997.

CROMWELL, J. B.; LABYS, W. C; TERRAZA, M. Univariate tests for time series

models. Sage University Paper series on Quantitative Aplications in the Social Scienses. n. 799. Thousand Oaks, CA: Sage.

DE OLIVEIRA, M. A. Previsão de sucessões cronológicas econômico-financerias por

meio de redes neurais artificiais recorrentes de tempo real e de processos ARMAGARCH: um estudo comparativo quanto à eficiência de previsão. Faculdade de

Economia, Administração e Contabilidade. São Paulo, 2003. 171 f. Dissertação (Mestrado

em Administração). Faculdade de Economia, Administração e Contabilidade: Universidade

de São Paulo, 2003.

DINIZ, H. A.; L. CARVALHO, A.; ANDRADE, M. Previsão de séries temporais utilizando

redes neurais artificiais e modelos de Box e Jenkins. Proceedings of the V Brazilian

Symposium on Neural Networks, Belo Horizonte: p. 173-178, dez. 1998.

ELMAN, J. L. Finding structure in time. Cognitive Science. v. 14. p. 179-211, 1990.

ENDERS, W. Applied econometric time series 2. ed. John Wiley & Sons, 2003.

ENGLE, R. Autoregressive conditional heteroscedasticity with estimates of the variances of

U.K. inflation. Econometrica, v. 50. p. 987-1008, 1982.

GENÇAY, R.; SELÇUK, F.; WHITCHER, B. An introduction to ondaletas and other

filtering methods in finance and economics. New York: Academic Press, 2002.

HAMILTON, J. D. Time series analysis. Princeton: Princeton University Press, 1994.

HANNAN, E. J. The estimation of the order of an ARMA process. The Annals of Statistics.

v. 8, p. 1071-1081. 1980.

HAYKIN, S. Redes neurais: princípios e prática. 2. ed. Porto Alegre: Bookman, 2001.

HILL, T.; O’CONNOR, M.; REMUS, W. Neural network models for time series forecasts.

Management Science. v. 42, n. 7, p. 1082 – 1092, jul. 1996.

HOMSY, G. V.; PORTUGAL, M. S.; ARAÚJO, J. P., Ondaletas e previsões de séries de

tempo: uma análise empírica. XXII Encontro Brasileiro de Econometria. Campinas, 2000.

KEIM, D.; STAMBAUGH, R. Predicting returns in stock and bond markets. Journal of

Financial Economics. v. 17, 1986, p. 357-390.

KUTSURELIS, J. E. Forecasting financial markets using neural network: an analysis of

methods and accuracy. 1998. 123 f. (Tese em Administração). Naval Postgraduate School,

Monterey, California. 1998.

LIMA, F. G. Um método de análise e previsão de sucessões cronológicas unidimensionais

lineares e não-lineares. Faculdade de Economia, Administração e Contabilidade. São Paulo.

228 f. Tese (Doutorado em Administração). Faculdade de Economia, Administração e

Contabilidade: Universidade de São Paulo, 2004.

LEUNG, M. T.; DAOUK, H.; CHEN, A. Forecasting stock indices: a comparison of

classification and level estimation models. International Journal of Forecasting. v. 16, n. 2,

2000, p. 173-190.

MCLEOD, A. J. e W. K. Li, Diagnostic checking ARMA times series models using squared

residuals correlations. Journal of Time Series Analysis, n. 4, 1983, p. 269-73.

MAKRIDAKIS, S.; WHEELWRIGHT, S. C.; McGEE, V. E. Forecasting: methods and

aplications. 2 .ed. John Wiley e Sons, 1983.

MEYER, Y. Ondaletas and operators. Tradução de D.H. Salinger. Cambridge: Cambridge

University Press, 1993.

MISITI, M. et al. Ondaleta toolbox: for use with Matlab. The Math Works, Inc. 1997.

Disponível em: <http://www.mathworks.com> . Acesso em: 14 ago. 2003.

MORETTIN, P. A. Séries temporais em finanças. São Paulo, 2002. 156 p. (Texto para um

Curso na Universidade Católica de Lima, Peru).

______________ .Ondas e ondaletas. São Paulo: Edusp, 1999.

MORETTIN, P. A.; TOLOI, C. M. de C. Análise de séries temporais. São Paulo: Edgard

Blücher, 2004.

O'CONNOR, M., W. REMUS AND K. GRIGGS, Going up - going down: how good are

people at forecasting trends and changes in trends? Journal of Forecasting, 16, 1997, p. 165176.

PINDYCK, R. S.; RUBINFELD, D. L. Econometric models and economic forecasts. 4. ed.

New York:McGraw-Hill International, 1997.

POLIKAR,

R.

The

wavelet

tutorial.

1994.

Disponível

em:

<http://www.site.uottawa.ca/~qingchen/wavelet.htm> . Acesso em 10 de jan. 2002.

PRIESTLEY, M.B. Spectral analysis and time series. London: Unknown, 1983.

QI, Min. Nonlinear predictability of stock returns using financial and economic variables.

Journal of Business & Economic Statistics. v. 64, n. 4, 1999, p. 419-429.

TAK, B. A new method for forecasting stock prices using artificial neural network and

ondaleta theory. 1995. 107 f. Tese (Doutorado em Economia). Universidade de Pensilvânia,

Estados Unidos, 1995.

TSAY, R. S. Analysis of financial time series. Wiley series in probability and statistics.

2002.

WINKLHOFER H.; WITT, S. F.; DIAMATOPOULOS, A. Forecasting practice: a review of

the empirical literature and an agenda for the future research. International Journal of

Forecasting, Elsevier Science B, v. 1 , n.12, p. 193-221,1996.

WILLIAMS, R. J.; ZIPSER, D. A learning algorithm for continually running fully recurrent

neural networks. Neural Computation. v. 1, p. 270-280. 1989.

_________________________. Gradient-based learning algorithm for recurrent networks and

their computational complexity, 1995.

WONG, H., IP. W., XIE, Z., LUI, X.. Modelling and forecasting by ondaletas, and the

application to exchange rates. Journal of Applied Statistics, v. 30, n. 5, 2003. p. 537-553.

ZHANG, G.; PATUWO, B. E.; HU, M. Y. Forecasting with artificial neural networks: the

state of the art. International Journal of Forecasting, Kent(Ohio) 14, p. 35–62, 1998.

ZOU, W. Integration of different forecasting models. The Journal of Business Forecasting.

p. 26-32,1999.

ZOU, H., YANG, Y. Combining time series models for forecasting. International Journal of

Forecasting. n. 20, p. 69-84.2004.