ANÁLISE COMPARATIVA DO DESEMPENHO DE APARELHOS AUDITIVOS

ANALÓGICOS VERSUS DIGITAIS NO RUÍDO

COMPARATIVE ANALYSIS OF ANALOG VERSUS DIGITAL HEARING

INSTRUMENTS PERFORMANCE IN NOISE

Alessandra Rabello de Oliveira Lamenza

Especialização em Audiologia Clínica pelo Centro de Especialização em

Fonoaudiologia Clínica (CEFAC)

Fonoaudióloga formada pela Universidade Federal do Rio de Janeiro (UFRJ)

Rua Ribeiro Guimarães, 80/206-I

Fone: (21) 2567-9031

20511-070

Fax: (21) 2242-8477

Rio de Janeiro - R.J.

[email protected]

Vicente José Assencio-Ferreira

Doutor em Medicina (Neurologia) pela Universidade de São Paulo (USP)

Instituição de Origem

Centro de Especialização em Fonoaudiologia Clínica (CEFAC)

Rua Cayowaá, 664

05018-000

Fone/fax: (11) 3675-1677

São Paulo – S.P.

[email protected]

2

Índice

1. Resumo.............................................................................................................03

2. Abstract.............................................................................................................04

3. Introdução.........................................................................................................05

4. Métodos.............................................................................................................07

5. Revisão de Literatura.......................................................................................10

5.1. Percepção Auditiva.............................................................................10

5.2 Percepção Auditiva da Fala................................................................12

5.3 Percepção Auditiva da Fala no Ruído................................................19

5.4. Próteses Auditivas..............................................................................26

6. Resultados........................................................................................................43

7. Discussão.........................................................................................................46

8. Conclusão.........................................................................................................52

9. Referências Bibliográficas..............................................................................53

10. Agradecimentos.............................................................................................58

Anexos

3

Resumo

O objetivo do presente trabalho foi determinar, através do índice de

reconhecimento de fala em presença de ruído, se usuários adaptados a aparelhos

auditivos analógicos teriam adaptação com aparelhos de circuito digital. Foram

avaliados 12 sujeitos portadores de perda auditiva bilateral variando de grau leve a

profundo. O procedimento de teste utilizado foi o de repetição de sentenças

apresentadas via CD com ruído competitivo em relação sinal / ruído de 0 dB.

Inicialmente o procedimento era realizado com a(s) prótese(s) do paciente,

posteriormente com a prótese digital, após a realização de um teste para

personalização dos parâmetros de ajuste. Na avaliação da prótese digital foi

utilizado o algoritmo para a situação de ruído, desativando-se a função direcional

dos microfones. Os pacientes foram divididos em dois grupos; observou-se

desempenho semelhante entre eles e entre os circuitos avaliados. A preferência por

cada tecnologia ficou dividida de forma equivalente entre os indivíduos (50% para

cada tecnologia – analógica versus digital). As dificuldades da situação de teste

(ruído competitivo, não utilização da leitura orofacial) não possibilitaram a obtenção

de escores elevados.

Descritores: adaptação; amplificação; comunicação; inteligibilidade; perda auditiva;

prótese auditiva; ruído; som.

4

Abstract

The goal of this research was to verify, through the speech in noise

recognition index, if experienced analog hearing aids users might have a good

acclimatization with digital instruments. Twelve people with binaural hearing loss

(from mild to profound) were evaluated. The testing procedure was a repetition of

sentences, which were presented by a CD with a competitive noise (SNR 0 dB). First

the procedure was done with the patient’s hearing aid(s) and then with the digital

instrument, after an interactive fitting procedure. The noise algorithm was selected in

the digital instrument, with the deactivation of the directional microphones function.

The subjects were divided into two groups; similar results were observed among the

groups and the technologies. Fifty percent of the patients preferred the analog circuit

and fifty percent the digital one. Low scores were obtained because of the difficult

testing conditions (competitive noise, no lip-reading).

5

Introdução

O ato de comunicar acontece quando partilhamos com alguém informações,

pensamentos, idéias, desejos e aspirações. A comunicação por meio da linguagem

falada é considerada um ato social fundamental, pois responde à necessidade vital

do homem na busca de novas experiências e conhecimentos (RUSSO,1999).

Podemos dizer que o homem é um ser que se comunica primordialmente pela

linguagem verbal, portanto problemas na recepção do som podem dificultar a

comunicação e a interação entre o homem e o seu meio. A deficiência auditiva pode

trazer diversas conseqüências sobre a vida social, emocional e sobre as habilidades

de se comunicar de um indivíduo. Os prejuízos tornam-se ainda mais graves quando

o indivíduo permanece por longos períodos em privação sensorial, sem acesso a

nenhum tipo de processo terapêutico.

Em alguns casos um dos processos terapêuticos indicados seria a

reabilitação auditiva por meio de aparelhos de amplificação sonora. Um aparelho

auditivo irá amplificar os sons visando recuperar, ainda que parcialmente, a

qualidade de recepção dos sons e, indiretamente, melhorar a inteligibilidade da fala

e a comunicação.

Apesar dos avanços tecnológicos nos últimos anos, os aparelhos auditivos

ainda apresentam limitações, principalmente os de circuito mais simplificado, como

os analógicos (IÓRIO et al, 1996).

Com o advento dos aparelhos de circuito digital, muitos progressos foram

obtidos em termos de flexibilidade de ajustes e adaptação. Estes equipamentos

oferecem programações múltiplas, adaptáveis a diversos tipos de ambiente e

necessidades auditivas.

6

Uma das queixas mais freqüentes dos usuários de aparelho auditivo é o

desempenho em ambientes ruidosos (BONALDI & ALMEIDA,1996; ASHA (American

Speech-Language-Hearing Association),1997; COSTA et al,1999; HODGSON,1999;

BORGES et al, 2002). A inteligibilidade fica prejudicada devido à captação, pelo

aparelho auditivo, não só do sinal de fala, mas também dos sons ambientais.

Observar se os aparelhos com processamento de sinal digital apresentam

maior eficácia em ambientes ruidosos, sendo capazes de atingir bons níveis de

inteligibilidade de fala pode ser um caminho para constatar de que forma o sinal

processado de forma digital colabora para melhorar a inteligibilidade da fala. Assim

poderemos verificar se é pertinente o dado da dificuldade de adaptação de

aparelhos de circuito totalmente digital em usuários de circuito analógico.

Diante deste fato surgiu o interesse por esta pesquisa cujo objetivo é

determinar através do índice de reconhecimento de fala em presença de ruído, se os

usuários adaptados a aparelhos auditivos analógicos teriam adaptação com

aparelhos de circuito digital.

7

Métodos

Foram avaliados 12 pacientes de ambos os sexos, com idades entre 59 e 85

anos, com perdas auditivas que variavam de grau leve a profundo, segundo a

classificação de DAVIS & SILVERMANN (1970), apud RUSSO & SANTOS (1993),

usuários de próteses auditivas analógicas, satisfatoriamente adaptados pelo setor de

Fonoaudiologia de uma empresa de aparelhos auditivos, no período entre outubro

de 2001 e novembro de 2002.

Foram excluídos crianças, pela complexidade do método de teste, usuários

de próteses auditivas intracanais, pela inviabilização da confecção de aparelhos

intracanais digitais para teste e ainda aqueles usuários de próteses retroauriculares

de outros fabricantes que não a Phonak, uma vez que realizamos a pesquisa dentro

das instalações de seu distribuidor exclusivo no Brasil.

Foram adotados os seguintes procedimentos:

1) Audiometria: foram utilizadas as audiometrias cadastradas nas fichas dos

pacientes como base para o ajuste inicial dos aparelhos, assim como seus

próprios moldes. Estas foram registradas dentro do programa Noah,

versão 2.00 a.

2) Prescrição do aparelho digital: Os aparelhos foram indicados com base na

regra de ganho Desired Sensation Level (DSL) e programados pelo

software Phonak Fitting Guideline (PFG), versão 7.3, da empresa Phonak,

fabricante das próteses em questão.

Dentro deste software foi realizado o teste Loudness Perception Profile

(LPP), ou seja, perfil de percepção da sonoridade, com o auxílio da active

response unit (ARU), isto é, uma unidade de resposta ativa (Anexo 1).

Tratava-se de uma escala com graus de sensações que foi manipulada

8

pelo paciente para classificar os estímulos sonoros de diversas

freqüências e intensidades que lhe foram apresentados através da prótese

auditiva.

3) Testar a habilidade de reconhecimento de fala frente ao ruído: Foi utilizado

o compact disc de sentenças em Português com ruído de espectro de fala

ao fundo com relação sinal-ruído de 0 dB, de COSTA (1998), reproduzido

por um discman, de marca Sony, com caixas acústicas a um metro de

distância do usuário, posicionadas a 0º azimute, em sala acusticamente

tratada, nas seguintes situações:

-

Com a prótese analógica do próprio paciente.

-

Com o aparelho digital Phonak: foram utilizados, dependendo do

grau de perda auditiva, os modelos Claro 211 dAZ ou Claro 311

dAZ, ambos apresentando o sistema Audiozoom, que reduz

significativamente a captação de ruídos ambientais, através da

utilização da direcionalidade de microfones.

Foi desativada a função direcionalidade de microfone (Audiozoom) e

quantificado o desempenho proporcionado apenas pelo circuito digital,

utilizando para isso o programa para ambientes ruidosos, ou seja, o Noise

Adapt, programa 2.

Verificou-se se haveria diferenças significativas e se o paciente relatou

melhora da qualidade sonora com o circuito em teste. As respostas foram

anotadas.

Ética: esta pesquisa foi avaliada e aprovada pelo Comitê de Ética em

Pesquisa do Centro de Especialização em Fonoaudiologia Clínica (CEFAC),

9

sob o processo de número 150/02 e considerado sem risco e com

necessidade do termo de consentimento livre e esclarecido (Anexo 2).

Estatística: 1. As análises estatísticas foram realizadas através da

aplicação do Teste t de Student para Proporções, do Teste t de Student e do

Teste t de Student para Dados Pareados. 2. Para a aplicação dos testes

estatísticos adotamos o nível de significância de 5% (0,050).

10

Revisão de Literatura

I - Percepção Auditiva:

A Audiologia é a ciência que avalia / estuda a audição e tem sua base

científica na Psicoacústica (RUSSO 1993, 1997).

Segundo HUMES (1999), a Psicoacústica seria um campo dentro da

Psicofísica. Esta, por sua vez, seria o estudo da relação existente entre o estímulo

físico e a sensação produzida no sujeito. Na Psicoacústica temos o sinal acústico

como estímulo aliado à uma sensação auditiva.

Conforme afirmam RUSSO & SANTOS (1993) e RUSSO (1997), a

Psicoacústica irá lidar com as sensações do indivíduo no que diz respeito à

freqüência (pitch), à intensidade (loudness) e em relação a ruídos, vozes humanas,

sons musicais. Relaciona-se à habilidade dos ouvintes em perceber diferenças entre

os estímulos e não diretamente com os mecanismos fisiológicos que servem de

base para a detecção/diferenciação dos sons, mas com relatos dos ouvintes sobre

eles.

RUSSO (1997) afirma que a percepção auditiva envolve a recepção e

interpretação dos sons através da audição, constituindo-se num processo complexo

que faz parte do processamento auditivo central.

Para LAZKY & KATZ (1983), apud KATZ & TILLERY (1997), a percepção

auditiva trata-se do que fazemos com o que ouvimos, ou seja, é a forma como

utilizamos efetivamente a informação auditiva. Visto que a percepção auditiva faz

parte do processamento auditivo central, KATZ & WILDE (1999) afirmam que o

processamento auditivo refere-se ao modo como aplicamos nosso conhecimento

11

para entender melhor a mensagem e como integramos e associamos a informação

auditiva com estímulos visuais e outros estímulos sensoriais.

Segundo RUSSO & BEHLAU (1993), os principais componentes da

percepção auditiva podem ser assim definidos:

1- detecção: ocorre quando pelo menos um dos componentes tonais situa-se

entre 20 e 20.000 Hz, com amplitude suficiente para estimular

eletricamente o nervo auditivo.

2- sensação sonora: trata-se da impressão subjetiva causada pelo som, em

termos de freqüência, intensidade e qualidade.

3- discriminação: processo de distinção de sons acusticamente similares,

porém com freqüência, duração e/ou intensidade diferentes.

4- localização: é a definição da origem da fonte sonora, a partir das

diferenças interaurais de tempo, fase e intensidade dos estímulos que

atingem as orelhas.

5- reconhecimento: identificação de dados sensoriais com base em

experiências anteriores.

6- compreensão: seria a interpretação de uma nova combinação de modelos

sonoros reconhecidos.

7- atenção: focalização num determinado sinal acústico, dando prioridade

sobre outros estímulos concomitantes, de modo a atribuir-lhe significado.

8- memória: capacidade de reter, armazenar e evocar informações, através

de mecanismos de associação.

A partir destes conceitos básicos poderemos compreender como se dá a

percepção auditiva da fala.

12

II - Percepção Auditiva da Fala:

RUSSO & BEHLAU (1993) afirmam que a percepção dos sons da fala

envolve um sistema complexo de interação onde não podemos considerar somente

a detecção de sinais acústicos. Por serem mais complexos do que os sons utilizados

na avaliação audiológica, estes sons precisam ser identificados, categorizados e

reconhecidos.

Segundo SCHOCHAT (1997), para a percepção dos sons da fala são

necessários um sistema auditivo perceptual periférico e mecanismos de codificação

central intactos.

A percepção da fala apresenta algumas etapas, iniciando-se com a detecção

do som (audibilidade). Em seguida temos a recepção da informação, a

discriminação, o reconhecimento, a memória e a compreensão da mensagem

(RUSSO & BEHLAU, 1993).

LURIA (1979), apud PEREIRA & ORTIZ (1997), diz que a memória não verbal

permite a distinção entre prosódia, altura, intensidade e timbre, tendo influência no

sistema de aprendizagem dos códigos sonoros da língua, já a memória verbal teria

influência no sistema de aprendizado do conteúdo lingüístico da língua, sendo

essencial para a compreensão da mensagem.

KEITH (1982), apud RUSSO & BEHLAU (1993), ainda cita três fatores

participantes do processo lingüístico e cognitivo na recepção de um sinal de fala:

análise-síntese, seqüenciação e fechamento auditivos. Descreve a análise-síntese

como sendo a decomposição/integração das informações recebidas, a seqüenciação

como a capacidade de ordenar estímulos sonoros e o fechamento como a

reconstrução da mensagem sonora, quando parte dela foi omitida.

13

O desenvolvimento das habilidades auditivas depende de uma capacidade

biológica inata do indivíduo e também da experienciação no meio em que se insere

(PEREIRA & ORTIZ, 1997).

Segundo RUSSO & BEHLAU (1993), existe uma redundância de pistas

acústicas das quais o ouvinte deve lançar mão, de acordo com a situação e o

contexto, para que haja a efetividade da transmissão da mensagem. Elas afirmam

que a energia do sinal de fala deve ser audível e os elementos acústicos passíveis

de discriminação, envolvendo a segmentação em unidades menores, que serão

armazenadas na memória, para comparação, reconhecimento e compreensão.

SANDERS (1982), apud COUTO & LICHTIG (1997), considera a redundância

resultante da interação de fatores inerentes:

-

ao falante: obediência às regras da linguagem, vocabulário e

obediência aos padrões de articulação e entonação;

-

à mensagem: número de sílabas e palavras, contexto, repetição,

freqüência e intensidade do sinal acústico;

-

ao ambiente: ruído, reverberação e outros estímulos ambientais;

-

ao ouvinte: familiaridade com regras lingüísticas, vocabulário,

assunto abordado e fidelidade de recepção do sinal.

Segundo COUTO & LICHTIG (1997), quando a intensidade do sinal de fala é

distorcida ou reduzida, quando há por exemplo reverberação ou ruído, se o ouvinte

estiver familiarizado com o contexto da informação, terá capacidade de predizer o

que virá posteriormente.

RUSSO & BEHLAU (1993) relatam que para um ouvinte compreender a fala

são necessários processos supra-liminares, relacionados com os seguintes fatores:

14

1) Atenção à mensagem:

Os centros processadores do cérebro recebem informações captadas

continuamente pelos órgãos sensoriais e o comportamento de atenção é quem

toma as decisões e as executa. Aqui distinguimos o ouvir do escutar. O

primeiro refere-se à detecção e o segundo envolve a atenção, visando atribuir

significado à mensagem falada.

2) Intensidade da mensagem:

Esta varia inter e intra-falante e intra-mensagem, implicando em constante

mudança do nível de pressão sonora que atinge o ouvido. FLETCHER (1953),

apud RUSSO & BEHLAU (1993), demostrou que o nível numa conversa

espontânea varia entre 46 e 86 dB NPS, com média de 65 dB NPS, a um metro

de distância do falante.

Torna-se fácil concluir que quanto mais fácil a compreensão da mensagem,

menor será o nível de sensação necessário para o ouvinte.

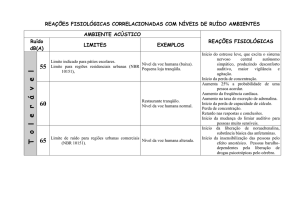

3) Intensidade do ruído:

Existe um limite de ruído que favorece uma boa recepção. O ideal seria um

ambiente com ruído máximo de 30 dB NPS, pois com níveis acima deste,

mesmo em ambientes com presença de mensagem falada amplificada, não

teremos uma compreensão adequada (HODGSON, 1986, apud RUSSO &

BEHLAU, 1993).

Porém sabemos que, em geral, esta não é nossa realidade habitual de

comunicação.

Acrescenta-se a isto o fato de alguns ambientes serem reverberantes, isto é,

a energia sonora continua no ambiente, mesmo após a cessação do estímulo

produzido pela fonte. Ambientes espelhados ou com azulejos são alguns

15

exemplos. Sendo assim, quanto maior o tempo de reverberação, menor a

inteligibilidade, independente da intensidade da mensagem.

4) Tipos de material de fala:

Como a comunicação não se restringe à uma somatória de vogais e

consoantes, o material de fala diz respeito à complexidade do vocabulário

utilizado, à construção sintático-semântica, à redundância da mensagem e à

familiaridade com o tópico em questão.

5) Coarticulação e fatores supra-segmentais:

Como não falamos através de um encadeamento de sons isolados, as

configurações para a produção de um som não se realizam completamente a

cada som. Na mudança dos articuladores existe uma sobreposição de gestos

motores que geram desvios e antecipações de movimentos da musculatura, de

acordo com o contexto. A isto chamamos coarticulação. (STEVENS & HOUSE,

1963, apud RUSSO & BEHLAU, 1993). Além desta, oferecem pistas adicionais

os fatores supra-segmentais, como: aumento na duração da sílaba tônica,

queda na freqüência fundamental, pausas no discurso...

6) Sensação de Freqüência (pitch):

Estudos já demonstraram que o ouvido humano é sensível às diferenças de

freqüência. Na maior parte das freqüências audíveis (20 a 20.000 Hz) podem

detectar-se mudanças de freqüência de 1%, aproximadamente (RUSSO,

1993).

No Português brasileiro, a voz do falante masculino apresenta freqüência

fundamental em torno de 105 Hz e 213 Hz para o sexo feminino. Em geral, os

sons da língua distribuem-se entre 400 e 8.000 Hz, levando-se em

16

consideração vogais e consoantes. As vogais concentram maior energia,

decrescendo até 30 dB nas consoantes mais agudas.

7) Sensação de Intensidade (loudness):

Trata-se da sensação que temos com relação a um som, ou seja, se o

consideramos forte ou fraco. Esse julgamento de sons da fala sofre influência

da intensidade do som, da freqüência do sinal acústico e da qualidade da voz.

RUSSO (1993) diz que precisamos de pelo menos 1 dB de intervalo para que

notemos diferença na intensidade de um som.

As vogais são mais intensas do que as consoantes e sua energia acústica se

concentra na maior parte em freqüências baixas (400 a 500 Hz). Apesar disto, a

inteligibilidade depende pouco desta contribuição, ou seja, depende mais dos sons

consonantais, cuja energia é pequena e se concentra na faixa acima de 2.000 Hz.

(Ver gráfico com valores acústicos médios de freqüência e intensidade dos sons da

fala do Português brasileiro, dispostos no registro gráfico do audiograma - retirado

de RUSSO & BEHLAU, 1993. Anexo 3). Assim, a energia de fala concentrada

nestas freqüências (agudas) é cerca de 20 a 35 dB mais fraca do que a concentrada

em freqüências graves. Isto explica o fato de pessoas com perdas auditivas em

freqüências altas terem dificuldade de discriminação, principalmente em ambientes

com ruído competitivo.

MILLER & NICELLY (1955), apud RUSSO & BEHLAU (1993), relatam que,

abaixo de 500 Hz, a contribuição para a inteligibilidade da mensagem é de apenas

5%, embora 60% da energia se concentre nesta área. Já nas freqüências entre 500

e 1.000 Hz, a energia e a inteligibilidade situam-se em torno de 35%. Por fim, acima

de 1.000 Hz encontram-se 5% de energia acústica, que serão responsáveis por 60%

da inteligibilidade da mensagem.

17

8) Fatores temporais, ritmo e velocidade de fala:

Nos falantes de uma língua, um elaborado sistema de controle temporal

governa a duração específica de cada elemento da fala e o encadeamento

entre eles. Esse fatores temporais devem ser especificados para que a sílaba

seja passível de análise. O ritmo e a velocidade referem-se à agilidade de

encadear os ajustes motores e têm relação com o tempo interior e rapidez

mental do falante. Se estiverem alterados irão comprometer a efetividade da

transmissão da informação.

9) Qualidade vocal do falante:

Relaciona-se à impressão criada por uma voz e depende da composição dos

harmônicos da onda sonora. Desvios nesta qualidade, como processos

disfônicos, por exemplo, reduzem as chances de sucesso do ouvinte.

10) Articulação e pronúncia:

O padrão articulatório do falante é um dos fatores que influenciam o sucesso

da compreensão da mensagem. Se este for travado ou indiferenciado

dificultará a tarefa do ouvinte. Se um falante apresentar um determinado

sotaque e o ouvinte não estiver familiarizado com esta pronúncia, poderemos

ter novamente comprometida a compreensão do sinal de fala.

Diante de tudo isto, devemos concordar com PENROD (1999), quando ele diz

que o aspecto mais importante a ser verificado na função auditiva é a habilidade

para compreender a fala, visto que é essencial para a maioria das atividades da

vida e um pré-requisito para a participação completa em nosso mundo sonoro.

A logoaudiometria convencional usa listas de palavras usuais e comuns na

língua, de modo a observar como o ouvinte detecta, recebe, discrimina e

18

reconhece o material apresentado em situação controlada acusticamente (RUSSO

& BEHLAU, 1993), ou seja, avalia a função comunicativa receptiva do ouvinte.

19

III – Percepção Auditiva da Fala no Ruído:

KATZ & TILLERY (1997) afirmam que o sistema auditivo nervoso central é

bastante complexo, tendo seus núcleos, centros e vias distribuindo-se por todo o

tronco cerebral e por várias regiões do cérebro. Devido a isto não seria de se

espantar que as disfunções de percepção auditiva possam estar associadas a várias

desordens, direta ou indiretamente.

O limite da normalidade auditiva normalmente é considerado entre 20 e 25 dB

NA (“decibéis nível de audição”). Valores acima destes indicam que o indivíduo

apresenta uma perda auditiva que pode variar de grau leve a profundo. Estes

indivíduos, segundo SCHOCHAT (1997), apresentam um processamento auditivo

periférico deficiente.

Uma

das

grandes

dificuldades

associadas

às

perdas

auditivas

neurossensoriais é a inteligibilidade em ambientes ruidosos (BONALDI &

ALMEIDA,1996; ASHA,1997; COSTA et al,1999; HODGSON,1999; BORGES et al,

2002).

COUTO & LICHTIG (1997) relatam que foi a partir da década de 60 que se

iniciaram os estudos do efeito do ruído sobre a inteligibilidade de fala.

Para estas autoras, um som complexo será interpretado como ruído

dependendo dos efeitos causados em determinado momento e local, e ainda

segundo suas características físicas. Um som considerado agradável num dado

momento poderá ser considerado desagradável numa outra ocasião. Para a

mensuração do nível de ruído num ambiente, utiliza-se o medidor do nível de

pressão sonora, com a escala de referência “A”, por ser a que corresponde melhor à

faixa de freqüência do ouvido humano.

20

COUTO & LICHTIG (1997) ainda acrescentam que um ruído será considerado

aceitável quando não causar desconforto nem interferência nos sinais de fala entre

os ocupantes de um recinto. Dados da ASHA (1997) informam que o ruído deve ser

inferior ao sinal de fala (pelo menos de 25 a 30 dB) para uma maior inteligibilidade.

Os que mais sofrem com o problema de inteligibilidade em ambientes com

ruído competitivo são os portadores de perda auditiva neurossensorial com queda

em freqüências altas e os indivíduos idosos.

Os portadores de perda auditiva “em rampa de esqui” são prejudicados

porque é nesta região onde apresentam a maior perda que se concentra a maior

parte da energia acústica das consoantes. Além disto, as consoantes geralmente

são emitidas com menor intensidade em relação às vogais (SCHOCHAT, 1997).

Já os idosos, em sua maioria, encontram, com o passar dos anos,

dificuldades auditivas. Para eles a pior conseqüência da perda auditiva é a grande

deficiência gerada na comunicação, levando-os ao isolamento e causando impacto

psicossocial profundo, como afirma RUSSO (1999).

SCHOCHAT (1997) relata que há uma deterioração do desempenho no ruído

com a idade, havendo ou não decréscimo nos limiares auditivos. Esta situação fica

ainda mais crítica quando se soma à esta o fato de o interlocutor utilizar uma

velocidade de fala acelerada, pois o idoso requer um tempo maior para processar a

fala. Portanto, a perda de pistas acústicas diminui as chances de se entender a fala.

WEINSTEIN (1999) afirma que os idosos necessitam de uma relação sinalruído mais favorável para atingir 50% de reconhecimento em alguns materiais de

fala, pois freqüentemente o ruído de fundo tem maior energia do que a fala.

KATZ e TILLERY (1997) dizem que a experiência de se entender uma

conversa em uma sala ruidosa é uma tarefa complexa que necessita de atividades

21

sofisticadas do sistema auditivo. Nas situações de ruído ambiental é que o indivíduo

deve utilizar as redundâncias para facilitar sua compreensão, ou seja, pistas

acústicas (como a duração dos sons), pistas sintáticas, semânticas, morfológicas e

léxicas (SCHOCHAT, 1997).

Um estudo de BERGMAN (1971), apud RUSSO (1999), revelou que quanto

mais idoso é o indivíduo maior é a dificuldade no desempenho de tarefas que exijam

separação e reconhecimento de palavras, ou seja, com a idade a taxa de

processamento de informação é reduzida, revelando uma deterioração no

desempenho comunicativo do indivíduo.

Além do mais, sabemos que com o envelhecimento, além dos problemas

auditivos, temos uma deterioração de memória. Esta memória encontra-se mais

prejudicada com relação aos sons da fala do que para tons puros, alterando-se

ainda mais se o indivíduo estiver em ambiente com ruído.

SCHOCHAT (1997), KATZ & TILLERY (1997) relatam que têm encontrado

casos de memória de curto prazo pobre associada à dificuldade de bloquear o ruído

de fundo. Acredita-se que haja uma relação indireta desta memória imediata com a

habilidade de escutar frente ao ruído, provavelmente pelo fato dessas funções

serem desempenhadas em regiões cerebrais próximas.

ISAACSOM & PRIBRAM (1986), apud KATZ & TILLERY (1997), afirmam que

um dos principais centros de memória no cérebro é o hipocampo, na porção mesial

inferior do lobo temporal anterior. KATZ & SMITH (1991), apud KATZ & TILLERY

(1997), concluíram que déficits severos de fala frente ao ruído também estão

associados ao lobo temporal anterior. Assim, por uma questão anatômica, ao se

descobrir uma alteração geralmente outras serão encontradas.

22

É importante salientar aqui que mesmo indivíduos com perdas auditivas de

grau leve apresentam dificuldade de compreensão frente ao ruído ambiental, uma

vez que a audibilidade de alguns sons do Português brasileiro se encontra em níveis

inferiores ao limiar considerado de normalidade (RUSSO & BEHLAU, 1993).

Diante do registro gráfico no audiograma dos sons do Português brasileiro

(Anexo 3), temos uma idéia aproximada do impacto na comunicação que uma perda

auditiva causa (RUSSO & BEHLAU, 1993).

Não é difícil chegarmos à conclusão de que as dificuldades de

inteligibilidade no ruído em portadores de perda auditiva, associadas às deficiências

de memória nos idosos, levem estes indivíduos ao isolamento, fazendo com que

reduzam a comunicação e relações interpessoais, levando-os à sensação de

frustração e conseqüentes problemas psicológicos.

Avaliar o reconhecimento de fala de indivíduos com perda auditiva

neurossensorial não é tarefa fácil, porque este processo (discriminação) já é

complexo por si só. Dizemos que um som é inteligível quando se compreende seu

significado, e, para que isto ocorra, devem se levar em conta características

acústicas do ambiente (SCHOCHAT, 1997).

SCHOCHAT (1997) ainda afirma que embora a audiometria tradicional nos

informe dados com relação à perda auditiva, não consegue descrever como a

mesma interfere na performance comunicativa do indivíduo. Normalmente obtém-se

dados sobre a comunicação dos pacientes por meio de entrevistas, questionários e

testes de fala no silêncio, que não demonstram a realidade do dia-a-dia. Muitas

vezes obtém-se bons resultados, embora a reclamação do paciente seja a de que

ouve, mas não entende a fala. Estudos como o de FERRO (2000) demonstram que

23

o desempenho no silêncio é bem melhor do que o obtido em ambientes ruidosos,

tanto na situação sem amplificação quanto com amplificação.

PENROD (1999) sugere que em pacientes com habilidade de discriminação

severamente reduzida apliquem-se sentenças e não monossílabos, visto que

fornecem dados sobre o uso funcional dos resíduos auditivos e por serem menos

frustrantes para o paciente, já que possibilitam melhores resultados.

WEINSTEIN (1999) defende a importância de se avaliar como o indivíduo

funciona nas situações de escuta diária.

Daí concluirmos que avaliar o sujeito em exposição a ruído competitivo seja a

melhor alternativa, pois muitas vezes é a situação mais freqüente e, com certeza, a

que oferece maior dificuldade. Segundo SCHOCHAT (1997) este tipo de teste mede

a habilidade do ouvinte em fazer fechamento auditivo.

Diante do exposto concluímos que a avaliação auditiva é de suma

importância, pois detectar, tratar e acompanhar perdas auditivas, ainda que de grau

leve, irão nos levar ao nosso objetivo maior, que é maximizar o uso da audição

residual do paciente. Para isso é preciso também que conheçamos as dificuldades

específicas que cada perda auditiva pode acarretar e que, principalmente,

orientemos nosso paciente com relação ao que esperar de um sistema de

amplificação.

É importante esclarecer que o aparelho não irá trazer de volta a audição em

níveis normais, principalmente em ambientes de escura desfavorável (ruído).

Além de tudo não devemos nos esquecer da questão: “até onde uma perda

auditiva neurossensorial pode ser considerada periférica ou com comprometimento

central?” Este é um dado muito importante a ser considerado quando da indicação

24

da prótese auditiva, pois os aparelhos de amplificação sonora tentam compensar a

perda periférica e não os déficits centrais da audição (SCHOCHAT, 1997).

Mesmo com todos os avanços tecnológicos obtidos nas próteses auditivas, o

paciente pode continuar experienciando dificuldades em determinados ambientes. É

aí que se encontra o papel essencial do audiologista em orientar o paciente e a

família, fornecendo pistas que o auxiliem a obter melhores resultados com seu(s)

aparelho(s) auditivo(s).

GIOLAS (1999) sugere algumas diretrizes de orientação, a fim de se buscar

melhores níveis de inteligibilidade:

-

tentar buscar um ambiente com o menor nível de ruído possível

(reduzindo o volume da música, fechando a porta para diminuir o

barulho vindo de outros ambientes, entre outras coisas);

-

posicionar-se próximo ao(s) falante(s), de preferência de frente a

ele(s);

-

sempre que possível limitar o número de interlocutores. É mais fácil

conversar com uma pessoa do que com um grupo;

-

buscar lugares mais iluminados para manter a conversação, de

modo a facilitar a captação de pistas orofaciais e corporais;

-

solicitar repetição quando não entender algo;

-

ajustar o volume da prótese buscando a melhor recepção sonora;

-

não esconder a deficiência auditiva. Falar sobre o problema e

sugerir que o interlocutor auxilie na sua compreensão;

-

jamais fingir que entendeu algo que foi dito, para não gerar maiores

confusões futuramente;

25

-

se não for possível interromper o falante, pedir que alguém próximo

repita a informação;

-

perder algumas pistas ou trechos é normal. Continuar atento à

discussão pode fazer com que volte a compreender o assunto;

-

encorajar o uso de microfones ou sistemas de amplificação (por

exemplo o FM) por parte dos interlocutores, para melhorar os níveis

de recepção sonora;

-

familiarizar-se com o tópico discutido auxilia na compreensão;

-

manter a calma (sempre);

-

pedir para que o interlocutor não grite e nem exagere na

articulação, pois isto não irá ajudar;

-

o deficiente auditivo deve procurar falar num modelo em que deseja

que as pessoas falem com ele (pausadamente, com intensidade

média e boa articulação).

Seguindo as orientações aqui propostas, o deficiente auditivo poderá facilitar

seu processo de comunicação, inclusive nas situações menos favoráveis, como as

de exposição a ruído competitivo.

26

IV – Próteses Auditivas:

IÓRIO (1998) afirma que, devido à sua importância para a comunicação

humana, a deficiência auditiva tem sido considerada há bastante tempo como uma

doença incapacitante.

Dados da ASHA (1997) nos mostram que de 5 a 10 % das alterações

auditivas encontradas em pacientes adultos não podem ser tratadas de modo

cirúrgico ou medicamentoso. E é nestes casos que os aparelhos de amplificação

sonora têm sua maior indicação.

Segundo COUTINHO (1997), o aparelho de amplificação sonora é um

sistema portátil com certos componentes que amplificam sons, visando habilitar o

indivíduo a utilizar seu resíduo auditivo de modo efetivo, buscando melhorar a

inteligibilidade de fala.

STAAB e LYBARGER (1999) relatam que a mão em concha atrás do pavilhão

auditivo talvez tenha sido o primeiro sistema de amplificação utilizado.

De acordo com IÓRIO et al (1996), a utilização das cornetas acústicas de

origem animal data do século XIII. Já o uso de cornetas acústicas manufaturadas

pelo homem iniciou-se no século XVII.

COUTINHO (1997) cita o histórico do desenvolvimento dos aparelhos de

amplificação sonora individual, segundo BERGENSTOFF (1993):

Época

Equipamento

1700-1800

eram utilizadas cadeiras com trombetas acopladas.

1876

Alexander G. Bell inventou o telefone nos EUA.

1896

começa a ser usada a versão “desktop” do telefone

de Bell, através do qual indivíduos com perda

auditiva recebiam treinamento de fala.

27

1900

surgiu o 1º aparelho auditivo analógico, composto

por microfone de carbono, fones e bateria (que se

encontrava fora do aparelho auditivo).

1920

surgimento da válvula. Os aparelhos auditivos

tornaram-se

mais

potentes,

mas

como

necessitavam de duas baterias, ainda eram muito

grandes e, portanto, não portáteis.

1940-1950

surge o aparelho auditivo convencional (ou de

caixa) devido à miniaturização das baterias.

1950

invenção

dos

transistores,

possibilitando

a

miniaturização dos aparelhos.

1955-1960

novos

transdutores

e

baterias.

Surgem

os

aparelhos retroauriculares e aparelhos embutidos

em

hastes

de

óculos.

Os

retroauriculares

apresentam ganho acústico de 30 a 40 dB.

1960-1970

desenvolvimento

de

circuitos

integrados,

de

aparelhos intra-auriculares e da bobina de indução

(para utilização em conversação ao telefone, entre

outras finalidades).

1970-1975

surgimento

do

microfone

de

eletreto

e

do

manequim KEMAR (Knowles Electronic Manikin for

Acoustical Research).

1975-1980

medição do ganho de inserção e surgimento de

baterias de zinco.

28

1980-1990

maior desenvolvimento dos circuitos integrados,

surgimento do aparelho intracanal e do aparelho

digitalmente programável.

1992

surgimento

do

aparelho

auditivo

com

processamento de sinal digital, o que possibilita a

supressão digital do feedback.

Existem

vários

tipos

de

próteses

auditivas.

As

principais,

conforme

MENEGOTTO et al (1996), são as convencionais ou de caixa, as retroauriculares e

as intra-aurais.

As próteses auditivas convencionais, também conhecidas como de caixa ou de

bolso, são as que possuem o microfone e o amplificador localizados em uma caixa,

presa na roupa do usuário. O receptor é externo e conecta-se à caixa através de um

fio. Pode utilizar um ou dois receptores acoplados a um molde do tipo direto.

Geralmente é indicado para perdas auditivas de grau profundo ou em casos de

limitações motoras consideráveis. Normalmente utilizam-se pilhas do tipo AA ou

AAA.

As próteses auditivas retroauriculares têm todos os componentes inseridos

numa caixa em formato de vírgula, que se adapta atrás do pavilhão auricular. O

aparelho é acoplado ao molde através de um gancho que contorna o pavilhão. São

os mais populares no Brasil, pois se adaptam a qualquer tipo, grau e configuração

de perda auditiva. Possuem espaço para controles internos e externos, possuindo

ainda versão reduzida, chamada de mini-retroauricular. Os maiores utilizam pilha

675 e os miniaturizados pilha 13.

As próteses intra-aurais são as que acomodam todos os componentes

eletrônicos no interior da concha ou meato auditivo externo, graças aos avanços

29

obtidos em termos de miniaturização de peças e circuitos. São as mais aceitas

atualmente por parte dos usuários, devido ao fator “estética”. Essas próteses podem

ser personalizadas, quando montadas dentro do molde do paciente, ou modulares,

quando uma prótese já pronta é adaptada ao molde do mesmo. A localização endoaural do microfone favorece a localização sonora e a ênfase em altas freqüências,

permitindo a utilização de menor ganho neste tipo de AASI (aparelho de

amplificação sonora individual), segundo IÓRIO (1998).

Dividem-se em intra-auriculares, intracanais e peritimpânicas. Segundo STAAB

e LYBARGER (1999), quanto menor a prótese, menor a flexibilidade de controles,

menos numerosos e menores os controles do usuário, menores as modificações

acústicas e menor a pilha.

As próteses intra-auriculares ocupam toda a concha ou a maior parte dela.

Possibilitam maior ganho e circuitos mais complexos (com mais controles internos),

porém ganhos muito elevados são difíceis de se obter devido à proximidade entre o

microfone e o receptor, que freqüentemente leva à realimentação acústica.

Geralmente utilizam pilha 13 e atendem até perdas de grau severo.

As próteses intracanais ocupam o meato acústico externo e atendem a perdas

de grau leve a moderado. Apresentam menor ganho do que as intra-auriculares e

geralmente utilizam pilha 312 ou 10.

Pacientes com dificuldades de destreza

manual podem ter problemas no manuseio deste tipo de aparelho, no que diz

respeito à inserção / remoção e ajuste do controle de volume.

As próteses peritimpânicas atendem ao mesmo grau de perda auditiva que as

intracanais. Utilizam pilha 10 e encontram-se totalmente inseridas no conduto

auditivo externo, devendo ser retiradas com o auxílio de um fio de nylon preso em

seu faceplate. Não possuem controle de volume e requerem menor ganho acústico

30

por estarem mais profundamente inseridas no conduto (aproximadamente 10 dB a

menos, segundo COUTINHO, 1997). Pode ser de difícil manuseio para alguns

pacientes.

Geralmente

apresentam

menor

distorção

e

possibilidade

de

realimentação acústica, melhor localização sonora, facilidade no uso ao telefone e

com fones de ouvido, redução do efeito de oclusão e estética favorecida.

Os componentes básicos de um aparelho auditivo são: microfone(s),

amplificador, receptor e bateria.

O microfone é um transdutor, ele capta e transforma o sinal acústico em um

sinal elétrico equivalente de corrente alternada, que será processado dentro da

prótese (MENEGOTTO et al, 1996). Podemos encontrar um ou dois microfones num

aparelho auditivo e a qualidade final do som amplificado depende da qualidade do

microfone utilizado (COUTINHO, 1997).

Vários tipos de microfone foram utilizados durante o desenvolvimento das

próteses auditivas: de carbono, cristal, magnéticos e cerâmicos. Atualmente o mais

utilizado é o de eletreto, segundo MENEGOTTO et al (1996). Este tipo de microfone,

como nos relata COUTINHO (1997), são vantajosos em relação ao tamanho,

alcance da faixa de freqüência, sensibilidade, relação sinal-ruído e resistência

mecânica. STAAB & LYBARGER (1999) afirmam que o microfone é o principal meio

utilizado para alterar a resposta de freqüência de uma prótese auditiva.

Existem duas categorias de microfone, segundo a sensibilidade com relação à

fonte sonora: os microfones direcionais e omnidirecionais. O primeiro tipo responde

a sons vindos de uma direção específica (ASHA, 1997), possuindo duas aberturas

para a entrada do som. Responde melhor a sons frontais, mais precisamente a 45º

de frente, segundo STAAB & LYBARGER (1999). Favorece a relação sinal-ruído

porque são menos sensíveis a sons vindos de trás, além de terem sensibilidade

31

menor para baixas freqüências, melhorando o desempenho em ambientes ruidosos.

O segundo tipo, os omnidirecionais, possuem apenas uma abertura para a entrada

de som e apresentam uma resposta idêntica para todos os ângulos de incidência da

onda sonora. São os mais utilizados nas próteses atualmente. Podemos dizer que

estes microfones amplificam da mesma forma os sons desejáveis e os indesejáveis,

não sendo muito favoráveis em ambientes ruidosos.

O amplificador da prótese auditiva, segundo CRUZ (2000), tem por finalidade

aumentar a intensidade dos potenciais gerados pelo microfone, estando diretamente

conectado ao receptor. É composto por dispositivos passivos (resistência,

capacitores, entre outros) e dispositivos ativos (transistores ou circuitos integrados),

conforme COUTINHO (1997). Segundo esta mesma autora, os circuitos integrados

(chips), em uma área muito pequena, abrigam grande quantidade de transistores e

componentes.

Segundo STAAB & LYBARGER (1999), os amplificadores dos aparelhos de

amplificação sonora são tipicamente um sistema integrado monolítico (CI) ou um

circuito integrado híbrido, e algumas vezes uma combinação dos dois. Eles afirmam

que o conceito de circuito integrado é aquele no qual todos os componentes do

circuito são construídos dentro de um único bloco monolítico (ou chip). A função

completa do circuito é formada sobre ou dentro de um único material semicondutor

(por exemplo, o silício). Os circuitos híbridos consistem de componentes pequenos e

pontiagudos soldados por técnicas especiais a um modelo de circuito sobre um

substrato de cerâmica com redes ou sobre uma placa de circuito impresso.

COUTINHO (1997) afirma que o amplificador é dividido em três partes: préamplificador, amplificador propriamente dito (onde ficam os controles internos) e

amplificador de saída (ou potência).

32

Existem vários tipos de amplificador, a saber, classe A, classe B, classe D e

classe H.

O amplificador classe A é composto por um único transistor de saída,

geralmente utilizado em próteses de baixo ganho (não mais que 50 dB). O consumo

de bateria é constante e elevado, por isso não é considerado muito eficiente, daí não

ser muito utilizado.

O amplificador classe B, também conhecido com “push-pull”, utiliza dois

transistores e podem tratar separadamente as fases positiva e negativa do sinal

elétrico, sendo posteriormente reunidas no receptor. Apresentam pequena distorção,

sendo utilizados em próteses de maior ganho. Só consomem energia durante a

amplificação, ou seja, o consumo não é constante. É considerado um amplificador

eficiente.

O amplificador classe D tem o chip do circuito de amplificação construído

dentro do receptor. Este circuito integrado (CI) transmite ao receptor sinais de

corrente alternados de intensidade relativamente baixa. Seus componentes são

pequenos, requerem pouco espaço, o consumo é baixo, a distorção é pequena,

oferece boa qualidade sonora e maiores níveis de saída antes da saturação.

MENEGOTTO et al (1996) ainda citam o circuito classe H, que seria um

amplificador de alta eficiência, usado em equipamentos de áudio de alta fidelidade.

Diz-se que apresentam menores níveis de distorção que os amplificadores classe D,

porém são necessários novos estudos para uma melhor análise de suas

características.

O receptor, segundo STAAB & LYBARGER (1999), é um transdutor de saída,

pois converte o sinal elétrico amplificado pela prótese em uma saída acústica. Os

receptores utilizados nas próteses auditivas são magnéticos (MENEGOTTO et al,

33

1996). Conforme afirma COUTINHO (1997), atualmente este é o componente do

aparelho de amplificação sonora que ainda limita uma maior miniaturização dos

aparelhos auditivos, devido ao seu tamanho.

Como qualquer outro equipamento eletrônico, as próteses auditivas precisam

de uma fonte de fornecimento de energia (CRUZ, 2000). A fonte de energia é a

bateria, ou seja, é o reservatório de energia química convertida em energia elétrica

no AASI (COUTINHO, 1997). Ela constitui-se, segundo MENEGOTTO et al (1996),

de dois metais diferentes colocados em um meio químico.

STAAB & LYBARGER (1999) dizem que, quanto maior o ganho e a

necessidade de saída do aparelho, maior deverá ser a capacidade em mAh da pilha,

e conseqüentemente maior será o seu tamanho.

Os principais tipos de pilhas usadas em próteses auditivas são zinco-ar e

mercúrio. As primeiras são ativadas após a retirada do selo protetor que veda o

orifício de entrada do oxigênio. Pode ser estocada por períodos prolongados sem a

perda da qualidade e têm baixo custo financeiro. Já as pilhas de mercúrio têm

durabilidade menor e vêm sendo proibidas por serem poluentes (COUTINHO, 1997).

A temperatura ideal para a estocagem de pilhas é de 25º. Temperaturas muito

elevadas ou muito rebaixadas são prejudiciais à sua durabilidade.

Além dos componentes básicos, as próteses auditivas possuem alguns

controles e entradas alternativas, como bobina telefônica, entrada de áudio, controle

de volume, chave liga-desliga, controle de saída, de tonalidade, entre outros.

A bobina telefônica é um tipo de entrada alternativa, bastante utilizada nas

próteses auditivas. Também é conhecida como bobina de indução. Ao selecionar a

chave “T”, o usuário irá captar somente os sons vindos do telefone, eliminando-se os

sons ambientais (ASHA,1997). Trata-se de um transdutor incorporado ao AASI que

34

pode ser utilizado, além do telefone, para recepção de TV, rádio, em cinemas,

teatros e em salas de aula, mediante indução magnética (COUTINHO, 1997).

A bobina constitui-se, segundo MENEGOTTO et al (1996), de um fio esmaltado

de metal condutor enrolado em um grande número de voltas ao redor de um núcleo

metálico. O campo eletromagnético induz na bobina uma corrente, enviada ao

amplificador. Estas autoras ainda citam que alguns sistemas auxiliares de indução,

como os equipamentos de freqüência modulada (FM), também podem ser

conectados ao AASI através da bobina. Sendo assim, o som captado pelo microfone

é transmitido por sinais de rádio em freqüência modulada para o usuário, via bobina

telefônica.

A entrada direta de áudio, segundo COUTINHO (1997), é uma tomada para

efetuar a ligação direta do sinal de áudio da TV ou rádio, por exemplo, para que os

usuários recebam o som com maior nitidez, sem distorção ou interferências

ambientais. Normalmente a conexão é feita através de um fio, que leva um sinal

elétrico correspondente a uma onda sonora diretamente ao amplificador e depois ao

receptor, que por sua vez irá transmitir a informação (som) ao usuário. Os sistemas

de FM também podem utilizar a entrada de áudio como conexão entre o receptor de

rádio freqüência e a prótese auditiva (MENEGOTTO et al, 1996).

O controle de volume ou potenciômetro permite ao usuário graduar o ganho do

AASI em um nível de audição adequado a cada situação. É um controle externo de

fácil acesso pelo paciente. MENEGOTTO et al (1996) afirmam que não é possível

fazer a estimativa de quanto de ganho é liberado em cada posição do controle de

volume, isto é, no ajuste intermediário não significa metade da capacidade total de

ganho, portanto é mais adequado realizar medidas específicas de ganho na posição

de uso desejada.

35

Não podemos confundir o controle de volume com o controle de ganho, que é

um controle interno da prótese, ao qual o audiologista tem acesso. Este controle

geralmente reduz o ganho de maneira uniforme ao longo da faixa de freqüência do

aparelho (STAAB & LYBARGER, 1999).

Existe também um controle de saída que regula o nível de pressão sonora

transmitido ao usuário. Pode ser feito por sistema de corte de picos ou compressão,

que serão abordados de maneira mais específica posteriormente.

Devemos citar ainda um controle externo, que é a chave liga/desliga.

Geralmente encontramos as opções O -T- M, onde “O” significa desligado (off), “M”

ligado (microfone) e “T” telefone (bobina telefônica). Onde se encontra a combinação

M/T significa que existe a captação de sons tanto do telefone quanto do ambiente.

O controle de tonalidade tem a finalidade de permitir a alteração da faixa de

freqüência do AAS (aparelho de amplificação sonora), dando mais ênfase a graves

ou agudos de acordo com a necessidade. Este controle consiste de uma rede de

filtros, ou seja, capacitores e resistores (STAAB & LYBARGER, 1999).

As principais características eletroacústicas das próteses são basicamente:

ganho, saída e faixa de freqüência. O ganho acústico é a diferença entre o som que

entra e o que sai da prótese, ou seja, segundo COUTINHO (1997), é a amplificação

que o AASI propicia, expressa em “decibéis” (dB). IÓRIO et al (1996) afirmam que é

basicamente uma característica do amplificador utilizado, combinado às regulagens

a que a prótese está submetida.

A saída máxima, ou saturação, é o maior nível de pressão sonora que a

prótese é capaz de produzir, independente do ganho ou sinal de entrada, e consiste

numa função do amplificador e do receptor da prótese (IÓRIO et al, 1996). É

expressa em “decibéis nível de pressão sonora” (dB NPS), podendo variar com a

36

freqüência (COUTINHO, 1997). Tem relação com o nível de desconforto do usuário,

pois deve ser estabelecida abaixo deste ponto.

A faixa de freqüência é a área em que o aparelho efetivamente amplifica.

Normalmente é expressa por seus limites inferior e superior, em “Hertz” (Hz)

(COUTINHO,1997). MENEGOTTO et al (1996) referem que a resposta de freqüência

de uma prótese é a relação de amplificação existente entre as diversas freqüências,

onde se pode observar que algumas freqüências são mais amplificadas do que

outras. Sendo assim, ela terá relação direta com o audiograma do paciente.

Outros dois importantes fatores a serem observados nos aparelhos auditivos

são a distorção e a realimentação. Para STAAB & LYBARGER (1999) a distorção é

a inabilidade de um sistema em transmitir / reproduzir uma forma de onda com

precisão. Refere-se a qualquer característica de sinal presente na saída de um

amplificador e que não estava presente na entrada, ou seja, é uma alteração do

sinal acústico que entra na prótese auditiva, segundo MENEGOTTO et al (1996).

Afirmam ainda que pode ou não afetar a inteligibilidade, uma vez que um aparelho

de amplificação sonora com alto nível de distorção será considerado “barulhento” ou

“com som estranho”.

A realimentação ocorre, ainda segundo estas autoras, quando um sinal de

saída de um circuito é mandado de volta para a entrada do mesmo. Segundo

STAAB & LYBARGER (1999), a realimentação acústica é a mais comum. É causada

por um vazamento direto do som que saiu do AAS, sendo captado pelo próprio

microfone e reamplificado.

Os principais circuitos utilizados nas próteses auditivas são o analógico, o

híbrido e o digital. Daremos maior ênfase aqui ao primeiro e ao último, por serem os

circuitos por nós avaliados nesta pesquisa.

37

As próteses de circuito analógico utilizam o processamento de sinal analógico,

ou seja, utilizam a eletrônica convencional para converter a onda sonora, que foi

captada pelo microfone, em um sinal elétrico equivalente ou análogo (IÓRIO, 1998).

Este sinal que mantém as mesmas características de amplitude, freqüência e fases

será amplificado, filtrado e, posteriormente, convertido em onda sonora pelo

receptor. De acordo com IÓRIO et al (1996), este tipo de circuito apresenta como

vantagens: baixo custo, miniaturização dos componentes, vasto conhecimento sobre

a tecnologia e baixo consumo de energia. Porém é um sistema mais simples,

embora possua alguns ajustes. Irá amplificar todos os sons (fala e ruído) na mesma

proporção. Geralmente são desenvolvidos com uma resposta de freqüência baseada

no audiograma (ASHA , 1997).

As próteses auditivas híbridas, ou digitalmente programáveis, utilizam

amplificação analógica e programação digital, isto é, o processamento de sinal é

analógico e os ajustes são realizados por uma unidade externa (computador) de

forma digital, permitindo novos ajustes sempre que necessário. Possui um ou mais

programas (memórias) que o paciente irá selecionar dependendo do ambiente,

buscando um melhor desempenho. Permitem adaptação a todo tipo de configuração

audiométrica, oferecendo boa qualidade sonora, porém o custo é mais elevado que

o dos aparelhos analógicos.

Os aparelhos verdadeiramente digitais não consistem apenas de seus circuitos

eletrônicos e transdutores, mas também de uma programação para controlar tais

circuitos. O processamento do sinal e seu controle são feitos de forma digital. Um

microfone capta a onda sonora, transformando-a em elétrica. O sinal passa por um

conversor analógico/digital que transforma o sinal elétrico em uma seqüência de

dígitos. Estes são enviados a um microprocessador que efetuará as filtragens e

38

amplificações necessárias. Neste microprocessador o sinal digital é processado pelo

programa de acordo com um ou mais algoritmos. Esta seqüência numérica é

enviada para o conversor digital/analógico, é transformada em sinal elétrico enviado

ao receptor, que irá reproduzi-lo amplificado e convertido em onda sonora (IÓRIO et

al, 1996).

As principais vantagens da prótese digital sobre a prótese analógica são:

capacidade de programação e precisão de ajustes, controle do feedback, redução

do ruído, ajustes automáticos em função das mudanças ambientais, baixa distorção

e excelente qualidade sonora, embora seja ainda a tecnologia que apresenta o

maior custo atualmente.

Para finalizarmos esta pesquisa teórica, abordaremos agora os principais

métodos de controle da saída máxima da prótese auditiva.

Segundo STAAB & LYBARGER (1999), a amplificação linear significa que as

mudanças na saída mantém uma relação direta e constante com as mudanças nos

sinais de entrada, até que se atinja o ponto de saturação da prótese auditiva. Aí

ocorre o corte de picos.

IÓRIO (1998) define o corte de picos como a remoção eletrônica de um

(assimétrica) ou ambos os extremos (simétrica) dos picos de amplitude da corrente

alternada em um nível previamente estabelecido. Acrescenta que qualquer corte de

pico gera distorção, mas que apesar disto a amplificação linear oferece boa

qualidade sonora, se o ganho da prótese não for elevado e a saturação não muito

baixa.

Segundo esta mesma autora, a maioria dos sistemas de amplificação não

linear utiliza alguma forma de compressão, que ela define como um sistema que

reduz automaticamente o ganho da prótese a partir de um determinado nível de

39

pressão sonora de entrada, para evitar um nível de saída excessivamente intenso. O

ganho é então reduzido por outros meios que não o corte de picos.

IÓRIO (1997) cita a compressão por diodo como sendo uma forma de

amplificação não linear que consiste num aumento gradual sempre menor na saída,

a cada aumento na entrada. Aproxima-se do corte de picos tradicional, porém com

ação menos abrupta e menores níveis de distorção.

IÓRIO & MENEGOTTO (1996) chamam a atenção para o fato de que no Brasil

os termos AGC (automatic gain control) e compressão têm sido usados como

sinônimos, porém veremos mais tarde que o AGC nada mais é do que uma das

formas possíveis de compressão.

Para melhor compreendermos como se dá a compressão iremos abordar suas

características estáticas e dinâmicas. Dentre as características estáticas, segundo

IÓRIO (1997), temos:

-

o limiar de compressão, que se refere ao menor nível em que a

compressão é ativada;

-

a área de compressão, que é a área onde a compressão opera;

-

a razão de compressão, ou seja, a razão existente entre a mudança

no nível de pressão sonora de entrada e a mudança no nível de

saída da prótese. Significa a quantidade de compressão do sinal;

Quanto às características dinâmicas, segundo IÓRIO & MENEGOTTO (1996),

temos as constantes de tempo, ou seja:

-

tempo de ataque, que se refere ao tempo que o sistema leva para

chegar a um novo valor de ganho, quando um nível de sinal maior

do que o determinado é detectado no ponto de monitorização. O

ideal é que este tempo seja bem curto;

40

-

tempo de recuperação, que é o intervalo de tempo compreendido

entre e redução do sinal para uma intensidade inferior ao limiar de

compressão e a volta do ganho aos valores pré-compressão.

Para que tenhamos uma boa adaptação protética o objetivo principal deve ser

tornar os sons baixos audíveis, os de fala confortáveis e os sons altos toleráveis.

Para se conseguir diferentes níveis de amplificação para diferentes níveis de entrada

é necessário utilizar um sistema de amplificação não-linear ou com processamento

automático de sinal (ASP),conforme afirma IÓRIO (1999).

Segundo STAAB & LYBARGER (1999), estes circuitos ASP que diminuem o

ganho em níveis altos e/ou aumentam o ganho em níveis baixos sem mudar a

resposta de freqüência da prótese, são os circuitos tradicionais de AGC e

compressão. São denominados circuitos de processamento de sinal com resposta

de freqüência fixa. E os circuitos que mudam automaticamente não só o ganho mas

também a resposta de freqüência do aparelho de amplificação sonora, em função do

sinal de entrada, são definidos como circuitos de respostas de freqüência

dependentes da intensidade, que elucidaremos mais tarde.

Conforme cita COUTINHO (1997), os principais sistemas de compressão com

resposta de freqüência fixa são:

-

Compressão silábica (ou compressão dinâmica ou WDRC): tem

tempos de ataque e recuperação curtos, baixa razão de

compressão e baixo limiar de compressão. Praticamente todos os

sinais de interesse estão sob compressão. Adapta as intensidades

dos sinais ambientais para a área dinâmica reduzida do paciente;

-

Limitação por compressão: tem tempos curtos de ataque, alto limiar

de compressão e alta razão de compressão. Um sinal de fala médio

41

não dispara o sistema de compressão. Este circuito previne que os

níveis de pico excedam o nível de desconforto do paciente;

-

Controle automático de volume/ganho (AVC ou AGC): tem tempo

de ataque e recuperação longos, baixo limiar de compressão e

razão de compressão elevada. Ajusta o ganho em função do nível

de entrada e compensa variações lentas no nível médio de entrada,

ou seja, para o paciente o sinal fica relativamente constante.

IÓRIO (1998) refere ainda uma classificação pelo AGC, quanto ao ponto de

monitorização. O ponto em relação ao controle de volume é que vai determinar o

tipo de compressão usado, ou seja, se o ponto de monitorização estiver antes do

controle de volume, o aparelho de amplificação sonora terá um sistema de

compressão de entrada (AGC – I). Se a localização do ponto for após o controle de

volume, existe uma compressão de saída (AGC – O). No AGC – I o nível de pressão

sonora que ativa a compressão independe do controle de volume. O limar de

compressão é constante, porém o ganho e a saída são alterados pela posição do

controle de volume. No AGC – O, a posição do controle de volume afetará o nível de

ativação da compressão. A variação do controle de volume altera o ganho e o limiar

de compressão, mas não a saída máxima.

Com relação aos sistemas ASP com alteração da resposta de freqüência em

função da intensidade, temos basicamente três tipos. IÓRIO & MENEGOTTO (1996)

os descrevem da seguinte forma:

-

BILL (bass increase at low levels): fornece aumento de resposta

para sons graves em menores níveis de entrada ou diminuição dos

mesmos para níveis elevados de pressão sonora. É descrito como

redutor de ruído, pois parte do princípio que a relação sinal-ruído

42

ambiental é pior para os graves, e quanto maior o nível de pressão

sonora pior esta relação;

-

TILL (treble increase at low levels) : fornece aumento de resposta

para agudos em baixos níveis de pressão sonora de entrada, ou

diminuição da resposta deles em altos níveis de pressão sonora. O

circuito K-AMP é um exemplo;

-

PILL

(programmable

increase

at

low

levels):

proporciona

modificações programáveis na resposta de freqüência do AASI

segundo a entrada, funcionando em mais de uma faixa de

amplificação.

Como

as

faixas

de

processamento

são

independentes, é possível programar tanto um aumento de agudos

como de graves, sem que uma faixa interfira na outra.

43

Resultados

Apresentamos a seguir os resultados encontrados na presente pesquisa, cujo

objetivo foi determinar, através do índice de reconhecimento de fala em presença de

ruído, se usuários adaptados a aparelhos auditivos analógicos teriam adaptação

com aparelhos de circuito digital.

Foram avaliados 12 sujeitos, todos portadores de perda auditiva bilateral,

variando de grau leve a profundo. Destes, nove eram do sexo feminino e três do

sexo masculino, sendo somente estes últimos protetizados bilateralmente.

A média total de idade (entre ambos os sexos) foi de 72 anos e o tempo

mínimo de protetização observado foi de quatro meses.

A avaliação audiológica tomada como base foi a registrada na ficha cadastral

de cada paciente e através dela foi selecionado o modelo de aparelho digital a ser

testado.

Inicialmente o paciente era solicitado a repetir as sentenças, apresentadas

com ruído de fundo, utilizando sua prótese analógica e seu(s) próprio(s) molde(s).

Posteriormente seus dados audiométricos eram cadastrados no software específico

e realizado o teste Perfil de Percepção da Sonoridade, para juntamente com a regra

de prescrição Desired Sensation Level ser estabelecida a amplificação necessária.

Desativava-se a função direcionalidade de microfones e selecionava-se o algoritmo

específico para situações de ruído. Somente então o paciente realizava o

procedimento de repetir sentenças, também apresentadas com ruído de fundo,

utilizando a prótese digital.

Os pacientes foram divididos em dois grupos para uma melhor análise de

resultados e as listas de sentenças utilizadas foram alternadas entre eles.

44

Por fim, os pacientes foram solicitados a referir qual tipo de processamento

apresentou melhor qualidade sonora.

Serão apresentadas a seguir as tabelas com os dados gerais da pesquisa, do

reconhecimento de fala e seus devidos comentários.

número

porcentagem

Significância

Sexo

Masculino

Feminino

3

9

25%

75%

—

Perda auditiva

Unilateral

Bilateral

0

12

0%

100%

—

9

3

75%

25%

3

3

4

2

25%

25%

33,33%

16,66%

6

6

50%

50%

Variável avaliada

Adaptação

Monoaural

Binaural

Tempo de Protetização

Até 12 meses

De 13 a 24 meses

De 25 a 36 meses

Acima de 36 meses

Circuito referido como melhor

Analógico

Digital

0,013

0,842

1,000

Aplicando-se o Teste t de Student para Proporções, encontramos os valores

de significância apontados na tabela acima.

No caso da variável Adaptação, encontramos uma diferença estatisticamente

significante entre os tipos Monoaural e Binaural, indicando que, então, o tipo

Monoaural é mais freqüente do que o tipo Binaural.

Nos casos das variáveis Tempo de Protetização e Circuito referido como

melhor, encontramos uma diferença estatisticamente não-significante entre as

respectivas proporções apresentadas pelas categorias definidoras dessas variáveis,

indicando que, então, tais categorias apresentam proporções semelhantes, para

45

cada uma das variáveis. No caso específico da variável Circuito referido como

melhor, dizemos que a semelhança é total.

Com relação aos níveis de inteligibilidade obtidos:

Média de acerto, em porcentagem, de cada grupo, do reconhecimento de

sentenças com ruído competitivo, na situação AASI analógico:

Estatística

Grupo 1

Grupo 2

Média

25,00%

5,00%

Desvio-padrão

38,34%

8,37%

Significância (p)

0,240

Média de acerto, em porcentagem, de cada grupo, do reconhecimento de

sentenças com ruído competitivo, na situação AASI digital:

Estatística

Grupo 1

Grupo 2

Média

21,66%

15,00%

Desvio-padrão

39,20%

25,10%

Significância (p)

0,733

Aplicando-se o Teste t de Student, observamos que os valores médios das

variáveis AASI analógico e AASI digital apresentam diferenças estatisticamente nãosignificantes, quando comparados considerando-se os grupos estudados, isto é, as

médias aritméticas, para ambas as variáveis, são semelhantes entre os grupos 1 e

2.

Média de acerto, em porcentagem, dos dois grupos, do reconhecimento de

sentenças com ruído competitivo, nas situações AASI analógico e AASI digital:

Estatística

AASI Analógico

AASI Digital

Média

15,00%

18,33%

Desvio-padrão

28,44%

31,57%

Significância (p)

0,474

Aplicando-se o Teste t de Student para Dados Pareados, observamos que os

valores médios das variáveis AASI analógico e AASI digital apresentam diferenças

estatisticamente não-significantes, quando comparados entre si, isto é, as médias

aritméticas de ambas as variáveis são semelhantes.

46

Discussão

No presente capítulo apresentamos a discussão dos resultados encontrados

neste estudo, cujo objetivo foi determinar, através do índice de reconhecimento de

fala em presença de ruído, se usuários adaptados a aparelhos auditivos analógicos

teriam adaptação com aparelhos de circuito digital.

Previamente à realização dos comentários sobre os achados desta pesquisa,

faremos algumas considerações sobre nossas escolhas, como material e método

utilizados.

Já descrevemos anteriormente que a avalição auditiva tomada como

referencial foi a contida na ficha cadastral de cada paciente adaptado pelo Setor de

Fonoaudiologia de uma empresa de aparelhos auditivos.

A linha de aparelhos escolhida para a testagem foi a linha Claro por se tratar

de tecnologia totalmente digital, onde tínhamos a possibilidade de dois modelos,

Claro 211 dAZ e Claro 311 dAZ, dependendo do grau de perda auditiva apresentada

pelo paciente, ou seja, perdas mais leves eram testadas com o modelo 211 dAZ e

perdas mais acentuadas com o modelo 311 dAZ.

A linha de aparelhos Claro possui dois programas básicos, sendo um para

ambientes silenciosos e um para ambientes ruidosos, e ainda um terceiro programa

à escolha do usuário, com opções para música, telefone acústico, bobina telefônica,

entre outros.

O processamento de sinal da linha Claro e a seleção do ganho se dão pelo

sistema

DPP (Digital Perception Processing), que seria o processamento de

percepção digital. Este sistema foi desenvolvido baseado no funcionamento coclear,

visto que analisa e processa o som em faixas de freqüência. Cada estímulo sonoro

será reconhecido em determinada área do sistema e, uma vez detectado o ruído,

47

será processado na área correspondente à sua freqüência e imediatamente

reduzido.

Os aparelhos foram prescritos de acordo com a regra DSL (Desired Sensation

Level) e programados pelo software PFG (Phonak Fitting Guideline). Cada paciente

realizou o teste perfil de percepção da sonoridade, onde estímulos sonoros de

diferentes freqüências e intensidades lhe eram apresentados através do aparelho

digital e ele deveria classificá-los numa escala de sensações. O objetivo deste teste

era produzir algo semelhante a um gráfico do campo dinâmico de audição do

paciente, para, com base nestas informações, calcularmos o ajuste inicial do

aparelho a ser testado.

Inicialmente o paciente foi solicitado a repetir sentenças apresentadas com

ruído competitivo utilizando sua(s) prótese(s) analógica(s) e, após o procedimento

de ajuste da(s) prótese(s) digital(is), a mesma tarefa era realizada com estes

aparelhos, utilizando-se o algoritmo para ambientes ruidosos, isto é, o segundo

programa básico.

Para tal procedimento foi selecionado o CD de sentenças em Português, de

COSTA (1998), por apresentar alto índice de similaridade entre as listas de

sentenças.

É importante destacarmos aqui que a função direcionalidade de microfones

presente nesta linha foi desativada, visto que em muito contribui para a

inteligibilidade no ruído (VALENTE et al, 1995; MAY, 1998; VALENTE, 1998;

PUMFORD et al, 2000; WALDEN et al, 2000; BRAITE & BARCO, 2002.)

Já é de nosso conhecimento que existem três condições prejudiciais à

inteligibilidade do deficiente auditivo: a distância, a reverberação e o ruído

(ASHA,1997) e este último vem sendo a queixa mais freqüente dos usuários de

48

prótese auditiva (BONALDI & ALMEIDA, 1996; ASHA, 1997; HODGSON, 1999;

COSTA et al, 1999; BORGES et al, 2002).

Vários autores afirmam e estudos comprovam a melhor inteligibilidade em

situação de silêncio, comparando-se com a situação de ruído (BLASCA &

BEVILACQUA, 1999; FERRO, 2000; PENTEADO & SANTOS, 2002).

Diante disto decidimos avaliar o desempenho de usuários já adaptados a

circuitos analógicos, frente ao ruído, por ser uma queixa freqüente, sem avaliar a

função direcionalidade de microfones e sem a comparação com o desempenho no

silêncio, visto que vários autores já o fizeram.

Inúmeros pesquisadores têm buscado avaliar e comparar o desempenho de

deficientes auditivos com as tecnologias disponíveis no mercado. É intensa a

divulgação de trabalhos acerca dos circuitos de aparelhos auditivos e o que seus

sistemas podem oferecer nas mais diversas situações.

FERRO (2000) estudou o reconhecimento de sentenças no silêncio e no

ruído, comparando as tecnologias programável e digital em 28 sujeitos novos

usuários de prótese auditiva. Os resultados obtidos revelaram uma melhor

performance do circuito digital em comparação com o programável em ambas as

situações. Sua pesquisa nos faz pensar que a adaptação de circuitos digitais seria

facilitada em novos usuários, visto que não existe uma experiência prévia que possa

interferir na adaptação de uma nova tecnologia, com algoritmos totalmente distintos.

BLASCA & BEVILACQUA (1999) avaliaram o desempenho de três adultos

com aparelhos analógicos e digitalmente programáveis em situação de silêncio e

ruído. Estes já eram usuários experientes de circuito analógico, porém passaram

por processo de experiência domiciliar com as próteses programáveis para esta

pesquisa. Tanto na avaliação específica da fala quanto em situação de vida diária os

49

pacientes alcançaram melhores resultados quando utilizavam o circuito digitalmente

programável. Provavelmente a similaridade do processamento de sinal (analógico)

tenha favorecido uma boa adaptação.

WALDEN et al (2000) compararam a performance de 40 adultos com

aparelhos digitais e aparelhos lineares com AGC-I ou com WDRC em dois canais.

Os aparelhos digitais foram avaliados com microfone omnidirecional, com tecnologia

direcional de multi-microfone e com um algoritmo para redução de ruído combinado

com a tecnologia direcional de multi-microfone. Os participantes da pesquisa eram

usuários experientes de aparelhos lineares com compressão AGC-I ou WDRC.