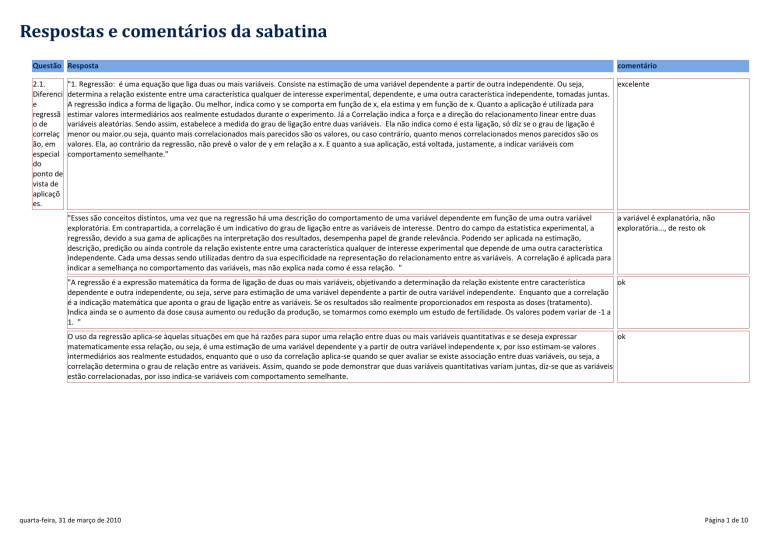

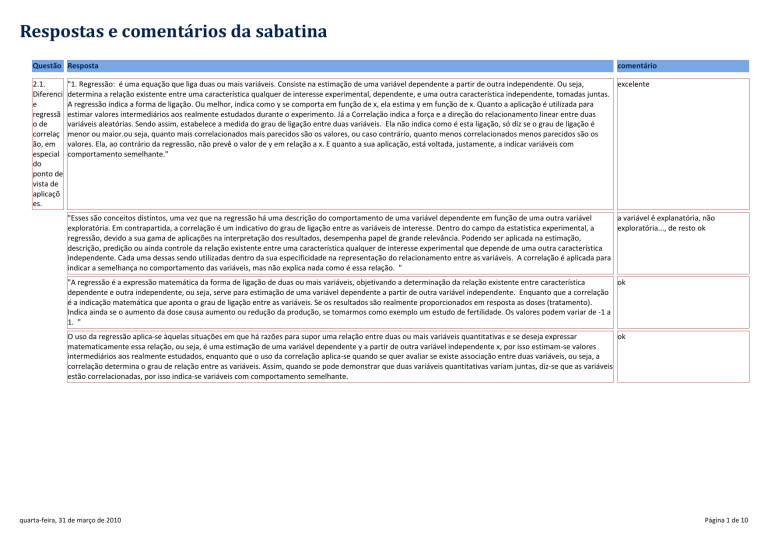

Respostas e comentários da sabatina

Questão Resposta

2.1.

Diferenci

e

regressã

o de

correlaç

ão, em

especial

do

ponto de

vista de

aplicaçõ

es.

comentário

"1. Regressão: é uma equação que liga duas ou mais variáveis. Consiste na estimação de uma variável dependente a partir de outra independente. Ou seja,

excelente

determina a relação existente entre uma característica qualquer de interesse experimental, dependente, e uma outra característica independente, tomadas juntas.

A regressão indica a forma de ligação. Ou melhor, indica como y se comporta em função de x, ela estima y em função de x. Quanto a aplicação é utilizada para

estimar valores intermediários aos realmente estudados durante o experimento. Já a Correlação indica a força e a direção do relacionamento linear entre duas

variáveis aleatórias. Sendo assim, estabelece a medida do grau de ligação entre duas variáveis. Ela não indica como é esta ligação, só diz se o grau de ligação é

menor ou maior.ou seja, quanto mais correlacionados mais parecidos são os valores, ou caso contrário, quanto menos correlacionados menos parecidos são os

valores. Ela, ao contrário da regressão, não prevê o valor de y em relação a x. E quanto a sua aplicação, está voltada, justamente, a indicar variáveis com

comportamento semelhante."

"Esses são conceitos distintos, uma vez que na regressão há uma descrição do comportamento de uma variável dependente em função de uma outra variável

a variável é explanatória, não

exploratória. Em contrapartida, a correlação é um indicativo do grau de ligação entre as variáveis de interesse. Dentro do campo da estatística experimental, a

exploratória..., de resto ok

regressão, devido a sua gama de aplicações na interpretação dos resultados, desempenha papel de grande relevância. Podendo ser aplicada na estimação,

descrição, predição ou ainda controle da relação existente entre uma característica qualquer de interesse experimental que depende de uma outra característica

independente. Cada uma dessas sendo utilizadas dentro da sua especificidade na representação do relacionamento entre as variáveis. A correlação é aplicada para

indicar a semelhança no comportamento das variáveis, mas não explica nada como é essa relação. "

"A regressão é a expressão matemática da forma de ligação de duas ou mais variáveis, objetivando a determinação da relação existente entre característica

ok

dependente e outra independente, ou seja, serve para estimação de uma variável dependente a partir de outra variável independente. Enquanto que a correlação

é a indicação matemática que aponta o grau de ligação entre as variáveis. Se os resultados são realmente proporcionados em resposta as doses (tratamento).

Indica ainda se o aumento da dose causa aumento ou redução da produção, se tomarmos como exemplo um estudo de fertilidade. Os valores podem variar de -1 a

1. "

O uso da regressão aplica-se àquelas situações em que há razões para supor uma relação entre duas ou mais variáveis quantitativas e se deseja expressar

ok

matematicamente essa relação, ou seja, é uma estimação de uma variável dependente y a partir de outra variável independente x, por isso estimam-se valores

intermediários aos realmente estudados, enquanto que o uso da correlação aplica-se quando se quer avaliar se existe associação entre duas variáveis, ou seja, a

correlação determina o grau de relação entre as variáveis. Assim, quando se pode demonstrar que duas variáveis quantitativas variam juntas, diz-se que as variáveis

estão correlacionadas, por isso indica-se variáveis com comportamento semelhante.

quarta-feira, 31 de março de 2010

Página 1 de 10

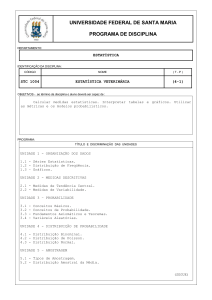

Questão Resposta

2.1.

Diferenci

e

regressã

o de

correlaç

ão, em

especial

do

ponto de

vista de

aplicaçõ

es.

comentário

"1- A regressão consiste em uma expressão matemática da ligação entre duas variáveis. Podemos criar uma regressão, onde teremos “y” sendo uma (variável

excelente

dependente) em função de “x” (variável independente), observando assim o comportamento de “y” em função de “x”. Embora que com base em uma regressão eu

possa igualmente conhecendo “y”, determinar qual é o “x” que causou aquele “y”, sendo expressa da seguinte maneira y = a + bx, onde normalmente vamos ter o

“x”. Já a correlação é um indicador matemático que mede o grau de ligação entre as variáveis, mas não indica nada como seria essa ligação ou quase nada. Ela só

diz se a ligação é próxima ou distante, e quanto mais correlacionada as variáveis mais parecidos serão os comportamentos delas. Enquanto que com a regressão eu

posso dar o valor de “x” e prever qual o valor de “y” para aquele “x”, e com a correlação não se tem a equação matemática entre as variáveis.O uso de aplicação de

correlação seria na substituição de variáveis .Um exemplo em nossa área, seria quando queremos saber qual é a variável fisiológica que determina a faixa de

absorção de nutrientes, onde sabemos que é a epiderme da raiz da planta . Só que neste caso, temos três variáveis que podemos medir a raiz: matéria seca,

comprimento, e área superficial da raiz. Mas a que tem maior relação biológica com absorção de nutrientes seria a área superficial, sendo a mais difícil de se medir.

Aqui, pegamos 100 raízes e medimos a área superficial, então vamos descobrir se existe uma boa correlação entre elas, onde medir a matéria seca de raiz é mais

fácil. Porém se temos uma boa correlação entre a variável mais fácil com a mais difícil, podemos usar a mais fácil no lugar da mais complicada de ser determinada.

Embora biológicamente o que deveria ser usado seria a mais difícil, e apenas como elas estão muito ligadas, o que acontece com a mais difícil (mais trabalhosa)

pode ser substituída pela a mais fácil e fazer a determinação.Outro clássico de regressão em nossa área seria em adubação, onde usa-se a dose econômica, faz a

curva que dá o valor de adubação que vai expressar a máxima produtividade com base no número que se aplica. Quando chegar a 90% da produtividade ,vai ser o

valor mais econômico, onde matematicamente pode-se descrever qual é o pico e qual é o ponto para ter 90% desse produção, sendo o uso direto da regressão"

"A regressão consiste na estimação de uma variável dependente a partir de outra variável independente. O estudo de regressão exerce papel relevante dentro do

ok

campo da estatística experimental, devido a sua larga aplicação na interpretação de resultados experimentais, e tem por objetivo determinar a relação existente

entre uma característica qualquer de interesse experimental, dependente, e outra característica independente, tomadas juntas. A regressão é usada para estimar

valores intermediários dos que forem estudados no experimento onde temos como exemplo doses de nutrientes e o crescimento das plantas, como: diferentes

dosagens de fósforo (independente) para obtenção de maior quantidade de matéria seca (dependente) em qualquer tipo de planta. A correlação determina o grau

de relação entre as variáveis, ou seja, procura determinar a relação quão bem uma equação linear, ou de outra espécie, descreve ou explica a relação entre as

variáveis que poderá ser positiva quando “r” é positivo, ou negativa quando o “r” é negativo, como exemplo: estudar a relação entre cigarros e doenças

respiratórias, calagem e pH, adubação e crescimento das plantas. "

"1) A regressão consiste em estimar uma variável Y (dependente) a partir de outra variável, X (independente). Em outras palavras, a regressão, através de uma

equação (y = a+bx) nos permite verificar se há uma ligação entre estas duas variáveis. Enquanto a correlação visa estimar o grau desta ligação entre as variáveis, ou

seja, o quanto da variação de Y é provocada por X. Se quisermos verificar se ocorre ligação entre duas variáveis (disponibilidade de Molibdênio e produtividade de

uma determinada cultura ou o preço de gasolina e o número de carros abastecidos por dia), faremos uma regressão. Porém, se quisermos avaliar o grau desta

ligação, devemos fazer uma correlação."

a regressão permite indicar COMO é a

ligação entre duas variáveis, enquanto

a correlação avalia se existe esta

ligação através da indicação do grau de

ligação

"Regressão é uma expressão matemática definida pela equação y= a + bx, onde “y” é a variável dependente e “x” a independente, donde y é a função linear do

valor de x e é utilizada para estimar como y se comporta em função dos valores de x. A correlação, diferente da regressão, dá a medida do grau de ligação entre as

duas variáveis, indicando o sentido e o nível dessa variação, podendo ser positiva, negativa ou zero. A regressão é aplicada para estimar valores estudados dentro

de um dado experimento, enquanto que a correlação é aplicada para indicar quais variáveis apresentaram comportamento semelhante. "

ok

Regressão é uma expressão matemática que não implica necessariamente numa relação de causa-efeito, esta ligada com duas ou mais variáveis, correlação é um

ok

indicador matemático do grau de ligação entre duas variáveis. A regressão é aplicada, por exemplo, para estimar valores não estudados dentro de uma faixa

experimental, ou seja, valores entre os pontos estudados. A correlação é usada para indicar variáveis que apresentam comportamento semelhante, por exemplo: a

correlação entre crescimento de plantas e raízes é um bom exemplo de seu uso, sendo a superfície radicular a melhor variável para explicar o crescimento de

plantas, porém mensurar a superfície radicular é difícil e muito trabalhoso, e a matéria seca da raiz apresenta uma boa correlação com a área superficial das raízes,

portanto sendo a matéria seca a variável usada para correlacionarmos com o crescimento das plantas.

O estudo de medidas envolvendo simultaneamente duas ou mais variáveis pode ser estudado através da regressão e correlação. A regressão, uma expressão

ok

matemática, a correlação, uma indicação matemática, que estabelecem relações com estas variáveis. A regressão consiste na ligação, de uma variável dependente

a partir de outra variável independente, possibilitando dessa forma, estimar uma variável dependente partindo do comportamento de uma variável independente.

Percebe-se que do lado prático, de suas aplicações, é possível estimar valores aproximados aos encontrados nos experimentos. Já a correlação determina o grau de

relação entre as variáveis, permitindo dessa forma verificar a existência de proporção entre determinadas doses ou tratamentos, possibilitando enxergar se os

prováveis aumento ou diminuição de produção fora afetado. Esses valores podem variar de -1 a 1.

quarta-feira, 31 de março de 2010

Página 2 de 10

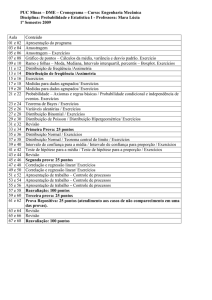

Questão Resposta

comentário

2.1.

Diferenci

e

regressã

o de

correlaç

ão, em

especial

do

ponto de

vista de

aplicaçõ

es.

A regressao é utilizada quando se deseja “ligar” os valores dos tratamentos (X) aos dados analisados (Y), ou seja, uma equação da forma de ligação entre duas

ok

variáveis, como se comporta (Y) em função de (X) ligada. Ex: estudar a relacao entre adubacao e crescimento das plantas. Ja a correlacao indica a intensidade dessa

ligacao, induzindo quanto da variacao de Y é provocada pelo tratamento aplicado (X), isto é, indica se é uma ligação próxima ou distante. Ex: a análise do pH do

solo com relacao ao teor de aluminio no solo.

2.2.

Discuta

a

afirmativ

aa

seguir.

Duas

regressõ

es, com

igual

nível de

significâ

ncia,

apresent

am igual

nível de

importâ

ncia.

"A afirmativa não é plausível. Duas regressões podem apresentar o mesmo nível de significância sem necessariamente possuírem a mesma importância científica.

excelente, até lembrou do coeficiente

De modo geral, a significância é apenas um indicativo da probabilidade de erro na afirmação de um acontecimento, não sendo um indicador de importância

de determinação

científica, assim, em modelos de regressão torna-se mais relevante a avaliação da importância científica do que a significância, uma vez que essa é um indicativo de

quanto da variação total está sendo explicado pelo modelo, ou seja pelo coeficiente de determinação da regressão. Essas considerações permitem intuir que

medidas de significância estatística não são realmente medidas de importância. Por exemplo, a contribuição marginal conjunta ao modelo de duas variáveis

explanatórias aumenta conforme aumenta a correlação entre elas. "

Podemos relacionar que é a diferença entre estatisticamente significativo e cientificamente importante. Quando se tem duas regressões de igual significância, não aleluia, aleluia, aleluiah... Pelo menos

quer dizer que elas tenham o mesmo nível de importância necessariamente. Se tivermos estas duas regressões com uma correlação de 0,1 (altamente

uma pessoa entendeu a minha

significativo), para a área de medicina por exemplo pode ser importante cientificamente, mas esse valor não seria para área de agrárias, porque é um valor baixo. pergunta... Excelente

Pois significância é a chance que eu tenho de está errado ao afirmar que alguma coisa aconteceu. Em agrárias não tem importância discutir a correlação 0,1,

porque é baixa,já para outras áreas como medicina é válido tem importância. Em agrárias 60% de correlação é considerada baixa, deve- se ter valores maiores para

serem discutidos. Quando encontramos uma correlação de 0,1 altamente significativa, é que vai acontecer menos que 1 em 10.000 vezes

"2) Depende da área de conhecimento que está sendo avaliada. Muitas pesquisas na área Médica admitem um nível de significância muito inferior ao que se adota

na área Agrícola, por exemplo. Se compararmos duas sub-áreas da Agronomia (Fitossanidade e Solos), encontraremos valores divergentes, onde provavelmente o

nível de significância adotado pelos cientistas da Fitossanidade será bastante semelhante ao adotado por cientistas da área Médica."

quarta-feira, 31 de março de 2010

nada a ver com a pergunta... Se estou

comparando as regressões elas têm de

ser da mesma área de conhecimento,

não acha?

Página 3 de 10

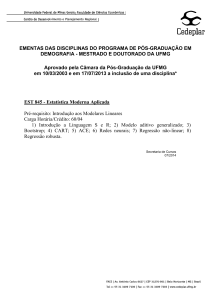

Questão Resposta

comentário

2.2.

Discuta

a

afirmativ

aa

seguir.

Duas

regressõ

es, com

igual

nível de

significâ

ncia,

apresent

am igual

nível de

importâ

ncia.

Não se pode afirmar que duas regressões tenham a mesma importância, mesmo com igual nível de significância, pois para determinadas áreas da pesquisa,

verifica-se que a margem de um nível de significância de 1%, resultado devido ao acaso, pode representar um nível altamente satisfatório; esses casos são vistos

principalmente na nossa área de conhecimento, que usualmente utiliza 5%. Para outras áreas, mesmo tendo um nível de significância tão pequeno, como um nível

de 1% de significância, pode trazer resultados não satisfatórios, principalmente por envolver vidas como as pesquisas na área da saúde. Portanto, do ponto de vista

do nível de importância, aquelas que não se pode dar ao luxo de que aconteça eventos devido ao acaso, como as pesquisas na área da saúde, apresentam maior

importância se comparado a pesquisas na nossa área.

se vou comparar as regressões,

significa que são na mesma área de

conhecimento, lógico. Além disto a

discussão pode ser válida para o nível

de significância, mas não tem nada a

ver com regressão

Não, uma vez que o mais importante é o que esta sendo estudado, ou seja, a importância se deve a área de estudo, por exemplo: em medicina pode ser de

importância este nível de significância, porém na agronomia este nível de significação não seja importante em igual nível.

Faz sentido comparar regressões de

diferentes áreas de estudo?

"Não necessariamente. Determinar um alto nível de significância não causa, obrigatoriamente, a importância cientifica, deve ser avaliado o estudo que está sendo excelente... Pegou bem o espírito da

feito para determinar quanto o grau de significância irá assemelhar-se com o de importância. Em modelos lineares a importância é principalmente definida por:

pergunta

proporção da variância atribuída ao modelo, o tamanho de um ou mais coeficientes de correlação, intervalos de confiança de interesse. Exemplo: encontra-se uma

correlação de 0,1, esta é altamente significativa, devido ao acaso vai ocorrer menos do que 1 em 1000, portanto não tem importância científica em agrárias, porém

em medicina esse valor encontrado é de extrema importância científica. Para exemplificar melhor boa parte dos estudos em agrárias são considerados baixos até

60%. "

Não necessariamente. Vai depende da área de estudo, pois se duas regressões têm o mesmo nível de significância não significa que elas sejam importantes, por

exemplo: se tivermos duas regressões com uma correlação de 0,1 (altamente significativo) não quer dizer que seja importante, pois se levarmos para a nossa área

de estudo não teria importância, tendo em vista que em ciências do solo para que uma regressão tenha importância ela deve ter uma correlação acima de 60%, já

para a medicina uma regressão com uma correlação de 10% seria importante.

excelente

"2. Dependendo da área de aplicação não. Pois, se compararmos duas áreas como as ciências agrárias e a medicina, sabemos que estes resultados serão avaliados

de modo diferente. Já que, nas ciências agrárias , como vimos, por exemplo, um valor de 60% na correlação é considerado baixo. Ao contrário da medicina, onde

uma correlação com valor correspondendo a 10% seria considerado uma valor alto. "

faz sentido discutir a comparação de

regressões de diferentes áreas do

conhecimento? Além disso, a pergunta

foi sobre nível de significância, não

sobre coeficiente de correlação. Ou

seja os níveis de significância é que

eram iguais

Depende, pois mesmo que apresentem o mesmo nível de significância, não quer dizer que obrigatoriamente deva apresentar o mesmo nível de importância,

esta discussão poderia ser válida se a

depende da área de estudo e do que está sendo estudado. Como por exemplo - admitindo-se um nível de 1% de significância - testes de medicamentos que podem pergunta fosse sobre nível de

causar má formação congênita em bebês, é considerado significante estatisticamente e importante, enquanto que este mesmo nível de significância admitido é

significância...

pouco importante na nossa área, como no exemplo testes para novos herbicidas, onde apresentam 1% de chance de não cumprir com seu objetivo, apresenta nível

de importância pouco expressivo.

quarta-feira, 31 de março de 2010

Página 4 de 10

Questão Resposta

comentário

2.2.

Discuta

a

afirmativ

aa

seguir.

Duas

regressõ

es, com

igual

nível de

significâ

ncia,

apresent

am igual

nível de

importâ

ncia.

O nível de significância revelará que a reta determinada como reta de regressão representa com suficiente exatitude a variação de uma das variáveis (séries) em

função da outra. Então, duas regressões, com igual nível de significância, necessariamente não apresentam igual nível de importância. Em modelos de regressão

avaliar a importância científica costuma ser mais importante do que a significância, pois uma regressão pode explicar muito bem uma relação entre variáveis sem

ser significativa. Neste caso, a importância compreende em seu conceito: a proporção da variância atribuída ao modelo de regressão utilizado, o tamanho de um

ou mais coeficientes de correlação e os intervalos de confiança de interesse.

ok, mas não comentou nada sobre

como identificar a importância

Esta afirmativa não é verdadeira. Pois, depende do que esteja sendo estudado. Tomando como exemplo um nível de significância de 1%, que indica a possibilidade

que determinado resultado aconteça apenas 1% devido ao acaso. Quando levamos este exemplo para a área da saúde, pode ter uma enorme importância, por

representar alta chance de se contrair uma dada doença. Porém, trazendo-o para a nossa área, que normalmente admite um valor maior, representa baixo risco de

que resultados inesperados aconteçam, portanto, menor importância.

a pergunta foi sobre a comparação de

duas regressões... Avalie se sua

resposta faz sentido para esta

pergunta.

2.3.

"3) Calcular os resíduos de uma regressão nos permite inferir na variação devido ao acaso. Valendo salientar que só podemos calcular os resíduos para valores

Porque é conhecidos, não podendo, portanto, determiná-los para valores interpolados, uma vez que se dá pela diferença entre o valor ajustado e o real. Se compararmos o

importa resíduo e a variável independente (X), poderemos visualizar o ajuste do modelo a ser utilizado."

nte

avaliar

os

resíduos

de uma

regressã

o, e que

possíveis

informaç

ões

podemo

s tirar

disto?

como os resíduos permitem avaliar o

efeito do acaso?

Avaliar o resíduo é importante, pois é a partir destes que se estima a variação ocorrida devido ao acaso, indicando o quanto das respostas obtidas por determinado definição de resíduo, mas não

tratamento foi devido ao acaso ou devido ao tratamento mostrando se o modelo utilizado é o ideal para o estudo. Por isto que só se tem resíduo a partir de valores respondeu à pergunta

reais, já que o resíduo é a diferença entre os valores ajustados e os reais, não podendo ser calculado a partir de valores interpolados.

É importante avaliar os resíduos de uma regressão, porque os resíduos representam a diferença entre aquilo que foi realmente observado e o que foi predito pelo

modelo de regressão. Como conseqüência disto, tem-se acesso a informações da estimativa da variação ocorrida devido ao acaso, indicando o quanto das

respostas obtidas por determinado tratamento foi devido ao acaso ou devido ao tratamento e se o modelo utilizado é o ideal para o estudo.

quarta-feira, 31 de março de 2010

ok quanto ao resíduo propriamente

dito, mas nada sobre porque...

Página 5 de 10

Questão Resposta

comentário

2.3.

Resíduos representam a diferença entre o valor observado de y e o que foi predito pelo modelo de regressão, assim, os valores de x no quadro residual são

Porque é idênticos aos valores de x digitados, os valores de y são os resíduos. É importante, após se realizar a regressão, testar se os requisitos dessa aplicam-se; isto se faz

importa com a análise dos resíduos. Esses são a variação do acaso e fornecem subsídios para avaliação o modelo.

nte

avaliar

os

resíduos

de uma

regressã

o, e que

possíveis

informaç

ões

podemo

s tirar

disto?

o miolo ficou confuso... No final

chegou mais perto da resposta, mas

não falou como eles fornecem estes

subsídios...

Porque o resíduo é a variação do acaso, ou seja, a diferença entre o valor ajustado e o valor real encontrado até aquele ponto, o acaso inclui parte da variação

explicada por (X), mas não é explicada de acordo com a equação escolhida, o acaso está fora da equação portanto a equação nunca vai representá-lo. A

comparação entre resíduo e a variável independente é útil para visualizar ajuste do modelo

chegou mais perto falando na

visualização do ajuste do modelo

Resíduos representam a diferença entre o valor observado de y e o que foi predito pelo modelo de regressão. Através dos resíduos, é possível calcular a variação

que foi devido ao acaso, isso porque pode ser realizada a diferença entre o valor ajustado e o real. Do ponto de vista prático, por necessitar de valores com maior

precisão e exatidão, fica praticamente inviável calcular através da interpolação, isso porque o distancia de valores próximos aos reais. Os resíduos da regressão

representam a variação da variável dependente que não é explicada pela variação do fator incluído na análise. Porém, é possível ajustá-lo junto ao modelo de

regressão a ser utilizado.

cumequeé? A última frase não tem pé

nem cabeça, nem muito menos

qualquer lógica... Antes dela, estava

até definindo razoavelmente bem o

que é resíduo, embora não estivesse

indicando nada quanto a sua

importância e possíveis informações

Porque com os resíduos pode-se calcular a variação que foi devido ao acaso, pela diferença entre o valor ajustado e o real. Porém, por necessitar de valores (doses) e como oferece estes subsídios?

precisos e exatos, reais, não é possível calculá-lo para valores interpolados. E ainda oferece subsídios para ajustar o modelo da regressão.

"Os resíduos estatísticos normalmente seguem a distribuição normal. Ele seria a diferença entre o valor ajustado e o valor real, ou valor alcançado menos o valor

obtido. Ele é válido para valores reais e deve ser calculados nestes pontos. A análise de regressão linear não fica completa sem o estudo dos resíduos. Pois os

resíduos podem ser considerados como erros observados. Com os resíduos podemos verificar a variação que ocorre devido ao acaso, saber realmente se os

resultados obtidos nos experimentos foram devido ao tratamento ou ao acaso "

ok quanto ao resíduo, mas não indicou

o porque de estudar ou as informações

"3. Resíduo, é a diferença entre o valor observado da variável dependente e o valor dito antes, ou melhor, estabelecido antes, pela equação de regressão. Logo,

resíduo nada mais do que a diferença entre o valor ajustado e o valor real. Ou seja, é a variação do acaso. Pois , quando esperamos um valor e este não é dado,

sabemos que houve uma variação do acaso que pode ser até um erro talvez, de manuseio, de condução. "

ok quanto à definição, nada quanto a

avaliação, importância destes e

possíveis informações

O resíduo é a diferença entre ajustado e real, sendo, portanto uma variação devido ao acaso, por exemplo: numa leitura de uma curva de potássio, a leitura do

segundo ponto foi de 23 no fotômetro de chama, porém sabemos que o real valor é de 20, portanto temos uma diferença de três (3), que é o resíduo neste

exemplo. A avaliação do resíduo é importante por permitir visualizarmos ajustes de um dado modelo em questão, portanto o resíduo indica quanto que esta

fugindo dos dados reais, e isto é importante para definirmos o quanto este erro é aceitável dentro de um dado estudo, ou simples determinação de um elemento

químico.

como?

É importante avaliar os resíduos da regressão porque é a partir destes que se estima a variação ocorrida devido ao acaso, e as informações dadas pelo resíduo é

quanto das respostas obtidas por determinado tratamento foi devido ao acaso ou devido ao tratamento, e é por isto que só se tem resíduo para valores reais, pois

o resíduo é a diferença entre os valores ajustados e os reais, não podendo ser calculado a partir de valores interpolados.

boa definição de resíduo, mas não

falou nada sobre o como...

quarta-feira, 31 de março de 2010

Página 6 de 10

Questão Resposta

comentário

2.4.

Não concordo com a afirmativa, pois y pode ser apenas estimado pelos valores de x, ou seja, não quer dizer que x seja a única causa de x, mesmo que essa

Discuta regressão seja significativa, pode ser que os valores de x e y tenham sido causados por fatores extrínsecos ao tratamento.

a

afirmativ

a "A

existênci

a de

uma

regressã

o

significat

iva entre

xey

indica

que x é a

causa de

y".

ok, mas faço ressalva sobre a parte de

"única causa". A regressão não permite

afirmar NADA com relação a causa

A afirmativa não é verdadeira já que regressão não significa relação de causa e efeito, ou seja, X não é a causa de Y e sim ajuda a estimalo, pois a relação entre

essas duas variáveis pode ter ligação por outros motivos e X esteja sendo usado para explicar Y. Um exemplo é explicar a quantidade de Al+3 no solo em função do

pH; população de bactérias pode ser predita a partir da relação entre população e o tempo de armazenamento ou em estudos de antropologia, onde utilizam o

femo para estimar a altura de um determinado individuo.

o osso é femur, não femo. Fora isto, ok

"4. Não. Embora, saibamos que em uma regressão y , é uma variável dependente, que se comporta em função de x , que é uma variável independente. Isso não

significa que x seja a causa de y. Pois , y pode sofrer variações embora estas não se relacionem diretamente com x, e sim de situações de terceiros, que tenham

sido influenciados por x."

excelente

Na equação de regressão o x é uma variável independente, e y a variável dependente da equação, e a regressão é apenas uma expressão matemática, para estimar

valores. Porém a variável x pode não explicar totalmente a causa de y, mais explica de certa forma uma percentagem considerada significativa desta causa,

provavelmente nunca 100% de que x e a causa de y. Um exemplo seria a resposta de milho a adubação nitrogenada, onde com o aumento das doses de nitrogênio

aplicado teremos uma resposta no aumento da produção de grão e/ou biomassa vegetal desta cultura, ou seja, se x (doses de adubação nitrogenada) causando um

efeito na produção de grão e biomassa na cultura do milho, (aumento da produção), o que representa a variável dependente y. No entanto, sabemos que outras

variações do acaso podem interferir neste resultado. Portanto x não é causa de y, pois depende da interpretação do pesquisador diante dos valores obtidos diante

de uma regressão, onde uma explicação biológica é a forma mais eficiente de explicar tais variáveis.

pela sua explicação x é a causa de y,

mas pode haver variação do acaso...

Regressão apenas indica como duas

variáveis estão ligadas, não havendo

qualquer julgamento de mérito quanto

à ligação... A parte final indica que a

interpretação do pesquisador seria

com base nos valores da regressão,

quando na realidade a interpretação

para causa e efeito não depende dos

valores

"4) Esta afirmativa não condiz, pois a regressão é uma ferramenta estatística que, baseada em médias, nos permite estimar os valores de Y em função de X. não

deve ser entendida como uma relação de causa-efeito porque possibilita verificar apenas a ligação entre as variáveis."

ok...

"A existencia de regressão não quer dizer que (X) seja a causa de (Y) pois pode ser que outra coisa esteja interferindo, ou seja, a regressao apenas representa

matematicamente a relação entre tratamento e resposta dos dados trabalhados, não explica uma coisa em funcao da outra. "

ok

A afirmativa acima está errada. Porque quem indica a relação de causa-efeito de modo efetivo de que x é a causa de y não é a regressão, mas o conhecimento que

o pesquisador tem acerca do fenômeno ou assunto estudado, haja vista que na regressão tem-se uma relação matemática onde os valores são estimados.

ok

quarta-feira, 31 de março de 2010

Página 7 de 10

Questão Resposta

2.4.

Discuta

a

afirmativ

a "A

existênci

a de

uma

regressã

o

significat

iva entre

xey

indica

que x é a

causa de

y".

comentário

Escrever uma regressão de y em função de x, não quer dizer que x seja a causa de y, ou seja, a variável resposta não é a causa da ocorrência, mas sim um sinal da

sugiro tentar escrever de forma mais

mesma causa. Pode ser que as variáveis estejam ligadas a um agente separado, que ao se usar x torna-se possível explicar o que está ocorrendo em y. Logo, há uma direta, porque está meio confuso. A

relação de causa e efeito, mas que não é explicada pela regressão. A análise de regressão apenas indica qual relacionamento matemático pode existir, em outras

parte final é a mais importante

palavras, nem a regressão nem a correlação podem mostrar que uma variável tenda a causar certos valores de uma outra variável. Entende-se então, que a lógica

de uma relação causal deve provir de teorias externas ao âmbito da estatística.

"4- A regressão não implica na relação de causa e efeito, é simplismente uma relação matemática. É incorreto afirmar que uma equação onde: y= a + bx, dizer que x excelente

é a causa de y. Ou seja: em uma regressão não quer dizer que haja uma relação causa e efeito,escrevendo uma regressão de y em função de x, não quer dizer que x

seja a causa de y. Pode ser que as 2 estejam ligadas uma à outra separada. O fato de exprimir uma regressão não quer dizer x seja a causa de y, quer dizer apenas

que eu estou usando x para estimar. Muitas vezes há uma relação de causa e efeito, mas quem diz se é uma relação de causa e efeito ou não (não é a regressão,

são os nossos conhecimentos sobre aquele assunto). Podemos exemplificar da seguinte forma: Se fizermos uma adubação em relação a produtividade, podemos

afirmar que a adubação é a causa do aumento da produtividade, isso é coerente. Mas isso não é coerente pela regressão, é coerente pelos meus conhecimentos de

fisiologia vegetal e fertilidade do solo, pois não é a regressão que está levando a isso. Outro exemplo seria exprimir a produtividade em função da chuva. A

regressão não é quem está me dizendo que é uma relação de causa e efeito, quem diz o que está acontecendo uma relação de causa e efeito, seria novamente

meus conhecimentos de fisiologia vegetal.,que indica que numa determinada faixa de valores diz que quanto mais chove mais a planta pode crescer."

Esta afirmação não é verdadeira. Pois, a regressão não indica relação causa-efeito. O que fazemos é o uso do “x” para estimar “y”, mas, não indica que “x” é a

causa do aumento de “y”. O que vai me dizer se houve relação causa-efeito são os meus conhecimentos sobre o assunto da minha pesquisa, como exemplo, em

fisiologia vegetal, nutrição de mineral de plantas, comportamento dos íons no solo, entre outras coisas.

ok

Do ponto de vista prático e direto, essa afirmação seria verdadeira, pois observa-se que quando maior o valor de x, aumentaria os valores de y. Dessa forma, é fácil

pensar que se for aumentado os valores de x, automaticamente os valores de y aumentaria, sem levar em consideração de um fator importante, que a regressão

não indica relação causa-efeito. Ao se obter a expressão matemática “x” para estima “y”, porém, “x” não é a causa do aumento de “y”. Por traz desses dados,

vários outros fatores devem ser levados em consideração, e que de certa forma pode estabelecer se houve ou não relação causa-efeito. Dentre esses fatores

podem ser elucidados conhecimentos referentes a pesquisa que de certa forma envolve diversas áreas que fortalecem e auxiliam na análise dos dados.

quase me mata do coração no início,

até o sem levar em consideração...

Bem matar do coração é exagero, mas

considerar a questão como

completamente errada ficou bem

perto...

quarta-feira, 31 de março de 2010

Página 8 de 10

Questão Resposta

comentário

2.5.

Como

podemo

s

compara

r duas

regressõ

es

lineares

diferent

es, e

com

base

nelas

avaliar

se as

resposta

s de y a x

são

semelha

ntes ou

não

entre as

regressõ

es?

esqeuceu r e intervalo de confiança

Duas regressões lineares diferentes só podem ser comparadas com base nos parâmetros da equação de regressão “a e b”, onde b é a inclinação da reta, enquanto

que o valor de a= y quanto x=0. A diferença entre elas é dada pelo b, que é quem indica a inclinação da reta e como estas se comportam, se são positivo ou

negativo, mostrado a influencia de determinado tratamento em “a”, pois este mostra o quanto do evento observado será obtido sem a influencia do “b” e pela

relação desses diferentes parâmetros.

Pode ser comparada com base nos parâmetros da equação de regressão

(y = a + bx) “a e b” onde o y varia em função do b, que é a inclinação da reta,

só faltou o intervalo de confiança

enquanto que o valor de a= y quanto x=0, e o b explica quanto o y varia para cada x. A diferença entre elas é dada justamente pelo b, que indica a inclinação da reta

(ou coeficiente angular) e como esta se comporta, negativo ou positivo (descendente ou ascendente), mostrado a influência de determinado tratamento em a,

onde este mostra o quanto do evento estudado será obtido sem a influencia do b, e pela relação entre estes diferentes parâmetros. E também pode ser

influenciado pelo r, que é o coeficiente de correlação, explicando o quanto do y é explicado por x.

A comparação é possível através da análise dos valores de “a” e “b” da equação da regressão linear y= a + bx, onde “a” representa o valor de “y” quando “x=0”, e

“b” o coeficiente angular (inclinação da reta), quanto “y” varia para cada “x”. Se “a” e “b” apresentarem valores semelhantes nas duas regressões, elas irão se

comportar de maneira semelhante, a mesmo “x”. Com base no coeficiente angular, podemos observar se as respostas (valores de y) são rápidas ou mais lentas de

acordo com o aumento de “x”, ou ainda, se os valores de “y” crescem ou decrescem com o aumento de “x”.

esqueceu intervalo de confiança e r

"5. Podemos fazer esta comparação, apenas com base nos parâmetros a e b da equação . Temos, Y= a + bX, onde o b é o coeficiente angular, responsável pela

finalmente alguém lembrou do

inclinação da reta, indicando se ela é positiva ou negativa, ou seja, ele representa quanto Y muda em relação a X. E o parâmetro a=Y quando X=0. E a diferença ou intervalo de confiança

não entre as regressões será dada justamente pelo parâmetro b. E pelo intervalo de confiança, pois se apresentarem os mesmos valores ou valores semelhantes, as

regressões não serão diferentes. Caso contrário serão diferentes. . Pois,sabemos que a regressão que apresenta maior b é a que melhor representa x e a que

melhor responde."

Se os valores de (a)-(intercepcao no eixo dos Y) forem semelhantes nas duas regressões e a diferença nos valores de (X) for baixa, teremos respostas semelhantes,

pois (b)-(coeficiente angular da reta) determina quanto o (Y) varia para cada (X).

de onde entrou a diferença nos valores

de x nesta história? Além disto,

esqueceu o r

Podemos comparar duas regressões lineares diferentes observando na equação (y= a + bx), conhecendo- se quem são os valores de “a” e os de “b”, onde para x=0

teremos y = a. Então como o “b” indica o grau de inclinação ( aclive ou declive), a depender dos valores, se eles forem positivos ou negativos

esqueceu r e intervalo de confiança

quarta-feira, 31 de março de 2010

Página 9 de 10

Questão Resposta

2.5.

Como

podemo

s

compara

r duas

regressõ

es

lineares

diferent

es, e

com

base

nelas

avaliar

se as

resposta

s de y a x

são

semelha

ntes ou

não

entre as

regressõ

es?

comentário

"5) Podemos compará-las através de estimativas dos parâmetros a e b. parâmetros estes, obtidos pelo método dos mínimos quadrados. Levando em consideração esqueceu o intervalo de confiança para

as médias dos dados relativos a X e Y e o número de observações. Onde a é o ponto em que a reta intercepta o eixo Y, ou seja, é o valor de Y quando X é zero. Por cada um...

exemplo, quando avaliamos a produtividade de feijão caupi em função da adubação. O valor de a neste caso, nos informará a produtividade de feijão caupi quando

não for realizada a adubação, ou seja, Y sem interferência de X. E b é o coeficiente angular da reta, que determina a declividade desta e expressa o valor de Y para

X=0. Quando o X varia em uma unidade, o b indica o número de unidades que varia o Y. Portanto, para dizer se as regressões são ou não semelhantes, precisamos

saber se a e b são semelhantes considerando um mesmo valor de X. Caso b seja positivo, a reta será ascendente, se b for negativo, a reta será descendente."

Podemos comparar duas equações através do coeficiente de determinação (r2), ou seja, quanto de y é explicado pela equação calculada. Por exemplo: para um

coeficiente de 98% e outro de 92%, podemos dizer que o primeiro coeficiente de determinação explica mais y do que o segundo, ou seja, a primeira regressão

explica melhor o que esta acontecendo. A avaliação pode ser feita através da inclinação da reta entre as duas variáveis que é expressa pela letra b da equação em

questão, pois b explica quanto de y varia em função do aumento ou da diminuição do valor de x. A inclinação da reta pode subir ou descer dependendo de cada

situação.

como o r2 indica o comportamento da

regressão pelamordedeus? A segunda

parte está parcialmente correta,

porque não leva em consideração a ou

intervalo de confiança

Podemos comparar duas regressões lineares tomando como base a equação matemática que as representam (y = a + bx), onde: y é a variável dependente, x é a

definições dos itens ok, mas não vi

variável independente, b é o parâmetro ou coeficiente angular da reta e determina a inclinação da mesma e a é o parâmetro ou coeficiente linear que expressa o

onde ficou a comparação...

valor de y para x = 0. Para a obtenção da linha reta de regressão, são calculados, então, a e b, que são as estimativas dos coeficientes linear e angular,

respectivamente. Desses parâmetros, o coeficiente linear (a) define a intersecção da reta com o eixo das ordenadas, e o angular (b), sua inclinação em relação ao

eixo das abscissas e a taxa de variação de y por unidade de variação de em x. A reta de regressão simples é crescente, decrescente ou horizontal (paralela ao eixo x)

conforme b seja positivo, negativo ou nulo. Assim, a diferença entre elas pode ser caracterizada conhecendo-se o valor b, que indica o sentido da inclinação da

reta, se positivo, se negativo ou nulo de modo a refletir matematicamente a relação e a influência de determinada condição experimental em a.

Ao se obter a equação da regressão linear (y= a + bx), é possível a realização da comparação entre as duas regressões, podendo estabelecer entre elas

esqueceu r e intervalo de confiança

semelhanças. Isso só será possível se analisarmos comparativamente os valores de ‘a’ e ‘b’. Dessa forma, pode-se dizer que y=a quando for obtido valor igual a zero

para ‘x’. Sabe-se que ‘b’ representa o coeficiente angular, ou seja, a inclinação da reta, podendo apresentar reta ascendente ou descendente. Vale ressaltar que os

valores de ‘y’ podem aumentar ou diminuir com o aumento de ‘x’, ou ainda se essas respostas são rápidas ou lentas com o mesmo aumento de ‘x’. Os valores de

“y” iram variar de acordo com os valores de “x”. Pode-se analisar as representações de ‘a’ e ‘b’ com valores semelhantes nas duas regressões para verificar o

comportamento destas, com o mesmo valor de x, o resultado será semelhante, apresentando as representações gráficas da reta.

quarta-feira, 31 de março de 2010

Página 10 de 10