Autovalores e Autovetores :

Considere um sistema linear do tipo:

y Ab,

(1)

em A é uma matriz arbitrária N x N, e transforma o vetor b de dimensão N no vetor

y também de dimensão N. Vamos considerar que o nosso objetivo seja resolver

este sistema linear sendo que o vetor

y

é o vetor contendo os dados conhecidos e o

nosso problema consiste em achar o vetor b . No entanto, nesta seção nós não iremos

nos preocupar com nenhum método para a solução deste sistema, ao contrário iremos

nos concentrar no estudo das propriedades básicas deste sistema.

x um vetor em Rn, então

geralmente não há uma relação geométrica comum entre o vetor x e o vetor Ax

(Figura 1a). No entanto, há geralmente certos vetores x tal que x e Ax são

Considerando que A é uma matriz arbitrária N x N e

múltiplos escalares de um no outro (Figura 1b).

Ax

Ax

x

(a)

x

(b)

Figura 1

DEFINIÇÃO: se A é uma matriz arbitrária N x N, então um vetor não nulo x em Rn é

chamado autovetor (eigenvector) de A se o vetor

x , ou seja,

Ax x

Ax

é um escalar múltiplo do vetor

(2)

O escalar é chamado de autovalor (eigenvalue) de A , e x

A correspondente (associado) ao autovalor

para algum escalar

é o autovetor de

1

Autovalores e autovetores têm uma interpretação geométrica em R2. Se o escalar

autovalor de A correspondente ao autovetor

x,

é o

então dependendo do valor do

autovalor a multiplicação por A levará há uma dilatação, contração ou mudança

de direção de x (Figura 2).

x=Ax

x

x

x=Ax

x

x=Ax

(a) Dilatação

(b) Contração

(c) Mudança de Direção

(

(0 <

(

Figura 2

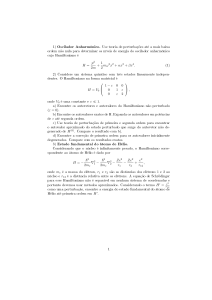

Para acharmos os autovalores da matriz A (N x N) temos que escrever a equação

Ax x como :

Ax I x

(3)

ou seja:

I

Para

- A x0

(4)

ser um autovalor deve existir uma solução não nula para esta equação, ou seja,

deve existir uma solução não trivial x 0 que satisfaça esta equação homogênea.

Uma solução não trivial para esta equação homogênea ocorre se e somente se

DET I - A 0

(5)

Esta equação acima é chamada de equação característica de A ; os escalares que

satisfazem a esta equação são os autovalores de A . Os autovalores de A devem

satisfazer ao polinômio de ordem N chamado de polinômio característico em que o

coeficiente de é 1 e tem a seguinte forma:

DET I - A N c1 N-1 ... cN 0

(6)

2

Interpretação Geométrica de autovalor e autovetor:

Considere a matriz simétrica

4 8

A

8 4

Esta matriz simétrica pode ser interpretada como uma matriz de dados em estatística,

em que as colunas representam variáveis e as linhas representam observações. Assim

o conteúdo de informação desta matriz pode ser visualizado geometricamente em R2 (e

também em R3 matriz 3 x 3), representando-se as observações num espaço definido por

eixos de variáveis (ou vice-versa):

Variável 2

Observação A (4,8)

Observação B (8,4)

Variável 1

Assim os pontos A (vermelho) e B (azul) representam as duas observações (linhas da

matriz) num espaço de duas variáveis (colunas da matriz)

Os autovalores da matriz A são dados resolvendo-se a equação característica. Assim

temos que

4 -

DET

8

8

4 - 2 64 0

4 -

Portanto a equação característica de A é:

2 8 48 0

A solução desta equação são

e ; estes são os autovalores da matriz

A.

3

Por definição temos que

são:

I

- A x 0 portanto

os autovetores respectivos

8 x11 0

4 - 1

8

x1 0

4

1 2

Tomando-se assim temos o vetor normalizado

1

x1

1

e

8 x21 0

4 - 2

8

x2 0

4

2 2

Tomando-se assim temos o vetor normalizado

1

x2

1

.

Introduzindo-se os autovetores e autovalores no gráfico acima temos:

Vemos que os autovetores tomados com módulos iguais ao valores absolutos dos

respectivos autovalores caracterizam uma elipse com centro na origem e que passa

pelos pontos A e B. A forma elíptica indica a existência de um autovalor próximo a zero.

Mas o que significa um autovalor próximo de zero ? Ou ainda. O que significa um

4

autovalor igual a zero ? Veremos, a seguir, que na direção do autovetor associado a

este autovalor próximo a zero há um mal-condicionamento do sistema, ou seja, há uma

dependência linear.

Vamos considerar agora dois casos extremos:

CASO (a) - Neste primeiro caso temos

4 0

A

0 4

Neste primeiro caso os autovalores são

A

e ; e

os autovetores da matriz

associada a estes autovalores são indeterminados: quaisquer dos vetores

satisfazem a equação I - A x 0 .

Graficamente podemos constatar que este caso representa uma situação ideal em que

as observações A e B são o mais diferentes possível (são informações não

redundantes) e os autovalores são idênticos.

A forma circular indica uma independência linear do sistema.

CASO (b) - O segundo caso extremo temos:

5

4 4

A

4 4

Neste segundo caso os autovalores são

A associada a estes autovalores são

e ; e

1

x1

1

e

os autovetores da matriz

1

x2 .

1

Graficamente podemos constatar que as observações são idênticas (redundantes), ou

seja a observação A é idêntica a observação B = (4,4).

Concluímos que o caso (a) representa uma situação ideal: as observações A e B são o

mais diferente possível e os autovalores são valores idênticos. Note que neste o

número de condição (razão entre o maior e menor valor singular) é igual a 1.No caso

(b), ao contrário, as observações A e B são idênticas (redundantes), neste caso o

numero de condição tende para o infinito (razão extrema)

Os três casos que estudados podem ser sintetizados de acordo com o número de

condição:

COND = | | / | | , | | > |

Observações completamente

independentes

COND = 4 / 4 = 1

Observações parcialmente independentes

COND = 12 / 4 = 3

6

COND = 8 / 0

Observações redundantes

Note que a presença de um autovalor NULO ou muito próximo a zero aumenta a

razão (em valor absoluto) entre os módulos dos autovalores extremos e indica

observações redundantes.

Podemos constatar que um autovalor nulo ou muito próximo de zero é um

medidor da não unicidade e da instabilidade, respectivamente, já que a redundância de

observações leva a problema subdeterminado, contendo mais incógnitas do que

observações (equações), e caracterizando portanto uma demanda de informação maior

que aquela contida nos dados observados problema mal-posto.

Então, para caracterizarmos se um problema é mal-posto, basta então

analisarmos os autovalores da matriz associada com o sistema linear

correspondente.

Infelizmente, a análise acima não pode ser aplicada diretamente porque em

geral o número de observações difere do número de parâmetros (incógnitas), de modo

que os autovalores e os autovetores de matriz não quadrada não são definidos.

Veremos abaixo como este problema é contornado.

Sistema linear Arbitrário:

Agora iremos investigar um sistema linear arbitrário n X M

y Ap,

(7)

p de dimensão M e o vetor y

A transforma o vetor p de dimensão M no vetor y

em A é uma matriz arbitrária N x M, o vetor

de

dimensão N. Portanto a matriz

de

dimensão N. É evidente que a matriz A está associada com dois espaços em que um é

de N dimensão e o outro de M dimensão. Se o vetor p do espaço M-dimensional é

dado, o operador A opera e o transplanta dentro do espaço N-dimensional. Por outro

lado, se o nosso objetivo é resolver este sistema linear, em que foi nos dado o vetor

y do espaço N-dimensional (vetor contendo os dados geofísicos), então o nosso

problema consiste em achar o vetor

p do

espaço M-dimensional que o produza por

meio do operador A . No entanto, nesta seção nós também não iremos nos preocupar

com nenhum método para a solução deste sistema, ao contrário iremos nos concentrar

no estudo das propriedades básicas deste sistema

A idéia central que será a base para toda as nossas discussões do

comportamento do operados linear é a seguinte. Nós não consideraremos o sistema

linear

y Ap

AT qx

isoladamente mas expandido pelo sistema adjunto (M x N)

(8)

7

A matriz

AT

x estão

em uma relação de reciprocidade (intercâmbio) com os vetores

tem M linhas e N colunas (M x N) e adequadamente os vetores

y

Concretamente,

enquanto

pe x

e

q são

pe

q e

y.

vetores que pertencem ao espaço N-dimensional,

são vetores que pertencem ao espaço M-dimensional.

Tomaremos o sistema adjunto

A T q x como um sistema auxiliar

formarmos um sistema aumentado. Assim combinaremos o sistema

para

A T q x com o sistema

Apy

dentro do esquema aumentado:

Tza

(9)

em que introduzimos uma nova matriz quadrada T de dimensões ( N+M X N+M ) e

definida como segue:

A

N 0

T

M AT 0

N

M

z

N

M

(10)

q

p

(11)

e

a

N

M

y

x

(12)

O sistema linear pode ser então definido como

0

A T

A q y

0 p x

Vale ressaltar que o sistema adjunto

efeito no sistema linear principal

A T q x não exerce nenhum

Apy.

Assim os vetores

q

e

x são

8

completamente independente dos vetores p e y , e vice-versa. Porém a adição do

sistema adjunto ao sistema linear principal amplia o nosso conhecimento sobre as

propriedades do sistema linear arbitrário N x M.

Como a matriz T é quadrada podemos definir agora seus autovalores e

autovetores. Para tanto vamos tomar a equação fundamental dos autovalores

Twsw

(13)

T s I w 0

ou seja,

(14)

Em vista das características da nossa matriz T de dimensões ( N+M X N+M ) o vetor

w é um vetor de dimensão N+M. Vamos considerar então que o vetor w seja

particionado nos vetores u e v de dimensões N e M, respectivamente

w

u

N

M

v

Então o sistema

Twsw

pode ser desdobrado na seguinte forma:

A v su

T

A u s v

(15)

Este par de equações chamaremos de “problema de autovalor deslocado” uma vez que

os vetores do lado direito u e v estão deslocados quando comparando com o

problema de autovalor já estudado em que temos

Ax x .

Vamos então pré multiplicar a primeira equação do sistema acima por

segunda equação por

A

AT e

a

. Temos então o seguinte sistema

T

T

A A v s A u

T

A

A

usAv

Da primeira equação do sistema (15) temos que

segunda equação do sistema (16) temos que

(16)

A v su .

Substituindo na

9

T

A A u s2

u

(17)

T

Da segunda equação do sistema (15) temos que

primeira equação do sistema (16) temos que

A u sv .

Substituindo na

T

A A v s2 v

(18)

As equações (17) e (18) definem dois problemas de autovalores-autovetores. O

primeiro problema é associado a matriz simétrica N x N

AA

T

e o segundo problema

T

A A , ambos problemas com os mesmos

autovalores não nulos s 2. Os vetores u e v são, respectivamente, os autovetores de

está associado a matriz M x M

AA

T

T

e A A , portanto são vetores ortogonais que geram, respectivamente

espaços de N e M dimensões.

Existirão, no máximo, min (M,N) autovalores diferentes de zero, todos os outros

autovalores serão nulos. Assim se N > M a equação (18) comportará M autovalores que

poderão ser diferentes de zero. Por outro lado, a equação (17) comportará os mesmos

M autovalores que poderão ser diferentes de zero e também comportará N - M

autovalores nulos. As mesmas observações se aplicam, mutatis mutandis, para o caso

M > N.

Presumindo, sem perda da generalidade, que N > M a primeira equação do

sistema (15) aplicado a cada par de autovalor-autovetor leva ao sistema:

A v s u

1

1 1

A v s u

2

2 2

A v s u

M

M M

(19)

Em notação matricial podemos escrever o sistema acima como:

10

A

v1

v 2 ... vM

s1u1

s2 u 2 ... sM uM

(20)

ou ainda

u

11

u21

u N 1

A V

u12

u22

uN 2

... u1M

... u2 M

...

u1, M 1

u2, M 1

... u NM

u N , M 1

... u1N s1

... u2 N

...

0

... u NN

0

sM

s2...

...

0

Finalmente podemos escrever:

A (N M)V (M M) U(N N) S(N M)

as matrizes

UeV

v1

V

(21)

são definidas como

v 2 ... vM

e

U u1

u 2 ... uN

T

T

Isto é U e V são matrizes cujas colunas são os autovalores de A A e A A ,

respectivamente. Como os autovetores são ortogonais, concluímos que os conjuntos

u1

v1

v 2 ... vM formam bases ortogonais

e

que geram os espaços de observações e parâmetros, respectivamente. Assim as

matrizes

u 2 ... uN

U e V tendo colunas que são vetores ortogonais, são matrizes ortogonais.

As matrizes

U e V são normalizadas de modo que U e V sejam ortonormais, isto é:

T

T

I ( M M ) e

T

T

I (NN )

V VVV

U UUU

11

T

Pós multiplicando a equação (21) por

V

:

A V V T US V T

portanto;

A U S VT

(22)

A equação 22 representa a DECOMPOSIÇÃO EM VALORES SINGULARES da matriz

A , assim chamada porque os valores S i que compõe a diagonal da matriz S

raiz quadrada positiva dos autovalores das matrizes

denominados de valores singulares de

T

A A ou

AA

, são a

T

e são

A.

A importância da decomposição de uma matriz em valores singulares está na obtenção

dos valores singulares, cuja análise, como já vimos, permite detectar se um problema é

mal-posto quando pelo menos um valor singular for NULO ou PRÓXIMO DE ZERO.

Veremos a seguir uma análise detalhada da relação entre a não unicidade e da

instabilidade com os valores singulares nulo ou próximo do valor zero.

12

Exemplo numérico da decomposição em valores singulares de uma

matriz A (3 x 2) em que o posto é igual a 1, portanto r < M < N. Neste

exemplo algumas propriedades das matrizes ortogonais U e V são

abordadas.

2

A 4

8

4

8

16

20.4939

0.2182 0.9759 0.0000

0

U 0.4364 - 0.0976 - 0.8944 S

0.8729 - 0.1952 0.4472

0

0

0 V

0

0.4472 - 0.8944

0.8944 0.4472

1.0000 0.0000 0.0000

U U 0.0000 1.0000 0.0000 I ( N N )

0.0000 0.0000 1.0000

1.0000 0.0000 0.0000

T

U U 0.0000 1.0000 0.0000 I ( N N )

0.0000 0.0000 1.0000

T

T

Então conclui-se que: U U U U

1 0

I

V V

0 1

T

I

(N N )

1 0

I ( M M )

VV

0

1

T

T

(M M )

T

Então conclui-se que: V

VVV

T

I

(M M )

0.9759 0.0000

0.2182

UN- r - 0.0976 - 0.8944

U r 0.4364

- 0.1952 0.4472

0.8729

( N N r )

( N r )

V r

0.4472

- 0.8944

( M r ) VM-r

( M r )

0.8944

0.4472

1 0

T

U

U

N

r

N r

U r U r 1(r r )

0

1

( N r N r )

T

13

Então conclui-se que: U r

T

V

1 (r r )

rVr

T

U r I (r r ) e U N r T U N r I ( N r N r )

T

V

M r V M r

1 (M r M r )

Então conclui-se que:

T

V r Vr I ( r r ) e V

T

Ur Ur

T

U N r U N r

T

M r V M r

I (M r M r )

0.0476

0.0952

0.0952

0.1905

0.1905

0.3810

0.1905

0.3810

0.7619

0.0000

- 0.8944

( N N )

0.9759

- 0.0976

- 0.1952

0.4472

( N N )

Veja que:

U r U r U N r U N r

1 0 0

0 1 0

I (N N )

0 0 1

( N N )

T

V r Vr

0.2

0.4

T

T

T

V M r VM-r

0.4

0.8

0.8

- 0.4

( M M )

- 0.4

0.2

( M M )

14

Veja que

T

V r Vr

T

V M r VM-r

1 0

I ( M M )

0 1 ( M M )

0.2182

T

A U r S r V r 0.4364 20.4959

0.8729

2

A 4

8

0.4472

0.8944

4

8

16

Das Equações acima poderíamos escrever:

T

V r Vr

T

V r Vr

T

V M r V M-r

I ( M M )

T

Ur Ur

T

Ur Ur

I ( M M )

T

V M r V M-r

e

T

U N r U N r I

I

( N N )

T

( N N )

- U N r U N r

Alguma propriedades importantes das matrizes ortonormais

V V

T

-1

U T U 1

0.8944

- 0.8944 0.4472

0.4472

0.2182 0.4364 0.8729

0.9759 - 0.0976 - 0.1952

0.0000 - 0.8944 0.4472

15

Alguma propriedades importantes dos Autovalores de uma matriz

quadrada A ( N X N). Considere que i , i 1,, N são os

autovalores de A .

1) A transposta de

2) A matriz

3) Se

A

kA

A

tem os mesmos autovalores da matriz

tem os autovalores

for Não- Singular, então

A

ki

A 1

tem autovalores

1

i

i k

4) A matriz

A kI

5) A matriz

p

A p em que p é um inteiro positivo, tem os autovalores i

6) Se a matriz

A

tem os autovalores

é uma matriz diagonal os autovalores

i aii

16